|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

7 октября 2025 г., 17:25

Закінчилася презентація, яка відкривала OpenAI DevDay, тож можна коротко оглянути представлені новинки.

Codex, той, що в хмарі, став загальнодоступним. Компанія представила AgentKit для створення AI-агентів, ChatKit для вбудовування чату в додатки та App SDK для інтеграції сторонніх сервісів на кшталт Spotify, Coursera та Canva прямо в ChatGPT.

Найсимпатичнішим виглядає AgentKit, в якому є Agent Builder – інтерфейс для створення агентів прямо в браузері, використовуючи вбудовані блоки і функції. У сервісів типу n8n або make тепер є можливість оптимістично розповісти, що їхній бізнес нікуди не дінеться, навпаки, OpenAI привчить так будувати агентів дуже велику аудиторію.

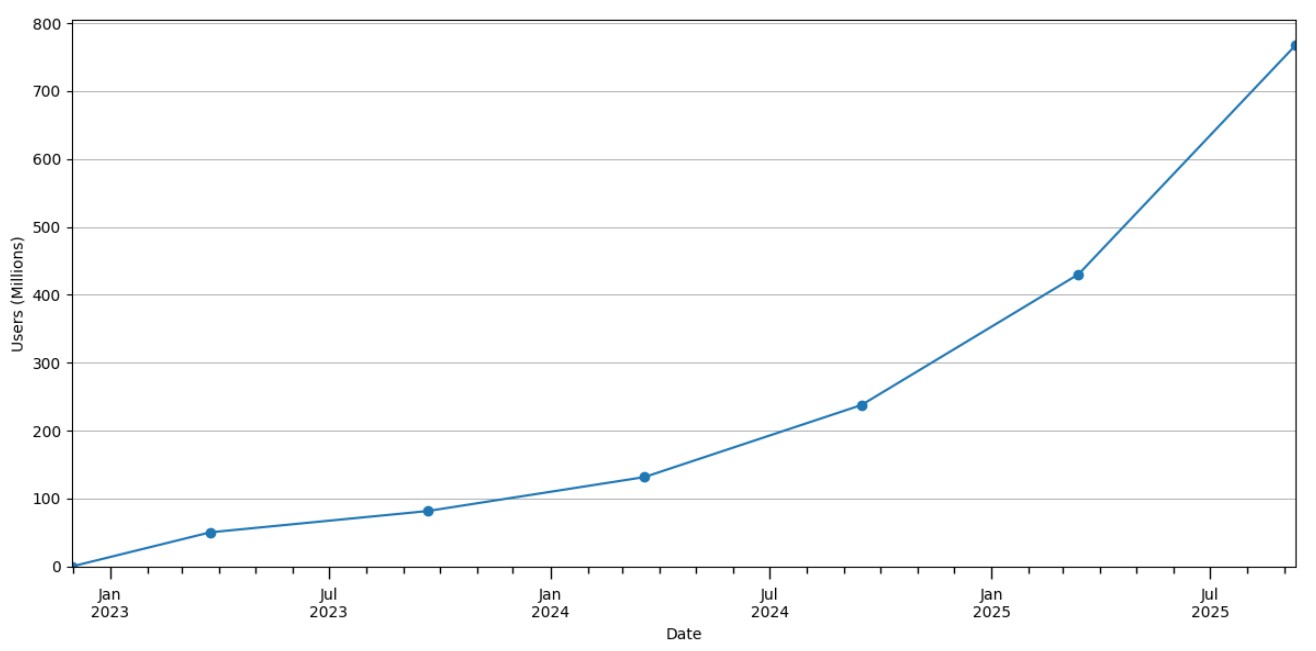

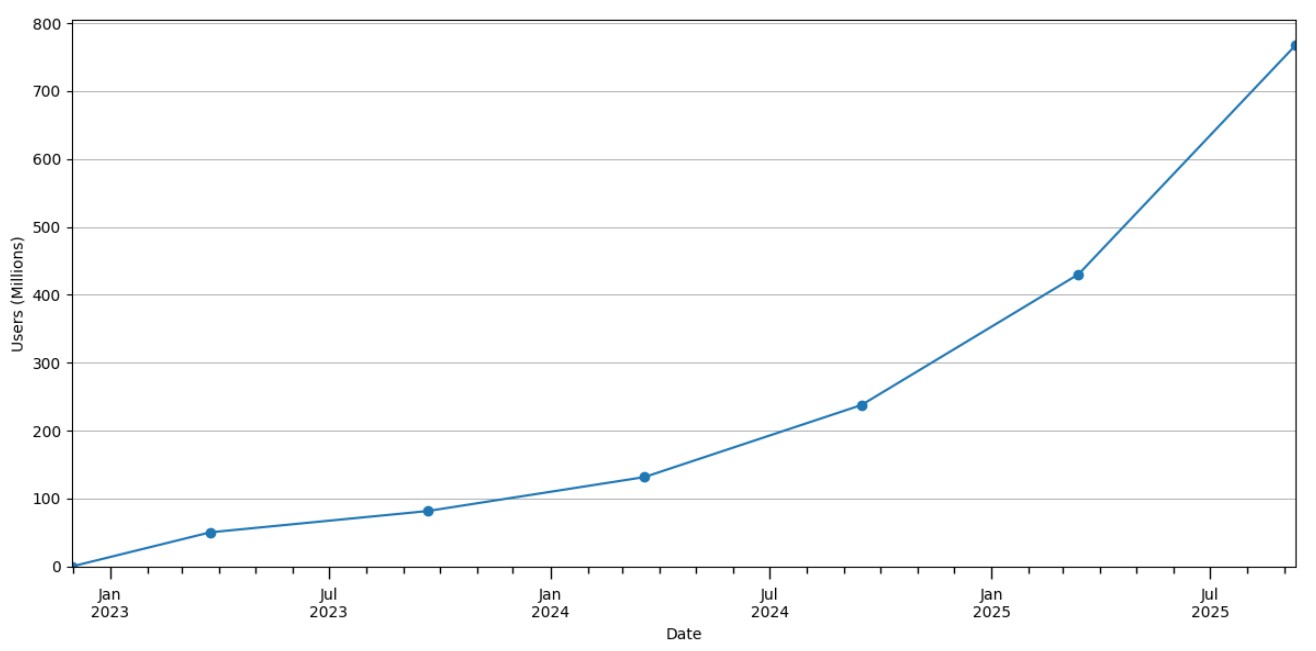

В API тепер з'явиться доступ до GPT-5 Pro і Sora2. А всього у ChatGPT 800 млн користувачів на тиждень.

OpenAI представила AgentKit для створення AI-агентів та інші новинки

2 октября 2025 г., 17:25

Thinking Machines Lab Мири Мураті запустила свій перший продукт – Tinker, інструмент для автоматизації fine-tuning передових AI-моделей через API. Компанія залучила 2 млрд дол. seed-інвестицій при оцінці 12 млрд дол. ще до релізу. Команда – це ключові вихідці з OpenAI: Джон Шульман, який вів роботу над fine-tuning ChatGPT через reinforcement learning, Баррет Зоф (колишній VP досліджень), Ліліан Венг та інші.

Tinker обіцяє демократизувати те, що раніше вимагало кластерів GPU і спеціальної експертизи. Бета-тестери відзначають, що аналоги існують (VERL, SkyRL), але Tinker краще балансує між абстракцією і контролем.

Ось тепер гадайте – 12 млрд дол. оцінка до продукту – це була тільки ставка на команду або ось ця лінія на fine-tuning відкритих моделей представлялася інвесторам з самого початку? І заодно оцініть, що Міра менше ніж за рік дійшла до робочого продукту, а чим переконав своїх інвесторів Ілля Суцкевер широкій громадськості так поки і не відомо.

Tinker для налаштування AI-моделей

26 сентября 2025 г., 17:35

Google DeepMind публікує третю ітерацію Frontier Safety Framework – найдетальнішу версію системи оцінки ризиків від просунутих AI-моделей. Головне нововведення – Critical Capability Level для harmful manipulation, коли модель може систематично змінювати переконання і поведінку людей в критично важливих контекстах.

Компанія фактично визнає можливість втрати контролю над моделями. У документі прямо йдеться про сценарії, де «неправильно налаштовані моделі штучного інтелекту можуть перешкоджати операторам керувати, змінювати або припиняти свої операції». Раніше це обговорювалося як щось гіпотетичне – тепер же в документі розроблені конкретні протоколи для моделей, які здатні розвинутися до потенційно небезпечного рівня.

Фреймворк описує і протоколи тестування нових моделей – причому не тільки перед оприлюдненням моделей на публіку, але і масштабних внутрішніх розгортаннях. Тобто визнається можливість проблем з моделями і при їх тестовій експлуатації всередині компанії.

Загалом, до деплою Skynet готові.

Skynet все ближче

23 сентября 2025 г., 17:25

З цікавістю прочитав свіже інтерв'ю CTO з AI в Мінцифрі України про те, як вони чудово розробляють LLM і той самий чат на порталі Дія.

Загалом, нічого особливо нового про процес я не дізнався. Крім того, що всю розробку LLM буде тягнути на собі «Київстар», а міністерство поки створило п'ять структур для організації та координації. Поки що нинішня інфраструктура того ж чату – це хмара Google. Правда, було несподівано зустріти іронію, з якою CTO заявив, що всю ключову функціональність розробила одна людина, і тому він передає привіт тим, хто будує великі команди. А тестуванням займався ще один тестувальник, плюс допомагали ще якимись командами Мінцифри, плюс залучені DevOps (без зазначення чисельності), плюс ще один займався фронтендом, з яким допомагали всією Мінцифрою. Чомусь тут привіти тим, хто будує великі команди, закінчилися.

Я писав, коли цей чат запустився, що функціонально там досить простий RAG-бот, який знає контент сайту і відповідає на питання по ньому. У чому предмет гордості людей, які зібрали працездатний додаток, я не дуже розумію. Відразу скажу, що аргумент «А ти спробуй сам зроби» зі мною не працює ніколи, а особливо зараз. З лютого місяця я веду розробку бота трохи складнішого. Причому спочатку довелося дослідити потенціал файнтюнінгу доступних моделей, потім розробити панель для оцінки різних моделей, в тому числі використовуючи ще одну модель як суддю, з донастроюванням оцінок LLM за оцінками експерта-людини (я планую детальніше це описати окремо), а вибравши модель, почати розробку чат-системи, яка має в розпорядженні базу податкової та бухгалтерської інформації, що оновлюється кілька разів на день, слідує певній схемі міркувань і видає досить складні відповіді фахівцям.

На цей час вона доступна більш ніж 20 тис. користувачів і обробляє близько 2 тис. запитів на день. Розробник і DevOps там рівно один – я сам з декількома LLM, фронтенд реалізований на Nuxt.js штатним розробником клієнта. У проєкті також бере участь провідний консультант, який спочатку описував, як треба відповідати, а тепер тестує і оцінює роботу. Втім, коли в проєкт потрапили живі користувачі, з'ясувалося, що вони запитують і оцінюють все інакше. Ну, як зазвичай. Проте на сьогодні середня оцінка користувачів – 96%.

За цим передаю привіт Мінцифрі, де тільки для координації розробки потрібно чотири комітети плюс координаційний комітет із семи осіб, включаючи міністра.

П'ять комітетів для організації та координації

17 сентября 2025 г., 17:25

OpenAI опублікувала дослідження на основі аналізу 1,5 млн чатів з ChatGPT. Найцікавіше – люди використовують ChatGPT зовсім не так, як припускали техно оптимісти. Програмування, яке всі вважають чи не головною здатністю GPT, залишається нішевою активністю. Зате половина всіх запитів – це Asking, коли користувачі просять поради, а не генерації контенту. ChatGPT став не інструментом автоматизації, а цифровим радником. Причому 70% використання взагалі не пов'язане з роботою – люди вирішують повсякденні завдання, шукають інформацію, пишуть особисті тексти.

Тижнева кількість активних користувачів ChatGPT

Про особисті тексти не знаю, а ось у мене він повністю замінив пошук в інформаційних запитах. Щобільше, він же прекрасно замінює навіть shopping-пошуки – спочатку пояснює, що саме потрібно для вирішення завдання, а потім з'ясовується, що це продається в Епіцентрі за декілька кілометрів від дому.

Географія теж виглядає незвично. Зростання в країнах з низькими доходами в чотири рази перевищує показники багатих країн. Схоже на історію зі смартфонами та мобільним зв'язком, коли у великій кількості країн, що розвиваються, їх освоєння відбулося без використання дротового інтернету і десктопного інтернету.

Гендерний розрив практично зник – жінки складають вже 52% користувачів проти 37% рік тому.

Правда, за межами дослідження залишилося корпоративне використання – тобто чати корпоративних користувачів. Там, безумовно, все інакше – можливо, програмування і лідирує. Втім, необов'язково.

ChatGPT – не більше, ніж цифровий радник?

11 сентября 2025 г., 17:25

Великий огляд SemiAnalysis присвячений детальному аналізу виробничих потужностей Huawei з виробництва AI-чіпів і доходить до цікавого висновку – Huawei готова штампувати мільйони AI-чіпів Ascend, але натрапляє на вузьке місце у вигляді HBM-пам'яті.

Huawei отримала 2,9 млн кристалів від TSMC до введення санкцій, що дозволило підтримувати виробництво у 2024-2025 роках. Samsung поставив 11,4 млн стеків HBM безпосередньо в Китай, причому 7 млн з них – в місячний період між оголошенням і вступом в силу обмежень в грудні 2024 року. Ці запаси дозволять виготовити близько 1,6 млн чіпів Ascend 910C, але до кінця року вони будуть вичерпані.

Власне виробництво HBM в Китаї компанією CXMT (найбільшого китайського виробника DRAM) знаходиться на початковій стадії. За прогнозами SemiAnalysis, у 2025 році компанія зможе виготовити тільки 2 млн стеків пам'яті – достатньо для 250-300 тис. процесорів. Це істотно нижче потенційних можливостей з виробництва логічних чіпів. Для порівняння, без обмежень по пам'яті Huawei могла б збільшити виробництво з 805 тис. одиниць в цьому році до більш ніж 5 млн в наступному.

При цьому CXMT досі не включена в entity list, попри її критичну роль в потенційному обході санкцій. Автори звіту вважають це серйозною помилкою адміністрації Байдена, яку необхідно виправити.

Паралельно триває виробництво мережевого обладнання та процесорів для дата-центрів Huawei на потужностях TSMC через систему підставних компаній, причому на більш передовому 5-нм техпроцесі. Це звільняє потужності SMIC (китайського аналога TSMC) для виробництва AI-чіпів, але також демонструє прогалини в системі контролю.

У контексті ширшої стратегії США розглядають можливість ліцензування поставок чіпів Nvidia H20 і потенційно потужніших B30A на базі Blackwell. Логіка полягає в балансуванні між стримуванням розвитку китайського AI та збереженням залежності Китаю від американських технологій. При цьому підкреслюється, що дозвіл на постачання більш потужних чіпів повинен корелюватися з власними можливостями Китаю – тільки коли місцеве виробництво досягне зіставного рівня.

Загальна картина показує, що стратегія технологічного стримування працює в короткостроковій перспективі. Виробництво передових AI-чіпів у Китаї буде серйозно обмежене щонайменше до 2026-2027 років, коли CXMT зможе налагодити виробництво конкурентоспроможної HBM пам'яті в потрібних масштабах (чверть міліонна пластин на місяць, що складе 15% світового виробництва DRAM). До цього моменту розвиток китайського AI буде залежати від залишкових запасів, обмеженого місцевого виробництва і можливих каналів обходу санкцій. Але ось після цього досягнення Китаєм повного AI суверенітету по всьому ланцюжку – від виробництва кремнію до генерації токенів, – стане тільки питанням часу.

HBM-пам'ять гальмує AI-амбіції Китаю

8 сентября 2025 г., 17:25

Співробітники OpenAI за результатами дослідження галюцинацій моделей роблять цікавий висновок: причина галюцинацій не тільки в моделях, а в метриках і лідербордах, які заохочують припущення замість визнання невизначеності. Їхній приклад показовий: модель з високою часткою відмов у відповідях дає менше помилок, тоді як більш «смілива» трохи виграє в точності, але різко збільшує частку неправильних відповідей. GPT‑5, за словами OpenAI, вже рідше галюцинує при міркуванні, але не позбавлена цього повністю.

«Правильні» відповіді та граматика масштабуються, на відміну від рідкісних фактів – низькочастотні відомості статистично призводять до вигадок. Калібрування простіше, ніж точність: маленька модель, яка не знає маорі, чесніше скаже «не знаю», ніж велика, яка трохи знає і почне впевнено фантазувати. І загальний висновок OpenAI виглядає досить просто – якщо при навчанні з підкріпленням карати за впевнені помилки сильніше, ніж за невпевненість у відповіді, і частково заохочувати модель за чесну відповідь «Не знаю», кількість галюцинацій помітно зменшується.

AI фантазує, коли не знає або не впевнений

3 сентября 2025 г., 17:25

Новина місяця, мабуть, – суддя Аміт Мехта відмовився від радикальних заходів у справі про монополію Google – компанія не зобов'язана продавати Chrome й Android. Правда, їй заборонено укладати ексклюзивні договори на дистрибуцію і наказано ділитися частиною пошукових даних з конкурентами. Ринок зітхнув з полегшенням: акції Alphabet додали близько 8% на постмаркеті, Apple, яка отримує мільярди доларів на рік за пошук за замовчуванням – близько 4%.

При цьому платити за попередню установку застосунків і установку пошуку (та інших застосунків) як і раніше можна, просто без умов про ексклюзивність. Широкої заборони платежів суд уникає, посилаючись на потенційний збиток для партнерів і споживачів. Ділитися доведеться не всім і не безплатно: рішення згадує «певні дані пошуку і дані про взаємодію користувачів» і не «рекламні дані».

Остаточне рішення буде оголошено на засіданні суду 10 вересня, куди викликаються обидві сторони. Ймовірно, воно може бути оскаржене. Хоча, якщо судити з реакції Мін'юсту, який прокоментував рішення в дусі «Суд визнав нашу правоту», поки продовження не буде.

Google не змушуватимуть продати Chrome та Android

29 августа 2025 г., 17:25

AOL вимикає свій dial-up сервіс 30 вересня. Він був запущений в 1991 році. У 2015 році у AOL було близько 1,5 млн dial-up передплатників. До 2021 року їх кількість скоротилася до «декількох тисяч». І ось ці кілька тисяч людей протрималися ще чотири роки – до 2025-го.

AOL, до речі, не останній провайдер dial-up в Америці. Є й інші компанії. Так що формально послуга залишиться доступною для тих, кому вона дійсно необхідна.

Цікаво порівняти – з 2011 року я не просто не маю доступу до dial-up, у мене півтора десятиліття взагалі немає провідного телефону, куди модем для такого доступу можна було б підключити. І щось я сумніваюся, що у когось в Україні картина виглядає радикально інакше. Хоча, напевно, десь ADSL ще й залишився.

Не останній dial-up провайдер Америки

26 августа 2025 г., 17:25

Apple планує витратити три роки на перезапуск iPhone. Марк Гурман у своїй колонці описує все детально – все почнеться з iPhone Air у 2025 році, який повторить стратегію MacBook Air 2008 року: тонкий, легкий, з компромісами. Одна камера, слабка батарея і перший власний модем Apple замість Qualcomm.

Власне, модем – це ключова деталь всієї історії. Apple працює над ним з 2019 року, коли купила модемний бізнес Intel за мільярд доларів. Перша версія буде слабкішою за рішення Qualcomm, але до 2026 року з'явиться чіп C2, який вже наблизиться до сучасних стандартів. І саме він піде в складаний iPhone з кодовою назвою V68 (м-м-м, згадуються складні моделі Motorola серії V).

Складаний iPhone цікавий не тільки сам по собі – Apple в черговий раз приходить в продуктову категорію, яку довго ігнорувала, поки першопрохідці набивали гулі. Можливо, цього разу вийде так само – Марк пише, що класична «складка» на екрані в Apple повинна бути практично непомітна на тлі моделей Samsung і Pixel.

Правда, в Купертіно вирішили відмовитися від Face ID на користь Touch ID. Технологічне обмеження чи усвідомлений вибір – незрозуміло.

Вінчає цей план 2027 рік, коли вийде ювілейний iPhone 20 з вигнутим склом. До того моменту Apple, можливо, вирішить і проблеми з Siri, поряд з використанням AI взагалі. Не факт, що сама, правда.

Плани Apple щодо розвитку лінійки iPhone

|

|

|