|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

19 декабря 2025 г., 17:25

Колись я регулярно писав у блозі про нові браузери – згадуючи і надбудови над IE типу NetCaptor, і бета-версії Firebird (пам'ятаєте взагалі, що так спочатку називався Firefox?). За останні роки, в принципі, картина визначилася – є Chrome, на маках є ще Safari, для любителів залишився Firefox і є ще деяка кількість різних збірок на базі Chromium різного ступеня серйозності.

Мені завжди подобалося використовувати Safari, але дуже бракувало плагінів. Деяку кількість я останнім часом навіть написав сам, але займатися їх перенесенням на Safari не хотілося навіть за допомогою AI. Іноді я все ж намагався переходити на Safari – оскільки на iPad я використовую саме його, то можливості синхронізації місцями допомагали. Але потім все одно повертався на Chrome – іноді це відбувалося через плагіни, а іноді – через споживання пам'яті.

Довгий час я провів на Mac Studio M1 Max з 32 Gb RAM і він, дуже швидкий в момент покупки, в міру використання регулярно нагадував, що 32 ГБ – це зовсім небагато за нинішніх часів навіть для перегляду сайтів і ще пари стандартних процесів. А я людина недовірлива і легко уявляв собі, як могло б бути швидко, якби не цей гігабайт, позначений як swap браузера.

Деякий час тому я побачив Orion – браузер на основі WebKit, який підтримує плагіни і Chrome, і Firefox, і вирішив спробувати. Дійсно, дуже швидко, АЛЕ – в якийсь момент один з процесів браузера починає просто ЖРАТИ пам'ять. До того ж ряд плагінів, які я використовую, працювали, але не до кінця – наприклад, якось не завжди працював LanguageTool, а 1Password відмовлявся використовувати будь-яку авторизацію, крім введення пароля (тобто не розблоковувався через Apple Watch, наприклад).

До речі, нещодавно у Orion вийшла релізна версія після шести років розробки, і я спробував його знову. На жаль, саме ці проблеми нікуди не поділися.

Бажання вибрати найкращий браузер у мене все одно не зникло. Навіть після переходу на MacBook Pro з M4 Pro і 48 Gb RAM (якщо запитаєте, чому не більше, то відповім, що саме ця конфігурація була тут і зараз і за вигідною ціною) мені досі не подобається бачити процеси, що займають багато пам'яті. Тим більше, що мені є куди її витрачати – підключення трьох зовнішніх моніторів через Thunderbolt Hub і вирішення проблем з їх коректним відображенням займає і CPU, і пам'ять.

Ретельний аналіз всіх можливостей показав, що пам'ять люблять взагалі всі. І тому треба вибирати ті, що люблять її хоча б трохи менше. На подив, фіналістів виявилося двоє, обидва на базі Chromium – Brave і Microsoft Edge. Якщо коротко, то у Brave під девізом приватності та безпеки блокування трекерів і реклами вбудовано в ядро, а не реалізовано плагіном, що дозволяє не приховувати, що не треба, а просто не завантажувати ресурси браузера зайвими запитами. При цьому всі плагіни працюють точно так само, як і в Chrome, тому що це ж Chromium. А Edge краще оптимізований для слабких систем і активніше управляє ресурсами. Але, на жаль, блокувати рекламу і трекери доведеться розширенням, тож виграш на потужній машині може бути слабо відчутним.

До фіналу трохи не дотягнув Safari – він все вміє робити на рідному залізі, але портувати самописні розширення я не готовий, а деяких критичних для мене там просто немає.

Загалом, я вже кілька тижнів живу на Brave і, в принципі, цілком задоволений. Правда, деякі розробники сайтів все ж примудряються зробити щось абсолютно монструозне – наприклад, сайт колишнього Twitter постійно розпухав в пам'яті до 2 гігабайт. З ним довелося справлятися окремо – зробити з вкладки додаток, додати Control Plane for Twitter і вичистити частину фіч.

А ось повторити процес з iPadOS не вийшло. Я часто використовую iPad, причому разом з клавіатурою, і хочу мати там швидкий і зручний браузер. Я, звичайно, знаю, що можливості розробників на мобільних платформах Apple обмежені, але мене б цілком влаштував той самий інтерфейс, синхронізація з десктопним браузером і можна навіть без плагінів.

Не тут-то було. Так, якась синхронізація у Brave for iPad з десктопним Brave є. Але сам браузер, м'яко кажучи, працює дивно. Наприклад, у новій вкладці завжди показується тільки вибране – хоча на десктопі є вибір між вибраним і часто відвідуваними сайтами. При заході на сайт Brave for iPad завжди запитує мобільну версію, і побачити щось звичне можна тільки окремим запитом. Ні, способу налаштувати «Завжди запитувати десктопну версію» я не знайшов. Найдивніше і реально дратує – всі браузери при відкритті нової вкладки, якщо підключена клавіатура, ставлять фокус в поле введення адреси сайту. Всі, але не Brave – вам треба окремо ткнути пальцем в екран, щоб почати цю незвичайну операцію набору адреси сайту з клавіатури. І це чемпіон серед браузерів на iPad за непомітністю кнопки нової вкладки – у всіх цей «плюс» добре помітний і в нього легко влучити пальцем, а у Brave він дуже невеликий, сірий на світло-сірому тлі і приліплений до крайньої вкладки. З огляду на те, що всі крипто-AI-штуки вони якраз вліпили і треба ходити це все відключати, я з цікавістю почекаю пояснень, як обмеження Apple не дають зробити хороший браузер.

Загалом, не так вже й хотілося цієї синхронізації – не настільки, щоб мучитися з цими дивацтвами. Поживу далі на Safari на iPadOS. А на десктопі – так, я цілком задоволений вибором Brave. Особливо, якщо там відключити криптогаманці, інтеграцію і дивний AI.

Вибори браузерів

16 декабря 2025 г., 18:10

Я вже приблизно рік займаюся декількома AI-проєктами, в тому числі RAG-ботом (Retrieval-Augmented Generation), і весь час дізнаюся для себе щось нове. Чому б не поділитися?

Розробка RAG-чатбота вважається простим завданням – багато хмарних платформ, від OpenAI до Cloudflare, пропонують навіть готові рішення, де все можна налаштувати кліками у вебінтерфейсі. Та й для власної розробки немає особливих проблем – візьміть базу знань, розділіть її на невеликі фрагменти, однорідні за змістом (наприклад, питання-відповідь або розділ у великому документі), обчисліть для цих фрагментів векторне представлення (embeddings, у найпростішому випадку це дуже дешево робиться через запит до API, наприклад, OpenAI або Google), збережіть у спеціальному вигляді бази, яка називається «векторною», і чекайте на запитання користувача. Отримане питання теж перетворюєте в ембеддінг і тепер на запит з ним векторна база поверне вам результати, найбільш схожі (similar) на поставлене питання. Залишається сформулювати запит до LLM буквально такого змісту «Ти фахівець служби підтримки (або консультант, залежно від завдання), ось питання користувача, ось що ми знаємо на цю тему, сформулюй відповідь».

Насправді як тільки ви виходите за рамки декількох десятків документів в базі та намагаєтеся навчити бота відповідати на складніші питання, починаються деталі, які сильно впливають на всю роботу. Ось про одну з таких деталей я і розповім.

Поки завдання всієї системи до генерації підсумкової відповіді зводиться до пошуку приблизно схожих питань серед вже наявних, все працює досить просто. Але, якщо ви вирішуєте для поліпшення якості відповіді додати в базу інші документи – наприклад, чому б магазину з продажу алкоголю не додати статті про процес виготовлення вина, винні регіони, традиції Північної Європи з виробництва горілки й так далі, – починаються цікаві проблеми. Пошук по векторній базі чомусь не видає ці чудові, повні корисного контексту статті, або ранжує їх помітно нижче банальних відповідей на питання. Ще гірше стає, якщо ви вирішуєте це завдання для області, де є маса інформації нормативного характеру – від законів до новин.

Причина цього дуже проста – хоча векторна схожість, на відміну від точного входження, і враховує семантику запиту, але все ж вона не може знайти результат, де всі або багато слів запиту представлені синонімами, наприклад. Тобто, якщо питання ставить простий користувач, а у вашій базі відповіді суперфахівців, сформульовані в абсолютно точних спеціальних термінах, пошук поверне щось випадкове – просто нічого схожого на питання «А як мені зробити так, щоб у мене швидко працював вай-фай» у вашій базі, де докладно пояснено, які канали Wi-Fi 2,4 GHz частіше зазнають впливу інтерференції в щільній міській забудові, може і не знайтися. Можливо, розумна LLM в результаті якось відповість без будь-яких підказок у промті, але досить часто, щоб виключити ймовірність галюцинацій, їй забороняють користуватися власними знаннями та використовувати тільки зміст контексту, а там випадкові результати.

Дуже погано, якщо мова користувача і документів в базі відрізняється разюче – наприклад, в базі лежать тексти законів і постанов. І проблема довершується, якщо запит користувача дуже короткий – в цьому випадку він стає схожим відразу на всі документи на тему.

Що можна зробити? Звичайно, є варіант зробити пошук гібридним. Тобто проіндексувати базу ще й з побудовою традиційного пошукового індексу і при пошуку за схожістю паралельно шукати за ключовими словами, об'єднуючи ці результати надалі. Але чи можна сам пошук за схожістю зробити кращим?

Виявляється, можна, і це досить нескладно з погляду логіки. Якщо у нас немає ідеального документа для пошуку, давайте його вигадаємо. Техніка HyDE (Hypothetical Document Embedding) працює саме так: перш ніж стукати в базу, ми просимо швидку LLM згенерувати гіпотетичну відповідь на питання користувача. Нам не потрібна фактична точність – нехай модель галюцинує, головне, щоб вона використовувала правильну термінологію і структуру. Замість питання «чому гальмує вай-фай» ми перетворюємо на вектор згенерований пасаж про «інтерференцію каналів і діапазон 2,4 ГГц». Векторний пошук, отримавши такий «м'ясний» контекст, знаходить реальні документи набагато точніше. Результат стає помітно кращим з двох причин. Така гіпотетична відповідь довша за питання, тому ви відсікаєте випадкові збіги у випадку коротких запитів. Плюс LLM набагато краще розуміє сенс питання, а не тільки схожість, і видає вам проєкт відповіді в тих термінах, які використовуються в документах бази. Цим ліквідується той самий розрив між лексикою користувача і документів.

Звичайно, треба попередити про очевидний ризик. HyDE відмінно працює на загальнолюдських знаннях, але на вузькоспеціалізованих даних може зіграти злий жарт. Якщо на специфічне питання щодо внутрішньої корпоративної політики модель згенерує правдоподібну, але неправильну відповідь із загальносвітової практики, вектор цієї відповіді відтягне пошук убік від ваших реальних документів.

Так, швидкість відповіді на питання падає – яку LLM ви не візьмете, вона додасть кілька секунд до процесу обробки питання, а це блокуюча операція. Але пошук та обчислення ембеддінгів теж займають час, а якщо підсумкова LLM у вас розсудна, то кілька секунд на помітне поліпшення якості пошуку себе виправдовують. Ба більше, краще знайшовши результати, ви можете передати LLM менше документів у запиті й в підсумку виявити, що загальний час відповіді особливо не змінився.

Але над цим варто особливо задуматися – якщо у вас невелика база відносно однорідних документів або якщо поточний пошук в середньому рівномірно покриває результатами всі категорії документів, то, можливо, у вас і немає такої гострої проблеми лексичного розриву між запитами та документами, і вам краще подивитися в бік інших способів поліпшити релевантність пошуку – наприклад, витягувати ключові слова або використовувати query rewriting. Але якщо проблема є і тема вимагає кваліфікованої відповіді, то користувач готовий миритися з декількома зайвими секундами до початку генерації більш точної й повної відповіді.

Ось така цікава техніка. Чудово спрацювало в нашому випадку, коли з'ясувалося, що питання користувачів на бухгалтерські та податкові теми, звичайно, схожі на консультації професійних експертів, але зовсім не збігаються з текстами законів і постанов уряду. Ми в результаті додали й HyDE, і пошук за ключовими словами (і переранжування) – і в підсумковий промпт стали набагато частіше потрапляти нормативні документи, а підсумкова розмірковуюча модель стала генерувати приблизно на 25% кращі (за оцінками людей-експертів) (повні та правильні) відповіді.

Stay tuned, у мене ще багато неочевидних знахідок у запасі.

Гіпотетично, відповідь така…

11 декабря 2025 г., 17:25

Пригоди GPU Nvidia все більше нагадують фантастичні романи, де постійно фігурують суперпроцесори, що дають небачені можливості й стають об'єктами різної активності, від контрабанди до кримінального переслідування.

Спочатку їх забороняли постачати до Китаю. Тепер Трамп заявив, що їх, а саме сучасну модель H200, можна постачати до Китаю, але з обмеженнями. Китайська влада тим часом навпаки, рекомендує місцевим компаніям не використовувати західні чіпи, наполягаючи на використанні аналогів від Huawei та навіть включивши їх до офіційного списку постачальників. Проблема, щоправда, в тому, що китайські чіпи поки що далеко не такі хороші в навчанні моделей.

Тепер TheInformation пише, що DeepSeek тренує наступну модель на Nvidia Blackwell – тобто чіпах вже наступного покоління, які постачати до Китаю навіть не планується.

Схема постачання, описана джерелами, заслуговує на окрему екранізацію. Створюються «фантомні дата-центри» в Південно-Східній Азії, закуповується легальне обладнання, проходить офіційний аудит від Nvidia або Dell. Після чого сервери розбирають до гвинтика і ввозять до Китаю як запчастини. Причому контрабандисти віддають перевагу системам з 8 чіпів, а не передовим стійкам NVL72 вагою в півтори тонни – логістика диктує архітектуру, у валізі стійку не вивезеш.

Тим часом DeepSeek робить ставку на метод sparse attention для зниження вартості інференсу. Саме архітектура Blackwell містить апаратне прискорення для таких обчислень, що дає двократний приріст продуктивності.

Ось так і виглядає реалізація кіберпанку.

Китайські пригоди GPU Nvidia

8 декабря 2025 г., 17:25

Натрапив на статтю в блозі Semrush про те, що золота ера SEO закінчується, AI в результатах пошуку Googel дає все більше відповідей без кліків на сайти, а AI-чати (ChatGPT або Claude) вважають за краще давати посилання на великі бренди. В результаті малий бізнес, який досі сподівався на пошукову оптимізацію і контент-маркетинг, отримує все менше трафіку і що далі робити – невідомо.

Зрозуміло, великий сервіс, орієнтований в тому числі на цей малий бізнес, не може просто підняти проблему – він має розповісти, що робити, і рекомендації там досить зрозумілі. Займіться, пишуть, нормальним маркетингом, будуйте бренд, нарощуйте соціальну присутність і офлайн-активність, і вас почнуть шукати за назвою, а тут вже будь-який пошук вас і знайде.

Можливо, спільність рекомендацій пов'язана, зокрема, і з відсутністю у Semrush готового сервісу, на який можна вказати пальцем і сказати «користуйтеся!». Але в цілому, я б назвав розвиток ситуації справедливим.

Чим, по суті, було пошукове просування для малого бізнесу останні, мабуть, 10 років, якщо не більше? Буквально два напрямки, обидва в міру сумнівні – розставляння посилань і контент-маркетинг. З посиланнями приблизно і так зрозуміло – те, що починалося з абсолютно добровільного обміну або цитування, давно виродилося в агресивну тактику закидання пропозиціями розмістити гостьовий пост, розмістити посилання десь в тексті, поміняти посилання в тексті 10-річної давнини та поставити там замість оригіналу посилання на інший сервіс «майже такий самий, але інший» – загалом, напевно знаєте, про що йдеться. Але що не так з контент-маркетингом?

Та приблизно все не так. Ось є сайт невеликого магазину або невеликої компанії. Контенту на ньому у звичайному випадку не те щоб багато – сторінки товарів, оплата/доставка, «Про нас», що ще може бути в магазині? Але тут приходить контент-маркетолог і розповідає, що не буде ніяких продажів без контент-маркетингу – тобто нових статей пару раз на тиждень на теми, пов'язані зі сферою магазину. Без цього, авторитетно пояснює маркетолог, не буде ні репутації магазину, як видатного у своїй ніші, ні пошукового трафіку, оскільки що тут індексувати пошуку?

Але поставте себе на місце власника магазину. Де він візьме матеріал на дві статті на тиждень? Про що писати? Хорошу статтю написати не дуже просто, навіть якщо у вас є матеріал. А у якої кількості магазинів і бізнесів взагалі є якийсь унікальний досвід, гідний статті? Ви знаєте, що виходить в результаті – численні статті-сміття «Топ-10 чого завгодно», де на першому місці наведено бездоганний продукт автора, а далі всілякі негідні конкуренти, або «Поради початківцям кому завгодно», хоч сантехнікам, хоч ядерним фізикам. Пройдіться по сайтах SaaS-продуктів – вони всі забиті регулярними статтями на абсолютно загальноосвітні теми, часто скопійовані або в інших, або з Вікіпедії. Це була епоха великого рерайту, що тут приховувати?

Ось тепер вона справедливо закінчується – коли йдеться про відповідь на питання, то AI хоч у чаті, хоч у видачі дасть відповідь краще і швидше, без зайвої реклами. А якщо продукт, сервіс, магазин має що сказати, як володарі унікального досвіду, він не пропаде. Я ось у великій кількості пошуків про клавіатури зустрічаю один український магазин, у якого і хороший набір товарів, і глибоке знання теми, і багато власних тестів з докладними оглядами. Шкода, що він такий у нас один, але він заслужив свій пошуковий трафік і мене як покупця.

От ще б соцмережі подібним чином очистити – але це прямо суперечить як бізнес-моделі, так і інтентам користувачів. Так що краще туди просто не ходити. Жартую.

Майбутнє SEO

3 декабря 2025 г., 17:25

Сем Альтман оголосив всередині OpenAI режим «code red». Три роки тому рівно ту ж фразу використовували в Google, реагуючи на реліз ChatGPT. Тепер ролі помінялися: Google Gemini з його 650 млн користувачів та інтеграцією в пошук став реальною загрозою, змусивши піонера ринку перегрупуватися.

Заради утримання лідерства OpenAI ставить на паузу запуск реклами (про яку офіційно не оголошували, але активно тестували) і розробку AI-агентів. Фокус зміщується на поліпшення базового продукту: персоналізацію, генерацію зображень і, що примітно, боротьбу з overrefusals.

Треба ж, всього місяць минув, як я розповідаю, що Gemini мені замінив OpenAI, а Сем вже реагує. Втім, серйозно кажучи, Google – це дійсно загроза, оскільки моделі у Google гарні та він їх дуже грамотно розгортає, причому у формі, зрозумілій користувачам.

Я підозрюю, що ми ще побачимо OpenAI з антимонопольними заявами на адресу Google – мовляв, використовує становище на ринках пошуку та браузерів для просування свого AI.

OpenAI перегруповується через конкуренцію з Google

28 ноября 2025 г., 17:25

Ілля Суцкевер прийшов на подкаст до Дваркеша Пателя і повторив свою тезу про завершення епохи масштабування. За його словами, з 2020 по 2025 рр. індустрія жила за простим рецептом – більше даних, більше обчислювальних потужностей, передбачуваний результат. Тепер дані для pre-training закінчуються, і ми повертаємося в «епоху досліджень», тільки з великими комп'ютерами.

Ілля цікаво пояснює парадокс сучасних моделей, які блискуче проходять складні бенчмарки, але в реальному vibe coding чергують один і той же баг туди-сюди. Суцкевер пропонує витончену аналогію: студент, який 10000 годин тренувався на спортивне програмування, вивчив всі алгоритми, але узагальнює і застосовує абстрактні знання гірше за того, хто витратив 100 годин і просто має «it factor». Поточний RL по суті повторює першого студента – компанії черпають натхнення з бенчмарків для навчання моделей.

SSI (компанія Іллі) при цьому позиціюється як компанія без продукту, яка вибирає стратегію «прямого пострілу» (straight shot) до суперінтелекту, минаючи випуск проміжних продуктів. Мета SSI – створити не просто систему, яка «знає все», а систему, яка здатна навчитися будь-якій роботі так само швидко і якісно, як людина, а потім перевершити її. Як здається Суцкеверу, люди володіють якоюсь технологією навчання, яку ще не змогли реалізувати в моделях.

При цьому він вважає, що досягнення суперінтелекту може не вимагати великих бюджетів – зрештою, трансформери були розроблені на кластерах, що складаються з 8 до 64 GPU. Компанії більше грошей витрачають на інференс. Хоча це звучить іронічно, враховуючи 3 млрд інвестицій, вже отриманих SSI, але вже як є.

Повернення від швидкого масштабування AI до досліджень

24 ноября 2025 г., 17:35

Вихідні в соціальній мережі, раніше відомій як Twitter, пройшли під знаком нової функції – About this account.

Функція гранично проста – тепер, кліком на дату реєстрації в профілі користувача, можна побачити, в якій країні він знаходиться і через який додаток (з точністю до країни магазину додатків) він користується мережею. Початковий варіант містив ще й країну, з якої акаунт був зареєстрований, але майже відразу функція зникла взагалі, а потім з'явилася вже без цього поля.

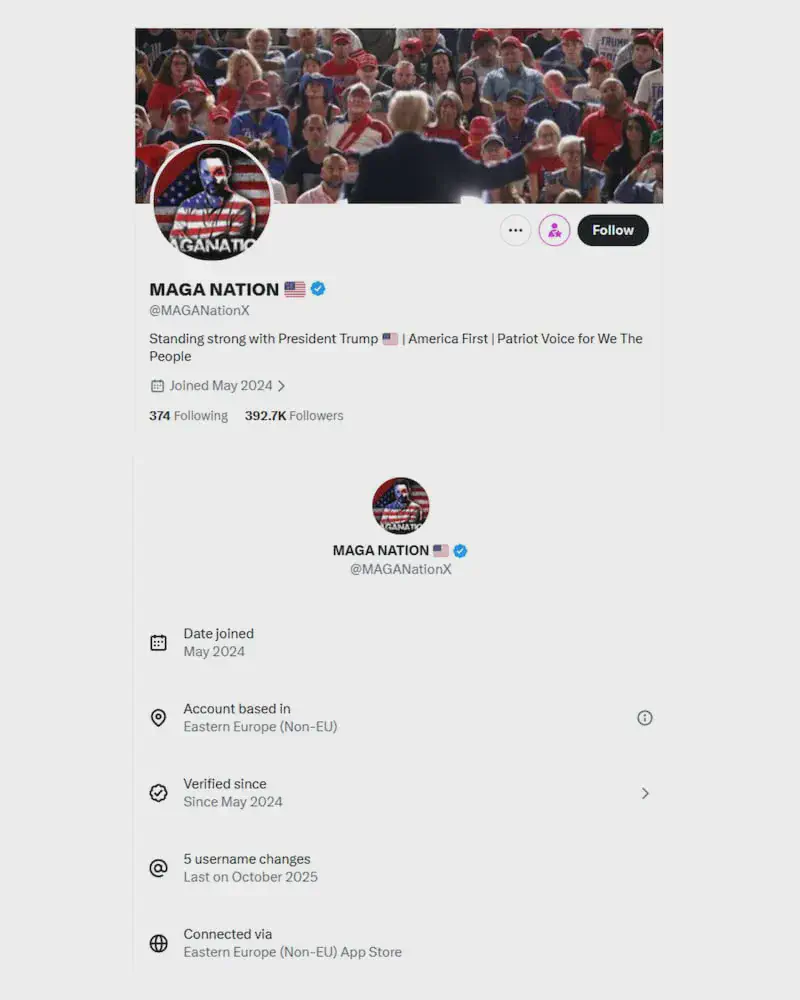

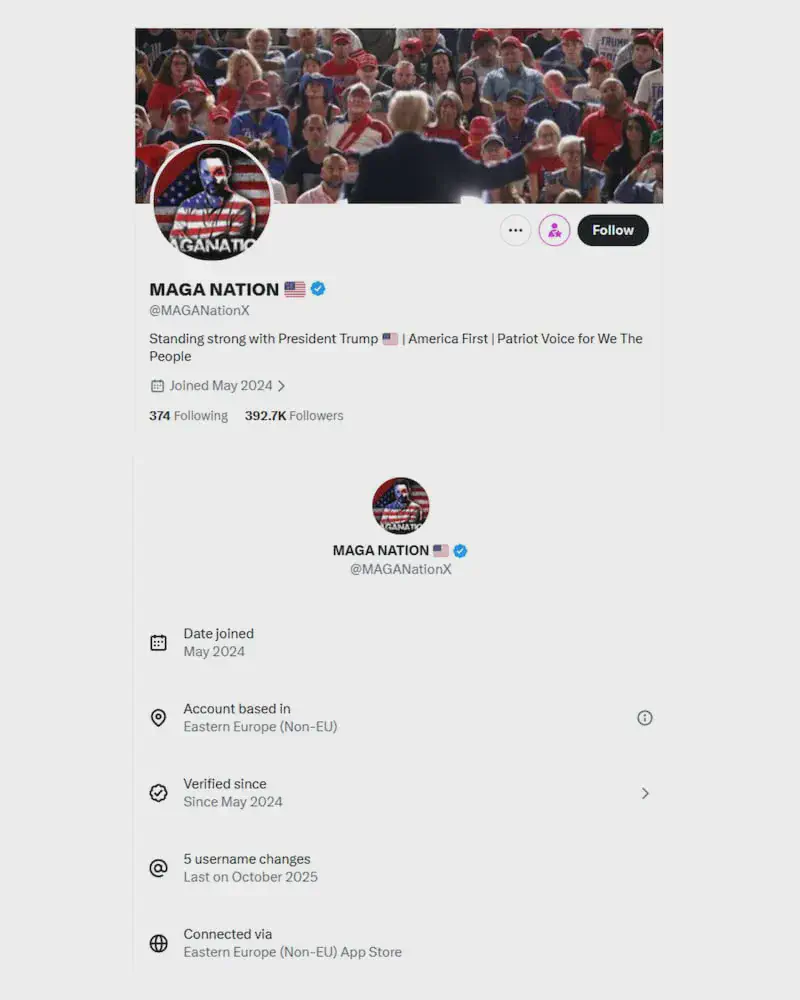

Звичайно, у більшості акаунтів там нічого цікавого – країна, де вони реально знаходяться, національний AppStore або Google Play. Але відразу стали з'являтися цікаві результати. Наприклад, багато акаунтів, що просувають ідеї MAGA (Make America Great Again), чомусь знаходяться не в Америці:

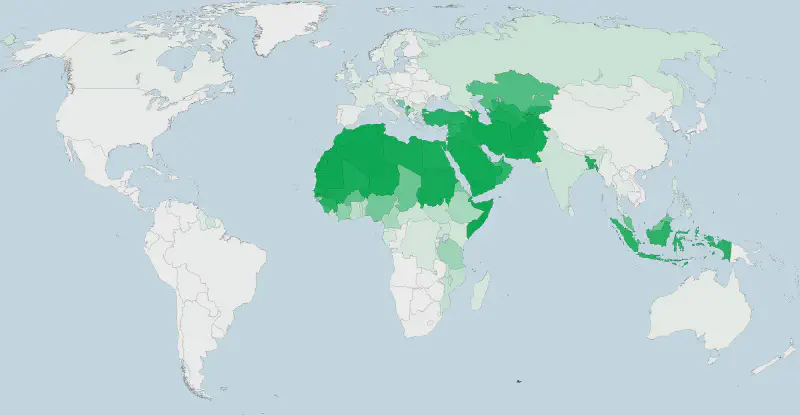

Жителі Гази, які страждають від бомбардувань ізраїльської військової машини, вважають за краще робити це в Індонезії:

Що зовсім не дивно – більшість проросійських акаунтів знаходяться в Європі. Втім, багато з них мають позначку, що свідчить про підключення через VPN, що зрозуміло – адже пряме з'єднання з сервісом в рф заблоковано.

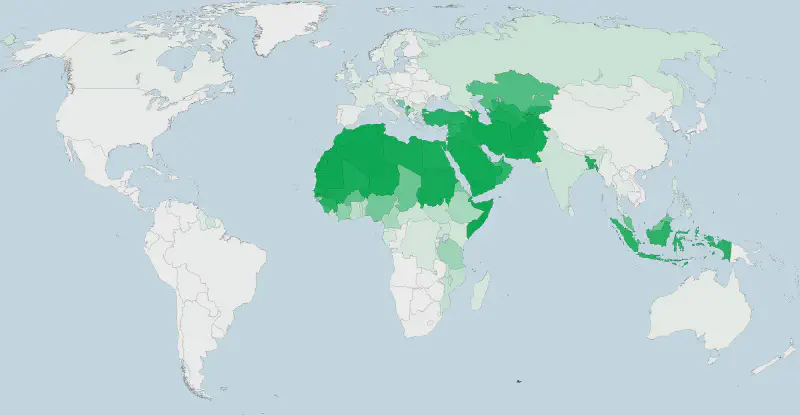

Нова функція, звичайно, дає чимало цікавого з погляду аналітики – наприклад, ось вже побудували карту MAGA-акаунтів.

Джерело https://x.com/DrEliDavid/status/1992706976439238783/photo/1

Але, на жаль, низький поріг входу в інтернет – точніше, низький поріг входу буквально в усе завдяки інтернету, – зіграв і тут свою роль. Постійні читачі та слухачі мого подкасту, можливо, пам'ятають епізод, коли розбирав «аналітику» за профілями в LinkedIn, де авторка робила висновок, що компанія Notion має офіси в Росії й навіть в Ірані(!). Все через те, що якась кількість із сотень мільйонів користувачів цієї соцмережі вказали, ніби вони працюють в Notion (був навіть trader в Notion). А будь-який «аналітик» знає, що все написане в інтернеті – свята правда.

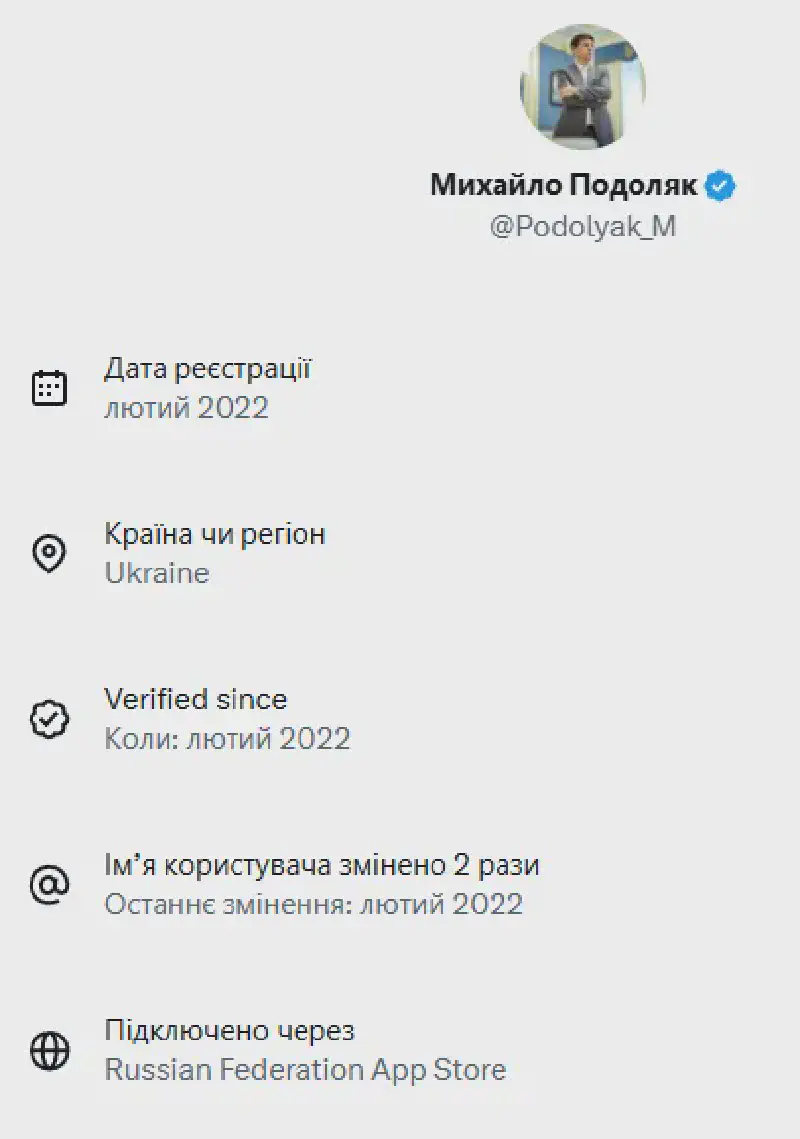

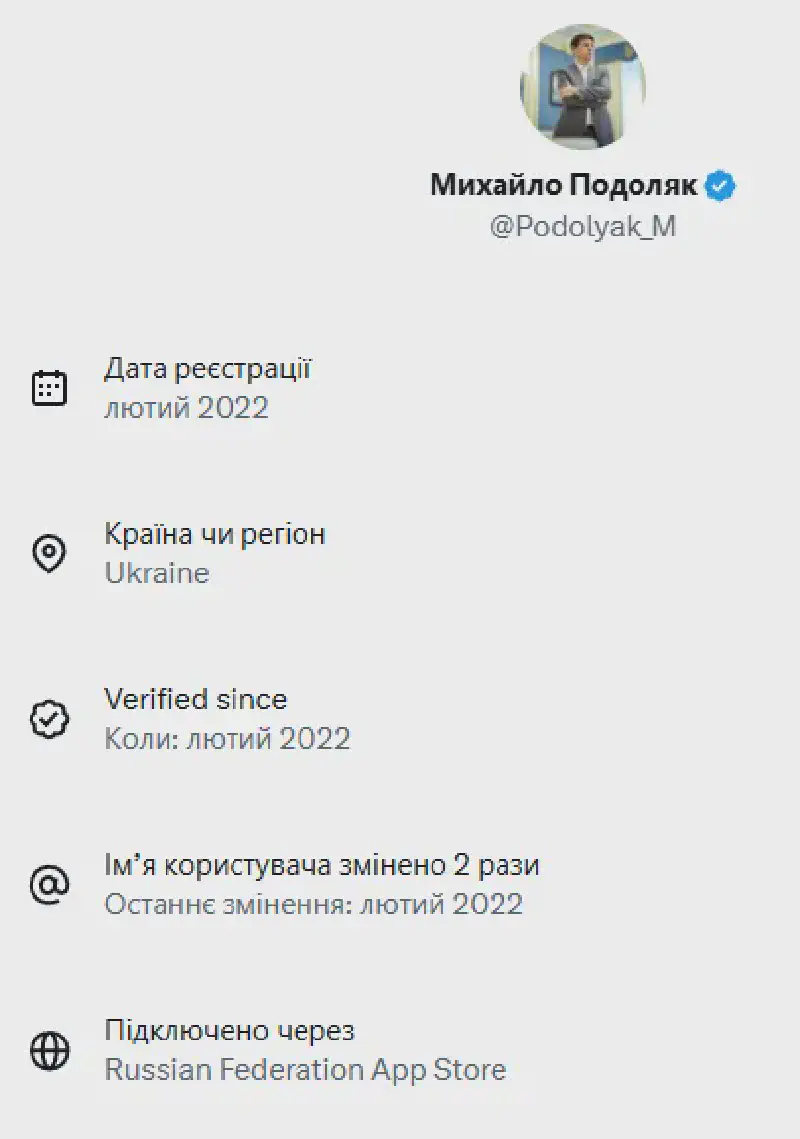

Український сегмент інтернету вважав за краще вхопитися за профіль Михайла Подоляка, політтехнолога і радника глави Офісу Президента України, який часто виступає з офіційними коментарями – у нього, розумієте, в профілі вказаний російський AppStore.

Що бачить середньостатистичний «аналітик» на цьому скриншоті? Що власник акаунта зареєструвався в соцмережі в лютому 2022 року з Росії. Адже інших дат тут немає, а Russian Federation – ось вона. Звідки з’являється ця інформація, такі «аналітики» не знають – і їх це абсолютно не хвилює.

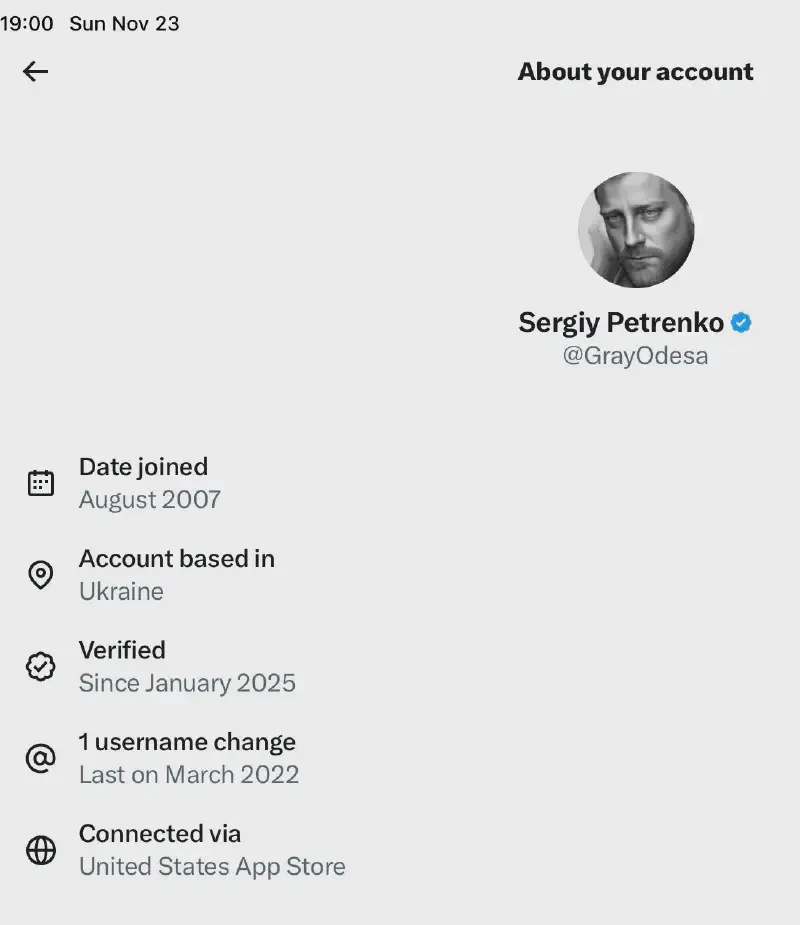

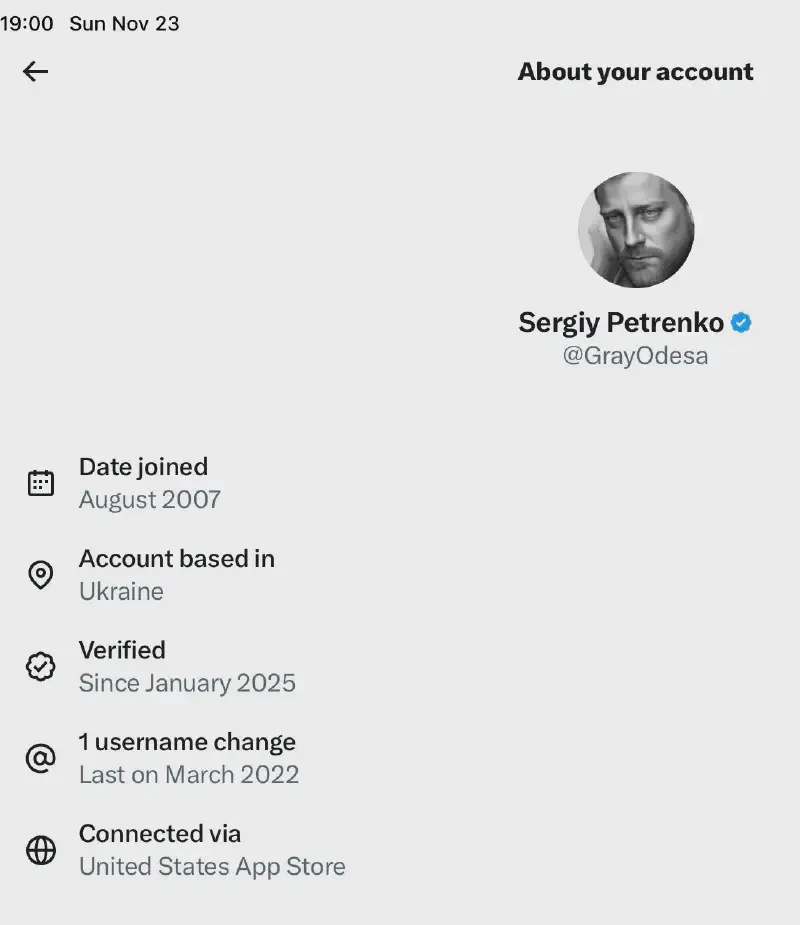

Тим часом інформація в цих полях абсолютно не пов'язана між собою. Ось, наприклад, мій акаунт:

Дивлячись на нього, наш аналітик явно вирішить, що я зареєструвався у 2007 році з США. Але це просто неможливо. Справа навіть не в тому, що вперше в США я побував у 2011 році. На цей смішний аргумент всезнайко мешканець соцмереж заявить, що все можна підробити, включаючи записи DHS (Department of Homeland Security, що контролює в'їзд до США), а ось скриншот із соцмережі – це істина з істин. Але у 2007 році у цієї соцмережі просто не було мобільних додатків – офіційні додатки Twitter з'явилися тільки у 2010 році. А запис про американський AppStore пояснюється набагато простіше – мій акаунт дійсно зареєстрований там і всі ці роки я його поповнюю за допомогою подарункових сертифікатів, причому останнім часом купую їх прямо на сайті Apple.

І я зовсім не виняток. Просто нормальний аналітик, який починає з вивчення фактів, а вже потім намагається зробити висновки, швидко натрапить на факт – AppStore в Україні запустився досить пізно, влітку 2012 року. Перші iPhone з'явилися в Україні восени 2007-го – пам'ятаєте, ті, які треба було розблоковувати, вставляти дивні сім-карти й так далі? Вже до 2011 року iPhone продавався повним ходом, часто з'являючись у продажу через тиждень після старту продажів у США, а iPad мені привезли практично відразу.

І, якщо просто пошукати в інтернеті, нескладно знайти численні статті «Як завести безплатний акаунт в AppStore», де детально описувалося, як вказати реальну адресу в США, відмовитися від прив'язки будь-якої карти та де купити gift card для поповнення рахунку.

У 2012 році, практично перед відкриттям AppStore, я навіть проводив опитування «Хто яким магазином користується?». Результати досі є в цьому самому блозі.

Опитування користувачів, травень 2012 року, показані тільки голоси користувачів з України

І це результати опитування в моїх акаунтах – тобто, загалом кажучи, сильно перекошена в бік гіків вибірка (до речі, чомусь більшість «аналітиків» не знають слова «вибірка», не кажучи вже про термін «генеральна сукупність»). А якщо хтось покопається в пам'яті, то легко згадає, що у всіх магазинах, які торгували iPhone в ті роки, до обов'язкових перехідників під наші розетки, були також рядки в прейскуранті «Реєстрація в магазині та встановлення додатків». Основна маса покупців, які не мали друзів-гіків, в результаті отримувала готовий телефон з якимось акаунтом та вже встановленими додатками, й взагалі не знала, як їх встановити самостійно. Чому б це Подоляку відрізнятися від них, він що, не народ? Гуманітарію-політтехнологу принесли готовий до використання телефон, переставили з попередньої люксової Nokia сім-карту і він почав по ньому дзвонити. А в лютому 2022 року знадобилося піти в Twitter – зареєструвався і почав писати.

Але навіщо вивчати факти, якщо можна розвести істерику в соцмережах і зібрати лайки?

Аналітика міленіалів

19 ноября 2025 г., 17:25

Google представила Gemini 3 – модель, яка, за їхніми словами, наближає компанію до AGI (Artificial general intelligence). З цього приводу в блозі цілий вибух матеріалів, оскільки Google починає впроваджувати її в усі свої продукти. Модель показує вражаючі результати на бенчмарках – 1501 Elo на LMArena, 91,9% на GPQA Diamond, 45,1% на ARC-AGI-2 в режимі Deep Think. Остання цифра особливо цікава, враховуючи, що цей бенчмарк створювався як перевірка на здатність до абстрактного мислення.

Я поки що бачив модель тільки в AI Studio, у звичайному Gemini її немає, хоча випуск, здається, вже почався. Будемо тестувати – треба сказати, що у мене Gemini замінив ChatGPT, а Deep Think дуже допоміг за тиждень використання.

Модель не відрізняється параметрами від попередньої версії – дата закінчення знань – січень 2025 року. Як і у 2.5 Pro, насправді вона навіть раніше, факти другої половини 2024 року їй невідомі. Розмір контексту – 1 млн токенів, 64K на вихід. А ось ціна в API дорожча – $2 на вхід до 200 тис. токенів, $4 – якщо промпт більше 200 тис., а видача $12 і $18 за млн токенів відповідно.

Зверніть увагу, що Flash моделі поки немає – попередню версію запускали інакше.

Загалом, пішли тестувати – за гроші, оскільки безкоштовний ключ не підійде.

***

Разом з анонсом Gemini 3 Google представив Antigravity – це нова агентська платформа розробки, на додаток до Gemini CLI. Насправді Google зробив власну версію Cursor/Windsurf. Звичайно, на базі VS Code, з Gemini та агентами. Можна спробувати, тим більше, що там абсолютно безплатно. Але поки що цікавіше те, що там вже є Gemini 3 Pro. Причому з різним бюджетом на роздуми.

Gemini 3 – крок до загального штучного інтелекту?

14 ноября 2025 г., 17:25

Сара Фріар, CFO OpenAI, виступила на заході Wall Street Journal і згадала, що компанія не планує IPO, але розглядає можливість створення екосистеми фінансування за участю банків, приватного капіталу та федерального «підстрахування» для інвестицій в інфраструктуру. Через кілька годин вона опублікувала пост у LinkedIn, де уточнила, що слово backstop було невдалим вибором. Мовляв, йшлося просто про те, що держава і приватний сектор повинні відігравати свою роль у розвитку технологічного потенціалу країни.

Роз'яснення знадобилося через те, що з'явилися коментарі про складнощі OpenAI з фінансуванням своїх зобов'язань за довгостроковими контрактами. Навіть Девід Сакс, проголошений Трампом «криптоцарем», який виступає радником з усіх технологічних питань, пов'язаних в тому числі з AI, заявив, що ніякої федеральної допомоги AI-компаніям не буде, мовляв, їх в країні вже п'ять і, навіть якщо одна провалиться (читай, збанкрутує), інші займуть її місце.

Втім, швидше за все, це помилкова тривога – поточні темпи зростання провідних AI-компаній навіть не натякають на майбутнє уповільнення зростання, а оскільки всі вони побудовані на підписній моделі, то найближчим часом криві зростання, швидше за все, будуть тільки крутіше задиратися, а не вирівнюватися.

***

Своєю чергою Сем Альтман опублікував розгорнуте пояснення планів OpenAI. Основна думка: ніяких гарантій для приватних компаній не потрібно, але уряд міг би побудувати власну інфраструктуру. OpenAI очікує виручку в річному обчисленні (annualized run rate) вище 20 млрд дол. наприкінці цього року і зростання до сотень мільярдів до 2030-го. При цьому зобов'язання компанії складуть 1,4 трлн дол. за вісім років.

Економічно такий прогноз виглядає амбітно навіть для OpenAI. 1,4 трлн дол. за вісім років – це приблизно 175 млрд дол. капітальних витрат щорічно. Навіть якщо до 2030 року виторг компанії перевищить 200 млрд дол., такі інвестиції вимагають або постійного припливу нового капіталу, або прибутковості, якої поки що немає ні в кого в індустрії. Альтман згадує плани продавати обчислювальні потужності як «AI cloud» – фактично, OpenAI хоче конкурувати з AWS і Azure, використовуючи їхню ж інфраструктуру на перших етапах.

Але, знову ж таки, повертаючись до дискусії – це не виглядає абсурдним. Поки що ми бачимо зростання в рази – за підсумками 2024 року виручка склала близько 4 млрд. Причому annualized run rate наприкінці минулого року становив близько 5,5 млрд. У червні були повідомлення про зростання цього показника до 10 млрд. Тепер, як бачимо, прогноз на понад 20 млрд – тобто майже в чотири рази більше.

Якщо врахувати, що кількість користувачів з серпня 2024 року зросла з 200 до 400 млн у лютому і до 800 млн у жовтні цього року, а конверсія безкоштовних користувачів у передплатників тримається на рівні 5-6%, то зниження темпів зростання явно не передбачається. А ще є міжнародний розвиток – датацентр в ОАЕ будується не тільки і не стільки для поліпшення життя наявних користувачів, це очевидно.

OpenAI не планує IPO, але…

11 ноября 2025 г., 17:25

Цікаві деталі спливли під час свідчень Іллі Суцкевера про події 2023 року, пов'язані зі звільненням Сема Альтмана з OpenAI. Матеріал TheInformation зосередився на гучній темі – виявляється, на той момент обговорювалося злиття з Anthropic. Втім, ось вам повний виклад свідчень, які Ілля дав в рамках позову Ілона Маска до Альтмана. Процес тривав майже 10 годин в офісі юридичної компанії Cooley в Сан-Франциско в присутності представників всіх сторін конфлікту: адвокати позивачів з команди Ілона Маска, захисники OpenAI, представники Microsoft і власні юристи Суцкевера.

У центрі уваги опинився меморандум на п'ятдесят дві сторінки, який Суцкевер склав восени 2023 року для незалежних директорів правління OpenAI. Цей документ починався з жорсткого звинувачення: Сем демонструє послідовну модель брехні, підриву своїх керівників і нацьковування керівників один проти одного. Суцкевер підтвердив, що це була його думка на той момент, і він направив документ тільки трьом незалежним директорам – Адаму Д'Анджело, Хелен Тонер і Таші Маколі.

Суцкевер пояснив, що використовував електронну пошту що зникає для відправлення меморандуму, оскільки побоювався витоку. На питання, чому він не надіслав документ всьому правлінню, включаючи самого Альтмана, Суцкевер відповів прямо: він відчував, що якщо Альтман дізнається про ці обговорення, то просто знайде спосіб змусити їх зникнути. Адам Д'Анджело попросив його підготувати документ, попередньо запитавши, чи є у Суцкевера скріншоти на підтвердження його побоювань щодо поведінки Альтмана.

Меморандум містив безліч конкретних звинувачень. Одне з них стосувалося історії Альтмана в Y Combinator. Згідно з документом, Сема виштовхнули з YC за схожу поведінку – він створював хаос, починав безліч нових проєктів, нацьковував людей один проти одного і погано керував компанією. Однак при детальному розпитуванні з'ясувалося, що ця інформація надійшла до Суцкевера не безпосередньо: її передала Міра Мураті з посиланням на розмову з Бредом Лайткепом. Суцкевер визнав, що сам не розмовляв з Лайткепом, щоб перевірити ці відомості.

Аналогічна ситуація склалася і з твердженнями про Грега Брокмана. У меморандумі йшлося про те, що Грег був по суті звільнений зі Stripe. Джерелом знову була Міра Мураті. Суцкевер підтвердив, що ніколи не звертався до самого Брокмана, щоб перевірити цю інформацію. На питання, чому він не зробив цього, Суцкевер дав просту відповідь: йому це не спало на думку. Він повністю вірив інформації, яку надавала йому Міра.

Меморандум містив цілий розділ під назвою «Нацьковування людей один проти одного». Там наводилися приклади нібито маніпулятивної поведінки Альтмана: Даніела проти Міри, маючи на увазі Даніелу Амодей і Міру Мураті, і Даріо проти Грега та Іллі, де йшлося про Даріо Амодей. Суцкевер критикував Альтмана за те, що той не зайняв тверду позицію, коли Даріо хотів очолити всі дослідження в OpenAI та домогтися звільнення Грега. При цьому Суцкевер визнав, що не має точної інформації про умови Даріо, але його загальне враження було таким, що вони були несправедливими й Сем повинен був відкинути їх відразу.

Ще один епізод стосувався історії з GPT-4 Turbo і порадою щодо безпеки розгортання. Меморандум звинувачував Альтмана у брехні Мірі щодо думки Джейсона – судячи з усього, Джейсона Квона, який на той момент, можливо, обіймав посаду генерального юрисконсульта. Суцкевер не говорив з Квоном про цю ситуацію. Щобільше, він визнав, що заднім числом усвідомив критичну важливість інформації з перших рук для таких питань. На питання, чи було помилкою покладатися на інформацію з других рук, Суцкевер відповів філософськи: інформація з других рук може бути дуже корисною, але вона є запрошенням для подальшого розслідування.

У меморандумі Суцкевер пропонував директорам поговорити з певними людьми для перевірки інформації, включаючи Боба МакГрю і Ніка Райдера. Однак сам він не знає, чи дотрималися директори цих рекомендацій, і не обговорював з ними продовження цих пропозицій. Він також не розмовляв з Діаною Юн або іншими свідками, згаданими в документі. Більшість скріншотів та інформації для меморандуму Суцкевер отримав від Міри Мураті, включаючи скріншоти текстових повідомлень між Грегом і Семом і навіть службову оцінку Міри щодо Сема.

Потім розмова перейшла до подій листопада 2023 року. Суцкевер визнав, що вважав звільнення правильним кроком. Адвокат позивачів процитував статтю з Wall Street Journal, де йшлося про те, що Суцкевер чекав моменту, коли динаміка правління дозволить замінити Альтмана на посаді генерального директора. Суцкевер підтвердив правильність цього твердження. Він пояснив, що чекав, поки більшість правління не буде очевидно дружньою до Сема. Це сталося після серії швидких відходів з правління з різних причин.

На пряме запитання, як довго він розглядав можливість звільнення Альтмана, Суцкевер відповів: принаймні рік. Він уточнив, що слово «планування» було б неправильним, тому що до певного моменту це не здавалося здійсненним. Раніше це було неможливо, тому він не планував. Але він розглядав цю можливість щонайменше протягом року до подій листопада.

Події після звільнення Альтмана розвивалися стрімко. Суцкевер визнав, що був вражений реакцією співробітників OpenAI. Та ж стаття в Wall Street Journal стверджувала, що він очікував, що співробітники зрадіють. Суцкевер уточнив: він не очікував, що вони зрадіють, але й не очікував, що вони матимуть сильні почуття в будь-яку сторону. Це було його переконання на той момент.

Одним з найдраматичніших моментів свідчень стало обговорення пропозиції про злиття з Anthropic. У суботу після звільнення Альтмана відбувся дзвінок правління, на якому Хелен Тонер розповіла про контакт з Anthropic. Суцкевер не був упевнений, хто ініціював контакт – Хелен звернулася до Anthropic або Anthropic зв'язалися з Хелен. Але суть пропозиції була зрозуміла: Anthropic хотіла об'єднатися з OpenAI та взяти на себе її керівництво.

Потім відбувся окремий дзвінок з керівництвом Anthropic. На ньому були присутні Даріо Амодеї, Даніела Амодеї і як мінімум ще одна людина, яку Суцкевер не запам'ятав. Anthropic висловила ентузіазм з приводу злиття, але також згадала про практичні труднощі, які у них виникнуть. Суцкевер був вкрай незадоволений цією пропозицією. На питання, чому, він дав коротку відповідь: він просто не хотів цього. Інші члени правління були набагато більш прихильними, і Суцкевер згадав, що Хелен Тонер була найбільш зацікавлена в злитті. Пропозиція не була реалізована через ті самі практичні перешкоди, про які говорила Anthropic, але обговорення були вкрай короткими.

Контекст цієї пропозиції набував додаткових вимірів при розгляді зв'язків Хелен Тонер. Вона була пов'язана з Open Philanthropy, яка, своєю чергою, пов'язана з Холденом Карнофскі. Холден одружений з Даніелою Амодеї, сестрою Даріо Амодеї, які обидва працюють в Anthropic. Суцкевер підтвердив знання про ці зв'язки, хоча зазначив, що його знання було розпливчастим.

Ще одна історія стосувалася статті Хелен Тонер, опублікованої в жовтні 2023 року. Суцкевер згадав, що вона критикувала OpenAI та хвалила Anthropic. Він не пам'ятав конкретного змісту критики, але запам'ятав, що стаття хвалила Anthropic. Його реакцією було: він вважав статтю дивною. Він вважав дивним, що вона взагалі це зробила. На питання, чи вважав він це доречним для члена правління OpenAI, Суцкевер відповів, що вважав це не дуже далеким від очевидно недоречного. Він обговорював із Семом можливість попросити Гелен покинути правління, хоча не пам'ятав деталей цієї розмови.

Пізніше того ж тижня правління погодилося піти у відставку і поновити Сема Альтмана. Адвокат OpenAI запитала Суцкевера про оцінку процесу, що передував звільненню. Суцкевер сказав одну річ, яку може стверджувати однозначно: процес був поспішним. Причиною поспіху було те, що правління було недосвідченим у питаннях управління радою директорів.

На зустрічі з членами правління та виконавчою командою після звільнення Альтмана керівники заявили, що якщо Сем не повернеться, OpenAI буде знищена, і це несумісно з місією компанії. Хелен Тонер відповіла, що це сумісно, причому сказала це навіть більш прямо, ніж передав сам Суцкевер. На питання про його реакцію на цю заяву, Суцкевер сказав, що не пам'ятає своєї реакції в той момент. Пізніше його запитали, чи вважав він, що знищення компанії було б сумісно з місією. Суцкевер відповів, що може уявити гіпотетичні екстремальні обставини, в яких відповідь була б позитивною, але в той конкретний момент часу відповідь для нього була однозначно негативною.

Після цих подій було сформовано спеціальний комітет правління для розслідування. Його очолили Брет Тейлор і Ларрі Саммерс, які найняли юридичну фірму WilmerHale. Вони проводили інтерв'ю, включаючи бесіду з самим Суцкевером. На питання, чи є у нього підстави сумніватися в незалежності Тейлора і Саммерса, Суцкевер відповів негативно. Однак на питання про цілісність розслідування він зауважив, що на той момент був занадто відсторонений від цих процедур, щоб давати оцінку.

Суцкевер покинув OpenAI в травні 2024 року, хоча точної дати не пам'ятав. Причиною відходу стало велике нове бачення, яке здавалося більш відповідним для нової компанії. У 2024 році він оголосив про створення Safe Superintelligence. Мета нової компанії – займатися новим і іншим видом досліджень. У нього з'явилася нова ідея, як робити речі, і він хотів спробувати їх реалізувати.

Значна частина допиту була присвячена фінансовим питанням. Суцкевер підтвердив, що на момент відходу з OpenAI у нього була частка в капіталі компанії. Ця частка у нього зберігається досі, і її вартість збільшилася з моменту його відходу. Однак коли адвокат позивачів спробував дізнатися конкретну вартість цієї частки, адвокат Суцкевера дав вказівку не відповідати на питання про суму, пославшись на право клієнта на конфіденційність фінансової інформації. Суцкевер міг підтвердити наявність фінансової зацікавленості, але не міг її кількісно визначити.

Це призвело до напруженого обміну репліками між адвокатами. Представник позивачів наполягав, що питання про фінансову зацікавленість свідка в відповідачі у справі, де відповідач звинувачується в багатомільйонних позовах, безсумнівно є релевантним і стосується питань інтересу та упередженості. Адвокат Суцкевера зберіг свою позицію, дозволивши підтвердити наявність інтересу, але не його розмір.

Питання про оплату юридичних послуг також викликало інтерес. Суцкевер сказав, що, ймовірно, його юридичні послуги оплачує OpenAI, тому що не знає, хто ще це міг би робити. Він не отримував рахунків за юридичну допомогу. Його запитали, як він прийшов до цих адвокатів. Спочатку адвокат дав вказівку не відповідати, але потім дозволив відповісти конкретно на питання про наймання у зв'язку з цією судовою справою. Суцкевер розповів, що його спогади не зовсім точні, але він вважає, що почав працювати з іншим адвокатом у фірмі Willkie, а потім його тодішня подруга знайшла Сімону Агнолуччі, і він сам зв'язався з нею.

Суцкевер підтвердив, що ніколи не обговорював цю судову справу з кимось в OpenAI та не обговорював свої свідчення з кимось, крім своїх адвокатів. Він востаннє розмовляв із Семом Альтманом близько десяти місяців або року тому – приблизно в січні 2025 року. З Грегом Брокманом він розмовляв востаннє близько року з чвертю тому. Він ніколи не обговорював судову справу ні з Альтманом, ні з Брокманом.

Під час допиту з'ясувалося, що існує ще один документ – меморандум про Грега Брокмана, аналогічний тому, що був складений про Альтмана. Суцкевер підтвердив, що склав такий документ і надіслав його правлінню. На питання, чи існує версія цього документа десь у будь-якій формі, його адвокат заперечила і дала вказівку не відповідати щодо документів, які він міг надати своїм власним адвокатам. Суцкевер сказав, що знає, що його адвокати мають копію, але потім отримав вказівку не відповідати на питання про те, що він дізнався від своїх адвокатів про те, хто ще може мати копію.

Це призвело до ще одного напруженого обміну. Адвокат позивачів наполягав, що дізнався про існування меморандуму про Брокмана вперше під час цих свідчень, що документ не був наданий, хоча на нього є посилання в загальнодоступних джерелах і в одному з використаних експонатів. Адвокат Суцкевера заперечувала, що документ був згаданий в експонаті, який використовували самі позивачі, що вони знали про його існування, що були широкі обговорення про те, які документи будуть і не будуть надані, і що меморандум ніколи не запитувався і не підпадає під запити про надання документів. Вона наполягала, що якщо вони хотіли меморандум, вони повинні були запросити його до цього дня. Представник позивачів не погодився і заявив, що вони мають намір звернутися до суду з цього питання. Адвокат Суцкевера зробила заяву для протоколу, що вони не згодні викликати свідка повторно.

Наприкінці свідчень, вже близько восьмої вечора, адвокат OpenAI поставила філософське запитання про те, хто, на думку Суцкевера, повинен керувати штучним загальним інтелектом. Суцкевер дав розлогу відповідь. Його поточна думка полягає в тому, що за дуже рідкісними винятками людина, яка буде керувати, швидше за все, буде дуже вправною у поводженні з владою. І це буде дуже схоже на вибір між різними політиками. Він вважає, що дуже важко для когось, кого можна назвати святим, домогтися цього. Він думає, що це варто спроби, але це буде як вибір між різними політиками – хто буде главою держави.

По завершенні допиту адвокат позивачів заявив для протоколу, що вважає свідчення незавершеними через ненадані документи, включаючи меморандум про Брокмана, і через відмову відповідати на питання про фінансові інтереси свідка. Адвокат OpenAI зробила окрему заяву про те, що багато експонатів, показаних свідку, були попередньо виділені маркером, хоча захисту передавалися невиділені копії, і що жодне виділення в документах не є оригінальним для цих документів. Вона зарезервувала всі права з цього приводу, і до цього заперечення приєднався адвокат Microsoft.

Свідчення Суцкевера щодо звільнення Сема Альтмана з OpenAI

|

|

|