|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

22 октября 2015 г., 11:05

Примерно год назад ARM опубликовала timeline выхода операционной системы mbed OS. И это уже было событием для самых разных индустрий – всё-таки «родная ОС» от производителя, лучше всех знающего свои архитектуры, это что-то, да значит. И вот mbed OS появилась. Пока только в бета-версии. Потому сразу никаких выводов «что этот факт может значить» делать не буду вообще, а сделаю краткий обзор – что это, чем интересно, что уже доступно.

mbed OS – нетривиальная операционная система, которую в ARM позиционируют как «ОС для IoT», и речь идёт о потенциально самой большой (если оценивать по численности инсталляций) части IoT – об оконечных устройствах, неисчислимых сенсорах и актуаторах.

Естественно, в ARM не ограничиваются только этой частью IoT, и полный технологический стек для реализации завершённых IoT-систем называют «mbed IoT Device IoT Platform». В более привычных для традиционных IT терминах mbed OS по сути является программным стеком, реализующим всю «клиентскую часть», включая безопасность и сетевые протоколы разных уровней.

Нетривиальность mbed OS (в её текущем состоянии) заключается в фундаментальной идее – это управляемая событиями (event-driven) система. Нельзя сказать, что такое решение уникально, и что mbed OS является единственным представителем event-driven архитектур. Сделаю короткое отступление, буквально несколько предложений о сути идей, лежащих в основе таких архитектур.

Понятийный аппарат: состояние (state) – «точка» в дискретном временном пространстве, полностью описывающая информационный «снимок» системы (или, если хотите, всех переменных в ней), событие (event) – это значимое изменение состояния. Классическим образцом event-driven архитектур являются конечные автоматы (FSM, Finite State Machines), которые технологически реализуются как угодно (даже полностью аппаратно) – от традиционного оператора switch() в бесконечном цикле до управляемой данными табличной структуры и шаблона проектирования State (рекомендую C-программистам этот замечательный и детальный обзор Адама Петерсена). Латентное принципиальное отличие управляемых событиями ОС от классических систем – однопоточность и отсутствие механизма диспетчеризации потоков или процессов (tasks scheduler). А уже это, в свою очередь, означает, что вся ответственность за принципиальную работоспособность системы в целом лежит полностью на программисте, и что о соблюдении фундаментальных для систем реального времени принципов речь вести можно только на уровне «прикладного ПО». Этот базис можно считать достаточным для дальнейшего обзора.

В отличие от многих RTOS с широким диапазоном разрядностей поддерживаемых архитектур, mbed OS создана исключительно для 32-битовых микроконтроллеров ARM, и, возможно этот факт стал основой выбора главного языка реализации – C++. Но язык реализации унаследованных высокоуровневых подсистем безопасности (например, разработанные в приобретённой ARM компании Offspark библиотеки PolarSSL) и даже таких важных абстракций, как сокеты (sockets), остаётся прежним, C. Так что в итоге получается «двуязычная embedded платформа», в которой почти вся низкоуровневая системная часть – объектно-ориентированная, на С++ (что само по себе весьма необычно).

Основной «навигатор» по исходным текстам всего проекта располагается в репозитории mbed-os. Надо отдать должное разработчикам ARM – уровень качества документирования проекта даже в этом его «сыроватом» и для «бета-» состоянии, весьма высок.

С высоты птичьего полёта вся «системная часть» ОС в текущей бета-версии состоит из настроенного над двухуровневым стеком абстракции аппаратных средств «диспетчера событий» (event manager), названного MINAR. Упомянутые два уровня абстракции образованы минимальными С-библиотеками HAL (Hardware Abstraction Layer) и использующими их C++ классами «драйверов». Несмотря на открытость исходных текстов, уровень HAL явно будет претерпевать достаточно серьёзные изменения (сейчас фактически есть две конкурирующих реализации, одна – "оболочка" над официальным "уровнем абстракции железа" ARM CMSIS) и не рекомендуется разработчиками для прямого доступа из пользовательского уровня, поэтому последний, уровень драйверов, умышленно «поднят» до объектно-ориентированного дизайна и языка реализации.

С точки зрения embedded-программиста, MINAR почти предельно прост, это по сути «переключатель» вызовов функций из заданной в теле программы очереди. Что очевидно означает – если управление из такой функции вообще не возвращено программистом в диспетчер, никакого переключения событий больше не будет вообще. Большинство embedded-программистов неизбежно писали что-то подобное «руками», обходясь без высокоуровневых объектно-ориентированных абстракций. И здесь кроется сразу несколько опасных деталей. Обманчивое слово «функция» может обозначать и метод класса, имеющего время жизни и область видимости. И если логика программы такова, что между переключениями видимость или существование объекта класса изменится – всю систему, в которую встроен вычислитель, вероятнее всего ожидает крах. Вторая очень большая сложность систем с таким принципом переключения задач – конечно же, согласование времён исполнения функций-событий. Это заслуживающая отдельного обсуждения тема из области практического программирования, здесь же стоит ещё раз подчеркнуть – mbed OS не является системой реального времени, но написанное для неё ПО можно разработать так, что оно будет соответствовать специфическим требованиям задачи.

Следует заметить, что MINAR не «окончательно единственное ядро» системы, а всего лишь «одно из возможных, работоспособное в текущем состоянии проекта». В планах ARM реализация полноценного ядра RTOS с вытесняющей многозадачностью (точнее, многопоточностью) в 2016 году, и защищённое ядро-гипервизор uVisor для высокоуровневых микроконтроллеров, имеющих аппаратные подсистемы защиты памяти.

Кроме диспетчера событий и уровня абстракции аппаратных средств mbed OS фактически традиционен и предлагает уровень абстракции сокетов с поддержкой Ethernet и 6LoWPAN интерфейсов (естественно, список физических контроллеров пока очень ограничен), Bluetooth LE стек (только для контроллеров компании Nordic Semiconductor), стек SSL/TLS безопасности (популярные библиотеки PolarSSL), стеки некоторых высокоуровневых IoT-протоколов (до сих пор рано говорить о существование «единого стандарта в IoT», потому можно считать эту часть системы «одной из возможных»).

В проекте довольно интересна собственная технологическая поддержка. Своя система компиляции-сборки yotta (на базе популярной Cmake), своя поддержка регрессионного тестирования etc. В целом, параллельно с ПО для целевых платформ, в ARM создают и свой технологический стек.

Итак, ARM делает очередную заявку на «полное замыкание» мира её интеллектуальной собственности (IP) на себя, вплоть до технологического кросс-инструментария. Заявка не первая (уже в 2012 году у ARM была операционная система в составе CMSIS 3). И, похоже, этот процесс оказался весьма непростым (если судить по срокам и наблюдаемым результатам). Для основанных на IP ARM реальных микросхем есть десятки конкурирующих проверенных временем и опытом ОС, и ARM нужно сказать разработчикам какое-то такое «волшебное слово», которое сделает новую систему настолько привлекательной, чтобы оправдать затраты на её освоение и поддержку в своих разработках. Пока, по моему скромному мнению, этого слова не слышно. Проект безусловно интересный и заслуживающий внимания, но этого мало.

А теперь, в качестве компенсации за всё это – немного очень полезных маленьких утилит.

Даже не знаю, почему раньше никто до такого не додумался, но системные администраторы и *nix-программисты эту крохотную утилитку оценят по достоинству. Yank читает из стандартного входа текстовый поток, отображает его на экране терминала скрыто разбитым на поля (разделитель полей можно указать опционально), по которым «бегает» управляемый клавишами селектор копирования в системный буфер clipboard. То есть, это инструмент, дающий интерактивный управляемый выбор «что именно скопировать из потока». Очень полезная утилита.

И ещё одна «игрушка» в копилку всякого полезного – высокоинформативный ping с «человеческим лицом». О ней ничего даже не буду рассказывать, по описанию всё понятно. Тоже очень приятная утилита, но не настолько «прилипчивая», как yank.

Откланиваюсь.

14 октября 2015 г., 17:25

Прочитав впечатления об iPhone 6s из соседней записи в блоге, решился описать радикальную противоположность. Причём во всём. Если iPhone 6s действительно даёт потребителю одно исключительно важное обоснование для выбора (поддержку радиоканалом низкочастотного "дальнобойного" LTE, естественно, там, где такое вообще существует), в моём случае вообще никаких специфических критериев, позволяющих определённо сказать "мне нужно именно Это", не было.

У меня просто сломался древний LG P500, служивший верой и правдой годы. И наступило время что-то выбрать.

Это было непростое время, надо сказать. С одной стороны, - в выбранном ценовом диапазоне вроде как изобилие. С другой - мои критерии, возможно, атипичны. Или наоборот, типичны, но о них никто не пишет. Единственный принципиальный критерий - так как смартфон для меня является расходным материалом, и мои задачи не требуют от него ничего особенного, верхняя ценовая планка ограничена цифрой $250 (я не менял этого принципиального критерия с момента покупки LG P500, честно отработавшего свои 5 лет). Второй принципиальный критерий, выработанный опытом возни с кучей всяких гаджетов разных производителей - я не хочу с ним возиться. Прошивки-перепрошивки, улучшения и прочее, что принципиально можно сделать - это уже очень скучно. Третий, тоже неспецифический критерий - две sim-карточки, 3G, и изредка мне нужен просто LTE (европейский). Очень редко. На пару недель в году.

Выбор начался с ознакомления с обзорами. Как-то получилось, что годами в обзоры смартфонов я не заглядывал - не было такой нужды. Потому сначала было очень смешно. Где-то на третьем обзоре я начал подозревать, что все пользователи смартфонов используют их для решения задач цветокоррекции (иначе зачем эти тщательно измеренные и отрисованные графики цветовых пространств, эти пиксели под микроскопом, "вот это вот всё"?), но от общества эту безвредную девиацию скрывают. Также узнал, что смартфоны "разгоняют", что есть показатели производительности, и что они исключительно важны (правда, не вдавался в эти "антуту" вообще). В общем, узнал столько абсолютно бесполезного, что перестал вообще заглядывать в обзоры. Ну а обязательная в видеообзорах фаза гаджетпорно - "я мееедленно снимаю с упаковки плёнку, меедленно снимаю крышку...", - это вообще какой-то отдельный жанр, невероятно смешной. Извините.

Затем наступил этап просмотра форумов пользователей (я потому описываю все процедуры, что их наверняка проходят многие, кроме тех, кто чётко знает - "хочу именно это", или покупающих "просто по деньгам"). Форумы надо уметь читать. Все их участники делятся на "деструктивно-активных" и "прочих". Форумы чаще всего объединяют именно "деструктивно-активных", у которых первые шаги освоения любого устройства начинаются с получения прав суперпользователя (потом наступает период "ломай всё, чтобы улучшить, любители же знают лучше разработчиков как это сделать", и он завершается или заменой устройства, или... заменой устройства). Потому в таких форумах у большинства что-нибудь, да не работает. Непременно. Или вообще всё не работает. Редко в них напишет кто-то - "купил, включил, пользуюсь, есть маленький вопрос...", такие записи теряются в километрах "хаков и модов". Но именно они представляют ценность.

Третий этап "мук выбора" - оценить предварительно присмотренное "живьём". А вот это уже совсем сложно. Потому что одного места, где собрано "всё", не существует. Увы, несмотря на одинаковость в виртуальности, на фотографиях, все эти шедевры, представляющие собой разновидности деформаций параллелепипеда, не такие одинаковые в реальности. Удивительно, но некоторые доступные на рынке совершенно не "горячие новинки" приходилось просить "на посмотреть" у знакомых.

Четвёртый этап для меня оказался новым. Вопрос "А-бренд или..." как-то раньше и не возникал, всё было понятно. Но тут оказалось, что в этом (подозреваю - самом востребованном не только в EMEA или Китае и Индии) ценовом диапазоне всё очень непросто. До той степени непросто, когда чётких граней уже почти нет.

Простая логика подсказывала, что А-бренды в самом востребованном ценовом диапазоне не будут мучить себя разработкой каких-то "очень своих" оболочек для несчастной Android и порадуют компактными аппаратами с "чистой ОС", оказалась наивностью (всё прочее отпало само собой, хотя я рассматривал и Win-фоны тоже, они отпали просто потому, что у меня в хозяйстве уже слишком развитый "Android-центрический комплект" плюс семейная ответственность за iOS-устройства, и Боливару три платформы не вынести). Увы, у всех, кроме Motorola (продукция которой упрямо "серая") с её Moto G (в котором всё для цены хорошо, кроме неудобств приобретения), всё совершенно не так. А мне, если честно, не хочется "ещё одной оболочки", какой бы она ни была простой и милой (это "необъяснимое" нежелание впоследствии было подтверждено практикой, о чём позже).

В общем, процесс выбора стал совсем неувлекательным, и я уже почти остановился на какой-то устаревшей модели Sony (А-бренд и соответствие всему прочему), которую ещё надо было отыскать, и тут обратил внимание на "чистопородных китайцев". Дальше решение принималось практически спонтанно, по приниципу - куплю так, чтобы можно было гарантированно вернуть за 14 дней, чтобы максимальная "официальность" и чтобы аппарат был ликвиден (учитывая невысокую цену, даже если не понравится потом, продам за пол цены, потеря невелика).

В этот момент "парадигма просто замены смартфона" транформировалась в эксперимент над собой. Тем более, что никогда не имел дела с продукцией "сугубо китайских производителей".

Дальше всё стало просто. Настроился очень ругать всё (на всякий случай), посмотрел, что из "породистых китайцев" самое популярное на нашем рынке (Meizu 2 Note), заказал, привезли. Выбор "по популярности" - не для облегчения жизни, а с надеждой, что большая пользовательская база означает больше выявленных проблем и лучшее знание методов их устранения (ну и ликвидность же, на всякий случай).

Ругаться особенно не пришлось. Не буду повторять обзоры, их без меня написали много. Очень аккуратно всё сделано (от упаковки и дальше), и очень культурно. Сразу понравилось то, о чём никто ничего не сказал - в отличие от многих, китайский бренд ограничился своим логотипом на задней крышке в том месте, которое всегда под рукой, если держишь телефон. Это, к слову, смущало в продукции А-брендов, выносящих логотип на самые видные места - не очень люблю за свои же деньги быть ходячей рекламой, и вообще, бирки с одежды принято спарывать.

Всё заработало из коробки, как должно, почти никаких настроек не потребовало, система не "забита" всевозможным и странным программным "под завязку", вообще непривычных программ очень мало (единицы), мелкие особенности китайской оболочки Flyme более чем рациональны (доступ к переключателю задач свайпом - в первую очередь, я это всегда использую в "чистой" Android с помощью дополнительных программ).

А вот теперь о выделенном слове "почти", и о том, что у китайских брендов реально нехорошо. Точнее, даже не столько у них, а в "экосистеме", где все эти "обзоры" и прочее. Кто мог знать, что утилита "Security" с характерной для всякого антивирусного иконкой в виде щита, даёт мощные механизмы управления энергосбережением, например? Я до этого не додумался сразу. Да и кто заглядывает в те "антивирусы" на смартфоне? А это вызвало мелкие неприятные ощущения, особенно в районах, где сигнал 3G оставляет желать лучшего (батарея буквально "таяла" на глазах). Очень жаль, что в обзорах мне показали пиксель экрана под микроскопом, а о том, что можно сделать с помощью невнятного Security - толком не рассказали. Из-за этого, например, поддержанная забавной политикой Meizu нервная публика спешит получить права суперпользователя и начинает мучить свои аппараты по заветам экспертов (очень забавная политика - эта процедура доступна "по воздуху" и без каких-либо ухищрений, зарегистрировал аккаунт где-то в Поднебесной прямо с телефона - законно автоматически получил root, делай что хочешь).

Больше даже не знаю что и сказать. Один раз случилась мелкая проблема с автоматической регистрацией в 3G сети после перезагрузки телефона и замены порядка установки sim карт (это же эксперимент). Решилась ручной регистрацией через меню System.

Все нужные мне программы установились и работают как положено. Их не так, чтобы много. Привычная мне клавиатура Swype, стандартный немного сокращённый "гуглопакет" Inbox, Drive, Docs, Sheets, Keep, пара "читалок" (5,5 дюймов 1920х1080 экран достаточен для просмотра аттачей к почте в разных форматах) exPDF Reader и Moon+ Pro (для беллетристики, на всякий случай), пара картографических программ (GPS весьма неплох), JuiceSSH (более чем употребимый на "телефоне-лопате"), де-факто обязательные "чатики-скайпы", Twitter-клиент Fenix. Камера в сочетании с программами сканера и ABBYY TextGrabber работает замечательно, да и вообще очень неплоха (как для телефона, конечно). Связь... Это во всех обзорах "закрытая тема". Сравнивая в сложных условиях (например, в удалённом от вышек железобетонном доме, с сильными замираниями сигнала) с iPhone 5 и другими Android'ными "железками", никакой принципиальной разницы не заметил.

В общем и целом - после отключения через Security Center автозапуска кучи наставленных приложений и ограничения им доступа к механизму нотификаций, включения там же механизма энергосбережения "Smart Power Mode", получилось неожиданно для цены качественно и даже приятно.

Больше, кажется, я ничего в ходе этого эксперимента "над собой" (так получилось, что именно над собой, а не над смартфоном) не делал. Работает и работает себе. Честно говоря, за пару прошедших дней привык к нему и вообще обо всём этом забыл.

Остался разве что один косвенный вывод. Китайские производители, имея "под рукой" свой огромный специфический и всё ещё небогатый внутренний рынок, похоже, научились работать в очень опасном ценовом диапазоне. Причём работать достойно. Это хороший пример для подражания. Очень хороший.

Откланиваюсь.

6 октября 2015 г., 19:04

Вчера появившиеся «заводские образы» системного ПО для разных устройств, объединённых брендом Google, и изменение версии системы в первой цифре на единицу – вполне достаточный стимул, чтобы решиться на «страшную» процедуру полного обновления. А прошедшего со вечера времени использования планшета с новой ОС хватает, чтобы уже что-то о ней рассказать.

Постараюсь вообще не затрагивать новые механизмы, зависящие не только от пользователя и его устройства, и требующие координированных сторонних усилий множества разработчиков (такие тоже есть, например, App Linking, обеспечивающий удобство механизма соответствий URL и активируемых приложений).

Для начала, совсем необязательное и непользовательское – версия загрузчика (bootloader) осталась неизменной, а «заводской образ» стал незначительно больше, по сравнению с последней версией ветки 5.x, речь идёт всего о паре десятков мегабайтов в образах системной части.

Вот и посмотрим, что же этой «дельтой» размером почти 20 MB в Google реализовали.

Первое, что бросается в глаза сразу после «прошивки» новой ОС – изменился дизайн индикатора загрузки системы. Характерных «летающих шариков» больше нет, вместо них появилась забавная и явно более соответствующая критериям «material design» анимация (трудно что-то рассказать об этих хитрых четырёх шариках, многие это увидят своими глазами). Совершенно ничего не значащая милая мелочь, но она явно для того, чтобы стало понятно – для разработчиков мелочей нет.

Конфигурирование системы «с нуля» сразу показывает нечто новое. Всплывающее окно диалога подключения к Wi-Fi сети стало проще и «чище» по сравнению с аналогом в версии 5.1.1, но это совершенная мелочь, «подчистка» интерфейса для соответствия критериям дизайна. Но теперь с настройкой аккаунта Google система предлагает возможность сразу указать дополнительные (корпоративные) IMAP или POP3 аккаунты. Иными словами, BYOD в действии, с первых шагов (сюда же следует отнести и появившийся в шестой версии Android For Work, но это отдельная тема для обсуждения, да и в целом «надсистемное» решение).

Так как полная «перепрошивка» – процедура, требующая редкого при использовании современного Android-устройства проводного USB-подключения, первая же загрузка свежей системы без отключения от ПК показывает и нечто новое в USB-подсистеме. Новое и приятное. Теперь по умолчанию USB-подключение переводит устройство только в режим подзарядки, а иконка нотификаций позволяет вызвать диалог управления режимом USB-подключения. При этом, например, если выбрать режим MTP передачи файлов, без всякого сомнения результат разительно отличается от того, что было в предыдущих версиях. Похоже, в Google серьёзно переработали USB-подсистему (серьёзность подтверждается и заявленной поддержкой USB Type-C), и прежних надоедливых странностей (по крайней мере, при совместной работе с ОС семейства Windows я с ними сталкивался постоянно) больше нет вообще.

Управление USB-подключением из нотификаций распространяется и на подключение «для отладки» в режиме разработчика, но в этом случае дополнительного диалога нет, просто активируется соответствующий (developer) «раздел» настроек System.

Теперь, сохраняя последовательность, надо сказать об одной забавной и необязательной для всех особенности Android 6. Это может быть полезно, например, пользователям планшетов Nexus 7 2013, лишённым штатной возможности подключать карточки памяти. А также программистам, для отладки и прочих «мучений» любых устройств.

До шестой версии «внешние» USB-накопители для Android были чужеродным явлением. Теперь же они становятся «родными», ОС может работать с ними как с «нативными» файловыми системами в формате Ext4, причём, по желанию пользователя, ещё и с зашифрованными.

Так что даже если вы не программист для платформы Android, но интенсивно используете свой смартфон или планшет, знаете, что такое «OTG кабель» и с помощью каких ухищрений можно подключать к устройству, например, обычные внешние USB «флешки», не спешите после перепрошивки сразу отключать устройство от ПК. Теперь не требуется получение прав суперпользователя и установка дополнительных программ, чтобы носить «всё своё с собой» на обычных USB флешках (я, например, так делаю давно, это очень удобно, а теперь стало ещё удобнее). Не пугайтесь, что ссылка ведёт на описание API ОС, в разделе «Adoptable Storage Device» есть синтаксис заветной команды adb (если вы «перешиваете» своё устройство «фабричными образами», вы должны знать, о чём идёт речь), результатом выполнения которой будет «эквивалентность внешнего накопителя с форматированием и шифрованием внутренней памяти устройства»:

adb shell sm set-force-adoptable true

(Естественно, чтобы выполнить эту команду и один раз навсегда включить такую удобную скрытую возможность ОС, в вашем устройстве должен быть включён режим «разработчика» и оно должно определяться командой adb, это обычные требования)

Многим Adoptable Storage не понадобится вовсе, но мне лично, например, это очень нравится просто для хранения на старых флешках кучи музыки и библиотек, с подключением «по желанию», с независимостью от непрерывного доступа к Интернет, или при нежелании такового (что теперь со многими случается всё чаще).

Ещё одно «системное» радикальное изменение – появление диалогов управления разрешениями (permission) приложений при их инсталляции и расширение этой же функциональностью соответствующего раздела настроек системы. Возможность явного включения-выключения отдельных разрешений программам ничуть не раздражает из-за фактической одноразовости, но при параноидальной подозрительности может привести к забавным последствиям. Так, при установке давно легально приобретённого файлового менеджера Solid Explorer я «наконец» заметил, что ему требуется доступ к телефонной функциональности устройства. И, так как мой планшет такой функциональности не имеет по определению, я из любопытства это разрешение отключил. За что Solid Explorer решил меня наказать сообщением о невозможности распознать факт его приобретения. Если кто-то с подобным столкнётся – ничего необратимого не произошло, все отключенные при инсталляции разрешения можно включить потом, в соответствующем разделе настроек System, и приложение заработает как надо.

Ещё одно новое в общесистемном – расширение механизмов управления энергосбережением за счёт невидимого режима Doze. С ним всё просто, понятно и логично – если устройство лежит неподвижно и его датчики, акселерометры и гироскоп это подтверждают, система переводится в режим «дозированного потребления энергии», при этом приложениям ограничивается доступ к сетевым адаптерам, ресурсам процессоров etc. Периодически система на короткие промежутки времени выходит из Doze-режима, чтобы приложения могли выполнить временно отложенные синхронизации.

Новая функция-невидимка подсистемы энергосбережения, «app standby», в перспективе будет радовать владельцев продукции компаний, очень любящих «напичкивать» штатную поставку ПО разнообразным хламом. И, похоже, даже является реакцией на это горе. Приложения, которые не используются пользователем, при батарейном питании автоматически переводятся системой в фактически «замороженный» режим. Очень здравая идея. Можно даже помочь системе выявлять такие приложения, запрещая подозрительным право доступа к механизму нотификации (заодно они будут и меньше раздражать).

Об этих скрытых функциях стоит знать, несмотря на их невидимость. Например, если вы пытаетесь синхронизировать что-то большое «в фоне от прочих дел», и оставляете устройство лежать в надежде, что всё сделается, в итоге окажется, что этого не случилось. Это не «ошибка», это логика работы системы. Так что фоновую синхронизация, например, больших коллекций в Evernote или Pocket надо проводить в режиме активного использования устройства.

Из субъективных наблюдений работы системы питания в сочетании с новыми невидимыми функциями энергосбережения – скорость зарядки устройства. Она заметно возросла по сравнению с версией ОС 5.1.1, буквально в разы.

Я ещё не проверял работу новой системы построения и восстановления резервных копий, Auto Backup, но, надеюсь, она делает именно то, что заявлено – сохраняет в Google Drive что выбрал пользователь, в том числе и полностью содержимое инсталляционных каталогов программ. Последнее означает, что восстановление рабочего состояния устройства «как было» после, например, заводского сброса, теперь не требует сторонних программ вообще. Что ещё интереснее – Google не учитывает требуемое для бэкпапа дисковое пространство Drive в механизме его квотирования. То есть, даже если ваш Drive заполнен «под завязку», бэкап ваших Android-устройств будет работать так, как должен, и Google не будет требовать от вас перехода, например, на другие тарифные планы Drive (правда, объёмы данных приложений ограничены 25 MB для каждого).

«Копошась» в системе (чего в режиме повседневного использования никто не делает), постоянно находишь какие-то мелкие изменения. Например, в разделе управления приложениями в Settings. Здесь появилась возможность прямого вызова настроек приложения. Расширились возможности управления нотификациями. В разделе Memory – возможность просмотра усреднённого потребления оперативной памяти отдельными приложениями. Таких мелких результатов «полировки» системы есть в достатке (всплывающие меню копирования-вставки, регулятор громкости, виджет закладок браузера Chrome, «упрощённый» до красоты штатный виджет цифровых часов etc), большинство пользователей их или просто не заметят, или воспримут как должное, потому что всё это сделано очень логично и «органично».

О сугубо субъективных изменениях (что случилось с «плавностью» анимаций и прочем подобном) ничего сказать не могу, потому что никогда не умел это измерять. Всё работает так, как должно очень хорошо работать. Разве что рендеринг шрифтов вроде как (подчёркиваю, - вроде) стал лучше.

О каких-либо проблемах с приложениями ничего не могу сказать, те 40 с небольших приложений, которыми я пользуюсь, ничего подозрительного не выявили (разве что новый штатный анализ использования памяти позволил сразу отобрать самых «прожорливых» и задуматься о поиске альтернатив).

Завершить этот краткий обзор придётся странно. Во-первых, после восстановления привычных приложений, Android 6 перестаёшь замечать. И «копошиться» в системе на пользовательском уровне становится неинтересно просто потому, что "чистая ОС Android" при работе как будто не существует. Во-вторых, придётся повториться, об этом я уже писал, когда появилась версия Lollipop. Система развивается без страшных «революций», в ней «пролечиваются» отдельные подсистемы, оттачивается до цельности пользовательский уровень, всё, что можно, выносится из системного уровня на уровень приложений и распространяется механизмами Play. И каждый новый результат этого эволюционного процесса мне лично нравится.

Откланиваюсь.

5 октября 2015 г., 17:58

Можно было бы название завершить фривольным смайликом, настолько всё в действительности непонятно. С одной стороны, оценки дальних прогнозов одновременно «отдаляются и увеличиваются» (и результирующая цифра будущей ёмкости рынка «умных домов» как будто ни от чего не зависит – ни от масштабов компании-прогнозиста, ни даже от специфики локальных рынков), с другой стороны – поставщики ключевых компонентов рапортуют об отгрузке 100-миллионой микросхемы контроллера ZigBee (одного из основных беспроводных стандартов в мире smart home в его текущем состоянии), с третьей стороны какие-то подававшие надежды компании разоряются и объявляют о банкротстве, с четвёртой стороны есть оценки текущего состояния рынка, и они выглядят подозрительно, и, наконец, с пятой стороны пока ничего «взрывного» и достойных масштабов не получается и у грандов индустрии.

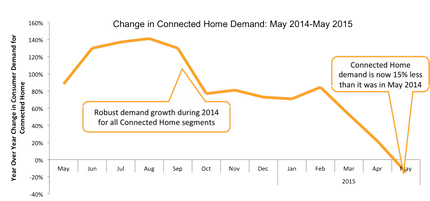

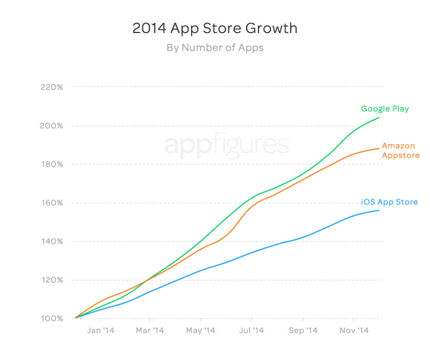

Давайте посмотрим на факты, избегая прогнозов. Мониторингом рынка IoT и сегмента Smart Home занимается, например, компания Argus Insights (не вижу каких-то поводов, почему её результаты не заслуживают доверия). В июне этого года Argus Insights опубликовала отчёт о динамике спроса на рынке Smart Home США за период с мая 2014 года по май 2015 года. Картина получилась весьма интересная, с характерным «подскоком» до пика в августе 2014, и последующим фактически постоянным спадом скорости роста, что в итоге привело к 15% сокращению спроса:

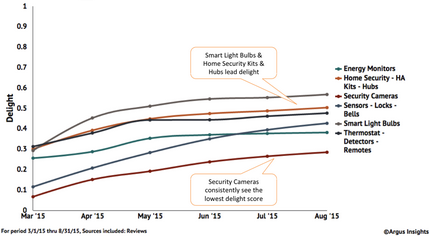

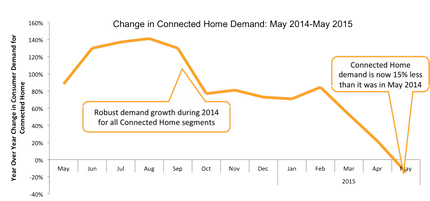

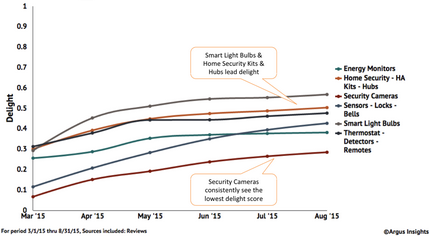

Сентябрьская аналитика от Argus Insights бодрости картине не добавила, хотя она уже отражает изменение не чисто рыночного показателя. Графики показывают, как изменялась «удовлетворённость» пользователей систем Smart Home, причём иллюстрируют это для разных подсистем (мониторов потребления энергии, грубо говоря охранных сигнализаций, камер наблюдения, сенсоров-дверных звонков и замков, «умных» ламп, термостатов). Предельное значение по оси ординат, «1», означает «полное удовлетворение».

К сожалению, картина показывает не только, что и «половинного удовлетворения» многие подсистемы пользователям не доставляют, но и характерное «успокоение» - роста удовлетворённости не наблюдается, и начинавшиеся подъёмом кривые буквально за три месяца эксплуатации реальных систем превращаются в прямые:

Что произошло с разработчиком интеграционной платформы для Smart Home, за шесть лет сформировавшим полуторамиллионное сообщество, Quirky, понятно по первой странице сайта. Quirky – банкрот, Smart Home бизнес компании, подразделение Wink, продаётся за $15 млн. (суммарные объёмы инвестиций оцениваются на порядок больше, около $185 млн).

Идея Quirky была смелой и на первый взгляд разумной – привлечь сообщество потенциальных и реальных пользователей Smart Home для генерации идей, и овеществлять эти идеи уже силами своих разработчиков. При этом максимально использовать готовые решения разных поставщиков, концентрируясь на реализации интеграционной составляющей.

Правда, в самой основе всего этого было нечто потешное, «всего лишь» чехлы для iPod (настолько потешное, что злые инвесторы Кремниевой Долины назвали это «IPod condoms»), но они позволили совсем юному основателю Quirky заработать более чем приличные деньги для дальнейшего роста начинания.

Как бы там ни было, начавшаяся со $185 тысяч Quirky доросла до $185 миллионов, затем «сдулась» до банкротства, несмотря на оригинальность идеи, популярность (полуторамиллионное сообщество – это в любом случае для инвесторов цифра, пусть даже в реальности она почти ничего не значит), работу в «hype-нише», неоднократные оптимизации бизнеса и изменения бизнес-модели.

У Quirky были симпатичные разработки «для людей», основанные на идеях сообщества и доведенные до продуктового уровня (например, «гибкий» блок розеток Pivot Power), серьёзные люди в управлении компанией, и всё равно «не сложилось». Не буду гадать о причинах, но перегретый hype сектор специализации Quirky безусловно сыграл свою роль.

Сугубо для контрастного душа – компания GreenPeak, очень хороший fabless-производитель компонентов, на всём этом фоне отмечает «отгрузку» 100-миллионого ZigBee-контроллера. Микросхемы этого назначения де-факто используются почти только в том, что называется Smart Home (есть незначительный процент, отнимаемый всякими системами «недомашней» автоматизации, но им можно пренебречь). К сожалению, GreenPeak не сообщают тонкой картины распределения их микросхем в готовых продуктах хотя бы по их назначению, но есть обоснованное подозрение, что львиную долю этой немаленькой цифры занимают всевозможные пульты дистанционного управления крупносерийной бытовой техники (то есть, не совсем, или даже совсем не то, что принято подразумевается под Smart Home).

Ну и, наконец, затянувшаяся история штурма Smart Home рынка Google начала обретать какие-то очертания. По крайней мере, купленная за $3,2 млрд ещё в феврале прошлого года Nest наконец объявила о будущей доступности своего протокола для соединения в целое разных устройств Smart Home.

Правда, пока что о протоколе известно название (назовём его с уточняющей частью, Nest Weave, потому что это не совсем то, чем должен быть другой протокол, тоже Weave, но уже с уточнение Brillo, именно его Google обещала на конференции I/O), примерное время его появления (2016 год), а также его основанность на Wi-Fi и принципиальная «локальность», это не сквозной протокол «от конечного устройства до клауд-сервиса». Такая принципиальная «неторопливость» в таком, казалось бы, «горячем» сегменте рынка, тоже о чём-то говорит.

Итак, что же происходит? Рыночные аналитики не утверждают, что потребители утратили интерес к Smart Home, но спрос всё-таки упал на 15% по сравнению с прошлым годом. Быстрый вход в «насыщение» показателей удовлетворённости пользователей и сравнительно невысокие для лояльной аудитории оценки оптимизма не добавляют. При этом доступность Smart Home систем и компонентов для них растёт с реактивной скоростью, и то, что ещё два года назад обходилось потребителю за трёхзначные суммы, теперь укладывается в скромные двузначные.

Я постарался посмотреть массу отзывов пользователей реальных систем, и отбросить «шелуху», связанную со всякими мелкими и не очень (в том числе и совершенно смешными) сугубо техническими проблемами. Это болезни «роста», они преодолеваются, например, выполнением инсталляционных работ квалифицированным и опытным персоналом. Меня интересовали более фундаментальные причины. Их отыскать сравнительно несложно. Подозрительно многие пользователи после многословного описания своих страданий и злоключений буквально одной-двумя фразами обрисовывают то, что принято называть «value of product» (ценность продукта, отражающая желание владельца приобрести или сохранить продукт). Например, «управлять яркостью света с помощью планшета было забавно первую неделю, теперь мы этим вообще не пользуемся». Таких «спокойных откровений» в достатке в тематических обсуждениях. Они доведены уже до специфической в аудитории фанатичных «бытовых технократов» шутки – «развернул умный дом, но оставил всё традиционное, чтобы если со мной что-то случится, жена смогла хотя бы включить свет».

Похоже, проблемы Smart Home начинаются с… самого термина. Дом – это не абстракция, и не набор предметов. Это место обитания пусть маленького, но социума. Home, sweet home, дом, родной дом. А в социуме «умность» имеет общепризнанный смысл, о котором лучше всего сказал знаменитый психолог Эдвард Ли Торндайк «способность понимать мужчину и женщину, мальчиков и девочек, и поступать мудро в человеческих отношениях».

В социальной среде эта самая умность, social intelligence, не имеет никакого отношения ни к бытовому удобству, ни, тем более, к технократическим неочевидным приёмам, основанным на принципе «потому что мы теперь так можем».

Так что в самом названии Smart Home скрыто обещает то, чего принципиально дать не может (или сможет когда-нибудь, после создания по-человечески мудрого искусственного интеллекта). Нет в этой, чаще всего примитивной, неочевидно необходимой и даже часто сомнительно удобной, бытовой автоматике, ничего «умного». Вообще ничего.

И умнее будет говорить не о Smart Home, а об Automated Home и о Connected Home.

К сожалению, в части Automated Home современная ситуация тоже далека от совершенства. Действительно хорошая бытовая автоматика должна работать на основе всей информации о её пользователях – кто конкретно сейчас где, как и когда перемещается, что делает с потенциально управляемыми автоматикой устройствами. Учиться навыкам конкретных пользователей. И на основании обучения помогать им. По-моему, это совершенно очевидное соображение. Требующее в том числе точной идентификации всех обитателей дома и точной системы indoor-позиционирования.

Ребёнок, подросток, зрелый и пожилой человек отличаются радикально в своих потребностях, навыках и привычках, и кто сказал, что все они не могут жить в одном доме? Дом ведь не обязательно лофт, в котором обитает одинокий техноманьяк-хипстер.

Очень часто то, от чего надо автоматически оберегать ребёнка, должно быть автоматически облегчено пожилому человеку (например, эту задачу частично решают производители лекарств хитрыми крышками с фиксаторами, но для людей, страдающих болезнью Паркинсона эти же крышки могут стать дьявольским наказанием).

Ничего этого, в первую очередь, механизмов позиционирования и обучения на основе собранной информации о действиях обитателей дома, в сегодняшней Home Automation нет.

Обучение системы как бы есть, это всякие «сценарии», задаваемые, или, ещё хуже, программируемые, пользователем или инсталлятором системы (то есть, вообще сторонним по отношению именно к этому дому человеком или людьми).

Это очень далеко от реального удобства именно «невидимой домашней автоматики».

Connected Home – совсем другая история. Раз Automated Home является частью интимного пространства людей, необходимо самое тщательное и строгое отношение к их приватности. Слишком малы «сладости» автоматизации того, что отточено веками, чтобы платить за них деинтимизацией (хоть бы и потенциальной) своего пространства. Найдутся желающие и на такое, но их будет мало, а по мере развития технологий – ещё меньше.

А вот Connected Home есть что предложить обитателям в обмен на какую-то долю приватности. Причём не столько конкретным обитателям, сколько их сообществам. Добровольное участие в программе оптимизации энергопотребления, например, с вытекающими специальными тарифами. Коммерческое участие в smart grid. И т.д.

В общем, если картина со Smart Home не изменится, то, скорее всего, высказанные соображения более чем имеют право на жизнь. Пока же они мне кажутся более разумными, чем просто маркетинговое и неопределённое Smart Home, в котором ничего «умного» нет и быть не может.

Откланиваюсь.

25 сентября 2015 г., 18:45

Обойдёмся без преамбул. Весной 2014 г. академическая исследовательская группа в составе двух профессоров и двух студентов Университета Западной Вирджинии исследовала поведение разных европейских дизельных автомобилей на дорогах США.

Исследование проводилось вполне традиционно – созданием достаточной экспериментальной базы данных (простыми словами – продолжительными заездами, 2000 и более миль, сбором в реальном времени и накоплением всей доступной информации об автомобиле), построением моделей, анализом.

Простая «разведка» по именам участников этого исследования показывает, что, вероятнее всего, целью исследования было в том числе и изучение поведения машин для получения данных о реальном «выхлопе» двигателей (полное название исследовательского подразделения – Центр Альтернативных Топлив, Двигателей и Оценки загрязнения окружающей среды).

Выбор моделей определялся по простому критерию – в академической среде реальных экспериментальных данных о них не было. Дизельные двигатели в легковых автомобилях в США – явление нечастое, потому отобранные машины и были европейскими.

Ну и, что логично, для оценки результатов «в большом», выбирались самые популярные авто – VW Jetta и Passat и BMW X5.

Результаты ожидались предсказуемыми – из трёх машин самым «чистым» должен был быть VW Passat, оборудованный самой современной системой селективной каталитической очистки выхлопных газов.

Давайте сразу присмотримся к этой детали, к «современности», она позволяет оценить реальное положение дел в классических индустриях – патент на селективную каталитическую нейтрализацию оксидов азота (NOx) оформлен в 1957 г., в 2015 г. это всё ещё современная технология. Почему именно об оксидах азота идёт речь? Потому что они действительно очень вредны как для планеты (разрушают озоновый слой), так и для отдельных людей.

Итак, невинные сугубо академические исследовательские испытания были весной 2014 г. И показали неожиданное. Если с дорогой и относящейся в США к классу Lux SUV BMW X5 всё оказалось именно так, как заявлено производителем, и в пределах, установленных требованиями Управления охраны окружающей среды США, то вот дешёвые и массовые машины, «для народа», показали превышение загрязнения выхлопа в 10-40 раз выше нормы.

Напоминаю, это был 2014 г., примерно лето. Прошло более года работы разных исследователей до момента полной определённости и Очень Большого Скандала.

Так что всё случилось не «буквально вчера», это совершенно не истерика, а вполне рациональная реакция.

- Во-первых, речь идёт именно о массовых «народных» моделях в доступном ценовом диапазоне.

- Во-вторых, американские регуляторы весь год работали с VW Group и пытались найти объяснение феномену, и корпорация предлагала версии «загрязнение выхлопа может быть связано с разными техническими причинами и особенностями режима эксплуатации» (эту незначительную деталь обходят стороной, но она есть в официальном письме Управления охраны окружающей среды США).

- В добавок к этой детали есть и в-третьих, которое выходит далеко за рамки технических и даже экономических вопросов и многое объясняет.

Управление охраны окружающей среды США (Environmental Protection Agency, EPA) – либеральная (до какого-то предела) организация, полностью доверяющая Сертификатам Соответствия (Certificate Of Conformity, COC), предоставляемым производителями автомобилей.

Логика совместной работы примерно такая – производитель проводит тесты в соответствии с требованиями законов и стандартов США, предоставляет EPA всю требуемую законами детальную информацию о результатах тестов и об автомобиле, и всё это необходимо для того, чтобы автомобиль смог стать товаром на территории США. Никакой крамолы в этом нет, всё очень либерально. Но есть важные нюансы.

Во-первых, в большом пакете законов и стандартов чётко определено (в кавычках привожу дословные переводы) – Сертификат Соответствия должен содержать полную информацию о всех узлах автомобиля, косвенно ответственных как за соблюдение норм загрязнённости выхлопа, так и «любые элементы конструкции, измеряющие температурные режимы, скорость автомобиля, обороты двигателя, режимы работы коробки передач, режимы давлений в вакуумных подсистемах, а также всё, что может активировать, управлять работой или деактивировать любую подсистему или часть системы контроля загрязнённости выхлопа».

Кроме того, Сертификат Соответствия должен чётко указывать «все настройки системы управления чистотой выхлопа, все параметры этой системы и их смыслы, назначения и влияния на работу системы, перечень всех режимов работы системы, включающий детальное описание режимов, снижающих её эффективность и рационально объясняющих их техническую необходимость, что позволяет отличить их от “умышленно нарушающего требуемые показатели устройства” [defeat device]”».

Сложно переводимое понятие “defeat device” также чётко пояснено – это нечто «что сокращает эффективность системы управления чистотой выхлопа в режимах, которые считаются нормальными при эксплуатации машины, за исключением (1) если это сокращение определено требованиями законов и стандартов, (2) необходимо системам безопасности для защиты машины в случаях аварий, (3) действует только в момент запуска двигателя…».

С 1978 г. все электронные системы автомобиля, включая управляющую логику (т.е. алгоритмы) и программное обеспечение попадают под действие перечисленного, наравне с аппаратными средствами.

И, наконец, всему, что не соответствует этим требованиям, с 1979 г. законами вынесен чёткий вердикт – оно не может быть сертифицировано, стало быть, не может быть товаром на территории США.

То есть, система допуска моделей автомобилей на американский рынок строилась на взаимовыгодных доверительных отношениях регулятора и производителей. За счёт неё производитель получал сокращёние затрат времени и средств при выведении автомобиля на рынок, регулятор также сокращал свои затраты (потому что тесты – занятие серьёзное, затратное и неспешное).

Эта система отношений была выстроена за десятилетия «войн за ёмкий американский рынок» и хорошо работала (и работает, что показали результаты проверки той же BMW X5).

Но в случае с двухлитровыми дизелями VW произошло то, чего произойти вообще не должно было и что полностью нарушило идиллию этой либеральной кооперации.

В итоге, после всех исследований и объяснений, и при возникшей прямой угрозе лишения VW в 2016 г. «допуска к рынку США» до выяснения причин, в VW признали наличие и встраивание умышленного режима «для тестов» в управляющую логику и embedded программы всех двухлитровых дизельных двигателей с 2009 по 2015 гг. включительно.

То есть, речь идёт о том самом defeated device, судя по доступным описаниям – весьма хитром. Не удивлюсь, если в итоге окажется, что это специальный программный модуль, основанный на нечёткой (fuzzy) логике, потому что низкоуровневая система управления двигателем выявляет из условий работы всего автомобиля в целом то, что похоже на проведение теста (речь идёт о сочетании неизменности положения руля, диапазоне оборотов etc, включая данные от барометрического датчика, которые косвенно говорят о высоте автомобиля над уровнем моря, так что, без сомнения, этот хитрый алгоритм в какой-то мере учитывает и географическое положение машины). И включает «соответствующий требованиям чистый режим». Во всех прочих случаях – выключает.

Это всё, что пока известно. Как и факты признания наличия defeated device корпорацией Volkswagen и добровольного увольнения её CEO.

Для рядовых владельцев автомобилей Volkswagen в США это всё на практике означает примерно ничто – уже купленные автомобили можно эксплуатировать. Для Volkswagen это означает большие сложности со сбытом в США подозрительных новых моделей (всё, что с 2.0 дизелем, включая и Audi) и большие затраты на устранение грязного выхлопа в огромном количестве уже проданных машин (без сомнения, реакция США будет не единичной, да и вообще не совсем понятно, возможно ли это принципиально, не исключено, что весь этот фокус связан с невозможностью «выдавить» именно из этого двигателя нужные владельцу авто и самой машине характеристики при соблюдении строгих норм на чистоту выхлопа). Для системы допуска автомобилей на рынок США это может означать серьёзную встряску и (пока вроде об этом речь не идёт) ужесточение требований к процедурам.

Но это всё интересно постольку, поскольку (тем более там, где после перегазовки экологически чистой маршрутки становится не столько даже трудно дышать, сколько темно). Но есть и косвенная польза в этой истории.

Во-первых, несмотря на огромную разрешительную базу США и ЕС, её надо изучать и знать. В самых давних и глубоких деталях (определению программного и даже алгоритмического defeated device, например, 37 лет). Это нужно просто для того, чтобы при попытках вывода продукции на рынок не оказаться в нехорошем положении. И, во-вторых. Независимый альтернативный анализ поведения сложной системы (в случае с автомобилями VW сами исследователи Университета Западной Вирджинии назвали этот процесс due diligence), проведенный за свой счёт, всегда лучше, чем внезапный сторонний, даже если не было никакого умысла в действиях.

Откланиваюсь.

23 сентября 2015 г., 20:35

В не слишком обширном списке «радиоканалов» (буду употреблять это умышленно сленговое название не только для того, чтобы сократить текст, но пока достаточно пояснения – под ним понимается весь технологический стек, от физического уровня до самого верха модели OSI) для IoT с большим радиусом действия DASH7 достойно занимает не последнее место, при этом технология почти никому не известна. А жаль. Очень интересная, даже уникальная разработка, и куда более доступная, чем, например, LoRa (сейчас представленная фактически одним производителем системообразующего компонента – микросхемы трансивера). Попробую восполнить пробел.

Для начала – пара слов о собственно прикладной области. «Дальнобойные радиоканалы» IoT предназначены для очевидного – в общем случае двухсторонней (но не исключена и только односторонняя) связи огромного числа оконечных устройств с чем-то промежуточным, что, уже имеющее «доступ в Internet», в сочетании со всей высокоуровневой архитектурой, формирует тот самый Internet of Things.

На первом, «мечтательном» этапе развития идеи IoT, преобладала мысль, что все цепочки такой сверхсистемы должны быть единым «пространством» стандартных интернет-протоколов. Эта мысль стала идеологической основой адаптации IPv6 для беспроводных сетей с ограниченным размером пакета данных, 6LoWPAN, и разных реализаций микро-TCP/IP стеков. В этом технологическом нюансе многие видели «суть IoT». Но были и другие мысли. Их носители вполне справедливо задавались вопросом – а что на практике даёт «сквозное протягивание» одних и тех протоколов через все уровни будущих систем, особенно если учесть, что адаптации этих протоколов или не соответствуют реальным возможностям, или настолько радикальны, что всё равно требуют чего-то промежуточного (шлюзов)? Кроме того, есть непростой вопрос с управлением адресным пространством, которое становится астрономическим. DASH7 как раз является представителем разработок, основанных на непринципиальности соблюдения правила «TCP/IP протокол – везде». Но при этом его разработчики всё равно позаимствовали некоторые очень удачные идеи из «до-IoT мира». Вот с этой заимствованной идеи и начнём, она – чуть ли не главное в DASH7.

В своё время была (и до сих пор живёт где-то в недрах Google) операционная система, доводившая одну ключевую идею Unix до совершенства минимализма. ОС Plan 9 освобождала программиста (и пользователя) сразу от груды лишних абстракций, представляя все нюансы, детали и устройства компьютерной сети единой файловой системой. То же самое в мире IoT делает DASH7. Пакеты, полезные нагрузки, адреса – всё это упрятано за абстракцией распределённой файловой системы с традиционными конструкциями «файл, доступный для чтения», «файл, доступный для записи», «исполняемый файл», и, наконец, «запрашиваемые файлы» (ужасный перевод термина queryable). Любой самый низкоуровневый узел DASH7-сети, тот самый встраиваемый во что угодно (в любую «вещь», thing) невидимый человеку вычислитель, является набором таких файлов. При этом DASH7 обеспечивает, условно говоря, «позиционную независимость» – файловой системе совершенно безразлично где в данный момент находится «вещь» (и спрятанный в неё вычислитель), что в терминах сети означает «к какому промежуточному пограничному устройству он подключен». Иными словами, файловая иерархия DASH7-сети не изменяется при перемещении «вещей» в реальном мире. В терминах DASH7 это дословно звучит так: «любые действия высокоуровневых приложений, все обмены данными отображены исключительно на манипуляции с файлами [Структурированными Элементами Данных, собственное название для «файлов» в DASH7] и их атрибутами [properties]»

Абстракция распределённой файловой системы DASH7 основана на чётко определённых критериях, которые в терминах системы принято называть аббревиатурой BLAST:

- B – это Burst, в контектсте – «порывистый», требование соответствия системы случайному прерывистому характеру инициируемых событиями материального мира обменов данными (так что всякое потоковое – это не для DASH7, как и для большинства IoT-систем);

- L – Light, «лёгковесность пакетов», которые не могут быть больше 256 байтов (включая полезную нагрузку, payload);

- А - Asynchronous, асинхронность, что означает – DASH7 фундаментально не требует механизмов периодической синхронизации;

- S – Stealth, весьма необычное свойство и критерий, подразумевающее полное отсутствие потребности в передаче традиционно необходимых периодических «пакетов для обнаружения» (discovery beacons), нет такого в DASH7, это «скрытная» система;

- T – Transitive, ориентированность на «непостоянство структуры», ещё один необычный для изучавших разные сети критерий, требующий максимального освобождения фиксированной в пространстве инфраструктуры сети от управления вычислителями и программами, встроенными в свободно перемещаемые «вещи», это поддерживается, в частности, за счёт «загрузочноориентированной» модели коммуникации (upload-centric или push communication model, об этом позже).

Даже из перечня критериев проектирования DASH7 становится понятно, что речь идёт о довольно нетривиальной разработке, очень непохожей на то, что стало совершенно нормальным и распространённым благодаря почти всему, надстроенному, например, над физическим и MAC уровнями 802.15.4 (ZigBee etc). Но есть одно приятное «но». В отличие от многих разработок всевозможных келейных альянсов, за DASH7 стоит реальный стандарт ISO (ISO/IEC 18000-7). Для многих разработчиков это не важно (например, работающих в потребительских секторах всевозможных smart home), но сбрасывать со счетов соответствие международным стандартам в промышленности (армии etc) не принято.

Из высокоуровневого осталось самое главное. Назначение и условия лицензирования. DASH7 создавался для сетей «активных дальнобойных» RFID, нужных в том числе и в большой логистике. Потому очень уважаем военными, например. Это нисколько не ограничивает область применения DASH7-устройств, но подчёркивает две важных особенности – DASH7, естественно, основан на фундаментальных для всех RFID требованиях минимального расхода энергии (и очень долгой работы от батареи) и очень низкой стоимости оконечных устройств (в RFID-терминах – тэгов). Более того. DASH7 изначально создавался для построения беспроводных сетей датчиков и актуаторов. Эта важная деталь, определяющая некоторую странность и необычность списка критериев, потому что чаще всего когда мы слышим аббревиатуру IoT, она подразумевает сугубо «сеть сенсоров» (т.е., такой интернет вещей, который способен в реальном мире только показывать весёлые картинки на мониторе, без воздействия на него).

Теперь можно перейти к конкретике.

Начнём с физического уровня. Он точно так же необычен.

Стремление добиться большой дальности действия на отрытой местности и в условиях помещений привело к стандартному, но необычно резкому для WSAN (беспроводные сети датчиков-актуаторов, Wireless Sensors Actuators Network) решению – выбору минимально доступной несущей частоты из небольшого перечня ISM-диапазонов. Разработчики DASH7 выбрали диапазон 433 MHz, в который до них всерьёз никто из создателей WSAN-сетей не заходил. Такое резкое понижение несущей частоты (в два с лишним раза по сравнению с самым традиционно низкочастотным, 868 MHz для Европы) имеет свои преимущества и недостатки. Начну с последних, благо, их очень немного, и главный из них – габариты антенны. Для 433 MHz классическая четвертьволновая антенна имеет длину 17 с лишним сантиметров. Если говорить об «интернете вещей» вообще, то далеко не в каждый «предмет» (thing) физического мира можно незаметно и красиво (предметы же не существуют сами по себе, они для людей) встроить такую немаленькую антенну. Кроме того, есть ещё государственные регуляторы, не оставляющие без внимания любой ISM-диапазон. Для излучающей в диапазоне 433 MHz есть специфические ограничения как Евросоюза, так и США. Европейцы ограничивают сочетание мощности и периода пребывания «в эфире», американцы – напряжённость электрического поля (измеряемую в вольтах на метр). Это тонкие нюансы, конечно, но об их существовании надо не забывать. Стандарт, лежащий в основе DASH7, разрешает реализацию физического уровня стека на втором субгигагерц ISM-диапазоне (868 MHz для Европы, 928 MHz для США).

Итак, физический уровень DASH7 – это 433 MHz приёмопередатчик (или просто передатчик), использующий несложную гауссовскую или просто FSK модуляцию (частотную манипуляцию, означающую разные частоты для передачи единичного и нулевого битов, «гауссовская» означает такую предварительную обработку передаваемого цифрового потока, при которой с минимальными затратами на радиочастотные цепи достигается минимальный уровень, грубо говоря, паразитных излучений), разделяющий весь допустимый диапазон (433.060 – 434.785 MHz) на каналы с шагом 25 или 200 KHz. Есть ещё много деталей (да и эта информация в целом приведена с «большим запасом»), главное же – реализующих всё это микросхем-приёмопередатчиков и никак не связанных с DASH7 производителей более чем достаточно, причём все они были до DASH7, существует независимо от DASH7, доступны и дёшевы (не производители, конечно, а только микросхемы). Это очень важный нюанс, радикально отличающий DASH7 от, например, LoRa (безусловно замечательной разработки, но «намертво» привязанной к единственному производителю микросхемы радиотракта, ещё и защищённого патентами).

Такой выбор на практике означает почти ничем не заполненный диапазон (в нём очень мало излучающих устройств), приличную дальность связи (до нескольких километров на открытой местности и с соответствующими стандарту допустимыми мощностями передатчиков), хорошую «проникающую способность» сигналов через типовые препятствия (бетон, кирпич etc), пониженную чувствительность к перемещающимся объектам (например, просто к бродящим по торговому залу людям) etc.

Буквально завтра продолжу этот экскурс, а затем восстановлю временно отложенную цепочку о MQTT, потому что две эти технологии по моему скромному мнению (и в моих скромных попытках реализации) идеально соответствуют требованиям и логике больших, фактически свободных от middleware (от всего лишнего рационально избавляться), IoT сетей.

Откланиваюсь

15 сентября 2015 г., 18:05

Без всякой помпы IBM вчера (14.09.2015) анонсировала создание двух новых подразделений, объединяющих достижения корпорации в Big Data, когнитивном компьютинге и аналитике, в том самом IoT и, наконец, в образовании.

Очень интересна и показательна персона и нового генерального менеджера этих подразделений – Харриет Грин пришла в IBM c багажом CEO туристической Tomas Cook Group (с годовым оборотом как будто из большой промышленности, почти $10 млрд) и исполнительного директора крупнейшего европейского дистрибьютора электронных компонентов Premier Farnell (и даже награждена Королевой Орденом Британской Империи за работу на благо общества и Короны в электронной индустрии). Удивительное сочетание, но, похоже, как раз подходящее для специфики IoT-направления в понимании IBM.

Масштабы подразделений и объёмы финансирования известны – более 2 тысяч консультантов, исследователей и разработчиков, $3 млрд на ближайшие 4 года. Известны и целевые рынки – от погодных сервисов до «умных городов», промышленного производства электроники и, обязательно, автомобилестроения. Важно не забыть эту мелкую деталь – IBM «заглядывает» в автомобильную промышленность уже не как поставщик сугубо программных систем «общего назначения».

Сегодня же SIGFOX (можно сказать первопроходцы в масштабных IoT системах) объявила о взаимодействии с французским оператором спутниковой связи Eutelsat Communications и о стратегическом использовании технологии Smart LNB при построении своих будущих систем. За этим коротким заголовком в новостях скрывался целый пласт для меня совершенно нового. Оказалось, что Smart LNB – это действительно очень интересно, даже странно, что вокруг неё так мало «шума».

Smart LNB – по сути, IoT «добавка» к системам спутникового телевидения (DTH), причём с двусторонней низкоскоростной связью (160 KBps). Приём данных осуществляется на тех же частотах спутникового телевещания из Ku-диапазона, передача возможна в Ka-, С- и Ku-диапазонах (частоты не привожу, всё есть в википедии). Похоже, в своё время крупные операторы спутниковой связи начинали такие проекты для построения систем интерактивного TV, но сейчас открылись настолько интересные и совершенно новые возможности такой технологии, обещающей быть дешёвой (стоимость комплекта Smart LNB со спутниковой «тарелкой» заявлена на уровне $40), что в Eutelsat ведут интенсивную разработку одночиповой реализации Smart LNB ресивера, и она ожидается на рынке уже в следующем году.

Для крупных IoT-систем появление такого канала приёма-передачи данных (160 KBps – далеко не так медленно, как кажется) означает возможность построения масштабных локальных инсталляций (основанных на какой-то малопотребляющей и дешёвой радиосети из всего доступного спектра), совершенно не зависящей от наличия затратных каналов связи «с внешним миром» (проводных, GSM или 3-4-NG, все они всё равно требуют развёртывания наземной инфраструктуры).

Само собой, Smart LNB интересна и в связке с классическим спутниковым телевидением (Eutelsat планирует их полностью «скрестить» и все новые тюнеры и «тарелки» будут обеспечивать функциональность Smart LNB). Это позволяет создавать совсем новые масштабные системы connected homes и вообще является самостоятельной очень аппетитной областью, потому и первопроходцы спешат «застолбить» здесь своё место.

В общем, hype безусловно есть, но где-то за маркетинговым шумом IoT тихо-тихо уже становится массовой системой планетарного масштаба. Впечатляет.

Теперь немного об электромобилях. Список производителей пополняет Porsche (что косвенно показывает – всё ещё идёт «обкатка» технологий на элитах, потому что ценовой диапазон у Porsche, как и Tesla, далеко не «народный»). Машина будет красивой (и было бы странно, если бы иначе), но в ней интересны вовсе не экстерьер-интерьер-параметры.

Porsche первыми в автоиндустрии увеличили напряжение силовой бортсети (и аккумуляторных батарей, соответственно) до 800 вольт. Увеличение рабочего напряжения силовой батареи и основных двигателей электромобиля – не прихоть, а спасение от очень высоких токов (и при таком рабочем напряжении всё равно речь идёт о сотне с лишним ампер) и ускорение зарядки.

Естественно, за это приходится расплачиваться очень высокими требованиями к силовой электронике. И тут интересно заметить одну деталь. Сравнительно высокие (сотни вольт) напряжения – не такое частое явление в массовой продукции. И, между тем, множество производителей направляют серьёзные усилия на разработку и доведение до серийного производства, например, сверхскоростных высоковольтных мощных нитрид-галлиевых (GaN) транзисторов с субнаносекундным временем переключения. Это массовое явление, не единичные уникальные разработки. Похоже, аналитики производителей компонентов видят в полноценных электрокарах скорое будущее и рыночную нишу, которую уже надо заполнять.

Точно так же интересно оценить развитие рынка микросхем, управляющих зарядом больших батарей, это очень непростая задача (в первых Tesla, например, рабочая батарея набиралась из 6831 цилиндрических литий-ионных аккумуляторов, и все они должны в процессе зарядки быть очень хорошо сбалансированы, неравномерная зарядка разных элементов в такой батарее резко сокращает её срок службы, а чтобы проиллюстрировать насколько это важно и сложно – маленький факт: более 60% патентов Tesla непосредственно относятся именно к рабочей батарее и процессу её заряда, рекомендую этот очень интересный обзор патентной активности в электромобилях).

Ну и немного косвенного, что вообще почти никому не заметно. Как ни странно, но всё взаимосвязано. Все уже почти забыли аббревиатуру Li-Fi (помните, технология высокоскоростной оптической передачи данных?), а она никуда не делась. Основной разработчик её, Институт микросистем фотоники (Общество Фраунгофер, Германия), объявил фактически пригодное к промышленному производству очень интересное и неожиданное воплощение этой идеи – микросхемы бесконтактного межплатного изолирующего соединения со скоростью передачи до 12,5 гигабит в секунду. Промышленные потребители и, опять же, автопроизводители, явно эту разработку оценят. Потому что где сотни вольт и сотни ампер – там необходима очень хорошая электрическая изоляция, в том числе и высокоскоростных подсистем, например, управляющих двигателями.

Откланиваюсь.

8 сентября 2015 г., 17:05

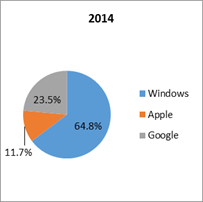

Спад спроса на планшеты, вызванный, в том числе, и быстрым насыщением рынка, и согласием массы пользователей с габаритами фаблетов (phablets, 5.6+ дюймов диагональ экрана), вызывает и ответные действия у производителей. Они весьма интересны, так как косвенно приоткрывают фрагменты очень разных стратегий, обычно тщательно скрываемых.

Начнём с Apple. iPad Pro. Полностью подчинённый лозунгу «больше и дороже». Радикальной новизны в этой конструкции искать не стоит. Экран с диагональю 12,9 дюймов плюс ценовой диапазон фактически младших моделей MacBook (в районе $1000).

Из реально забавного – оснащение немаленького (и потому очевидно специфического в использовании) устройства LTE-интерфейсом и режим «разделённого экрана», позволяющий отображать сразу два полноразмерных окна приложений. Первое забавно потому, что при таких габаритах «мобильность» этого устройства кажется загадочной (но «на ходу» его точно никто не сможет использовать, кроме вовсе отъявленных эпплофилов), второе потому, что реальная мультиоконность – решение, не ограничивающееся только отображением нескольких окон, а требующее массы специфических общесистемных механизмов, поддержанных на уровне ОС (например, drag’n’drop, мультибуферов копирования, удобного переключения контектста etc, для «пальцеориентированных» интерфейсов это вообще не очень хорошо изученная область).

Как бы ни было, в Apple явно уверены, что iPad Pro найдёт своего покупателя.

Если внимательно наблюдать за Google, то в действиях «империи добра» можно рассмотреть нечто и схожее, и противоположное. Как и Apple, пытающаяся создать «планшетную мультиоконность» (но «привязанную» к физическим характеристикам планшета), Google вводит в ОС механизмы, делающие многооконные приложения законными «обитателями» мира Android, но при этом заранее старается упорядочить использование мультиоконности.

Будущая версия ОС, Android M (Marshmallow), скрывает в себе одновременно и фактическое признание мультиоконных (в том числе и «плавающих») приложений, и явно сформированную опытом поддержки колоссального количества инсталляций ОС защиту пользователя от возможных злоупотреблений мультиоконностью. Начиная с 23й версии API ОС Android M, приложения, пытающиеся «рисовать» поверх других окон (так называемые «плавающие»), не смогут этого делать без подтверждения пользователем этого права. Естественно, запрос о подтверждении пользователем формируется для одного приложения всего один раз.

Кроме «плавающих» приложений появляется и поддержка пока ещё двухоконного «тайлинга» (открытия двух окон с выбранными пользователем и зависящими от ориентации экрана предустановленными вариантами расположения и размеров).

По моему скромному мнению, и на основе опыта интенсивной эксплуатации разных Andorid-устройств, «плавающая» мультиоконность лучше соответствует возможностям и специфике «пальцеориентированного» интерфейса. Но в реальном мире она же очевидно открывает возможности для злонамеренных разработчиков (например, даёт возможность фальсифицировать ввод пароля, «зарисовав» область ввода своим окном поверх реального приложения). Явное требование подтверждения допустимости «плавающих» окон пользователем – очень важный и логичный шаг в расширении возможностей ПО в первую очередь планшетов (из-за достаточной площади экрана).

Производители конечной продукции из Android мира тоже ищут пути выхода из «планшетного кризиса», причём иногда делают это весьма интересно. Если предпринимаемые Apple и Google попытки очевидно направлены на расширение области применения планшетов и даже на прямую конкуренцию с ноутбуками малых диагоналей экранов (мультиоконность тому свидетельство), то в Acer, наоборот, решились на сужение «устройства потребления контента» до «игрового планшета».

Predator 8 имеет характерные для игровых консолей приметы – тактильную обратную связь с игроком (haptic feedback), объёмный звук (4 бросающихся в глаза излучателя в торцах), наконец, подчёркнутый дизайн.

Казалось бы, планшетный мир на границах, очерченных Apple и Google, заканчивается. Тем более, в период охлаждения интереса. Но это не так. Как ни странно, но финская Jolla довела свои разработки до коммерческой готовности, и новый планшет под управлением Sailfish OS 2.0 можно уже заказывать за вполне пристойную для его характеристик цену (порядка $300).

Интересная, но и одновременно курьёзная история – и с Sailfish OS, и с Jolla. Курьёзная потому, что саму ОС очевидно спасает возможность запуска Android-приложений, ведь у скромной Jolla нет ни сервисной инфраструктуры, ни финансов, позволяющих превратить эту ОС в «мейнстрим», привлекающий косяки разработчиков. Но факт остаётся фактом – любители хорошо сделанных и одновременно эпатажно не от мира сего конструкций, имеют и такой забавный выбор.

О планшетном осталась одна маленькая деталь. Похоже, рынок расставил всё на свои места, и верхняя ценовая планка современного планшета определена – будь то игровая модель от мощного производителя, будь то вовсе экзотичный аппарат под управлением редкой нишевой ОС от маленькой компании, за границу $300 для востребованной 8-дюймовой диагонали экрана никто даже не пытается заглядывать. Даже играющая по своим правилам Apple решилась на всего «$100 наценку» для базовой 16-гигабайтной модели iPad Mini 3.

А теперь посмотрим на «не только планшеты». А именно, на десктопы. «Рабочие лошадки» давно не в фаворе, и новости о них также давно ограничены разве что компонентно-узловым уровнем (процессоры, видеокарты etc). Потому тихая и малозаметная новость (опять от Acer) привлекла моё внимание.

Блочный десктоп, Revo Build, это, по крайней мере, мило и забавно. Идея та же, что и в проекте Google Ara – поднять уровень внутренних скрытых узлов до завершённых элементов конструкции.

Базовый блок, параллелепипед с габаритами 12,5 × 12,5 × 5,5 см, содержит «базовую машину» на основе малопотребляющих Pentium или Celeron с 8 GB ОЗУ (для расширения оперативной памяти достаточно снять декоративную крышку на одном винте, и это, судя по всему, единственная операция, требующая доступа внутрь конструктива). Всё остальное, включая, например, расширенную подсистему графики и даже проектор – собирающиеся в стойку модули такого же формата, отличающиеся только высотой.

Пока известная только ориентировочная стоимость базового блока (199 евро), всё остальное будет анонсировано где-то в октябре, когда начнутся продажи Revo Build.

Внешне милая конструкция, интересная попыткой совместить приятный дизайн с одновременным полным вовлечением пользователя в мир одного производителя, но без ограничений в жёстко навязанных конфигурациях. В любом случае, нетривиальный и технически интересный ход (например, межблочный разъём и интерфейс Revo Build допускает горячую замену и добавление модулей).

И, наконец, последнее, на совсем мелком компонентном уровне. Но многих это явно порадует. Потому что USB-C, освобождающий от асимметричного разъёма, ждут многие. Но есть одно маленькое «но», незаметное конечному потребителю – для широкого распространения новый разъём и кабели требуют аппаратной поддержки. Всё-таки нужны микросхемы контроллеров. И они наконец начали появляться. Причём бюджетные и дополняющие существующие USB 3 и 3.1 микросхемы. Раз компонентные производители USB-С признали, значит, этому разъёму всё-таки быть полноценным в бытовых устройствах. Заодно мы можем оценить «время реакции» индустрии, пусть всего лишь на появление спецификаций разъёмов и кабелей, цифра будет всё равно значимой – в августе 2014 года USB Implementers Forum анонсировал готовность спецификаций разъёма и кабелей Type-C, осенью 2015 года начинают появляться первые «расширяющие контроллеры», позволяющие «малой кровью» реализовать потенциал Type-C (а он куда больше освобождения пользователя от асимметричности разъёма, особенно в части управления питанием).

18 августа 2015 г., 14:26

Тихое – не значит неважное. Скорее, наоборот. Просто для коммерциализации его ещё рано, потому и механизмы распространения информации с таким «сырьём» работают тоже тихо. Но не замечать «тихого» – упустить зарождающуюся «волну».

Многие помнят об одном из многих приобретений Google – Boston Dynamics. В основном, из-за ярких конструкций этой даже не компании, а исследовательской лаборатории. Но, как о всём нетоварном, о Boston Dynamics пошумели недолго, да и забыли. Чем там занимаются – почти полная тайна. Правда, иногда завесу немного приоткрывают, и из доступного минимума информации можно «откопать» неожиданно много интересного.

Итак, в Boston Dynamics явно удовлетворены своими разработками алгоритмов управления шагающими машинами, потому что в списке новых ключевых направлений появился пункт, исключительно важный для всей большой идеи IoT – актуаторы (исполнительные механизмы).

Здесь надо сделать маленькое, но необходимое, отступление. Идея «взаимодействующих без участия человека предметов, дополненных встроенной интеллектуальностью» (лучше определить IoT у меня не получается) предусматривает обязательность неких механизмов, трансформирующих информацию в изменения физических величин. Иначе нет смысла городить сложные защищённые радиоканалы, большие сервисы и масштабные сети – получится не «интернет вещей», а система встроенных вычислителей, без особого смысла усложняющая жизнь (хороший пример – «шагомеры 2.0», ничего принципиально нового не делающие по сравнению с механическими предшественниками, но вводящие море бессмысленных сущностей, вроде никому не нужных карт маршрутов, как будто городские фанатики джоггинга каждый день бегают новыми, полными феерических неожиданностей, маршрутами). Это может быть забавно, на этом можно построить какую-то временную социализацию (что спасает и даже доставляет удовольствие), но не более того. Фундаментальных изменений мира к лучшему, которые ожидаются от IoT, с такими системами не добиться (разве что явные проблемы с приватностью могут породить какие-то новые полезные способы их решения). Для бизнеса и стартапов в частности, эти банальности означают одно – пока «ранний IoT» является зоной повышенных рисков (просто потому, что очень большие игроки всё ещё ведут войну за «простое и традиционное», в первую очередь, за стандарты на всех уровнях реализации).

И пока Google в необычном для компании режиме «очень ограниченного доступа с максимальным затягиванием конкретных анонсов» продвигает платформу Brillo, в Boston Dynamics заняты в том числе «умными актуаторами» (smart actuators). Например, такими:

Это гидравлический исполнительный механизм, очевидно преобразующий информацию (команды) в положение штока (он виден слева). Раз гидравлика, значит очень немаленькие усилия (никто не будет делать гидропривод для усилий, где достаточно моторчика с редуктором) и, при высоком качестве исполнения, – высокая надёжность. Особо присматриваться к фотографии не требуется, чтобы понять – этот актуатор (или технологическая оснастка, извините за сленг из некомпьютерной области, для его производства) изготавливался методом «прямого» (аддитивного) производства, в простонародье – 3D-принтингом (иначе такую сложную геометрию цельной конструкции не получить). То есть, медленно, тихо, но уверенно, где-то внутри Google формируется собственная подсистема проектирования и даже производства актуаторов (кто создал одно работающее устройство – сможет создать и семейство, опыт уже есть). Кто-то там вовсю отрабатывает взаимодействие с серийными производителями прецизионного литья (иными способами сделать такое невероятно дорого), кто-то – высокоуровневым моделированием актуаторов (без него не добиться результирующей точности работы, повторяемости, не построить алгоритмику встроенных вычислителей, потому что те же калмановские фильтры требуют наличия модели).

В общем, тихо-тихо, как и с Brillo, в Google работают и над самым главным в IoT. Актуаторы «обкатываются» на удивительных роботах Boston Dynamics, а что будет дальше с этим вполне самостоятельным сегментом – посмотрим. Может так сложиться, что в итоге именно актуаторы «выстрелят» куда раньше завершённой продукции на основе разработок Boston Dynamics. Просто потому, что они в IoT нужны везде, всегда и принципиально, без них никакого IoT нет.

Теперь посмотрим, что происходит в другом ключевом для IoT секторе – в беспроводных сетях. Здесь тоже тихо сформировалось нечто очень серьёзное. Рабочая группа IEEE 802.11 (занимающаяся разработкой стандартов всего того, что мы называем Wi-Fi) объявила о работе над новыми спецификациями 802.11ah. Финальная версия стандарта 802.11ah ожидается в следующем году, а это означает, что и примерно тогда же появятся и первые коммерчески доступные микросхемы контроллеров.

Можно было бы этого вообще не заметить, если бы не одно «но» - с 802.11ah Wi-Fi становится серьёзным конкурентом всевозможным «IoT-ориентированным» разработкам. Потому что это «очень другой Wi-Fi».