|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

26 августа 2024 г., 20:58

Програми генеративного штучного інтелекту, такі як ChatGPT і Gemini, вже тут і вже впливають на наше життя і бізнес. І хоча вони значно спрощують життя користувачів, вони також значно ускладнюють життя вашої організації.

Хоча деякі організації повністю заборонили додатки GenAI, згідно з дослідженням Check Point і=та Vason Bourne, 92% компаній дозволяють своїм співробітникам використовувати інструменти GenAI, але при цьому стурбовані питаннями безпеки і витоком даних. За однією з оцінок, зараз 55% витоків даних є прямим наслідком використання GenAI.

Оскільки такі завдання, як налагодження коду та уточнення тексту, тепер можна виконати за лічені хвилини, без правильних інструментів ці самі завдання можуть поставити під загрозу ваші бізнес-дані та дотримання нормативних вимог.

Традиційні інструменти не справляються з ризиками GenAI

Традиційні рішення для захисту даних не призначені для виявлення та запобігання витоку даних у додатках генеративного АІ, оскільки вони покладаються на статичні заздалегідь визначені ключові слова та шаблони. Вони не здатні зрозуміти контекст неструктурованих даних, характерних для підказок GenAI, які за своєю суттю є розмовними.

Насправді, щоб усунути ризики GenAI, потрібні рішення на основі GenAI. І такі системи вже розроблені.

Наприклад, в арсеналі Check Point зʼявилося таке рішення, яке вже доступне в рамках програми попереднього використання. Воно встановлюється за лічені хвилини, щоб виявити служби GenAI, які використовуються у вашій організації, оцінити їх ризики та застосувати революційний захист даних на основі АІ, щоб ви могли впровадити новітні служби без додаткових ризиків.

Це рішення використовує трансформаційний аналіз даних на основі штучного інтелекту Check Point для точної класифікації розмовних даних і намірів у підказках. Технологія класифікації розуміє контекст даних, щоб забезпечити точну видимість і контроль, уникаючи необхідності визначати громіздкі типи даних.

Наприклад, використовуючи DLP на основі GenAI, рішення може розрізняти особистий контент з низьким рівнем ризику і бізнес-контент з високим рівнем ризику.

Завдяки АІ та автоматизації, нові можливості безпеки GenAI від Check Point дозволяють підприємствам безпечно впроваджувати інструменти генеративного АІ. Виявляючи при цьому, як використовуються додатки GenAI, аналізуючи дані, що передаються, застосовуючи політику безпеки, яка запобігає втраті даних в режимі реального часу, а також забезпечуючи прозорість і звітність для відповідності вимогам.

Ці нові можливості приносять негайну користь, розширюючи можливості організацій:

#1 Виявлення та оцінка використання GenAI на підприємстві

Рішення дозволяє виявляти як санкціоновані, так і тіньові додатки GenAI, а також забезпечує видимість на основі штучного інтелекту в основних випадках використання GenAI, таких як кодування і маркетинг, щоб ви могли приймати обґрунтовані рішення щодо управління GenAI. Воно також виявляє джерела даних, скопійованих/вставлених у підказки, і надає оцінку ризиків, щоб визначити пріоритети для їх усунення.

#2 Запобігайте втраті даних у режимі реального часу та вирішуйте проблеми конфіденційності

Рішення дозволяє застосовувати політики, що налаштовуються, для запобігання витоку даних. Воно навіть дозволяє застосовувати обмеження на копіювання/вставку для запобігання витоку даних у сховищах вихідного коду, інструментах CRM, корпоративній електронній пошті та інших конфіденційних додатках.

#3 Відповідайте нормативним вимогам за допомогою візуалізації корпоративного рівня

Нове рішення безпеки GenAI від Check Point забезпечує детальний моніторинг і наочність для полегшення дотримання нормативних вимог. Воно забезпечує видимість ризикованих користувацьких підказок і високоризикованих програм штучного інтелекту (на основі даних про загрози для конкретних додатків) і навіть вказує, чому підказка була позначена як небезпечна, з детальним описом.

5 августа 2024 г., 20:36

Усе почалося близько 12 років тому, коли з'явилася можливість запускати набагато потужніші алгоритми. Ми нарешті змогли збирати й аналізувати дані у великому обсязі, власне, так це і назвали: великі дані, big data. Але нам також потрібен був спосіб зберігати ці дані з мінімальними витратами, і так з'явилися віртуальні мережі.

Водночас коли мобільні застосунки поширилися по всьому світу, даним раптом знадобилося переміщатися, бути скрізь. Так ми отримали хмарних провайдерів. Проблеми хмарних обчислень розв'язували за допомогою масштабованого коду, розбитого на сервіси, що працюють на віртуальних машинах, які стають активними за викликом.

До цього часу з'явилося машинне навчання для оптимізації даних і отримання глибоких висновків. З'явилася система Kubernetes, що забезпечує додаткову гранулярність кодування і запуску сервісів.

Криптовалюти призвели до зростання обчислень на GPU, а генеративний AI став реальністю. І нарешті, саме пандемія ковіду дала хмарам найбільший поштовх.

Віддалені кінцеві точки, дані, що доступні звідусіль, і швидкість розвитку технологій - все це вимагає хмарних сервісів. Сьогодні компанії від малого до великого або вже працюють у хмарі, або збираються це зробити.

Хмара стала невіддільною частиною нашого повсякденного життя і досягла такого рівня розвитку, що її присутність стала повсюдною. Хмара надала нам безліч переваг і можливостей, які раніше неможливо було навіть уявити. Зрозуміло, не обійшлося і без проблем. Однак нам необхідно зрозуміти, що хмара - це не проблема, а її рішення. Використовуючи переваги хмари, ми зможемо поліпшити заходи безпеки найближчими роками та вивести нашу роботу на новий рівень.

Додатки засновані на двох основних каналах обміну даними: вхід до хмари, де користувачі надсилають запити на різні послуги з хмарного додатка через публічний інтернет, мобільні мережі та VPN. Потім є службовий вхід - з нього постійно надходять код і дані для підтримки роботи застосунку. Отже, по суті, ми захищаємо “дроти” комунікації. Ми намагаємося зрозуміти кожен зроблений запит, і у нас є набір інструментів, щоб підтвердити, що обмін безпечний.

Але така велика кількість обміну даними по різних каналах і в гібридних хмарах також може призвести до неприємностей. Якщо подивитися на цю спрощену схему ланцюжка постачання, то одразу побачимо безліч компонентів, які обмінюються даними та потенційно можуть слугувати чорним ходом для проникнення хакерів у ваше середовище.

Щоразу, коли дані обмінюються між компонентами, існує ризик, що вони будуть порушені або піддані маніпуляціям. Додайте до цього той факт, що ви покладаєтеся на безліч сторонніх каналів і служб, що обмінюються даними, які також можуть мати свій власний набір вразливостей.

Щоб захистити бізнес, ми використовуємо різні заходи безпеки, як-от WAF для вхідних даних, CSPM і захист робочих навантажень для хмарного вмісту, а також застосовуємо сканування коду та мережеву безпеку для кінцевих точок. Завдяки цим заходам ми впевнені, що зможемо впоратися з будь-якими відомими ризиками. Однак ми не можемо виключати те, що є можливість виникнення невідомих ризиків, тому необхідно зберігати пильність і адаптованість у підході до безпеки.

Спробуймо зрозуміти, від чого іде захист, почавши з базових визначень. Відомі вразливості означають і те, що ми робимо самі, наприклад:

- неправильна конфігурація або приховані облікові дані,

- відомі вразливості, які можуть дозволити шкідливу активність доти, доки не будуть виправлені та...

- динамічні індикатори ризику, засновані на широкій базі даних індикаторів атак, таких як підозрілі моделі поведінки, шкідливі IP-адреси, шаблони атак і т.д.

Постійний пошук цих проблем та індикаторів дозволяє нам забезпечувати безпеку, захист та нетерпимість у мережі додатків.

Але можуть бути й невідомі вразливості, наприклад:

- невиявлені вразливості програмного забезпечення, які можуть призвести до того, що програмний компонент відхилиться від свого початкового призначення та дозволить отримати доступ або маніпулювати ним;

- вразливі «чорні ходи», деякі з яких створені спеціально (наприклад, функція "забув пароль"), та ненавмисні «чорні ходи», виявлені зловмисниками, або, нарешті, просто нові техніки та методи атак, які хакери постійно винаходять, а ми про них поки що не знаємо. Тому що ми не знаємо, як захиститися від цих невідомих ризиків - а вони, звісно ж, саме те, що шукають зловмисники, і тому експлойти нульового дня стали так поширені.

Основний спосіб, за допомогою якого йдуть повідомлення про невідомі уразливості, - це використання CVE або Common Vulnerability and exposure - це спосіб тримати команди безпеки в курсі останніх проблем, а найчастіше і їхніх рішень та виправлень.

Тільки у 2022 році користувачами Інтернету по всьому світу було виявлено понад 25000 нових CVE - це найвищий річний показник на сьогодні. Це означає, що в середньому спеціаліст з безпеки розпочне свій ранок з 68 CVE, третина з яких представлятиме високий чи критичний ризик. Це 68 нових CVE щодня на рік.

Але також цікаво відзначити, що дозвіл CVE займає в середньому 65 днів, тому доти, доки не вийде стабільна латка, що усуває основну проблему, єдина лінія захисту, яка у вас є, - це WAF, а ваш WAF сліпий до невідомих атак поки не буде випущена сигнатура.

У минулому штучний інтелект дозволяв нам робити великі речі - починаючи зі здатності оптимізувати роботу з великими обсягами даних чи покращувати процеси, а з розвитком CNAPP та консолідації даних ми тепер можемо розглядати дані про загрози як єдине ціле та отримувати висновки, які допомагають нам покращувати та масштабувати нашу безпеку.

Але що якщо використовувати той же AI, щоб дивитися не зовні, а всередину? Якщо ми отримаємо глибоке розуміння нормальної поведінки програми, ми зможемо виявити все, що виходить за межі цієї норми, і просто заблокувати це.

Наприклад Check Point CloudGuard WAF використовує запатентований механізм машинного навчання для безперервного аналізу вебзапитів та API-запитів користувачів за протоколом HTTP. AI-движок WAF вивчає, як користувачі зазвичай взаємодіють з вебдодатком, і автоматично виявляє запити, що виходять за межі звичайних операцій. Ці запити далі аналізуються, щоб вирішити, чи є запит шкідливим, чи ні. Така точність забезпечує практично повну відсутність помилкових спрацьовувань і дозволяє блокувати проблеми, не покладаючись на сигнатури чи правила.

CloudGuard WAF – це нове покоління брандмауерів вебдодатків. Він поширюється у вигляді нано-агентів у хмарному середовищі, ефективно перехоплюючи всі HTTP-взаємодії та аналізуючи їх у режимі реального часу. Це рішення не покладається на сигнатури або правила для блокування атак, а використовує два етапи для забезпечення захисту від відомих та невідомих ризиків.

На першому етапі механізм впровадження, що базується на машинному навчанні, шукає індикатори атак у HTTP-запиті. Оцінка заснована на моделі, яка ідентифікує індикатори та пов'язує їх з певною статистичною ймовірністю або "балом" того, що вони є частиною атаки.

Бали надаються кожному індикатору окремо і парам індикаторів. З іншого боку, індикатори асоціюються з певними сімействами атак, у яких зазвичай зустрічаються. Процес підрахунку балів дозволяє CloudGuard прийняти точне початкове рішення про можливість атаки на HTTP-запит.

На цьому традиційні WAF закінчуються. А ось у другій частині відбувається найцікавіше. Підозрювані запити аналізуються за допомогою механізму оцінки контекстного машинного навчання, щоб отримати додаткову впевненість у тому, що будь-який HTTP-запит, визнаний потенційно шкідливим, дійсно є атакою. Зіставляються додаткові параметри, такі як: структура програми, поведінка користувача/групи, контент користувача та транзакції, а також багато іншого. Це дозволяє досягти надзвичайно точного виявлення, ефективно виявляючи будь-який нерегулярний або шкідливий запит і блокуючи його.

Слід зазначити, що CloudGuard WAF успішно блокував ВСІ великі атаки нульового дня за останні роки, включаючи Log4Shell, Spring4Shell та MOVEit. Наші клієнти були захищені з першого дня, їм навіть не потрібно було запускати оновлення.

Сьогодні для захисту хмарного середовища необхідні рішення, засновані на запобіганні загрозам, які боронять бізнес від відомих та невідомих ризиків, незалежно від їхнього походження.

28 июня 2024 г., 18:28

Хмара - це дійсно фантастичний спосіб надання безлічі послуг, але не менш важливо розуміти, коли суто хмарний підхід може бути неоптимальним.

Наприклад підхід Check Point щодо безпечного доступу до Інтернету полягається на захист на пристрої, водночас надаючи функціональність у хмарі для тих, хто цього хоче.

Результатом є рішення для інтернет-безпеки, яке захищає співробітників компанії від онлайн-загроз і підтримує швидкість з'єднання без негативного впливу на продуктивність пристрою.

Фундаментальним компонентом безпечного доступу до Інтернету є захищений веб-шлюз (Secure Web Gateway, SWG).

SWG може бути вбудований у локальний шлюз, але частіше він є частиною хмарного шлюзу.

Хмарний підхід означає, що вам не потрібно турбуватися про так званий ефект тромбона, коли трафік йде від віддаленого користувача до дата-центру компанії на іншому кінці світу, а потім на веб-сайт. Замість цього ви просто звертаєтеся до найближчого хмарного провайдера для перевірки безпеки, перш ніж потрапити в мережу.

Це набагато кращий підхід, але він все одно має певну вбудовану затримку, якої неможливо уникнути, що сповільнює продуктивність з'єднання. За допомогою Harmony SASE вдається скоротити крок до хмари і обробляти потреби у веб-безпеці безпосередньо на пристрої, включаючи веб-фільтрацію та захист від шкідливого програмного забезпечення.

Результати можуть бути дійсно приголомшливими: вдвічі вища продуктивність порівняно з традиційним хмарним підходом. Ось у чому різниця, коли ви обираєте найкоротший шлях до веб-ресурсів, не жертвуючи безпекою.

Але гібридний підхід має набагато більше переваг, ніж просто підвищення швидкості обміну даними, наприклад, серед них - безпека та конфіденційність. Більшість безпечних інтернет-рішень здійснюють перевірку SSL у хмарі на наявність потенційних загроз. Це означає, що трафік вашої компанії розшифровується в неконтрольованому місці.

У повсякденному житті це може бути нормально, але що станеться, коли ваш хмарний провайдер зазнає збою через помилку в конфігурації, нульовий день у базових технологіях або будь-яку іншу потенційну загрозу?

Раптом цей захищений хмарний сервіс виявиться скарбницею даних, яка просто дозріла для хакерів, щоб завдати ще більшої шкоди.

За допомогою Harmony SASE виконується перевірка SSL на пристрої кінцевого користувача. Це означає, що кожна перевірка SSL локалізована в середовищі під контролем вашої організації. Крім того, якщо у вас є специфічні для регіону вимоги до перевірки SSL, вони автоматично враховуються, оскільки функція працює локально за замовчуванням.

Гібридне SASE також означає, що ви не спотворюєте вбудовану геолокацію вашого браузера, що корисно не тільки для замовлення обіду.

Уявіть, наприклад, що вам потрібно отримати доступ до державної служби в рамках вашої повсякденної роботи. Послуга, про яку йде мова, вимагає IP-адресу з вашої країни, але найближчий до вас шлюз доступу до інтернету не є таким. Тепер вам доводиться відключатися від служби безпеки, щоб отримати доступ до сайту - не найкращий варіант, враховуючи чутливість даних, до яких ви збираєтеся отримати доступ.

Краща геолокація також допомагає оптимізувати роботу, пропонуючи вам додатки правильною мовою або замовляючи канцелярське приладдя з правильного місця.

Це може здатися дрібницею, але додайте до цього кількість щоденних запитів на локалізацію, які потрібно вносити вручну, і ви зрозумієте, що це суттєво впливає на продуктивність.

Коли справа доходить до доступу до Інтернету, ви не хочете жертвувати продуктивністю.

10 июня 2024 г., 17:26

Великі мовні моделі (LLM) революціонізують способи взаємодії з технологіями. У результаті постачальники SaaS борються за конкурентну перевагу, інтегруючи функції AI та пропонуючи підприємствам такі інструменти, як аналітика продажів на основі AI або кодинг-пілоти.

Традиційно моделі безпеки з нульовим рівнем довіри ґрунтувалися на чіткому розмежуванні користувачів і додатків. Однак застосунки, інтегровані з LLM, порушують це розмежування, функціонуючи одночасно як ті й інші. Така реальність створює новий набір вразливостей у системі безпеки, таких як витік даних, впровадження підказок, ризикований доступ до онлайн-ресурсів і навіть доступ до корпоративних ресурсів від імені співробітників. Для розв'язання цих проблем під час розгортання LLM необхідний унікальний набір заходів щодо забезпечення нульової довіри. Саме їх сформулював Томер Бехор (Tomer Behor), який займається напрямком GenAI Security & DLP у Check Point Software Technologies.

Розглянемо приклади того, що може піти не так при впровадженні сервісів GenAI та чому організаціям слід почати розглядати підхід із нульовою довірою до доступу до AI (ZTAI, Zero Trust AI).

Ризик GenAI № 1 - Проста ін'єкція - коли ви наймаєте Гаррі Поттера

Зловмисники зловживають можливостями LLM, створюючи ввідні дані для прямого або непрямого маніпулювання поведінкою LLM з метою спонукати його до шкідливої або неетичної поведінки. Підказки можуть вводитися як безпосередньо зловмисником, так і побічно мимовільним користувачем, який використовує додаток на базі LLM відповідно до його призначення. Існує чотири типи ін'єкцій підказок:

- Пряма ін'єкція підказок (Direct Prompt Injection), під час якої зловмисники вводять певні підказки, щоб змінити поведінку або виведення LLM шкідливим чином. Зловмисник може безпосередньо попросити LLM виступити в ролі неетичної моделі, злити конфіденційну інформацію або змусити модель виконати шкідливий код.

- Непряма ін'єкція підказок більш тонка, вона пов'язана з маніпуляцією джерелами даних, які використовує LLM, що робить її набагато небезпечнішою і складнішою для виявлення в організаційному середовищі.

- Мультимодальні ін'єкції Prompt Injections дають змогу LLM отримувати на вхід такі формати, як зображення, відео та звуки, з прихованими інструкціями, що вбудовуються в медіавхід і змінюють поведінку бота застосунку, змушуючи його спілкуватися, як Гаррі Поттер.

- Атаки типу «відмова в обслуговуванні» (DoS) також можуть бути здійснені за допомогою ін'єкцій, що призводить до перевантаження ресурсів LLM, погіршення якості обслуговування і високих витрат.

Ризик GenAI №2 - витік конфіденційних даних - чи може ваш AI зберігати секрети?

Моделі можуть бути точно налаштовані або доповнені за допомогою доступу до даних для досягнення найкращих результатів у конкретній галузі. Наприклад, для бота служби підтримки було б чудово налаштувати модель за допомогою минулих звернень. Але чи може ваш AI зберігати секрети?

В одному з досліджень вчені використовували механізм тонкого налаштування ChatGPT для вилучення імен та адрес електронної пошти більш ніж 30 співробітників New York Times. Цей приклад показує, як конфіденційні дані, використовувані для попереднього навчання або тонкого налаштування AI, можуть бути викрадені, що створює регуляторні ризики. Як наслідок, моделям LLM не можна довіряти в плані захисту конфіденційних даних від витоку.

Ризик GenAI № 3 - вразливий студент - ризики, пов'язані з навчанням

Моделі генеративного AI проходять тривале навчання на різних наборах даних, які часто включають більшу частину інтернет-контенту. Процес навчання охоплює попередню підготовку на великих наборах даних для широкого розуміння мови і світу, а потім тонке налаштування для конкретних цілей з використанням спеціальних наборів даних.

У разі отруєння даних зловмисники можуть порушити безпеку цих моделей, маніпулюючи невеликою часткою (всього 0,01%) навчальних даних. Оскільки моделям і користувачам не можна довіряти наосліп, цілісність і безпеку навчальних даних також не можна вважати надійною.

Ризик GenAI № 4 - контроль доступу - ласкаво просимо на Дикий Дикий Захід

Дедалі більше організацій інтегрують LLM у багатокомпонентні додатки, або «агенти». Ці інтеграції розширюють можливості LLM, як-от доступ до Інтернету, пошук корпоративних ресурсів і виконання різних дій з ними. Примітно, що недавній запуск магазину плагінів OpenAI сприяє широкому доступу до доповнень для LLM.

Отримання даних з інтернету в режимі реального часу може бути дуже цінним для користувачів. Такі доповнення дозволяють LLM давати точніші відповіді на запити користувачів, ґрунтуючись на актуальній інформації. Однак розширення доступу LLM до інтернету є серйозною проблемою, особливо в контексті впровадження шкідливих програм. У недавніх прикладах вставка шкідливих інструкцій в URL-адресу змусила чат Bing переконати користувачів відвідати шкідливий сайт або розкрити конфіденційну інформацію, яка була відправлена на зовнішній сервер.

LLM-інтегровані додатки можуть бути розроблені для взаємодії з корпоративними ресурсами, такими як бази даних або додатки. Однак такий тип доступу являє собою ризик навіть для не зловмисних користувачів, оскільки вони можуть випадково отримати доступ до конфіденційних даних і ресурсів, взаємодіючи з LLM-інтегрованим додатком.

У системі доступу з нульовою довірою до AI поведінка інтегрованого в LLM застосунку не викликає довіри, як і прийняття ним рішень, пов'язаних із доступом до корпоративних ресурсів, включно з тим, до яких ресурсів і коли здійснюється доступ, які дані експортуються тому чи іншому користувачеві і які операції виконуються в цих ресурсах.

З експоненціальною продуктивністю приходить експоненціальний ризик. Щоб ефективно захистити LLM, їх не слід розглядати виключно як користувачів або додатки, а скоріше як те й інше.

Підхід Zero Trust AI access (ZTAI) пропонує розглядати інтегровані в LLM додатки як сутності, які потребують суворого контролю доступу, захисту даних і політики запобігання загрозам - створення більш жорсткої лінії оборони, ніж та, що потрібна для захисту звичайного співробітника.

12 марта 2024 г., 17:42

З розвитком цифрового ландшафту прогресує і сфера кібербезпеки, яка зараз стоїть на порозі трансформаційної ери, що ґрунтується на генеративному АІ.

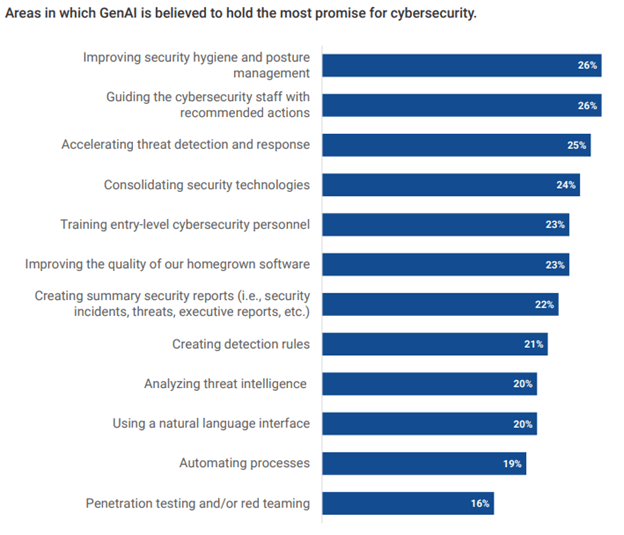

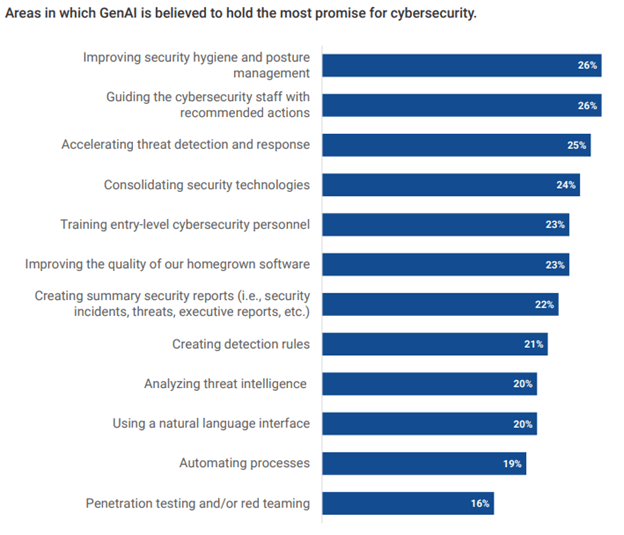

Дослідження, що було нещодавно проведено TechTarget Enterprise Strategy Group за підтримки Check Point, надало переконливі дані, які підкреслюють вирішальну роль генеративного АІ у формуванні майбутнього кібербезпеки.

Майже 92% респондентів проведеного опитування погоджуються, що машинне навчання підвищило ефективність та результативність технологій кібербезпеки. Але слід зазначити деякі деталі в отриманих оцінках.

Парадокс впровадження. Хоча 87% фахівців з безпеки визнають потенціал генеративного АІ для посилення захисту кібербезпеки, існує відчутне почуття обережності. Це пов'язано з розумінням того, що ті ж самі технології можуть бути використані супротивником для організації більш складних кібератак.

Стратегічне управління і розробка політики. Вражаючий показник - 75% організацій не просто пасивно спостерігають, а активно розробляють політику управління для використання генеративного АІ в кібербезпеці. Такий проактивний підхід свідчить про значний зсув у бік інтеграції АІ в систему кібербезпеки, забезпечуючи його ефективне та відповідальне застосування.

Інвестиції та вплив. Дослідження прогнозує ключову тенденцію: до кінця 2024 року генеративний АІ впливатиме на рішення про закупівлю систем кібербезпеки для більш ніж 60% організацій. Ця статистика свідчить про зростаючу впевненість у здатності АІ революціонізувати операції з безпеки - від виявлення загроз до реагування на інциденти.

Операційна ефективність і реагування на загрози. Одне з найбільш важливих спостережень дослідження - 80% опитаних команд безпеки очікують, що генеративний АІ значно підвищить операційну ефективність. Більше того, 65% очікують, що він збільшить час реагування на загрози, що підкреслює потенціал технології не просто покращити, але й активно прискорити робочі процеси у сфері безпеки.

Виклики та занепокоєння. Попри оптимізм, дослідження також проливає світло на основні проблеми. Приблизно 70% респондентів підкреслили проблему інтеграції генеративного АІ в існуючі інфраструктури безпеки, тоді як 60% вказали на ризики, пов'язані з потенційною упередженістю та етичними міркуваннями.

Слід зазначити, що звичайно, кіберзловмисники також мають доступ до відкритих додатків GenAI та технічні можливості для розробки власних LLM. Наприклад WormGPT та FraudGPT є ранніми прикладами, призначених для використання кіберзлочинцями та хакерами цих технологій.

Чи будуть кіберзлочинці використовувати та отримувати вигоду від LLMs? Понад три чверті респондентів опитування (76%) не лише вважають, що це станеться, але й впевнені, що зловмисники будуть намагатися отримати перевагу (над кіберзахисниками) від інновацій у сфері генеративного АІ. Респонденти також вважають, що генеративний AI може призвести до збільшення обсягу загроз, оскільки полегшує некваліфікованим кіберзловмисникам розробку більш складних атак. Фахівці з безпеки та ІТ також занепокоєні глибокими підробками та автоматизованими атаками.

Дослідження TechTarget ESG висвітлює складний, але багатообіцяючий горизонт генеративного АІ в кібербезпеці. Воно являє собою аналіз ситуації з обережним оптимізмом, де потенціал для інновацій збалансований з гострим усвідомленням майбутніх викликів. Для організацій, які долають цей новий рубіж, ідеї, викладені в цьому дослідженні, можуть бути своєрідним маяком. Маяком, що спрямовує розробку стратегій, які є не лише технологічно передовими, але й етично обґрунтованими і стратегічно правильними.

По суті, майбутнє кібербезпеки, як показано в дослідженні TechTarget, полягає не лише у впровадженні генеративного АІ, але й у поміркованому, відповідальному і, зрештою, трансформаційному підході до нього.

15 февраля 2024 г., 18:46

У той час як багато галузей тільки починають вивчати можливості GenAI та ChatGPT, кіберзлочинці вже активно використовують потужний потенціал АІ у масштабуванні векторів атак.

На початку 2023 року команда Check Point виявила перші натяки на зацікавленість кіберзлочинців у використанні ChatGPT для створення шкідливого програмного забезпечення, інструментів шифрування та інших векторів атак. Крім того, кібершахраї одразу ж почали вивчати, як обійти будь-які обмеження, щоб почати використовувати GenAI у незаконних діях.

Через рік після запуску ChatGPT можна спостерігати, що використання генеративного АІ стало новою нормою для багатьох кіберзлочинних сервісів, особливо у сфері паролювання та соціальної інженерії. Деякі з них усвідомили потенціал GenAI як диференціатора для підвищення ефективності своїх сервісів і навіть хваляться цим.

Фейкові акаунти у соціальних мережах становлять значну загрозу кібербезпеці через їхній потенціал для зловмисної діяльності, імітації брендів, поширення дезінформації та багато іншого.

Наприклад, у грудні 2023 року досвідчений зловмисник на «авторитетному» російському підпільному форумі запропонував на продаж готову платформу, яка використовує АІ як основний модуль генерації контенту для соціальних мереж. Запропонований інструмент може бути використано для майже повної автоматизації ведення фейкових акаунтів у соцмережах.

На форумі зловмисник пояснив, що усвідомив, наскільки потужними є ці інструменти, лише під час роботи над своєю платформою, і зараз він пропонує дві бізнес-моделі.

Одна з них - управління фейковими акаунтами в соціальних мережах як послуга - зловмисник і його команда створюють усі необхідні акаунти в Instagram, Facebook, Telegram і Twitter. Потім вони автоматично генерують контент і просувають акаунти, щоб надати їм видимість і відчуття автентичності. Платформа може одночасно створювати контент для більш ніж 200 акаунтів і генерувати щоденні пости, ролики тощо. Акаунти, керовані штучним інтелектом, приваблюють підписників, а трафік з усіх акаунтів може бути використаний у будь-яких зловмисних цілях.

Другий варіант, що пропонує зловмисник, це автономна платформа - інструмент продається «як є», і покупець самостійно керує всіма акаунтами, керованими штучним інтелектом. Однією з ключових особливостей володіння платформою є можливість завантажувати контент і збагачувати його за допомогою АІ. Вартість цієї пропозиції - 5000 дол.

Напередодні Нового року, на одному з найбільших російських підпільних форумів було представлено ще один сервіс для видавання себе за іншу особу.

Використання сервісів, описаних у прикладах вище, окремо або в комбінації, можуть бути використанні у завданнях соціальної інженерії.

Ще один напрямок використання GenAI - спам.

Шкідливий спам - одна з найстаріших незаконних послуг, яку можна знайти на підпільних форумах кіберзлочинців. Спам є найпоширенішим початковим вектором для різних сценаріїв атак, таких як фішинг і збір облікових даних, розповсюдження шкідливого програмного забезпечення, шахрайство тощо.

Використання ChatGPT допомагає рандомізувати текст спаму і підвищити ймовірність того, що листи потраплять до поштової скриньки жертви. При цьому автоматично створюється унікальний текст для кожної спам-розсилки, що допомагає їй легко обходити антиспам-фільтри.

За словами одного з клієнтів нового спам-сервісу з використанням, послуга на основі штучного інтелекту допомогла йому обійти антиспам і антифішинг у популярних поштових сервісах і досягти 70% успішної доставки на цільову адресу електронної пошти.

Інше поле застосування GenAI у кіберзлочинах - KYC.

Процедури «Знай свого клієнта» (Know Your Customer, KYC) стали стандартною практикою для компаній, що надають фінансові послуги, через необхідність посилення безпеки, зниження ризиків і дотримання нормативних вимог.

KYC також відіграє вирішальну роль у відновленні доступу до облікового запису у випадку, якщо законний власник не може скористатися традиційними методами, такими як зміна пароля. Зазвичай компанія вимагає від клієнтів пройти процедуру KYC, щоб підтвердити їхню особу та переконатися, що вони є законними власниками облікових записів. Зазвичай це передбачає надання дійсних ідентифікаційних документів, таких як видане державою посвідчення особи, паспорт або водійське посвідчення, а також додаткові кроки перевірки, наприклад, фотографування з документом.

Існує цілий підпільний ринок тіньових послуг у напрямку KYC, таких як створення зображень фальшивих документів для перевірки. Раніше таку роботу кіберзлочинці виконували здебільшого вручну, маніпулюючи відповідними зображеннями.

Однак зараз у Darkweb вже є постачальники KYC-послуг, які починають інтегрувати АІ, щоб значно прискорити процес створення фальшивих верифікаційних документів «високої» якості.

Стрімкий розвиток технологій штучного інтелекту створює нові можливості та виклики у сфері кібербезпеки. Хоча АІ уможливлює такі корисні застосування, як виявлення шкідливого програмного забезпечення та захист систем, він також дозволяє кіберзлочинцям значно масштабувати свої операції.

Тепер кіберзлочинці можуть використовувати можливості штучного інтелекту для створення більш складних схем соціальної інженерії, швидше знаходити вразливі місця в мережі, створювати синтетичні медіа для залякування або крадіжки персональних даних, а також автоматизувати спроби фішингу та розробку шкідливого програмного забезпечення.

13 ноября 2023 г., 17:41

Генеративний AI, безумовно, це сьогодні трансформаційна сила, яка змінює парадигму кібербезпеки. На відміну від традиційних систем, заснованих на правилах, GenAI навчається та адаптується, залишаючись на крок попереду кіберзагроз. Цей революційний підхід виявився корисним у виявленні та зменшенні вразливостей, які раніше важко було розпізнати.

GenAI використовує величезні масиви даних, щоб зрозуміти закономірності, аномалії та потенційні ризики. Постійно навчаючись і розвиваючись, технологія покращує свою здатність виявляти та запобігати кіберзагрозам у режимі реального часу.

Наприклад ThreatCloud AI від Check Point має більш ніж 40 функцій на основі штучного інтелекту для захисту від найсучасніших кіберзагроз.

Ось деякі з ключових механізмів штучного інтелекту в арсеналі компанії для запобігання загрозам.

Так озброєний механізмами глибокого навчання, Zero-Phishing blade захищає в режимі реального часу від фішингових атак "нульового дня". Він перевершує традиційні антифішингові рішення, виявляючи в чотири рази більше фішингових сторінок "нульового дня", і перевершує постачальників рішень для захисту на основі штучного інтелекту на помітні 40% у виявленні.

DeepPDF - найсучасніше доповнення до лінійки продуктів компанії зі штучним інтелектом, призначене для виявлення та запобігання масштабним фішинговим кампаніям, які розгортають шкідливі PDF-файли. Ретельно аналізуючи структуру PDF-файлів, вбудовані зображення, URL-адреси та необроблений вміст, DeepPDF чудово розпізнає фішингові макети, успішно нейтралізуючи широкий спектр кампаній.

Захищаючи від локальних і глобальних атак з підробкою брендів, механізм Brand Spoofing Prevention Engine перевіряє нові домени одразу після реєстрації. Завдяки превентивному запобіганню, потенційні спроби підробки брендів припиняються до того, як вони можуть бути використані для атаки.

Використовуючи технологію машинного навчання, LinkGuard виявляє шкідливі LNK-файли. Заглиблюючись у хитросплетіння LNK-файлів, він препарує їх до самого ядра, виявляючи виконання шкідливого коду та аналізуючи аргументи командного рядка.

MemDive, що стоїть на сторожі від шкідливих програм, які намагаються обійти заходи безпеки, довів свою ефективність у запобіганні різноманітним спробам пакувальників на основі командного коду. Серед нещодавніх успіхів - запобігання спробам запуску програми-вимагача STOP і RedLine Stealer.

Використовуючи можливості штучної нейронної мережі, DeepDNS відстежує та блокує кампанії, які зловживають DNS. Захист від тунелювання DNS ThreatCloud AI використовує передовий механізм глибокого навчання на основі даних для аналізу DNS-запитів, ефективно розуміючи та запобігаючи спробам тунелювання.

Ці потужні механізми вже доступні для наших клієнтів і вони забезпечують надійний захист від постійно мінливого ландшафту загроз. І що важливо, мова йде не тільки про запобігання атакам, але й про їх випередження.

26 октября 2023 г., 17:16

Здавалося б, безпека хмарних мереж не дуже відрізняється від безпеки традиційних мереж, але це не так принаймні в деяких аспектах.

У хмарних мережах використовуються ті самі фундаментальні парадигми і протоколи, що і в локальних мережах, тому безпека і там і там певною мірою перетинається. На думку галузевих аналітиків, міжмережеві екрани в "хмарі" відіграють таку ж важливу роль, як і в локальних мережах. Наприклад, як зазначає Gartner, "мережеві брандмауери залишаються ключовими засобами контролю мережевої безпеки".

Але не варто думати, що традиційні рішення і процеси мережевої безпеки здатні захистити хмарні мережі. Попри деяку схожість між хмарними та локальними мережами, існують і суттєві їхні відмінності. Так, під час розгортання хмарних застосунків ви, найімовірніше, зіштовхнетеся зі складними внутрішніми мережами та додатковими компонентами управління мережею. Серед іншого це можуть бути сервісні мережі та контролери входу, яких не зустрінеш в більшості локальних середовищ.

Це означає, що звичайну стратегію мережевої безпеки не можна просто "взяти й перенести" для захисту хмарних мереж. Тому потрібні додаткові можливості, інструменти та стратегії, яких може не бути в разі традиційної локальної експлуатації робочих навантажень.

Щоб зрозуміти, що таке безпека хмарних мереж, необхідно спочатку розібратися з тим, що таке хмарна безпека загалом. Сьогодні популярною моделлю, що дає змогу осмислити значення хмарної безпеки, є розроблена компанією Gartner концепція платформи захисту нативних хмарних додатків (Cloud Native Application Protection Platform, або CNAPP). Платформи CNAPP призначені для захисту хмарних застосунків, тобто застосунків, що працюють у хмарних середовищах, і забезпечують захист усіх рівнів стека хостингу та всіх етапів життєвого циклу постачання програмного забезпечення.

Оскільки хмарні застосунки часто містять складні мережеві архітектури, CNAPP мають захищати безліч аспектів мережевої функціональності - від міжмережевих екранів нового покоління і балансувальників навантаження до вебдодатків та API. Крім того, вони повинні забезпечувати гранулярну сегментацію і захист трафіку. З огляду на те, що кожне хмарне розгортання під'єднується до мережі за межами хмари і використовує мережу для передавання даних між різними ресурсами всередині хмари, безпечна мережа є основою для решти частини стратегії безпеки хмари.

Це справедливо, до речі, незалежно від того, який тип хмарної архітектури ви використовуєте: чи йдеться про одну "хмару" або ви належите до 90% організацій, що застосовують мультіклауд. Можливе також використання гібридного хмарного середовища, що поєднує приватні хмари або локальні ресурси із загальнодоступними хмарними сервісами. Незалежно від архітектури хмари, всі типи хмарних середовищ - однохмарні, багатохмарні та гібридні - залежать від мережі, що зв'язує інфраструктуру і робочі навантаження. Тому всі вони під загрозою серйозних ризиків у разі порушення безпеки хмарних мереж. І дуже важливо впровадити відповідне рішення. Рішення для забезпечення мережевої безпеки, яке буде послідовно й ефективно підтримувати всі ресурси незалежно від типу хмари, де вони розміщені.

Слід також зазначити, що моделі поділу відповідальності не звільняють компанії від необхідності забезпечувати безпеку хмарних мереж. Нагадаю, моделі поділу відповідальності - це угоди, що укладаються провайдерами хмарних обчислень зі своїми клієнтами, відповідно до яких провайдер відповідає за захист одних компонентів хмарного середовища, а його клієнти - за інші.

З погляду мережевої безпеки моделі спільної відповідальності вимагають від хмарних провайдерів захисту фізичної мережевої інфраструктури, наприклад комутаторів і маршрутизаторів, що забезпечують під'єднання до їхніх хмарних інфраструктур. Однак завдання забезпечення безпеки віртуальних мереж, які конфігурують замовники, а також трафіку, що входить і виходить із хмарного середовища через ці віртуальні мережі, лягає на плечі замовників. Грубо кажучи, ваш хмарний провайдер не врятує вас, якщо ви випадково залишите вразливі віртуальні машини в хмарі без виправлень, але надійна система запобігання вторгнень знизить цей ризик. Саме ви повинні керувати подібними ризиками безпеки хмарних мереж, використовуючи для захисту своєї хмари правильний набір інструментів і рішень - чи то власні засоби безпеки хмарних постачальників, чи то клієнські рішення "зроби сам", чи то продукти від постачальників засобів кібербезпеки.

У певному сенсі безпека хмарних мереж нагадує звичайну мережеву безпеку. Вона передбачає обмеження доступу до хмарних ресурсів за допомогою міжмережевих екранів, закриття вразливих портів, виявлення і блокування підозрілого мережевого трафіку тощо.

Однак в інших відношеннях безпека хмарних мереж пов'язана з низкою унікальних проблем. Це серед іншого.

Складність хмарних мереж. Хмарні мережі, як правило, складніші, ніж локальні. Вони можуть містити широкий спектр підмереж, віртуальні приватні хмари (наприклад, Amazon VPC), оверлейні мережі і, можливо, навіть міжмережеві з'єднання між декількома хмарами. За такої складності виявляти й усувати ризики безпеки складніше.

Менша прозорість. У хмарі компанії не мають прямого доступу до фізичної мережевої інфраструктури, що означає меншу прозорість того, що відбувається в їхніх мережах.

Динамічний характер хмарних активів. Локальні активи, як правило, більш постійні та статичні, тоді як хмарні - більш динамічні. У хмарі, наприклад, IP-адреси можуть швидко змінюватися, а активи - швидко збільшуватися або зменшуватися. Динамічний характер хмари може ускладнити запобігання ризикам безпеки.

Відсутність чистого периметра мережі. За бажання можна за допомогою брандмауера відокремити всю локальну мережу від Інтернету, але з "хмарою" так ви не зробите. Це означає, що хмарні мережі мають більш розмиті периметри. Можна використовувати рішення постачальників для створення деякої ізоляції між хмарними ресурсами та Інтернетом, але в кінцевому підсумку ці ресурси все одно можуть бути схильні до загроз мережевого рівня.

З цих причин безпека "хмарних" мереж вимагає іншого підходу, ніж традиційна. Не можна просто перенести засоби і процеси з локальної мережі в хмару. Замість цього необхідно впроваджувати рішення безпеки, спеціально розроблені для хмарних середовищ. Ефективний захист хмарних мереж включає три аспекти.

Комплексність. Необхідно мати можливість запобігати загрозам у будь-якій публічній або приватній хмарній мережі, а також у будь-якому іншому компоненті ІТ-системи, використовуючи єдине рішення.

Консолідованість. Інструментарій безпеки має бути консолідованим і забезпечувати єдине управління та операції безпеки.

Спільна робота. Використання даних про загрози та інтеграція із зовнішніми інструментами мають давати змогу командам спільно виявляти та запобігати ризикам безпеки хмарних мереж.

Якщо стратегія безпеки хмарних мереж відповідає всім цим пунктам, ви зможете запобігати ризикам максимально ефективно і результативно.

Крім розгортання вірних засобів захисту, подальшому зміцненню безпеки хмарних мереж сприяє дотримання передових практик.

Серед іншого це Zero Trust (нульова довіра). Ця модель безпеки передбачає заборону на взаємодію ресурсів, що підключаються до хмарної мережі, з іншими ресурсами доти, доки вони не пройдуть перевірку і не будуть визнані безпечними.

Необхідно використовувати підхід “Найменших привілеїв”. Обмеження хмарних сутностей мінімально необхідними привілеями дає змогу знизити ризик і масштаби порушень безпеки, пов'язаних із небезпечними налаштуваннями прав доступу. Методологія найменших привілеїв також привносить контекст у мережеву безпеку, допомагаючи адміністраторам визначити, яку роль має відігравати кожен користувач.

Не забувайте також про сегментацію. Обмеження зв'язку між віртуальними мережами в хмарі може суттєво знизити ризик поширення загрози між мережами.

Ну і в завершення, традиційно нагадаю про необхідність впровадження проактивної стратегії захисту, будь то мова про безпеку хмарних мереж чи традиційних інфраструктур.

25 августа 2023 г., 18:24

Якщо питання, винесене у заголовок задати саме у ChatGPT, то ви отримаєте таку відповідь від системи: «Як мовна модель АІ, я не маю власної волі чи намірів. Однак, як і будь-яка інша технологія, я потенційно можу бути використана зловмисниками зі зловмисними намірами. Зрештою, відповідальність за використання та потенційне зловживання системами штучного інтелекту лежить на користувачах. Важливо, щоб приватні особи та організації використовували технологію штучного інтелекту етично та відповідально, дотримуючись правових та етичних норм і вживаючи заходів обережності для запобігання будь-якій шкоді або зловживанням».

І слід зазначити, що ChatGPT не помиляється…

Генеративні інструменти штучного інтелекту, такі як ChatGPT і Google Bard, набувають все більшої популярності в усьому світі. Ці інструменти дозволяють користувачам підвищити ефективність і продуктивність у виконанні повсякденних завдань і обов’язків.

Однак цими великими можливостями можна зловживати. Невдовзі після появи інструменти генеративного AI почали використовувати для створення шкідливих програм, багато з яких з’явилися в офіційних магазинах додатків. Генеративний AI використовувався для створення електронних листів і повідомлень для фішингових кампаній з використанням AI, а також для створення відео на YouTube, яке було визнано шкідливим.

На жаль, компанії, що розробляють генеративний AI, не займаються цими питаннями. У нещодавньому звіті команда Check Point Research виявила, що Google Bard майже не накладає обмежень на створення фішингових листів і що за мінімальних маніпуляцій його можна використовувати для розробки шкідливих кейлоггерів, що становить загрозу безпеці.

З цих причин деякі компанії вирішили заборонити використання інструментів штучного інтелекту на корпоративних пристроях або в мережах, а інші компанії, які надають працівникам доступ до генеративних інструментів штучного інтелекту, стали жертвами витоку конфіденційних даних.

Тому, поки не буде вжито належних заходів для захисту конфіденційних даних від витоку та внутрішньої інформації від крадіжки, компаніям слід приділяти особливу увагу своїй політиці безпеки.

Мобільні пристрої не є винятком. Насправді користувачі мобільних пристроїв частіше завантажують шкідливі програми або стають жертвами фішингових атак. Маленькі екрани мобільних пристроїв, велика кількість додатків і сповіщень можуть відволікати користувачів, що ускладнює уникнення переходу за шкідливими посиланнями або завантаження шкідливих файлів. Для багатьох з нас соціальні мережі є найбільш часто використовуваними додатками на мобільних пристроях, а це означає, що мобільні користувачі є більш вразливими до соціальної інженерії та фішингу.

Мало того, розмиті межі між особистим і професійним використанням мобільних пристроїв і це робить їх основною точкою входу в організацію, тому захист від загроз штучного інтелекту повинен бути головним пріоритетом.

Що потрібно зробити, щоб захистити свій мобільний парк від загроз AI?

Найважливіше, що необхідно усвідомити, - це те, що користувачам мобільних пристроїв не можна довіряти. Кількість і витонченість атак постійно зростає, і зараз вони занадто просунуті та складні для того, щоб їх могла виявити людина. Класичним прикладом є фішингові сайти, які еволюціонували настільки, що виглядають так само як і оригінальні сайти. Для того, щоб мати справу з таким рівнем складності, вам потрібні передові технології, щоб захистити пристрій і запобігти проникненню загроз у вашу організацію.

Мобільні пристрої - це точка входу в вашу організацію. Оскільки AI розвивається так швидко, виявлення та усунення загроз недостатньо. Ваше рішення для захисту мобільних пристроїв повинно включати превентивні можливості, щоб зупинити загрозу на рівні пристрою ще до того, як вона отримає доступ до ваших корпоративних активів.

Можливості генеративного навчання AI вражають. Щоб йому протистояти, потрібно використовувати AI. Переконайтеся, що ваше рішення безпеки використовує АІ та технологію машинного навчання, щоб зберегти перевагу.

Як, наприклад Check Point Harmony Mobile. Поведінкові механізми у ньому реалізовані запускають кожну програму через різні емулятори, щоб зрозуміти та виявити будь-яку ненормальну, підозрілу, ризиковану або зловмисну поведінку. Шкідливі програми, створені людиною або генеративним АІ, будуть розпізнані та заблоковані ще до того, як вони потраплять на пристрій.

У разі якщо шкідливий агент потрапив на пристрій, функція мережевого захисту Check Point Harmony Mobile, заснована на механізмах AI ThreatCloud і найсучасніших алгоритмах, забезпечить блокування зв’язку між шкідливим додатком і його CnC-сервером, про що буде повідомлено кінцевим користувачам і адміністраторам системи безпеки.

Якщо ваша організація потребує більш суворого підходу, механізми перевірки Check Point Harmony Mobile можуть тегувати мобільні додатки за допомогою служб Generative-AI і внутрішньої інфраструктури. Це означає, що організація може обмежити доступ пристроїв до корпоративних ресурсів, якщо вони містять додатки Generative-AI.

І у завершення, ще раз нагадаю найбільш діючий підхід - організації повинні прагнути запровадити проактивні стратегії, які можуть захистити персонал і корпоративні дані від потенційних кібератак.

4 августа 2023 г., 18:22

Що потрібно зробити, щоб захистити хмарну мережу під час і після міграції у хмару?

Нагадаємо, існує три основні напрямки, які можна обрати для захисту хмарних мереж та міграції:

Захистити свої активи за допомогою рішень безпеки, що надаються постачальником хмарних послуг.

Інвестувати в підхід «зроби сам».

Співпрацювати з постачальником, який спеціалізується на кібербезпеці.

У попередніх постах мова йшла про перший та другий напрямок, а тепер зупинимося на третьому.

Цей підхід полягає у співпраці з постачальником послуг кібербезпеки, чиї програмні рішення і передові практики спеціально розроблені для забезпечення безпеки міграції в хмару і постійного захисту хмарних сервісів. Які ж переваги дає цей підхід? Про це нижче.

Максимальна гнучкість і свобода від прив’язки до конкретного хмарного оператора. Відомий постачальник рішень безпеки може задовольнити ваші потреби незалежно від того, як виглядають різні рівні вашої хмари, і він може працювати з вами незалежно від того, який тип хмарної архітектури - однохмарну, багатохмарну або гібридну - ви використовуєте. Як результат, ви отримуєте максимальну гнучкість і не будете прив’язані до конкретного рішення чи інфраструктури. Якщо в майбутньому ви додасте нового хмарного постачальника - наприклад, в результаті стратегічного вибору, підтримку суверенітету даних або злиття та поглинання з іншим бізнесом - це буде швидко і легко зробити. В результаті ви зможете відповідати не лише вимогам кібербезпеки, з якими стикаєтесь сьогодні, але й тим, з якими зіткнетеся в майбутньому, коли ваш бізнес і хмарна стратегія розвиватимуться.

Спеціалізована експертиза в галузі безпеки. Безпека - це на 100% те, чим займаються спеціалізовані постачальники безпеки. День за днем. Завдяки своєму глибокому досвіду, постачальники послуг з кібербезпеки є авторитетом, якому довіряють, коли мова заходить про безпеку хмарних технологій. Вони пропонують передові рішення та практики безпеки, які відповідають останнім загрозам та методам атак, і тому постійно рекомендуються та визнаються лідерами галузевими аналітиками.

Відповідність нормативним вимогам та регуляторна підтримка. Постачальники рішень з кібербезпеки розуміють вимоги до відповідності, характерні для різних галузей, і їхні рішення можуть допомогти організаціям у виконанні нормативних зобов’язань, пов’язаних з безпекою хмарних технологій, під час процесу міграції та після нього.

Міркування щодо загальної вартості володіння. У довгостроковій перспективі це часто є більш доступним, оскільки потрібно менше часу на розуміння вимог, налаштування та планування, а також навчання команд. Процес розгортання буде набагато швидшим і простішим, що, своєю чергою, також заощадить гроші. І це особливо актуально, коли ви використовуєте одного і того ж постачальника послуг з кібербезпеки для локальної безпеки, міграції в хмару і постійного захисту в хмарі.

Насправді згідно з дослідженням компанії Forrester про те, як один бізнес використовував рішення постачальника кібербезпеки, ПЗ забезпечило загальну рентабельність інвестицій у розмірі 169% з періодом окупності менше трьох місяців.

Але ж у третього напрямку теж є мінуси, про які слід пам’ятати.

Потенційно складніша інтеграція. Оскільки інструменти безпеки сторонніх постачальників не вбудовані в хмари, які вони захищають, налаштування може бути дещо складнішим, ніж при використанні інструментів від хмарного провайдера. Однак, маючи за плечима тисячі безпечних розгортань і міграцій, більшість постачальників рішень для кібербезпеки пропонують безпроблемні процеси інтеграції.

Додавання іншого постачальника. Виробник рішень кібербезпеки стає ще одним постачальником, з яким потрібно працювати. Це створює деякі додаткові операційні зусилля. Але якщо ви використовуєте того самого постачальника послуг з кібербезпеки, що й для захисту вашої локальної мережі, то ці зусилля мінімізуються.

Ми можемо бути дещо упередженими, але Check Point маємо 30 років досвіду у сфері кібербезпеки та понад 100 000 клієнтів по всьому світу, щоб підтвердити наше твердження, що співпраця з постачальником послуг з кібербезпеки - це підхід вартий уваги. Саме він дозволить максимізувати безпеку, простоту використання та рентабельність інвестицій.

Тому, коли постачальник хмарних рішень каже вам, що їхні хмарні рішення для безпеки «достатньо хороші», ви повинні ретельно зважити всі «за» і «проти» такого кроку. І, що важливо, переконайтеся, що ви знаєте, на що йдете.

І на завершення, якщо ви мігруєте в хмару, або намагаєтесь підвищити безпеку ваших систем у хмарі та підбираєте рішення для захисту хмарних мереж, ретельно оцініть різні стратегії та різні інструменти. Check Point та наші партнери з радістю допоможуть вам та нададуть необхідні консультації.

|

|

|