| 0 |

|

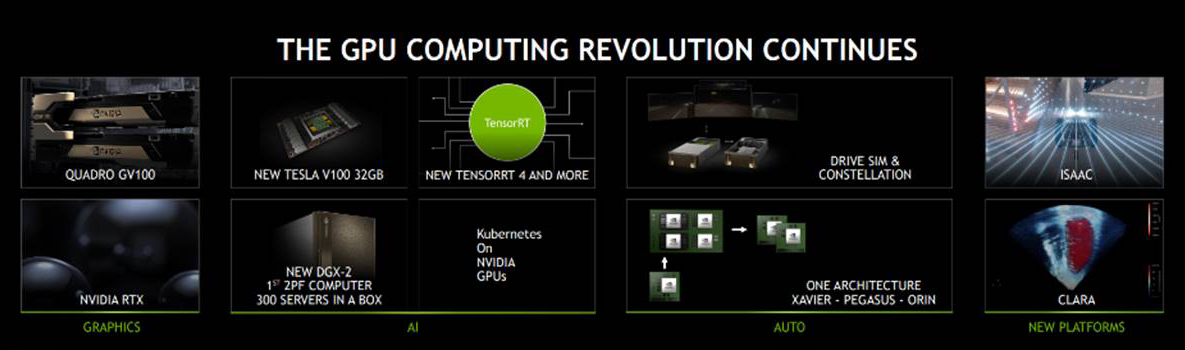

Компания NVIDIA анонсировала ряд новых технологий и партнерств, которые расширяют потенциальный рынок инференса до 30 млн гипермасштабируемых серверов во всем мире и значительно сокращают стоимость сервисов и приложений глубокого обучения.

Выступая с речью на конференции GTC 2018, президент NVIDIA Дженсен Хуанг (Jensen Huang) рассказал о применении GPU-ускорения для инференса глубокого обучения в таких областях, как распознавание речи, обработка естественного языка, системы рекомендаций и распознавание изображений, в дата-центрах и автомобилях, а также в таких устройствах, как роботы и дроны.

NVIDIA анонсировала новую версию ПО для инференса TensorRT и интеграцию TensorRT в популярный фреймворк Google TensorFlow. NVIDIA также объявила о том, что Kaldi, самый популярный фреймворк для распознавания речи, оптимизирован для GPU. Тесное сотрудничество NVIDIA с партнерами, такими, как Amazon, Facebook и Microsoft, позволяет разработчикам применять GPU-ускорение при использовании ONNX и WinML.

NVIDIA представила ПО TensorRT 4 для ускорения инференса глубокого обучения в широком спектре приложений. TensorRT обеспечивает высокую точность работы сетей с операциями INT8 и FP16, что поможет сократить серверные затраты до 70%.

TensorRT 4 может использоваться для быстрой оптимизации, проверки и развертывания обученных нейросетей в гипермасштабируемых дата-центрах, встраиваемых и GPU платформах. Программное обеспечение ускоряет инференс до 190 раз(2) по сравнению с CPU в приложениях для компьютерного зрения, машинного перевода, автоматического распознавания речи, синтеза речи и др.

Для еще большего упрощения процесса инженеры NVIDIA и Google интегрировали TensorRT в TensorFlow 1.7, чтобы улучшить работу приложений инференса на GPU.

NVIDIA оптимизировала ведущий в мире речевой фреймворк Kaldi, чтобы повысить производительность на GPU. GPU-ускорение позволит создавать более точных и полезных виртуальных помощников для потребителей и сократить расходы на внедрение для операторов дата-центров.

Владельцам дата-центров все время приходится искать баланс между производительностью и эффективностью, чтобы их серверы работали максимально продуктивно. Отмечается, что серверы на базе GPU NVIDIA Tesla могут заменить несколько стоек CPU-серверов для приложений инференса, освобождая ценное место в серверной и уменьшая расходы на питание и охлаждение.

TensorRT можно также установить в автономных автомобилях NVIDIA DRIVE и встраиваемых платформах NVIDIA Jetson. Глубокие нейросети на каждом фреймворке можно обучить в системах NVIDIA DGX в дата-центре и затем внедрять во все типы устройств – от роботов до самоуправляемых автомобилей – для осуществления на них инференса в реальном времени.

Стратегія охолодження ЦОД для епохи AI

| 0 |

|