|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

16 февраля 2017 г., 11:44

На днях сразу по нескольким информационным каналам произошла утечка информации о NVMe-накопителе Intel Optane P4800X. Если StorageNewsletter.com ограничился публикацией первой страницы фирменного описания устройства, то Digital Trends поделился с читателями своей попыткой получить дополнительную информацию у производителя. Как и ожидалось, Intel не стал комментировать параметры Optane-устройства. Чего ждать от SSD-накопителя, емкостью 375 ГБ, выполненного в виде платы для PCI Express слота?

Скорее всего, Intel Optane P4800X будет использоваться на серверных платформах в так называемом Storage Mode — в режиме накопителя, чьи объекты, обеспечивающие управление SSD, включены в адресное пространство платформы. Как оперативную память их использовать нельзя, за работу с ними отвечает драйвер блокового устройства. Очевидно, что устройства серии P4800X не являются заменой DRAM, как живописали рекламные материалы недавнего прошлого, а представляют собой быстрый накопитель, отданный в распоряжение операционной системе. И по производительности, и по типу интерфейса. К концепции вытеснения DRAM запоминающими устройствами, выполненными по технологии 3D XPoint, мы сможем вернуться не ранее, чем через два-три года.

Нельзя не отметить, что в опубликованной спецификации сделан акцент на поддержку нестандартных размеров секторов, в том числе программно-видимых значений размеров, не являющиеся целой степенью двойки. Можно ли предположить, что высокие значения Endurance Rating заслуга не только совершенного физического носителя, но и избыточных кодов, (ECC)? Ведь ресурс этого серверного накопителя («живучесть», оптановое число : ) достигает заоблачной на сегодня величины в 30 DWPD.

Intel Optane P4800X оснащается защитой информации от сбоев питания — Power Loss Data Protection. Вероятно, в качестве аварийного источника используются накопительные конденсаторы, дополненные электронными ключами. Такое схемное решение позволяет задействовать питающие напряжения как по линии +5V (или +3,3V), так по линии +12V. Последняя ни на что больше в твердотельных накопителях и не годится.

13 февраля 2017 г., 18:05

Ожидается, что в ближайшем будущем семейство серверных процессоров Xeon начнет оснащаться Volume Management Device — фирменной разработкой Intel, наполняющей новыми смыслами программно-определяемые системы хранения данных. Попытаемся составить представление о технологии VMD незадолго до официального ее запуска.

Volume Management Device — это устройство, которое формирует обособленный фрагмент PCIe-топологии, реализованный отдельным Host Bridge контроллером в составе процессора. Особенность его реализации в том, что платформе предоставляется возможность управлять доступом к выделенной дочерней шине, формируемой VMD. Ее обслуживание может быть скрыто от прикладного программного обеспечения. Поэтому PCIe-топология, реализованная VMD-доменом, не включается в стандартное конфигурационное пространство (MCFG MMIO) и доступна только через отдельный адресный диапазон. Стартовые процедуры UEFI могут декларировать этот диапазон посредством ACPI-интерфейса как дополнительный конфигурационный сегмент. В этом случае топология, адресуемая через Volume Management Device, доступна для сканирования стандартными методами, в том числе и в среде операционной системы с помощью уполномоченных драйверов.

VMD-домен используется для соединения платформы с пулом NVMe-накопителей, аналогично тому, как формируется RAID-масссив. В отличие от классических аппаратных RAID-контроллеров, снабженных собственными процессорами ввода-вывода, операции перемещения данных в сочетании с формированием и проверкой избыточных кодов возлагаются на специальные аппаратные средства в составе микросхемы центрального процессора. В частности, для этого может применяться узел DMA Engine с технологией Intel Quick Data.

Задействуя Volume Management Device, можно получить производные сущности — виртуальные массивы RAID (VROC). Иногда — SW VROC, подчеркивая программный способ организации дискового массива.

Volume Management Device, с точки зрения аппаратной виртуализации, может обслуживать NVMe-накопители, поддерживающие SR-IOV, но только как транзитное звено. Другими словами через VMD можно увидеть реплицированные накопителем виртуальные функции, но сам домен, предположительно, не умеет реплицировать накопители, лишенные функциональности SR-IOV.

Статус каждого накопителя в пуле, принадлежащем VMD, меняется динамически в результате горячей замены или отключения (вывода из эксплуатации). В этом смысле Volume Management Device позволяет изолировать нестабильный фрагмент PCIe-топологии от локальных ресурсов платформы. Каждый VMD-домен воспринимается платформой как отдельный контроллер, не пересекаясь во взаимодействии с другими доменами, коль скоро таковые имеются в составе одного или нескольких центральных процессоров.

В настоящее время приходится только догадываться, какая архитектура NVMe-устройств окажется наиболее приспособленной к доменной структуре. Можно предположить, что для Entry Level решений стоит применять двухпортовые накопители. Спецификация NVMe v1.2.1 подтверждает этот тезис, описывая их как два взаимно-независимые PCIe-устройства. Дополнительные аргументы можно обнаружить в способе реализации сброса: программно инициируемая операция RESET для каждого из портов NVMe-накопителя выполняется независимо. Это означает, что сброс по одному из портов не повлияет на функционирование его компаньона.

Несмотря на то, что двухпортовое NVMe-устройство позволяет изолировать сброс и иные принципиально важные события между портами, создавая дополнительный потенциал масштабируемости, функциональность VMD актуальна и при обслуживании массивов однопортовых накопителей, снабженных внешними коммутаторами. Более того, для разветвленных вычислительных структур, где нужно обслуживать больше двух хостов, двухпортовые устройства не решат проблему — без внешних коммутаторов все равно не обойтись. В итоге, технология Volume Management Device, наряду с двухпортовостью, становится одним из инструментов организации программно-определяемых хранилищ данных.

7 февраля 2017 г., 13:32

Выйдя на арену конвергентных систем, Microsoft настойчиво и неуклонно рекомендует строить сетевую инфраструктуру на протоколах с поддержкой RDMA. Почему так? Если не особо вдаваться в подробности, то ответ будет простым и лаконичным: Zero-Copy.

Борьба с задержками сетевого обмена серверов в среде высокопроизводительных вычислений HPC родила протокол InfiniBand. Благодаря использованию удаленного доступа к памяти (Remote Direct Memory Access, RDMA) он позволяет минимизировать участие процессора в копировании данных в/из оперативной памяти. Infiniband и сейчас востребован в больших дата-центрах и стратосферных облаках типа Microsoft Azure. С ростом объемов хранения и популярности распределенных систем оказалось, низкие сетевые задержки нужны всем. Пересадка протокола RDMA (иногда в вариациях iWARP или RoCE) в демократичную среду Ethernet, поверх транспортного слоя TCP/IP, открыла новые возможности развития сетевой инфраструктуры массовых приложений. Объединить производительность, быстрый сетевой отклик и низкую стоимость экосистемы на стандартных компонентах — хороший рецепт популярности.

RDMA-адаптеры снизили непроизводительные расходы, освободив центральный процессор от рутинных промежуточных пересылок. Их способность раздавать нагрузку процессорам приложений (у Mellanox, например, адаптер ConnectX-4 одновременно общается с 8 ядрами) стала образцом аппаратной многопоточности.

Удаленный доступ непосредственно к памяти только тогда чего-то стоит, если он может работать с актуальной информацией. В конвергентных системах за это отвечает дисковый пул. Пока отклик дисков был медленным — сети не были узким местом. С появлением твердотельных накопителей (масла в огонь добавит технология Optane, в прошлом известная как 3D XPoint, стирающая грани между городом и деревней оперативной и внешней памятью) сетевая архитектура требует широкополосных линков, с короткими задержками, с исключением CPU из обслуживания транзитных пулов памяти.

Общими усилиями удалось получить тысячекратное увеличение скорости доступа. Теперь, при суб-микросекундном его уровне, Zero-Copy становится реальностью. А транспорт с поддержкой 100/200-гигабитного Ethernet уже немыслим без RDMA: отказ от технологии удаленного доступа к памяти потребовал бы соответствующего повышения частоты центрального процессора, о чем можно только мечтать.

В контексте сказанного, уместно задать вопрос: каковы перспективы? Сохранится ли RDMA-технология при внедрении таких инициатив как NTB (Non-Transparent Bridge)? Ведь речь идет о взаимодействии серверных платформ вообще без посредников — по шине PCI Express. Скорее всего, адаптеры Infiniband действительно окажутся ненужными. Но ведь это только частный случай реализации прямого доступа к памяти по сети, а RDMA в более широком смысле, продолжит свое существование.

30 января 2017 г., 15:25

Время бурных анонсов уходит. Это и понятно: рынок переживает не лучшие времена, что сразу сказалось на финансировании PR-компаний. Сегодня мы узнаем о достижениях в области компьютерных технологий из скромных пресс-релизов, догадываясь о подробностях и додумывая детали самостоятельно. Одна из таких вылазок помогла с определенной долей осторожности построить далеко идущие планы.

Новость, которой поделилась компания American Megatrends, не впечатляет какими-то особенными техническими откровениями. Скупой строкой пресс-релиза повествуется об имплементации в свой флагманский продукт Aptio V новейших инициатив — UEFI 2.6 и ACPI v6.1. Читать эту новостную рутину — только время тратить. Но лучше подойти творчески к информации, распространяемой AMI, и поискать смыслы между строк (не зря ведь компания дала к этому информповод?).

Не будет секретом, что одним из ожидаемых новшеств для вычислительных платформ является совмещение оперативной и энергонезависимой памяти. Накануне поголовного перехода на 3D XPoint производители (и American Megatrends в их числе) затаились со своими наработками, обслуживающими функциональность модулей NVDIMM.

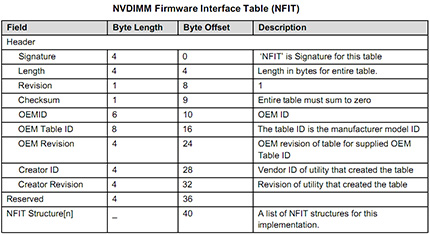

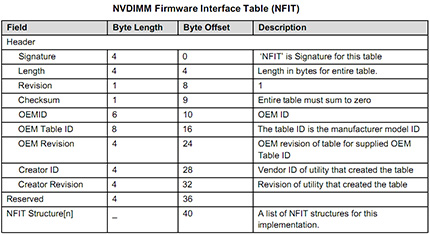

Поле для внедрения новых технологий уже вспахано: на современных платформах, допускающих непосредственное включение энергонезависимой памяти в адресное пространство, есть специальный системный объект — ACPI-таблица NFIT (NVDIMM Firmware Interface Table). Ее структура, а равно алгоритмы формирования системных объектов на основании содержимого SPD, определенные еще в спецификации ACPI 6.0, подвергнуты уточнениям в ACPI 6.1.

Для оптимального и корректного использования модулей NVDIMM, балансирующих на стыке двух технологий, не обойтись без участия UEFI-процедур. Ведь сведения, полученные на этапе детектированием модулей памяти, используются в процессе программирования контроллера ОЗУ: устанавливаются тайминги, каждому модулю назначается диапазон адресного пространства с учетом многоканальности и других факторов. И наконец, данные о конфигурации памяти должны быть переданы от UEFI в операционную систему посредством ACPI-интерфейса.

Теперь, как говорится, все готово для встречи дорогих гостей, хотя нет ни изделий с торговой маркой Intel Optane, ни Optane Ready платформ. В описаниях чипсетов Intel 200 Series, совсем недавно сменивших предыдущее поколение системной логики, Optane упоминается применительно только к SATA-интерфейсу, да и то без обычной в таких случаях детализации. Но не стоит спешить с выводами: обслуживание NVDIMM требует поддержки со стороны контроллера ОЗУ, на сегодня — нового процессорного решения. Но намеки, которыми щедро делится American Megatrends, позволяют предположить: следующие поколения людей будут жить уже с энергонезависимой памятью.

|

|

|