|

СПЕЦІАЛЬНІ

ПАРТНЕРИ

ПРОЕКТУ

Определение наиболее профессиональных ИТ-управленцев, лидеров и экспертов в своих отраслях

Кто внес наибольший вклад в развитие украинского ИТ-рынка.

Награды «Продукт года» еженедельника «Компьютерное обозрение» за наиболее выдающиеся ИТ-товары

|

|

6 июля 2011 г., 19:16

Исследователи из Университета Северной Каролины (NCSU) разработали два новых способа, позволяющих повысить на 10—40%% производительность многоядерных процессоров. Это было достигнуто с помощью новых методов распределения полосы пропускания и предвыборки данных.

Каждое ядро в многоядерном процессоре имеет собственное центральное устройство обработки. В то же время каждое ядро нуждается в извлечении данных из оперативной памяти. Скорость этого процесса ограничивается полосой пропускания соответствующих шин.

Одним из способов повышения производительности ядер является предвыборка данных. Каждый чип имеет небольшой объем собственной памяти, называемой кэшем. При предвыборке в кэш-память считываются данные, которые, по предположению, понадобятся ядру для последующих ближайших вычислений. При точном попадании это увеличивает производительность ядра. Однако предсказание не всегда бывает точным, что перегружает шины при предвыборке ложных данных.

«Первый метод опирается на критерий, который мы разработали, чтобы определить, какую полосу пропускания необходимо предоставить каждому ядру процессора», - сказал д-р Ян Солихин. Некоторые ядра требуют наличия в кэше больше данных, чем другие. Исследователи использовали легко собираемую информацию от аппаратных счетчиков на каждом чипе, чтобы определить, какие ядра нуждаются в большей полосе.

«Второй метод опирается на набор критериев, который мы разработали для определения, когда предвыборка будет повышать производительность и может быть сделана, а когда она будет замедлять процессор, и ее не следует проводить», - пояснил д-р Солихин. Эти критерии также используют данные от аппаратных счетчиков.

При использовании обоих наборов этих критериев исследователям удалось повысить производительность на 40% для многоядерных процессоров без предвыборки данных и на 10% - с предвыборкой.

4 июля 2011 г., 15:12

Зацепление (entanglement) – весьма необычное явление в квантовой физике: оно выражается в том, что если две элементарные частицы когда-либо взаимодействовали друг с другом, то как бы далеко они впоследствии ни удалились одна от другой, они будут описываться общей волновой функцией, то есть изменение состояния одной из них окажет воздействие на другую.

Большинство взаимодействий включает тот или иной вид зацепления. Трудность в том, чтобы их установить. Зацепление очень неустойчивое и быстротекущее явление. Миг – и оно разрушилось. Вот почему так трудно сохранить, наблюдать и еще труднее манипулировать зацепленными частицами.

В последние годы физики научились зацеплять все виды квантовых объектов в пары – фотоны, электроны, атомы и т.п. В 1999 г. они создали кутрит (по аналогии с кубитом), зацепив три фотона. В прошлом году удалось привести в зацепление шесть фотонов.

И вот Син-Цань Яо (Xing-Can Yao) и команда из Университета науки и технологии Китая сообщили, что им удалось привести в зацепленное состояние восемь фотонов, и они манипулировали и наблюдали их всех одновременно.

Это весьма не легкое дело, может быть даже более сложное, чем собрать кошек в стадо.

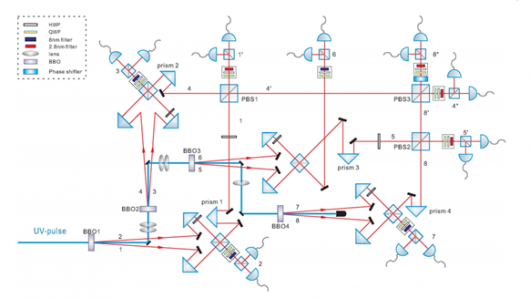

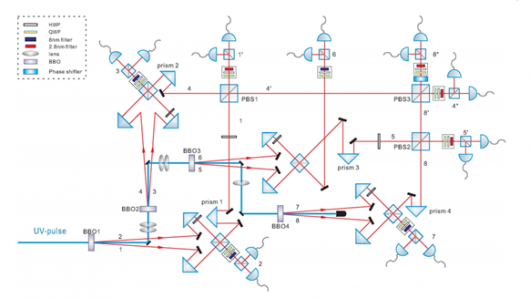

Фокус заключался в том, что вначале фотон высокой энергии был послан через нелинейный кристалл, в котором он расщепился на два зацепленных фотона, но с меньшей энергией. Один из них, фотон А, продолжил путь в экспериментальном устройстве, тогда как другой был снова расщеплен на другом кристалле.

Эта пара была, конечно, зацеплена с фотоном А. Один фотон из этой пары остался в устройстве, тогда как второй снова был расщеплен, и т. д., пока в экспериментальном устройстве не оказалось восемь зацепленных фотонов. Трудность такого эксперимента заключается также в том, что в результате получаются очень слабые лучи.

Схема экспериментальной установки

Сегодня наиболее реально использовать полученные результаты для симулирования других квантовых систем, различных явлений в квантовой физике и даже в биофизике. Физики также предполагают, что 8-фотонное зацепление позволит им продемонстрировать мощный метод коррекции квантовых ошибок в так называемых топологических квантовых компьютерах, существующих пока еще в теории, которые, как полагают, весьма перспективны для создания крупномасштабных квантовых вычислений.

2 июля 2011 г., 17:09

Ученые из Имперского Колледжа, Лондон, осуществили наиболее точное измерение формы электрона. Эксперимент, который длился десять лет, показал, что электрон отличается от точной сферы менее чем на 10-27 см. Это значит, что если бы он был увеличен до размеров Солнечной системы, он все еще был бы сферическим с точностью до толщины человеческого волоса.

Физики из Центра холодной материи изучали движение электронов в молекулах фторида иттербия. Используя очень точный лазер, они провели тщательные измерения их движения. Если бы электроны не были точно сферическими, то их движение испытывало бы биение, как у несбалансированного волчка, и нарушало бы форму молекулы.

Результаты этой работы являются важными для изучения антиматерии. Знание формы электрона могло бы помочь исследователям понять, как ведут себя позитроны и чем материя может отличаться от антиматерии.

Чтобы еще больше повысить точность эксперимента, ученые разрабатывают новые методы измерения формы с использованием сверхнизких температур.

28 июня 2011 г., 22:58

Ученые из Национальной лаборатории Ферми (FNAL) анонсировали 24 июня результаты исследований редкого явления – превращения мюонного нейтрино в электронное. С некоторыми ограничениями эти результаты находятся в соответствии с данными японского эксперимента Tokai-to-Kamioka (T2K), который анонсировал возможность такого типа превращения.

Результаты этих двух экспериментов могут сказаться на нашем понимании роли, которую нейтрино может играть в эволюции вселенной. Если мюонные нейтрино преобразуются в электронные нейтрино, то это могло бы быть причиной, почему при Большом взрыве было произведено больше материи, чем антиматерии.

В эксперименте на установке Main Injector Neutrino Oscillation Search (MINOS) (Главный инжектор поиска осцилляций нейтрино) были зарегистрированы 62 частицы, похожие на электронные нейтрино. Если бы мюонные нейтрино не преобразовывались в электронные, тогда должны были бы быть зарегистрированы только 49 событий. В то же время, согласно эксперименту T2K, при наличии этого явления таких событий должно было бы быть 71. Два эксперимента используют разные методы и технику анализа при рассмотрении этого редкого превращения.

Чтобы обнаружить превращение мюонных нейтрино в другие типы (электронное и тау-нейтрино), в эксперименте MINOS пучок мюонных нейтрино посылается на расстояние 735 км под землей от Главного ускорителя Лаборатории к нейтринному детектору весом 5 тыс. тонн, расположенному на 600-метровой глубине в Суданской подземной лаборатории на севере Миннесоты. В эксперименте используются два почти одинаковых детектора: детектор в Лаборатории - для проверки чистоты пучка мюонного нейтрино, и детектор в Судане (так называется поселок) - для регистрации мюонных и электронных нейтрино.

Более десяти лет ученые имели основания полагать, что три известных типа нейтрино могут превращаться друг в друга. Эксперименты обнаружили, что мюонные нейтрино исчезают. Предполагалось, что бóльшая часть этих нейтрино превращаются в тау-нейтрино, которые до сих пор было очень трудно обнаружить, а меньшая – в электронные нейтрино.

Наблюдение частиц, похожих на электронные нейтрино, в суданском детекторе позволяют ученым оценить значение, называемое sin2 2θ13 (синус квадрат два тэта тринадцать). Если мюонные нейтрино не превращаются в электронные, значение этой величины равно нулю. Согласно эксперименту MINOS значение лежит в диапазоне 0—0,12, тогда как T2K дает диапазон 0,03—0,28.

Эксперимент MINOS будет продолжаться до февраля 2012 г., тогда как T2K был прерван в марте из-за сильного землетрясения, разрушившего источник мюонных нейтрино.

Схема распространения нейтринного пучка

Дальний детектор MINOS в Судане, Миннесота

Ближний детектор MINOS в Лаборатории Ферми

26 июня 2011 г., 19:05

«A Facebook without Facebook.com», - так охарактеризовала вице-президент и директор научной лаборатории вычислительных систем в PARC Тереза Лант (Teresa Lunt) Интернет, который может появиться в ближайшие несколько лет, - управляемый контентом и данными, полностью независимый от лежащей в основе структуры или сетевых точек.

Такова идея сетей, управляемых контентом (Content-Centric Networking, CCN), в которых данные равномерно распределены по сети, с небольшим количеством «облаков» или других решений, необходимых, чтобы собрать все вместе. Ван Якобсон (Van Jacobson), признанный автор концепции CCN, сформулировал ее в 2006 г. на конференции Google.

«Когда вы занимаетесь распространением, вас интересуют данные, а не тот, кто их вам предоставляет. И создатели приложений, и пользователи должны делать это с помощью ужасных операций в своих головах и в сети, … чтобы решить проблему, которую сеть должна была бы решить для них, но не знает их намерений и не может узнать, что они хотят, - сказал он. – Данные не должны где-либо жить, данные – это имя. Архитектура PARC CCN рассматривает контент в качестве первичного и отсоединяет локализацию от идентификации, безопасности и доступа, от концепции хост/машина на самом низком уровне. Мы верим, что фокус на что, а не на где, решает современные проблемы связи лучше, чем традиционная модель пакетных сетей, сохраняя при этом надежность, простоту и масштабируемость сетей TCP/IP».

Тереза Лант сказала, что коммерческие приложения, основанные на CCN, могут появиться через 18 месяцев. Они позволят формировать социальные сети «на лету» самими пользователями, которые будут сами отвечать за их безопасность, без коммерческих сервисов.

24 июня 2011 г., 10:08

Карлос Казелес Хименес (Carlos Caselles Jiménez), исследователь из Мадридского политехнического университета, разработал анонимную систему с автоматическим управлением маршрутами.

Система создает среду для передачи данных, в которой пользователи неидентифицируемы. Эта защита пользователей наряду с улучшением безопасности обмена данными делает более эффективными их получение и отправку. Для этого было разработано многоточечное ПО на базе клиент-серверных приложений.

Цель проекта заключалась в разработке безопасной и эффективной системы связи, которая легко разворачивается на любой сети организации, и возможности управлять всеми установленными соединениями, обеспечивающий эффективный сервис с непрерывной поддержкой безопасности.

Приложение было создано на языке Java в многоплатформенной открытой среде разработки Eclipse для семейства ОС Microsoft Windows, хотя может быть сделано совместимым с Unix-системами. Оно включает OpenSSL-подобный механизм безопасности. С помощью набора инструментов SSL могут быть реализованы протоколы безопасности SSL/TLS, такие как протокол HTTPS, который обеспечивает веб-браузерам безопасный доступ к сайтам, требующих передачу персональных данных.

Этим способом достигается конфиденциальность передаваемых данных, участвующие пользователи идентифицируются во избежание обмана, и гарантируется защита от атак третьей стороны.

В зависимости от ситуации устанавливаются различные транспортные протоколы, использующие сокеты UDP или TCP. Чтобы повысить безопасность потока данных, система имеет встроенный сетевой механизм управления, использующий алгоритм, который вычисляет оптимальные в том или ином смысле маршруты.

Целью проекта было обеспечить установление канала связи анонимной системой, включающем механизмы безопасности с аутентификацией и техникой шифрования для защиты всех данных, которые передаются по сети от разных организаций.

Чтобы увеличить безопасность передачи данных, сетевой доступ TCP/SSL будет ограничиваться машинами, которые имеют действительные цифровые сертификаты. Дополнительно, шифрование UDP-дейтаграмм, использующее симметричный алгоритм BlowFish, позволяет организациям, участвующим в обмене данными, зашифровывать и дешифровывать разделяемый сессионный ключ, делая систему более безопасной.

Другой сильной стороной системы является производительность управления трафиком. Успех здесь достигнут благодаря алгоритму маршрутизации, который вычисляет наиболее эффективные маршруты в зависимости от сложившихся условий. Алгоритм распределяет и обновляет маршруты со временем, позволяя значительно расширять сеть и не беспокоиться о том, что увеличение количества подключений понизит производительность системы.

22 июня 2011 г., 14:41

Технологии помощи водителям, такие как адаптивный автомат постоянной скорости и автоматическое торможение, обещают в один прекрасный день облегчить движение на переполненных маршрутах и предотвращать инциденты. Испытания таких автоматизированных систем являются весьма трудной задачей, но ученые из Университета Карнеги-Меллона продемонстрировали недавно, что проверка безопасности таких сложных систем реальна.

Чтобы сделать это, исследователи сначала разработали модель распределенной системы управления автомобилем, в которой компьютеры и датчики в каждой машине были подключены к управлению газом, тормозом и сменой полосы движения, а также въезду и выезду с магистрали. Затем они использовали математические методы для формализованной проверки того, что система сможет предохранить машины от столкновения друг с другом.

«Система, которую мы создали, является одной из наиболее сложных кибер-физических систем, которые когда-либо проверялись формальными методами, - сказал ассистент профессора Андре Платцер (Andre Platzer) на презентации системы на Международном симпозиуме формальных методов, который сейчас проходит в Университете г. Лимерик, Ирландия. - Дорожные происшествия стоят обществу миллиарды долларов и многих жизней, так что автоматические системы, которые повысят безопасность на дорогах, востребованы».

Формальные методы тестирования являются обычными при проверке компьютерных схем и ПО. Их использование для обнаружения ошибок сопряжено с определенными проблемами. Подобно другим кибер-физическим системам, они должны принимать во внимание как законы физики, так и особенности аппаратного и программного обеспечения. Но системы управления транспортными средствами добавляют еще один уровень сложности, связанный с их распределенностью, иными словами, отсутствует единственный управляющий компьютер – каждая машина принимает решение в зависимости от остальных машин, участвующих в дорожном движении.

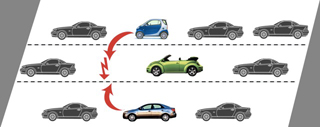

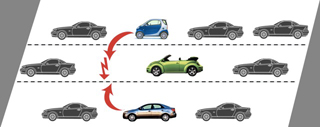

Платцер с сотрудниками показали, что они смогли протестировать безопасность их адаптивной системы круиз-контроля посредством разбиения задачи на иерархическую систему модулей. Самый нижний модуль описывает два автомобиля в одной полосе. Затем на его основе они смогли показать, что система является безопасной для одной полосы с произвольным количеством автомобилей и, в конечном счете, для магистрали с произвольным количеством полос. Подобным же способом, они показали, что машины могут безопасно покидать и переходить на одну полосу движения, а затем распространили метод на многополосную магистраль.

Платцер предостерег, что их доказательство имеет главное ограничение – оно применимо только к прямой магистрали. При решении задачи с поворотами основной фокус будет направлен на учет погрешности датчиков и времени синхронизации. Однако предложенный метод может быть обобщен на другие системы или на изменения динамики автомобилей.

«Любая другая реализация распределенной системы управления автомобилями отличная от той, что мы предложили, будет более сложной, - сказал Платцер. – Но теперь, по крайней мере, мы знаем, что эти будущие системы не являются столь сложными, чтобы мы не могли протестировать их безопасность».

Водители в машинах на верхней и нижней полосах могут полагать, что их перемещение на среднюю полосу перед зеленым автомобилем безопасно, однако в действительности это вызовет их столкновение

20 июня 2011 г., 15:20

Электроинженеры из Университета Дьюка нашли, что уникальные искусственные материалы могли бы теоретически улучшить беспроводную передачу энергии как к небольшим устройствам, таким как ноутбуки или мобильные телефоны, так и к большим – автомобилям или подъемникам.

Теоретически метаматериалы могут улучшить эффективность зарядки устройств без проводов. При беспроводной передаче энергии большая ее часть, а иногда и вся, рассеивается, если только устройства не расположены очень близко друг к другу. Однако предложенные исследователями метаматериалы, которые могут быть размещены между источником и получателем энергии, позволяют передавать энергию через открытое пространство с минимальными потерями.

«Мы в настоящее время способны передавать небольшие порции энергии на короткие расстояния. Примером могут служить устройства RFID, – сказал Ярослав Уржумов, ассистент профессора по электронной и вычислительной технике. – Однако большое количество энергии, как в лазерах или микроволновых печах, сжигало бы все на своем пути. Согласно нашим расчетам возможно использование новых метаматериалов для увеличения количества энергии, передаваемой без негативных эффектов».

Исследования Уржумова являются боковой ветвью исследования в области суперлинз, проводимого в лаборатории проф. Дэвида Смита. Суперлинзы, которые сделаны из метаматериалов, изменяют траектории лучей внутри материала линзы, заключенного между ее двумя внешними поверхностями, что позволяет более точно ими управлять.

Метаматериал, используемый для беспроводной передачи энергии, может быть изготовлен из сотен и тысяч индивидуальных тонких проводящих петель, собранных в массив. Каждая часть сделана из подложки медь-на-фибергласе, используемой для производства печатных плат. Эти части могут затем собираться в огромное множество конфигураций, которые подгоняются к специфическому устройству.

17 июня 2011 г., 13:16

Ученым из Технологического института Карлсруэ (KIT) удалось закодировать данные и передать их со скоростью 26 Тб/с с помощью одного лазерного луча на расстояние 50 км и успешно декодировать информацию. Это максимальный на сегодня объем данных, переданных одним лазерным лучом.

В этом эксперименте ученые из KIT, возглавляемые проф. Юргом Лойтголдом (Jürg Leuthold), побили собственный рекорд по высокоскоростной передаче данных, когда преодолели магический предел 10 Тб/с в 2010 г. Этого успеха группа достигла благодаря новому алгоритму кодирования. Метод оптоэлектронного декодирования является на первом этапе чисто оптическим и выполняется на максимальной скорости передачи данных, а затем скорость понижается и данные обрабатываются электрически. Для рекордной скорости кодирования данных команда использовала мультиплексирование с разделением по ортогональным частотам (OFDM) .

«Для того чтобы передать данные со скоростью 26 Тб/с, необходимо было увеличить скорость обработки не в тысячу раз, а в почти в миллион, - сказал проф. Лойтголд. – Решающей идеей была оптическая реализация математического метода». Оптические вычисления оказались не только очень быстрыми, но и энергоэффективными.

«Наш результат показывает, что физические пределы еще не превышены даже при крайне высоких скоростях передачи, - сказал проф. Лойтголд. – Несколько лет назад скорости 26 Тб/с были утопическими даже при использовании нескольких лазерных лучей».

Проф. Юрг Лойтголд управляет уровнями сигнала

15 июня 2011 г., 21:23

Проблемы безопасности являются одним из главных препятствий для применения новой технологии энергонезависимой основной памяти (NVMM) в компьютерах нового поколения, которая может ускорить старт компьютера и работу памяти. Однако теперь исследователи из Университета Северной Каролины (NCSU) разработали новую аппаратную поддержку шифрования для использования с NVMM, защищающую персональные и другие данные.

Технологии NVMM, такие как фазовая память, являются весьма перспективными для замены традиционной динамической памяти с произвольным доступом (DRAM) в качестве основной памяти в компьютерах. Такая память позволит компьютерам практически мгновенно стартовать. К тому же она занимает гораздо меньше места. Однако при ее использовании возникают проблемы безопасности.

Традиционная DRAM не хранит данные в компьютере после его выключения. Но NVMM оставляет все данные пользователя в основной памяти годами даже после его выключения. Эта особенность может предоставить преступникам доступ к конфиденциальным данным, если ноутбук или смартфон был украден. А поскольку данные сохраняются в основной памяти, они не могут быть зашифрованы с помощью ПО. Исследователи из NCSU разработали аппаратное решение этой проблемы, названное i-NVMM.

«Мы можем использовать аппаратуру для шифрования всего, - объяснил д-р Ян Солихин (Yan Solihin). – Но тогда система будет работать очень медленно, поскольку она должна будет постоянно заниматься шифрованием и дешифрованием данных. Взамен этого мы разработали алгоритм для определения данных, которые с большой вероятностью не нуждаются в обработке процессором. Это позволяет нам держать 78% данных в основной памяти в зашифрованном виде в течение типичных операций, что замедляет производительность системы только на 3,7%».

Технология i-NVMM имеет также еще два преимущества. Первое, ее алгоритм также определяет холостой режим. Это значит, что любые данные, не находящиеся в текущей обработке, такие как номер кредитной карты, автоматически шифруются. Второе, хотя 78% данных в основной памяти шифруются при работе компьютера, остальные 22% шифруются, когда компьютер выключается.

i-NVMM опирается на внутреннюю машину шифрования, которая инкорпорируется в модуль компьютерной памяти и не требует доработок процессора. Это значит, что она может быть использована с разными процессорами и в разных системах.

|

|

|