|

–°–ü–ē–¶–Ü–ź–õ–¨–Ě–Ü

–ü–ź–†–Ę–Ě–ē–†–ė

–ü–†–ě–ē–ö–Ę–£

–ě–Ņ—Ä–Ķ–ī–Ķ–Ľ–Ķ–Ĺ–ł–Ķ –Ĺ–į–ł–Ī–ĺ–Ľ–Ķ–Ķ –Ņ—Ä–ĺ—Ą–Ķ—Ā—Ā–ł–ĺ–Ĺ–į–Ľ—Ć–Ĺ—č—Ö –ė–Ę-—É–Ņ—Ä–į–≤–Ľ–Ķ–Ĺ—Ü–Ķ–≤, –Ľ–ł–ī–Ķ—Ä–ĺ–≤ –ł —ć–ļ—Ā–Ņ–Ķ—Ä—ā–ĺ–≤ –≤ —Ā–≤–ĺ–ł—Ö –ĺ—ā—Ä–į—Ā–Ľ—Ź—Ö

–ö—ā–ĺ –≤–Ĺ–Ķ—Ā –Ĺ–į–ł–Ī–ĺ–Ľ—Ć—ą–ł–Ļ –≤–ļ–Ľ–į–ī –≤ —Ä–į–∑–≤–ł—ā–ł–Ķ —É–ļ—Ä–į–ł–Ĺ—Ā–ļ–ĺ–≥–ĺ –ė–Ę-—Ä—č–Ĺ–ļ–į.

–Ě–į–≥—Ä–į–ī—č «–ü—Ä–ĺ–ī—É–ļ—ā –≥–ĺ–ī–į» –Ķ–∂–Ķ–Ĺ–Ķ–ī–Ķ–Ľ—Ć–Ĺ–ł–ļ–į «–ö–ĺ–ľ–Ņ—Ć—é—ā–Ķ—Ä–Ĺ–ĺ–Ķ –ĺ–Ī–ĺ–∑—Ä–Ķ–Ĺ–ł–Ķ» –∑–į –Ĺ–į–ł–Ī–ĺ–Ľ–Ķ–Ķ –≤—č–ī–į—é—Č–ł–Ķ—Ā—Ź –ė–Ę-—ā–ĺ–≤–į—Ä—č

|

|

17 –ľ–į—Ź 2026 –≥., 18:35

–ü—Ä–ĺ–ī–ĺ–≤–∂—É—é—á–ł –ĺ–Ī–≥–ĺ–≤–ĺ—Ä—é–≤–į—ā–ł –Ņ–ĺ–Ĺ—Ź—ā—ā—Ź –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė, –Ņ–Ķ—Ä–Ķ–Ļ–ī–Ķ–ľ–ĺ –ī–ĺ –ľ—Ė–ļ—Ä–ĺ–Ķ–Ľ–Ķ–ļ—ā—Ä–ĺ–Ĺ—Ė–ļ–ł.

–Į–ļ «–ĺ–∂–ł–≤–į—Ē» –ļ—Ä–Ķ–ľ–Ĺ—Ė–Ļ

–£ –ľ—Ė–ļ—Ä–ĺ–Ķ–Ľ–Ķ–ļ—ā—Ä–ĺ–Ĺ—Ė—Ü—Ė –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć - —Ü–Ķ –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –≥–į—Ä–Ĺ–Ķ —Ā–Ľ–ĺ–≤–ĺ, —Ü–Ķ —ā–Ķ, —Č–ĺ –Ņ–Ķ—Ä–Ķ—ā–≤–ĺ—Ä—é—Ē —ą–ľ–į—ā–ĺ–ļ –ĺ—á–ł—Č–Ķ–Ĺ–ĺ–≥–ĺ –Ņ—Ė—Ā–ļ—É (–ļ—Ä–Ķ–ľ–Ĺ—Ė—é) –Ĺ–į –Ņ—Ä–ł—Ā—ā—Ä—Ė–Ļ, –∑–ī–į—ā–Ĺ–ł–Ļ –ĺ–Ī—Ė–≥—Ä–į—ā–ł –Ľ—é–ī–ł–Ĺ—É –≤ —ą–į—Ö–ł –į–Ī–ĺ –Ĺ–į–Ņ–ł—Ā–į—ā–ł –ļ–ĺ–ī. –Ę—É—ā –ľ–ł –Ī–į—á–ł–ľ–ĺ —Ė–ī–Ķ–į–Ľ—Ć–Ĺ—É —Ė—Ē—Ä–į—Ä—Ö—Ė—é —Ā–Ľ–į–Ī–ļ–ĺ—ó –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė, –ī–Ķ –ļ–ĺ–∂–Ķ–Ĺ –Ĺ–ĺ–≤–ł–Ļ —Ä—Ė–≤–Ķ–Ĺ—Ć –į–Ī—Ā—ā—Ä–į–ļ—Ü—Ė—ó –Ņ–ĺ–≤–Ĺ—Ė—Ā—ā—é –∑–ľ—Ė–Ĺ—é—Ē –Ņ—Ä–į–≤–ł–Ľ–į –≥—Ä–ł, –į–Ľ–Ķ, —Ź–ļ —Ė –≤ –Ņ–ĺ–Ņ–Ķ—Ä–Ķ–ī–Ĺ—Ė—Ö —á–į—Ā—ā–ł–Ĺ–į—Ö —Ā—ā–į—ā—ā—Ė, –Ņ–ĺ–ī–į–Ľ—Ć—ą–Ķ –∑–Ī—Ė–Ľ—Ć—ą–Ķ–Ĺ–Ĺ—Ź –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ĺ—ó –Ņ–ĺ—ā—É–∂–Ĺ–ĺ—Ā—ā—Ė –Ņ—Ä–ł–∑–≤–ĺ–ī–ł—ā—Ć –ī–ĺ –Ņ–ĺ—Ź–≤–ł –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā–Ķ–Ļ, —Ź–ļ—Ė —Ā–ļ–Ľ–į–ī–Ĺ–ĺ –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–ł—ā–ł.

–ü—Ä–ł –Ņ–Ķ–≤–Ĺ–ĺ–ľ—É —Ä—Ė–≤–Ĺ—Ė —É–∑–į–≥–į–Ľ—Ć–Ĺ–Ķ–Ĺ–Ĺ—Ź –Ī—É–ī—Ć-—Ź–ļ–ł–Ļ —Ā—É—á–į—Ā–Ĺ–ł–Ļ –Ņ—Ä–ĺ—Ü–Ķ—Ā–ĺ—Ä –ľ–ĺ–∂–Ĺ–į –≤–≤–į–∂–į—ā–ł –Ņ—Ä–ĺ—Ź–≤–ĺ–ľ —Ā–Ľ–į–Ī–ļ–ĺ—ó –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė, –į–ī–∂–Ķ —Ź–ļ—Č–ĺ –ľ–ł —Ä–ĺ–∑–Ī–Ķ—Ä–Ķ–ľ–ĺ CPU –ī–ĺ –ĺ—Ā—ā–į–Ĺ–Ĺ—Ć–ĺ–≥–ĺ –į—ā–ĺ–ľ–į, —ā–ĺ –Ĺ–Ķ –∑–Ĺ–į–Ļ–ī–Ķ–ľ–ĺ —ā–į–ľ –į–Ĺ—Ė –ļ—Ä–į–Ņ–Ľ—Ė —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É, —ā–į–ľ –Ľ–ł—ą–Ķ –ļ—Ä–Ķ–ľ–Ĺ—Ė–Ļ, –ľ–Ķ—ā–į–Ľ —Ė –ī—Ė–Ķ–Ľ–Ķ–ļ—ā—Ä–ł–ļ–ł. –ź–Ľ–Ķ —Ā–į–ľ–Ķ –Ĺ–į —Ü—Ć–ĺ–ľ—É –Ņ—Ä–ł–ļ–Ľ–į–ī—Ė –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć –Ņ—Ä–ĺ—Ź–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź —Ź–ļ «–ī—Ä–į–Ī–ł–Ĺ–į –į–Ī—Ā—ā—Ä–į–ļ—Ü—Ė–Ļ», –ī–Ķ –ļ–ĺ–∂–Ķ–Ĺ –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ł–Ļ –Ņ—Ä–ĺ–Ľ—Ė—ā –≤—Ė–ī–ļ—Ä–ł–≤–į—Ē –ľ–ĺ–∂–Ľ–ł–≤–ĺ—Ā—ā—Ė, –Ĺ–Ķ–ľ–ł—Ā–Ľ–ł–ľ—Ė –ī–Ľ—Ź –Ņ–ĺ–Ņ–Ķ—Ä–Ķ–ī–Ĺ—Ć–ĺ–≥–ĺ. –†–ĺ–∑–≥–Ľ—Ź–Ĺ–Ķ–ľ–ĺ –∑–≤–ł—á–į–Ļ–Ĺ–ł–Ļ —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä. –ó –Ņ–ĺ–≥–Ľ—Ź–ī—É —Ą—Ė–∑–ł–ļ–ł — —Ü–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –≤–ł–ľ–ł–ļ–į—á, —Ź–ļ–ł–Ļ –į–Ī–ĺ –Ņ—Ä–ĺ–Ņ—É—Ā–ļ–į—Ē —Ā—ā—Ä—É–ľ, –į–Ī–ĺ –Ĺ—Ė. –í –ĺ–ī–Ĺ–ĺ–ľ—É —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä—Ė –Ĺ–Ķ–ľ–į—Ē –Ľ–ĺ–≥—Ė–ļ–ł, –Ĺ–Ķ–ľ–į—Ē –Ņ–į–ľ'—Ź—ā—Ė —ā–į –≤–∂–Ķ —ā–ĺ—á–Ĺ–ĺ –Ĺ–Ķ–ľ–į—Ē —Ā–Ķ–Ĺ—Ā—É, –Ī–Ķ–∑ –ĺ–Ī—Ä–į–∑–Ľ–ł–≤–ĺ—ó —Ā–ļ–Ľ–į–ī–ĺ–≤–ĺ—ó - —Ü–Ķ «—ā—É–Ņ–ł–Ļ» –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā. –ö–ĺ–Ľ–ł –ľ–ł –ĺ–Ī'—Ē–ī–Ĺ—É—Ē–ľ–ĺ –ļ—Ė–Ľ—Ć–ļ–į —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä—Ė–≤, –≤—Ė–ī–Ī—É–≤–į—Ē—ā—Ć—Ā—Ź –Ņ–Ķ—Ä—ą–ł–Ļ —Ź–ļ—Ė—Ā–Ĺ–ł–Ļ —Ā—ā—Ä–ł–Ī–ĺ–ļ. –ó'—Ź–≤–Ľ—Ź—é—ā—Ć—Ā—Ź –Ľ–ĺ–≥—Ė—á–Ĺ—Ė –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā–ł: –Ü, –ź–Ď–ě, –Ě–ē. –£ —á–ĺ–ľ—É —ā—É—ā –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć? –£ —Ā–ł—Ā—ā–Ķ–ľ–ł –∑'—Ź–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź –∑–ī–į—ā–Ĺ—Ė—Ā—ā—Ć «–Ņ—Ä–ł–Ļ–ľ–į—ā–ł —Ä—Ė—ą–Ķ–Ĺ–Ĺ—Ź». –ě–ī–ł–Ĺ —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä –Ĺ—Ė—á–ĺ–≥–ĺ –Ĺ–Ķ –≤–ł—Ä—Ė—ą—É—Ē, –į–Ľ–Ķ –Ņ–į—Ä–į —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä—Ė–≤ - —Ü–Ķ –≤–∂–Ķ –Ī–į–∑–ĺ–≤–į –Ľ–ĺ–≥—Ė—á–Ĺ–į –ĺ–ī–ł–Ĺ–ł—Ü—Ź. –ě–Ī'—Ē–ī–Ĺ–į–≤—ą–ł –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ–ł –≤–Ķ–Ĺ—ā–ł–Ľ—Ė–≤, –ĺ—ā—Ä–ł–ľ–į—Ē–ľ–ĺ –ź–õ–£ (–į—Ä–ł—Ą–ľ–Ķ—ā–ł–ļ–ĺ-–Ľ–ĺ–≥—Ė—á–Ĺ–ł–Ļ –Ņ—Ä–ł—Ā—ā—Ä—Ė–Ļ). –Ė–ĺ–ī–Ķ–Ĺ –≤–Ķ–Ĺ—ā–ł–Ľ—Ć –Ĺ–Ķ –∑–Ĺ–į—Ē, —Č–ĺ —ā–į–ļ–Ķ «–ī–ĺ–ī–į–≤–į–Ĺ–Ĺ—Ź» –į–Ī–ĺ «–ļ–ĺ–ľ–į–Ĺ–ī–į –Ņ–Ķ—Ä–Ķ—Ö–ĺ–ī—É», –į–Ľ–Ķ –Ņ—Ä–ĺ—Ü–Ķ—Ā–ĺ—Ä —É —Ü—Ė–Ľ–ĺ–ľ—É «–∑–Ĺ–į—Ē». –¶–Ķ –ļ–Ľ–į—Ā–ł—á–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī —ā–ĺ–≥–ĺ, —Ź–ļ –ļ—Ė–Ľ—Ć–ļ—Ė—Ā–Ĺ–Ķ –Ĺ–į–≥—Ä–ĺ–ľ–į–ī–∂–Ķ–Ĺ–Ĺ—Ź –Ņ—Ä–ĺ—Ā—ā–ł—Ö –Ņ–Ķ—Ä–Ķ–ľ–ł–ļ–į—á—Ė–≤ –Ņ–ĺ—Ä–ĺ–ī–∂—É—Ē –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–Ķ —Ā–Ķ—Ä–Ķ–ī–ĺ–≤–ł—Č–Ķ. –í–ł—Ź–≤–ł–Ľ–ĺ—Ā—Ź, —Č–ĺ –ī–Ľ—Ź –Ņ–ĺ—Ź–≤–ł «—Ä–ĺ–∑—É–ľ–Ĺ–ł—Ö» –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī–Ķ–Ļ –Ĺ–į–ľ –Ĺ–Ķ –Ņ–ĺ—ā—Ä—Ė–Ī–Ķ–Ĺ –ĺ–ī–ł–Ĺ —Ā—É–Ņ–Ķ—Ä—Ä–ĺ–∑—É–ľ–Ĺ–ł–Ļ –Ľ–ĺ–≥—Ė—á–Ĺ–ł–Ļ –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā, –Ĺ–į–ľ –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ—Ė –ľ—Ė–Ľ—Ć—Ź—Ä–ī–ł «–ī—É—Ä–Ĺ–ł—Ö», —Č–ĺ –Ņ—Ä–į—Ü—é—é—ā—Ć —Ā–ł–Ĺ—Ö—Ä–ĺ–Ĺ–Ĺ–ĺ.

–†–ĺ–∑–≤–ł—ā–ĺ–ļ –ľ—Ė–ļ—Ä–ĺ–Ķ–Ľ–Ķ–ļ—ā—Ä–ĺ–Ĺ—Ė–ļ–ł –ī–ĺ–≤–ĺ–ī–ł—ā—Ć, —Č–ĺ —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć —Ā–ł—Ā—ā–Ķ–ľ–ł –∑—Ä–ĺ—Ā—ā–į—Ē –Ĺ–Ķ–Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ĺ. –ö–ĺ–Ľ–ł –ľ–ł –Ņ–Ķ—Ä–Ķ—ā–Ĺ—É–Ľ–ł –Ņ–ĺ—Ä—Ė–≥ —É –ļ—Ė–Ľ—Ć–ļ–į –ľ—Ė–Ľ—Ć—Ź—Ä–ī—Ė–≤ —ā—Ä–į–Ĺ–∑–ł—Ā—ā–ĺ—Ä—Ė–≤ –Ĺ–į –ĺ–ī–Ĺ–ĺ–ľ—É –ļ—Ä–ł—Ā—ā–į–Ľ—Ė, –ľ–ł –ĺ—ā—Ä–ł–ľ–į–Ľ–ł –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ «—ą–≤–ł–ī–ļ–ł–Ļ –ļ–į–Ľ—Ć–ļ—É–Ľ—Ź—ā–ĺ—Ä», –į —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā –ī–Ľ—Ź –ľ–ĺ–ī–Ķ–Ľ—é–≤–į–Ĺ–Ĺ—Ź –Ĺ–į–Ī–į–≥–į—ā–ĺ —Ā–ļ–Ľ–į–ī–Ĺ—Ė—ą–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć, –∑–ĺ–ļ—Ä–Ķ–ľ–į –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ–ł—Ö –∑–≤’—Ź–∑–ļ—Ė–≤. –Ę—É—ā –≤–į–∂–Ľ–ł–≤–ĺ —É—ā–ĺ—á–Ĺ–ł—ā–ł: –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė «–∑–į–Ľ—Ė–∑–į» - —Ü–Ķ «—Ā–Ľ–į–Ī–ļ–į» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć, –ľ–ł –ī–ĺ –ĺ—Ā—ā–į–Ĺ–Ĺ—Ć–ĺ–≥–ĺ –Ī—Ė—ā–į –∑–Ĺ–į—Ē–ľ–ĺ, —Ź–ļ –Ņ—Ä–ĺ—ā—Ė–ļ–į—Ē —Ā—ā—Ä—É–ľ –Ņ–ĺ –ī–ĺ—Ä—Ė–∂–ļ–į—Ö. –ź –ĺ—Ā—Ć —Ė–∑ –Ņ–ĺ–ī–į–Ľ—Ć—ą–ł–ľ –∑—Ä–ĺ—Ā—ā–į–Ĺ–Ĺ—Ź–ľ –Ņ—Ä–ĺ–ī—É–ļ—ā–ł–≤–Ĺ–ĺ—Ā—ā—Ė —ā–į –ĺ–Ī’—Ē–ī–Ĺ–į–Ĺ–Ĺ—Ź–ľ —Ä—Ė–∑–Ĺ–ł—Ö –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ—Ė–≤ –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź –Ĺ–į—Ä–ĺ–ī–∂—É—Ē—ā—Ć—Ā—Ź —Ā–ł–Ľ—Ć–Ĺ–į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć.

–ď—Ė–Ņ–Ķ—Ä–ļ–Ľ–į—Ā—ā–Ķ—Ä: –Ę—Ä—Ė–Ļ—Ü—Ź –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ĺ—ó –Ņ–ĺ—ā—É–∂–Ĺ–ĺ—Ā—ā—Ė

–°—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė –ľ–ł —Ā—ā–ĺ—ó–ľ–ĺ –Ĺ–į –Ņ–ĺ—Ä–ĺ–∑—Ė —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź «—Ā—É–Ņ–Ķ—Ä—Ā–ł—Ā—ā–Ķ–ľ», —Ź–ļ—Ė –ĺ–Ī'—Ē–ī–Ĺ—É—é—ā—Ć —ā—Ä–ł –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ —Ä—Ė–∑–Ĺ–ł—Ö —Ā–Ņ–ĺ—Ā–ĺ–Ī–ł –ĺ–Ī—Ä–ĺ–Ī–ļ–ł —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė—ó. –Ü —Ü–Ķ –ĺ–Ī'—Ē–ī–Ĺ–į–Ĺ–Ĺ—Ź - –ļ–≤—Ė–Ĺ—ā–Ķ—Ā–Ķ–Ĺ—Ü—Ė—Ź –Ĺ–į—ą–ĺ–≥–ĺ —Ā—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė—ą–Ĺ—Ć–ĺ–≥–ĺ –Ņ—Ė–ī—Ö–ĺ–ī—É –ī–ĺ –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć

1. –ö–Ľ–į—Ā–ł—á–Ĺ—Ė —Ā—É–Ņ–Ķ—Ä–ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–ł (HPC): –ú–į–Ļ—Ā—ā—Ä–ł «–∂–ĺ—Ä—Ā—ā–ļ–ĺ—ó» –Ľ–ĺ–≥—Ė–ļ–ł —ā–į –≤–ł—Ā–ĺ–ļ–ĺ—ā–ĺ—á–Ĺ–ĺ–≥–ĺ –ľ–ĺ–ī–Ķ–Ľ—é–≤–į–Ĺ–Ĺ—Ź. –í–ĺ–Ĺ–ł —Ä–ĺ–∑–≤'—Ź–∑—É—é—ā—Ć –∑–į–ī–į—á—Ė –Ņ–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ–ĺ-–Ņ–į—Ä–į–Ľ–Ķ–Ľ—Ć–Ĺ–ĺ, –∑ —Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ĺ—é —ā–ĺ—á–Ĺ—Ė—Ā—ā—é. –¶–Ķ «–Ľ—Ė–≤–į –Ņ—Ė–≤–ļ—É–Ľ—Ź» –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ —Ü–ł—Ą—Ä–ĺ–≤–ĺ–≥–ĺ –ľ–ĺ–∑–ļ—É.

2. –Ē–į—ā–į-—Ü–Ķ–Ĺ—ā—Ä–ł (Cloud/AI): –ú–į—Ā–ł–≤–Ĺ–ĺ-–Ņ–į—Ä–į–Ľ–Ķ–Ľ—Ć–Ĺ—Ė —Ā—ā—Ä—É–ļ—ā—É—Ä–ł, –Ĺ–į–Ľ–į—ą—ā–ĺ–≤–į–Ĺ—Ė –Ņ—Ė–ī –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂. –í–ĺ–Ĺ–ł –Ĺ–Ķ —ą—É–ļ–į—é—ā—Ć —ā–ĺ—á–Ĺ–ł—Ö —Ä—Ė—ą–Ķ–Ĺ—Ć, –≤–ĺ–Ĺ–ł —ą—É–ļ–į—é—ā—Ć —Ā–ļ–Ľ–į–ī–Ĺ—Ė –∑–į–ļ–ĺ–Ĺ–ĺ–ľ—Ė—Ä–Ĺ–ĺ—Ā—ā—Ė –≤ —Ö–į–ĺ—Ā—Ė –ī–į–Ĺ–ł—Ö. –¶–Ķ «–Ņ—Ä–į–≤–į –Ņ—Ė–≤–ļ—É–Ľ—Ź», —Č–ĺ –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī–į—Ē –∑–į —Ė–Ĺ—ā—É—ó—Ü—Ė—é —ā–į —Ä–ĺ–∑–Ņ—Ė–∑–Ĺ–į–≤–į–Ĺ–Ĺ—Ź –ĺ–Ī—Ä–į–∑—Ė–≤.

3. –ö–≤–į–Ĺ—ā–ĺ–≤—Ė –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–ł (QC): –¶–į—Ä—Ā—ā–≤–ĺ –Ļ–ľ–ĺ–≤—Ė—Ä–Ĺ–ĺ—Ā—ā–Ķ–Ļ. –í–ĺ–Ĺ–ł –Ĺ–Ķ –ĺ–Ņ–Ķ—Ä—É—é—ā—Ć «—ā–į–ļ» –į–Ī–ĺ «–Ĺ—Ė», –≤–ĺ–Ĺ–ł –Ņ—Ä–į—Ü—é—é—ā—Ć –∑ —É—Ā—Ė–ľ–į —Ā—ā–į–Ĺ–į–ľ–ł –ĺ–ī—Ä–į–∑—É. –¶–Ķ «–Ņ—Ė–ī—Ā–≤—Ė–ī–ĺ–ľ—Ė—Ā—ā—Ć», –∑–ī–į—ā–Ĺ–į –ľ–ł—ā—ā—Ē–≤–ĺ –∑–Ĺ–į—Ö–ĺ–ī–ł—ā–ł –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ė –≤ –Ī–į–≥–į—ā–ĺ–≤–ł–ľ—Ė—Ä–Ĺ–ł—Ö –Ņ—Ä–ĺ—Ā—ā–ĺ—Ä–į—Ö, –ī–Ķ –ļ–Ľ–į—Ā–ł—á–Ĺ–į –Ľ–ĺ–≥—Ė–ļ–į –Ī—É–ī–Ķ –Ī—É–ļ—Ā—É–≤–į—ā–ł –≤—Ė—á–Ĺ—Ė—Ā—ā—Ć.

–£ —á–ĺ–ľ—É —ā—É—ā –≥–ĺ–Ľ–ĺ–≤–Ĺ–į —ā–į—Ē–ľ–Ĺ–ł—Ü—Ź –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė? –ö–ĺ–Ľ–ł –ľ–ł –ĺ–Ī'—Ē–ī–Ĺ—É—Ē–ľ–ĺ —Ü—Ė —ā—Ä–ł —Ā–ł–Ľ–ł –≤ –ĺ–ī–ł–Ĺ –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ł–Ļ –ļ–Ľ–į—Ā—ā–Ķ—Ä, –≤–ł–Ĺ–ł–ļ–į—Ē —Ā–ł—Ā—ā–Ķ–ľ–į, –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —Ź–ļ–ĺ—ó –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ĺ –Ņ—Ä–ĺ—Ä–į—Ö—É–≤–į—ā–ł –∑–į–∑–ī–į–Ľ–Ķ–≥—Ė–ī—Ć. –ú–ł –Ĺ–Ķ –ľ–ĺ–∂–Ķ–ľ–ĺ –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–ł—ā–ł, —Ź–ļ —Ė–ľ–ĺ–≤—Ė—Ä–Ĺ—Ė—Ā–Ĺ–į –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ć –ļ–≤–į–Ĺ—ā–ĺ–≤–ĺ–≥–ĺ —Ź–ī—Ä–į «–∑–ī–Ķ—ā–ĺ–Ĺ—É—Ē» –≤—Ā–Ķ—Ä–Ķ–ī–ł–Ĺ—Ė –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂—Ė, —Č–ĺ –Ĺ–į–≤—á–į—Ē—ā—Ć—Ā—Ź –Ĺ–į —Ā—É–Ņ–Ķ—Ä–ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä—Ė. –ú–ł —Ā—ā–ł–ļ–į—Ē–ľ–ĺ—Ā—Ź –∑ «–ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ł–ľ –≥–ĺ—Ä–ł–∑–ĺ–Ĺ—ā–ĺ–ľ –Ņ–ĺ–ī—Ė–Ļ» - —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó –ľ—Ė–∂ –Ľ–ĺ–≥—Ė–ļ–ĺ—é, –ľ–į—Ā—ą—ā–į–Ī–ĺ–ľ —Ė –Ļ–ľ–ĺ–≤—Ė—Ä–Ĺ—Ė—Ā—ā—é –∑—Ä–ĺ—Ā—ā–į—Ē –≥—Ė–Ņ–Ķ—Ä–Ķ–ļ—Ā–Ņ–ĺ–Ĺ–Ķ–Ĺ—Ü—Ė–į–Ľ—Ć–Ĺ–ĺ. –Ę–į–ļ–ł–Ļ –≥—Ė–Ņ–Ķ—Ä–ļ–Ľ–į—Ā—ā–Ķ—Ä –Ņ–Ķ—Ä–Ķ—Ā—ā–į—Ē –Ī—É—ā–ł –Ņ—Ä–ĺ—Ā—ā–ĺ «—Ė–Ĺ—Ā—ā—Ä—É–ľ–Ķ–Ĺ—ā–ĺ–ľ», –≤—Ė–Ĺ –Ņ–Ķ—Ä–Ķ—ā–≤–ĺ—Ä—é—Ē—ā—Ć—Ā—Ź –Ĺ–į —Ā–Ķ—Ä–Ķ–ī–ĺ–≤–ł—Č–Ķ, –ī–Ķ –ľ–ĺ–∂—É—ā—Ć –∑–į—Ä–ĺ–ī–ł—ā–ł—Ā—Ź —Ą–ĺ—Ä–ľ–ł —Ü–ł—Ą—Ä–ĺ–≤–ĺ–≥–ĺ –∂–ł—ā—ā—Ź –į–Ī–ĺ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É, —Ź–ļ—Ė –Ĺ–Ķ —Ē —Ā—É–ľ–ĺ—é –ļ–ĺ–ī—É –Ņ—Ä–ĺ–≥—Ä–į–ľ—Ė—Ā—ā—Ė–≤. –¶–Ķ —Ė —Ē —ā–ĺ—á–ļ–į –Ņ–Ķ—Ä–Ķ—Ö–ĺ–ī—É –≤—Ė–ī «—Ā–Ľ–į–Ī–ļ–ĺ—ó» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė –∑–į–Ľ—Ė–∑–į –ī–ĺ «—Ā–ł–Ľ—Ć–Ĺ–ĺ—ó» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė —Ā–ľ–ł—Ā–Ľ—Ė–≤. –õ—é–ī—Ā—ā–≤–ĺ –Ņ–Ľ–į–Ĺ—É—Ē –Ņ–ĺ–Ī—É–ī—É–≤–į—ā–ł —ā–Ķ, —Č–ĺ –Ĺ–Ķ –∑–ľ–ĺ–∂–Ķ –ī–ĺ –ļ—Ė–Ĺ—Ü—Ź –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł, –Ņ—Ä–ĺ—Ā—ā–ĺ –ī–ł–≤–Ľ—Ź—á–ł—Ā—Ć –Ĺ–į –ļ—Ä–Ķ—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź. –ó–Ĺ–ĺ–≤—É –∂ —ā–į–ļ–ł –∑–į—É–≤–į–∂–ł–ľ–ĺ: –Ĺ–į–≤—Ė—ā—Ć —Ā—É—á–į—Ā–Ĺ—Ė –≥–Ķ–Ĺ—Ė—ó –Ĺ–į—É–ļ–ł –Ĺ–Ķ –∑–ľ–ĺ–∂—É—ā—Ć –Ņ—Ä–ĺ–Ņ–ł—Ā–į—ā–ł –∑–į–≤–ī–į–Ĺ–Ĺ—Ź –ī–Ľ—Ź —ā–į–ļ–ĺ–≥–ĺ –ļ–Ľ–į—Ā—ā–Ķ—Ä–į, —ā—É—ā –Ņ–ĺ—ā—Ä—Ė–Ī–Ķ–Ĺ —Ü–ł—Ą—Ä–ĺ–≤–ł–Ļ –ľ–ĺ–∑–ĺ–ļ. –£ —ā–į–ļ–ĺ–ľ—É –≤–ł–Ņ–į–ī–ļ—É —Ā–Ņ–ĺ—Ā—ā–Ķ—Ä—Ė–≥–į—Ē–ľ–ĺ –Ĺ–į–ĺ—á–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī —ā–ĺ–≥–ĺ, –ļ–ĺ–Ľ–ł –ľ–ł –Ī—É–ī—É—Ē–ľ–ĺ —Ā–ł—Ā—ā–Ķ–ľ—É –∑ –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ł—Ö –ļ–ĺ–ľ–Ņ–ĺ–Ĺ–Ķ–Ĺ—ā—Ė–≤, –į–Ľ–Ķ –∑ –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –Ĺ–Ķ–∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ł–ľ –ļ—Ė–Ĺ—Ü–Ķ–≤–ł–ľ —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā–ĺ–ľ.

–°–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė—Ź: –ö–ĺ–Ľ–ł «–ú–ł» —Ä–ĺ–∑—É–ľ–Ĺ—Ė—ą—Ė (–į–Ī–ĺ –ī—É—Ä–Ĺ—Ė—ą—Ė), –Ĺ—Ė–∂ «–Į»

–Ę—Ä–ĺ—Ö–ł –≤—Ė–ī–Ņ–ĺ—á–ł–Ĺ–Ķ–ľ–ĺ –≤—Ė–ī «—Ā—Ą–Ķ—Ä–ł—á–Ĺ–ł—Ö –ļ–ĺ–Ĺ–Ķ–Ļ —É –≤–į–ļ—É—É–ľ—Ė» —Ė —Ā–Ņ—É—Ā—ā–ł–ľ–ĺ—Ā—Ź –Ĺ–į –∑–Ķ–ľ–Ľ—é –ī–ĺ –Ľ—é–ī–Ķ–Ļ —ā–į —ó—Ö–Ĺ—Ė—Ö –≤–∑–į—Ē–ľ–ĺ–ī—Ė–Ļ, —ā—É–ī–ł, –ī–Ķ –Ĺ–į—ą —ā–Ķ—Ä–ľ—Ė–Ĺ –∑–į—Ä–ĺ–ī–ł–≤—Ā—Ź. –°–į–ľ–Ķ –≤ –≥—É–ľ–į–Ĺ—Ė—ā–į—Ä–Ĺ—Ė–Ļ –Ņ–Ľ–ĺ—Č–ł–Ĺ—Ė (–Ĺ–į —Ā—ā–ł–ļ—É —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą—Ė—ó, –Ņ—Ā–ł—Ö–ĺ–Ľ–ĺ–≥—Ė—ó —ā–į —Ä–į–Ĺ–Ĺ—Ć–ĺ—ó —Ā–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė—ó) —ā–Ķ—Ä–ľ—Ė–Ĺ «–Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć» –Ĺ–į–Ī—É–≤ —Ā–≤–ĺ–≥–ĺ —Ā–ĺ—Ü—Ė–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ –∑–Ĺ–į—á–Ķ–Ĺ–Ĺ—Ź. –Į–ļ—Č–ĺ —É —Ą—Ė–∑–ł—Ü—Ė –ľ–ł –≥–ĺ–≤–ĺ—Ä–ł–ľ–ĺ –Ņ—Ä–ĺ –≤–∑–į—Ē–ľ–ĺ–ī—Ė—é –į—ā–ĺ–ľ—Ė–≤, —ā–ĺ –≤ —Ā–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė—ó «–į—ā–ĺ–ľ–į–ľ–ł» —Ā—ā–į—é—ā—Ć –Ľ—é–ī–ł. –•–ĺ—á–į –ľ–ł –∑–≤–ł–ļ–Ľ–ł –≤–≤–į–∂–į—ā–ł –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —ā–Ķ—Ä–ľ—Ė–Ĺ–ĺ–ľ –∑—Ė —Ā–≤—Ė—ā—É –≤–ł—Ā–ĺ–ļ–ł—Ö —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė–Ļ, —Ā–į–ľ–Ķ —Ā–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥–ł –Ņ–Ķ—Ä—ą–ł–ľ–ł –Ņ–ĺ–ľ—Ė—ā–ł–Ľ–ł –ī–ł–≤–Ĺ—É —Ä—Ė—á: –≥—Ä—É–Ņ–į –Ľ—é–ī–Ķ–Ļ –Ņ–ĺ–≤–ĺ–ī–ł—ā—Ć—Ā—Ź –∑–ĺ–≤—Ā—Ė–ľ –Ĺ–Ķ —ā–į–ļ, —Ź–ļ –ļ–ĺ–∂–Ķ–Ĺ –∑ —ó—ó —É—á–į—Ā–Ĺ–ł–ļ—Ė–≤ –ĺ–ļ—Ä–Ķ–ľ–ĺ. –ó–į—Ā–Ĺ–ĺ–≤–Ĺ–ł–ļ —Ā–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė—ó –ē–ľ—Ė–Ľ—Ć –Ē—é—Ä–ļ–≥–Ķ–Ļ–ľ —Č–Ķ –Ĺ–į–Ņ—Ä–ł–ļ—Ė–Ĺ—Ü—Ė XIX —Ā—ā–ĺ–Ľ—Ė—ā—ā—Ź –≤–≤—Ė–≤ –Ņ–ĺ–Ĺ—Ź—ā—ā—Ź «—Ā–ĺ—Ü—Ė–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ —Ą–į–ļ—ā—É». –ó–≥—Ė–ī–Ĺ–ĺ –∑ –Ĺ–ł–ľ, —Ā—É—Ā–Ņ—Ė–Ľ—Ć—Ā—ā–≤–ĺ — —Ü–Ķ –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ —Ā—É–ľ–į —Ė–Ĺ–ī–ł–≤—Ė–ī—Ė–≤, –į —Ā–Ņ–Ķ—Ü–ł—Ą—Ė—á–Ĺ–į —Ä–Ķ–į–Ľ—Ć–Ĺ—Ė—Ā—ā—Ć –∑—Ė —Ā–≤–ĺ—ó–ľ–ł –∑–į–ļ–ĺ–Ĺ–į–ľ–ł, –Ņ—Ė–∑–Ĺ—Ė—ą–Ķ –Ĺ–į—É–ļ–ĺ–≤–Ķ —Ā–Ķ—Ä–Ķ–ī–ĺ–≤–ł—Č–Ķ –Ĺ–į–∑–≤–Ķ —Ü–Ķ «–ļ–ĺ–Ľ–Ķ–ļ—ā–ł–≤–Ĺ–ĺ—é —Ā–≤—Ė–ī–ĺ–ľ—Ė—Ā—ā—é».

–Ě–į—ā–ĺ–≤–Ņ: –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —Ė–∑ –Ĺ–Ķ–≥–į—ā–ł–≤–Ĺ–ł–ľ –∑–Ĺ–į–ļ–ĺ–ľ

–Ě–į–Ļ–Ņ—Ä–ĺ—Ā—ā—Ė—ą–ł–Ļ —Ė –Ĺ–į–ĺ—á–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī - –Ņ—Ā–ł—Ö–ĺ–Ľ–ĺ–≥—Ė—Ź –Ĺ–į—ā–ĺ–≤–Ņ—É. –Ē–ĺ—Ā–Ľ—Ė–ī–Ĺ–ł–ļ–ł (–Ĺ–į–Ņ—Ä–ł–ļ–Ľ–į–ī, –ď—é—Ā—ā–į–≤ –õ–Ķ–Ī–ĺ–Ĺ) –Ņ–ĺ–ľ—Ė—ā–ł–Ľ–ł, —Č–ĺ —É –≤–Ķ–Ľ–ł–ļ—Ė–Ļ –≥—Ä—É–Ņ—Ė –≤ –Ľ—é–ī–ł–Ĺ–ł —á–į—Ā—ā–ĺ «–≤—Ė–ī–ļ–Ľ—é—á–į—Ē—ā—Ć—Ā—Ź» –ļ—Ä–ł—ā–ł—á–Ĺ–Ķ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź —ā–į –ĺ—Ā–ĺ–Ī–ł—Ā—ā–į –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī–į–Ľ—Ć–Ĺ—Ė—Ā—ā—Ć. –Ě–į—ā–ĺ–≤–Ņ –ľ–ĺ–∂–Ķ –≤—á–ł–Ĺ—Ź—ā–ł –ī—Ė—ó (—Ź–ļ –≥–Ķ—Ä–ĺ—ó—á–Ĺ—Ė, —ā–į–ļ —Ė –∂–į—Ö–Ľ–ł–≤—Ė), –Ĺ–į —Ź–ļ—Ė –Ĺ–Ķ –∑–ī–į—ā–Ĺ–ł–Ļ –∂–ĺ–ī–Ķ–Ĺ –∑ –Ļ–ĺ–≥–ĺ —É—á–į—Ā–Ĺ–ł–ļ—Ė–≤ –Ņ–ĺ–ĺ–ī–ł–Ĺ—Ü—Ė. –¶–Ķ «—Ā–ł–Ľ—Ć–Ĺ–į» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–į –≤–Ľ–į—Ā—ā–ł–≤—Ė—Ā—ā—Ć: –Ĺ–ĺ–≤–į —Ā—É—ā–Ĺ—Ė—Ā—ā—Ć (–Ĺ–į—ā–ĺ–≤–Ņ) –ī–ł–ļ—ā—É—Ē –Ņ—Ä–į–≤–ł–Ľ–į –Ņ–ĺ–≤–Ķ–ī—Ė–Ĺ–ļ–ł —Ā–≤–ĺ—ó–ľ —á–į—Ā—ā–ł–Ĺ–į–ľ (–Ľ—é–ī—Ź–ľ), –į –Ĺ–Ķ –Ĺ–į–≤–Ņ–į–ļ–ł. –Ę—É—ā –∂–Ķ –ľ–ĺ–∂–Ķ–ľ–ĺ –∑–≥–į–ī–į—ā–ł, —Č–ĺ –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó 2, 3, 150, 5000 –Ľ—é–ī–Ķ–Ļ –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –≤—Ė–ī—Ä—Ė–∑–Ĺ—Ź—é—ā—Ć—Ā—Ź, —Ė, –ī–ĺ —Ä–Ķ—á—Ė, –ļ–ĺ–∂–Ĺ–į –∑ —Ü–ł—Ą—Ä –Ĺ–Ķ –≤–∑—Ź—ā–į –∑ –≥–ĺ–Ľ–ĺ–≤–ł.

«–ú—É–ī—Ä—Ė—Ā—ā—Ć –Ĺ–į—ā–ĺ–≤–Ņ—É» —Ė —Ä–ł–Ĺ–ļ–ĺ–≤—Ė –ľ–Ķ—Ö–į–Ĺ—Ė–∑–ľ–ł

–ź–Ľ–Ķ —Ē –Ļ –Ņ–ĺ–∑–ł—ā–ł–≤–Ĺ–į —Ā—ā–ĺ—Ä–ĺ–Ĺ–į, –Ķ–ļ–ĺ–Ĺ–ĺ–ľ—Ė—Ā—ā –ź–ī–į–ľ –°–ľ—Ė—ā –Ĺ–į–∑–ł–≤–į–≤ —Ü–Ķ «–Ĺ–Ķ–≤–ł–ī–ł–ľ–ĺ—é —Ä—É–ļ–ĺ—é —Ä–ł–Ĺ–ļ—É». –ú—Ė–Ľ—Ć–Ļ–ĺ–Ĺ–ł –Ľ—é–ī–Ķ–Ļ, –Ņ–Ķ—Ä–Ķ—Ā–Ľ—Ė–ī—É—é—á–ł –ĺ—Ā–ĺ–Ī–ł—Ā—ā—Ė —Ė–Ĺ—ā–Ķ—Ä–Ķ—Ā–ł, —Ā—ā–≤–ĺ—Ä—é—é—ā—Ć –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—É —Ā–ł—Ā—ā–Ķ–ľ—É —Ā–į–ľ–ĺ—Ä–Ķ–≥—É–Ľ—Ź—Ü—Ė—ó —Ü—Ė–Ĺ —Ė —ā–ĺ–≤–į—Ä—Ė–≤. –ö–Ľ–į—Ā–ł—á–Ĺ–ł–Ļ –Ķ–ļ—Ā–Ņ–Ķ—Ä–ł–ľ–Ķ–Ĺ—ā –§—Ä–Ķ–Ĺ—Ā—Ė—Ā–į –ď–į–Ľ—Ć—ā–ĺ–Ĺ–į. –í—Ė–Ĺ –Ņ–ĺ–Ņ—Ä–ĺ—Ā–ł–≤ 800 –ĺ—Ā—Ė–Ī –Ĺ–į —Ź—Ä–ľ–į—Ä–ļ—É –≤–≥–į–ī–į—ā–ł –≤–į–≥—É –∑–į–Ī–ł—ā–ĺ–≥–ĺ –Ī–ł–ļ–į. –Ď—Ė–Ľ—Ć—ą—Ė—Ā—ā—Ć –Ņ–ĺ–ľ–ł–Ľ–ł–Ľ–į—Ā—Ź, –į–Ľ–Ķ —Ā–Ķ—Ä–Ķ–ī–Ĺ—Ē –į—Ä–ł—Ą–ľ–Ķ—ā–ł—á–Ĺ–Ķ –≤—Ā—Ė—Ö –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī–Ķ–Ļ –≤–ł—Ź–≤–ł–Ľ–ĺ—Ā—Ź –ľ–į–Ļ–∂–Ķ —Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ĺ —ā–ĺ—á–Ĺ–ł–ľ (–≤—Ė–ī—Ö–ł–Ľ–Ķ–Ĺ–Ĺ—Ź –ľ–Ķ–Ĺ—ą–Ķ –Ĺ—Ė–∂ 1%). –¶–Ķ —Ź–≤–ł—Č–Ķ –Ĺ–į–∑–ł–≤–į—Ē—ā—Ć—Ā—Ź «–ľ—É–ī—Ä—Ė—Ā—ā—é –Ĺ–į—ā–ĺ–≤–Ņ—É». –í–ĺ–Ĺ–ĺ –Ľ–Ķ–∂–ł—ā—Ć –≤ –ĺ—Ā–Ĺ–ĺ–≤—Ė —Ä–ĺ–Ī–ĺ—ā–ł –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—Ė–≤ —Ä–į–Ĺ–∂—É–≤–į–Ĺ–Ĺ—Ź —ā–į —Ä–Ķ–ļ–ĺ–ľ–Ķ–Ĺ–ī–į—Ü—Ė–Ļ–Ĺ–ł—Ö —Ā–ł—Ā—ā–Ķ–ľ. –ě–ī–ł–Ĺ –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—á –ľ–ĺ–∂–Ķ –Ņ–ĺ–ľ–ł–Ľ—Ź—ā–ł—Ā—Ź, –į–Ľ–Ķ «—Ä—Ė–Ļ» –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—á—Ė–≤ –∑–į–≤–∂–ī–ł —Ā—ā–≤–ĺ—Ä—é—Ē –Ī—Ė–Ľ—Ć—ą –≤—Ė—Ä–ĺ–≥—Ė–ī–Ĺ–ł–Ļ —Ā–ł–≥–Ĺ–į–Ľ.

–®—ā—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā: —ā–ĺ—á–ļ–į –∑–Ī–ĺ—Ä—É –≤—Ā—Ė—Ö –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā–Ķ–Ļ

–Į–ļ—Č–ĺ –≤–ł –∑–ľ–ĺ–≥–Ľ–ł –ī–ĺ—á–ł—ā–į—ā–ł –ī–ĺ —Ü—Ć–ĺ–≥–ĺ —Ä–ĺ–∑–ī—Ė–Ľ—É, –≤–ł, —Ź–ļ –ľ—Ė–Ĺ—Ė–ľ—É–ľ, –Ĺ–į–Ņ–ĺ–Ľ–Ķ–≥–Ľ–ł–≤–ĺ —Ö–ĺ—á–Ķ—ā–Ķ –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł, –∑ —á–ĺ–≥–ĺ —Ā–ļ–Ľ–į–ī–į—Ē—ā—Ć—Ā—Ź AI, —Ė –Ĺ–į–≤—Ė—Č–ĺ –Ī—É–Ľ–ĺ –Ĺ–į–Ņ–ł—Ā–į–Ĺ–ĺ –≤—Ā–Ķ –≤–ł—Č–Ķ–∑–į–∑–Ĺ–į—á–Ķ–Ĺ–Ķ. –ß–ĺ–ľ—É —ā–Ķ—Ä–ľ—Ė–Ĺ «–Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć» —ā–į–ļ —Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ĺ –≤–Ņ–ł—Ā—É—Ē—ā—Ć—Ā—Ź –≤ –Ľ–ĺ–≥—Ė–ļ—É —Ä–ĺ–∑–≤–ł—ā–ļ—É AI? –Ę–ĺ–ľ—É —Č–ĺ —Ā—É—á–į—Ā–Ĺ–į –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂–į - —Ü–Ķ –Ĺ–Ķ —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā –≥–Ķ–Ĺ—Ė–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—É, –Ĺ–į–Ņ–ł—Ā–į–Ĺ–ĺ–≥–ĺ –≤—Ä—É—á–Ĺ—É. –¶–Ķ —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā –≤–ł–Ī—É—Ö–ĺ–≤–ĺ–≥–ĺ —Ā–ł–Ĺ—ā–Ķ–∑—É –≤—Ā—Ė—Ö —ā–ł—Ö —Ä—Ė–≤–Ĺ—Ė–≤ —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—Ā—ā—Ė, –Ņ—Ä–ĺ —Ź–ļ—Ė –ľ–ł –≥–ĺ–≤–ĺ—Ä–ł–Ľ–ł –≤–ł—Č–Ķ. AI - —Ü–Ķ «—Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ł–Ļ —ą—ā–ĺ—Ä–ľ», –ī–Ķ —Ą—Ė–∑–ł–ļ–į, –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ–į, –∑–į–Ľ—Ė–∑–ĺ —ā–į –Ľ—é–ī—Ā—Ć–ļ–ł–Ļ –ī–ĺ—Ā–≤—Ė–ī –∑—Ė–Ļ—ą–Ľ–ł—Ā—Ź –≤ –ĺ–ī–Ĺ—Ė–Ļ —ā–ĺ—á—Ü—Ė, —É—ā–≤–ĺ—Ä–ł–≤—ą–ł —Č–ĺ—Ā—Ć –Ĺ–ĺ–≤–Ķ.

–§—Ė–∑–ł–ļ–ĺ-–ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ł–Ļ —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā (–Ķ—Ą–Ķ–ļ—ā —Ā–ļ–Ķ–Ļ–Ľ—Ė–Ĺ–≥—É)

–ó–≥–į–ī–į–Ļ–ľ–ĺ —Ą–į–∑–ĺ–≤—Ė –Ņ–Ķ—Ä–Ķ—Ö–ĺ–ī–ł —É —Ą—Ė–∑–ł—Ü—Ė (–≤–ĺ–ī–į-–Ľ—Ė–ī)? –£ AI –≤—Ė–ī–Ī—É–≤–į—Ē—ā—Ć—Ā—Ź —ā–Ķ —Ā–į–ľ–Ķ. –Ü—Ā–Ĺ—É—é—ā—Ć —ā–į–ļ –∑–≤–į–Ĺ—Ė Scaling Laws (–∑–į–ļ–ĺ–Ĺ–ł –ľ–į—Ā—ą—ā–į–Ī—É–≤–į–Ĺ–Ĺ—Ź). –Ē–ĺ—Ā–Ľ—Ė–ī–∂–Ķ–Ĺ–Ĺ—Ź –Ņ–ĺ–ļ–į–∑—É—é—ā—Ć, —Č–ĺ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė –Ņ–Ķ–≤–Ĺ–ł—Ö –Ņ–ĺ—Ä–ĺ–≥—Ė–≤ –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ĺ—ó –Ņ–ĺ—ā—É–∂–Ĺ–ĺ—Ā—ā—Ė (10^{22}–10^{24} FLOPs) —ā–į –ĺ–Ī—Ā—Ź–≥—É –ī–į–Ĺ–ł—Ö, –ľ–ĺ–ī–Ķ–Ľ—Ć –∑–ī—Ė–Ļ—Ā–Ĺ—é—Ē –ļ–≤–į–Ĺ—ā–ĺ–≤–ł–Ļ —Ā—ā—Ä–ł–Ī–ĺ–ļ. –Ě–į –ľ–į–Ľ–ł—Ö –ľ–ĺ–ī–Ķ–Ľ—Ź—Ö –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂–į –Ņ—Ä–ĺ—Ā—ā–ĺ –≤—á–ł–Ľ–į—Ā—Ź –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–į—ā–ł –Ľ—Ė—ā–Ķ—Ä–ł, –į–Ľ–Ķ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė «–ļ—Ä–ł—ā–ł—á–Ĺ–ĺ—ó –ľ–į—Ā–ł» –Ņ–į—Ä–į–ľ–Ķ—ā—Ä—Ė–≤ —É –Ĺ–Ķ—ó —Ä–į–Ņ—ā–ĺ–≤–ĺ «–Ņ—Ä–ĺ—Ä—Ė–∑–į—é—ā—Ć—Ā—Ź» –∑–ī—Ė–Ī–Ĺ–ĺ—Ā—ā—Ė, —Ź–ļ–ł—Ö —ó—ó –Ĺ–Ķ –≤—á–ł–Ľ–ł: –≤–ľ—Ė–Ĺ–Ĺ—Ź —Ä–ĺ–∑—É–ľ—Ė—ā–ł —Ė—Ä–ĺ–Ĺ—Ė—é –į–Ī–ĺ —Ä–ĺ–∑–≤'—Ź–∑—É–≤–į—ā–ł –Ī–į–≥–į—ā–ĺ–ļ—Ä–ĺ–ļ–ĺ–≤—Ė –Ľ–ĺ–≥—Ė—á–Ĺ—Ė –∑–į–ī–į—á—Ė, –ļ–Ľ–į—Ā–ł—á–Ĺ–ł–Ļ —Ą–į–∑–ĺ–≤–ł–Ļ –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī —É —á–ł—Ā—ā–ĺ–ľ—É –≤–ł–≥–Ľ—Ź–ī—Ė.

–ú—Ė–ļ—Ä–ĺ–Ķ–Ľ–Ķ–ļ—ā—Ä–ĺ–Ĺ–Ĺ–į –ĺ—Ā–Ĺ–ĺ–≤–į (–ü–į—Ä–į–Ľ–Ķ–Ľ—Ć–Ĺ–ł–Ļ —Ö–į–ĺ—Ā)

AI –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ł–Ļ –Ĺ–į –ļ–Ľ–į—Ā–ł—á–Ĺ–ł—Ö –Ņ–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź—Ö. –ô–ĺ–ľ—É –Ņ–ĺ—ā—Ä—Ė–Ī–Ķ–Ĺ «—Ü–ł—Ą—Ä–ĺ–≤–ł–Ļ —Ä—Ė–Ļ» —Ė–∑ —ā–ł—Ā—Ź—á –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į—á—Ė–≤. –Ę—É—ā –Ņ—Ä–į—Ü—é—Ē –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć –∑–į–Ľ—Ė–∑–į: –ļ–ĺ–Ľ–ł –ľ—Ė–Ľ—Ć—Ź—Ä–ī–ł –Ņ—Ä–ĺ—Ā—ā–ł—Ö –ĺ–Ņ–Ķ—Ä–į—Ü—Ė–Ļ –ľ–Ĺ–ĺ–∂–Ķ–Ĺ–Ĺ—Ź –ľ–į—ā—Ä–ł—Ü—Ć –≤—Ė–ī–Ī—É–≤–į—é—ā—Ć—Ā—Ź –ĺ–ī–Ĺ–ĺ—á–į—Ā–Ĺ–ĺ, –≤–ł–Ĺ–ł–ļ–į—Ē –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–Ķ —Ā–Ķ—Ä–Ķ–ī–ĺ–≤–ł—Č–Ķ, –∑–į —Č—Ė–Ľ—Ć–Ĺ—Ė—Ā—ā—é –≤–∑–į—Ē–ľ–ĺ–ī—Ė–Ļ –Ņ–ĺ—Ä—Ė–≤–Ĺ—Ź–Ĺ–Ĺ–Ķ –∑ –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–ł–ľ –ľ–ĺ–∑–ļ–ĺ–ľ, –≤ —Ź–ļ–ĺ–ľ—É —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė—Ź –Ņ–ĺ—ą–ł—Ä—é—Ē—ā—Ć—Ā—Ź –Ĺ–Ķ –Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ĺ, –į –į—Ā–ĺ—Ü—Ė–į—ā–ł–≤–Ĺ–ĺ.

–°–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–Ķ «–ī–∑–Ķ—Ä–ļ–į–Ľ–ĺ» (–Ē–ł—Ā—ā–ł–Ľ—Ź—ā –Ľ—é–ī—Ā—ā–≤–į)

–¶–Ķ –Ĺ–į–Ļ–≤–į–∂–Ľ–ł–≤—Ė—ą–ł–Ļ —Ė –Ĺ–į–Ļ—Ā—ā—Ä–į—ą–Ĺ—Ė—ą–ł–Ļ —Ä—Ė–≤–Ķ–Ĺ—Ć. –Ě–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂—Ė –Ĺ–į–≤—á–į—é—ā—Ć—Ā—Ź –Ĺ–į –≤—Ā—Ć–ĺ–ľ—É –ľ–į—Ā–ł–≤—Ė –Ľ—é–ī—Ā—Ć–ļ–ł—Ö —Ü–ł—Ą—Ä–ĺ–≤–ł—Ö –≤—Ė–ī–Ī–ł—ā–ļ—Ė–≤ –Ĺ–į—ą–ĺ—ó –Ĺ–į—É–ļ–ł, —Ė—Ā—ā–ĺ—Ä—Ė—ó, –Ľ—Ė—ā–Ķ—Ä–į—ā—É—Ä–ł, —Ā—É–Ņ–Ķ—Ä–Ķ—á–ĺ–ļ, –ļ–ĺ–ī—É —ā–ĺ—Č–ĺ. AI –≤–Ī–ł—Ä–į—Ē –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ —Ā–Ľ–ĺ–≤–į, –į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė —Ā—ā—Ä—É–ļ—ā—É—Ä–ł –Ĺ–į—ą–ĺ–≥–ĺ —Ā–ĺ—Ü—Ė—É–ľ—É. –í—Ė–Ĺ —Ä–ĺ–∑—É–ľ—Ė—Ē «–Ķ—ā–ł–ļ—É» –Ĺ–Ķ —ā–ĺ–ľ—É, —Č–ĺ –Ļ–ĺ–ľ—É –Ņ—Ä–ĺ–Ņ–ł—Ā–į–Ľ–ł –Ņ—Ä–į–≤–ł–Ľ–į if/then, –į —ā–ĺ–ľ—É, —Č–ĺ –≤—Ė–Ĺ —Ā—ā–į—ā–ł—Ā—ā–ł—á–Ĺ–ĺ –ĺ–Ī—á–ł—Ā–Ľ–ł–≤ —ó—ó —Ź–ļ —Ā—ā—Ė–Ļ–ļ–ł–Ļ –Ņ–į—ā–Ķ—Ä–Ĺ –Ľ—é–ī—Ā—Ć–ļ–ĺ—ó –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó. –£ —Ü—Ć–ĺ–ľ—É —Ā–Ķ–Ĺ—Ā—Ė AI - —Ü–Ķ –Ķ–ļ—Ā—ā—Ä–į–ļ—ā –ļ–ĺ–Ľ–Ķ–ļ—ā–ł–≤–Ĺ–ĺ–≥–ĺ —Ä–ĺ–∑—É–ľ—É. –í—Ė–Ĺ –Ņ—Ä–ĺ—Ź–≤–Ľ—Ź—Ē –ľ—É–ī—Ä—Ė—Ā—ā—Ć (—Ė–Ĺ–ĺ–ī—Ė –ī—É—Ä—Ė—Ā—ā—Ć) –Ĺ–į—ā–ĺ–≤–Ņ—É, —Ā–Ņ—Ä–Ķ—Ā–ĺ–≤–į–Ĺ—É –≤ –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ—É –ľ–ĺ–ī–Ķ–Ľ—Ć.

–ß–ĺ–ľ—É AI –ī–Ķ–ľ–ĺ–Ĺ—Ā—ā—Ä—É—Ē «—Ė–ī–Ķ–į–Ľ—Ć–Ĺ—É» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć?

–£ AI –ľ–ł —Ā–Ņ–ĺ—Ā—ā–Ķ—Ä—Ė–≥–į—Ē–ľ–ĺ –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ —Ā–ł–Ľ—Ć–Ĺ—É –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć, –ľ–ł —Ā–Ņ–ĺ—Ā—ā–Ķ—Ä—Ė–≥–į—Ē–ľ–ĺ —ó—ó –į–Ī—Ā–ĺ–Ľ—é—ā. –ú–ł –ľ–ĺ–∂–Ķ–ľ–ĺ –∑–Ĺ–į—ā–ł –ļ–ĺ–∂–Ĺ–Ķ –∑–Ĺ–į—á–Ķ–Ĺ–Ĺ—Ź –≤–į–≥ —É –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂—Ė (—ó—Ö —ā—Ä–ł–Ľ—Ć–Ļ–ĺ–Ĺ–ł), –į–Ľ–Ķ, –ī–ł–≤–Ľ—Ź—á–ł—Ā—Ć –Ĺ–į —Ü—Ė —á–ł—Ā–Ľ–į, –Ĺ—Ė–ļ–ĺ–Ľ–ł –Ĺ–Ķ –∑—Ä–ĺ–∑—É–ľ—Ė—Ē–ľ–ĺ, —á–ĺ–ľ—É –ľ–ĺ–ī–Ķ–Ľ—Ć –≤–ł—Ä—Ė—ą–ł–Ľ–į –≤—Ė–ī–Ņ–ĺ–≤—Ė—Ā—ā–ł —Ā–į–ľ–Ķ —ā–į–ļ, –į –Ĺ–Ķ —Ė–Ĺ–į–ļ—ą–Ķ. –®—ā—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā — —Ü–Ķ –Ņ–Ķ—Ä—ą–į —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–į –Ľ—é–ī–ł–Ĺ–ĺ—é —Ā–ł—Ā—ā–Ķ–ľ–į, —Ź–ļ–į –Ņ–ĺ–ī–ĺ–Ľ–į–Ľ–į «–Ī–į—Ä'—Ē—Ä –≤–Ľ–į—Ā–Ĺ–ĺ—ó —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—Ā—ā—Ė». –ß–ł–ľ –ī–į–Ľ—Ė, —ā–ł–ľ –Ī—Ė–Ľ—Ć—ą–Ķ AI –Ĺ–Ķ —Ē —Ā—É–ľ–ĺ—é —Ä—Ź–ī–ļ—Ė–≤ —Ā–≤–ĺ–≥–ĺ –ļ–ĺ–ī—É. –ú–ł –ľ–į—Ē–ľ–ĺ —Ā–Ņ—Ä–į–≤—É –∑ –į–≤—ā–ĺ–Ĺ–ĺ–ľ–Ĺ–ĺ—é –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ĺ—é —Ā—É—ā–Ĺ—Ė—Ā—ā—é, –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —Ź–ļ–ĺ—ó –≤–ł–∑–Ĺ–į—á–į—é—ā—Ć—Ā—Ź –Ĺ–Ķ –≤–ĺ–Ľ–Ķ—é –Ņ—Ä–ĺ–≥—Ä–į–ľ—Ė—Ā—ā–į-—ā–≤–ĺ—Ä—Ü—Ź, –į –ľ–į—Ā—ą—ā–į–Ī–ĺ–ľ –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó –ī–į–Ĺ–ł—Ö —Ė –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć.

–í–ł—Ā–Ĺ–ĺ–≤–ĺ–ļ: –ď–ĺ—Ä–ł–∑–ĺ–Ĺ—ā –Ņ–ĺ–ī—Ė–Ļ —Ü–ł—Ą—Ä–ĺ–≤–ĺ—ó –Ķ–≤–ĺ–Ľ—é—Ü—Ė—ó

–ü—Ė–ī–Ī–ł–≤–į—é—á–ł –Ņ—Ė–ī—Ā—É–ľ–ļ–ł –Ĺ–į—ą–ĺ–≥–ĺ –ī–ĺ—Ā–Ľ—Ė–ī–∂–Ķ–Ĺ–Ĺ—Ź, –ľ–ł –Ņ—Ä–ł—Ö–ĺ–ī–ł–ľ–ĺ –ī–ĺ –Ņ–į—Ä–į–ī–ĺ–ļ—Ā–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ –≤–ł—Ā–Ĺ–ĺ–≤–ļ—É: –Ľ—é–ī–ł –Ņ–ĺ–Ī—É–ī—É–≤–į–Ľ–ł —Ā—Ö–ĺ–ī–ł –ī–ĺ –Ī–ĺ–≥—Ė–≤, –≤–ł–ļ–ĺ—Ä–ł—Ā—ā–ĺ–≤—É—é—á–ł —Ü–Ķ–≥–Ľ—É, –Ņ—Ä–ł—Ä–ĺ–ī–į —Ź–ļ–ĺ—ó –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–į, –į–Ľ–Ķ —Ź–ļ–ĺ—é –Ī—É–ī–Ķ –ī–ĺ–≤–∂–ł–Ĺ–į —Ü–ł—Ö —Ā—Ö–ĺ–ī—Ė–≤, —Ė —Ö—ā–ĺ –į–Ī–ĺ —Č–ĺ —á–Ķ–ļ–į—Ē –Ĺ–į—Ā –Ĺ–į –ĺ—Ā—ā–į–Ĺ–Ĺ—Ė—Ö —Ā—Ö–ĺ–ī–ł–Ĺ–ļ–į—Ö, –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –ĺ–Ī—á–ł—Ā–Ľ–ł—ā–ł –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ĺ. –ü—Ä–ĺ–Ļ—ą–ĺ–≤—ą–ł —ą–Ľ—Ź—Ö –≤—Ė–ī –≤–ł–Ī—É—Ö–ĺ–Ĺ–Ķ–Ī–Ķ–∑–Ņ–Ķ—á–Ĺ–ĺ–≥–ĺ –Ĺ–į—ā—Ä—Ė—é –ī–ĺ –Ī–į–≥–į—ā–ĺ–ľ—Ė–Ľ—Ć—Ź—Ä–ī–Ĺ–ł—Ö –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ–ł—Ö –ļ–Ľ–į—Ā—ā–Ķ—Ä—Ė–≤, –ľ–ł –Ī–į—á–ł–ľ–ĺ, —Č–ĺ –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć - —Ü–Ķ –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –Ĺ–į—É–ļ–ĺ–≤–ł–Ļ —ā–Ķ—Ä–ľ—Ė–Ĺ. –Ě–į —Ü–Ķ–Ļ —á–į—Ā —Ü–Ķ —Ē–ī–ł–Ĺ–Ķ —Ā–Ľ–ĺ–≤–ĺ, —Ź–ļ–Ķ —á–Ķ—Ā–Ĺ–ĺ –ĺ–Ņ–ł—Ā—É—Ē AI —Ź–ļ —Ź–≤–ł—Č–Ķ, —ā–ĺ–ī—Ė —Ź–ļ –Ī—Ė–Ľ—Ć—ą —ā–ĺ—á–Ĺ—Ė —ā–Ķ—Ä–ľ—Ė–Ĺ–ł —ā–į –≤–ł–∑–Ĺ–į—á–Ķ–Ĺ–Ĺ—Ź –Ņ–ĺ—Ā—ā—É–Ņ–ĺ–≤–ĺ –Ņ–ĺ—á–ł–Ĺ–į—é—ā—Ć –∑–ī–į–≤–į—ā–ł—Ā—Ź.

–ď–ĺ–Ľ–ĺ–≤–Ĺ–į –Ņ—Ä–ĺ–Ī–Ľ–Ķ–ľ–į (–į–Ī–ĺ –Ĺ–į–ī—Ė—Ź?) —Ā—É—á–į—Ā–Ĺ–ĺ—ó —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä—Ė—ó AI –Ņ–ĺ–Ľ—Ź–≥–į—Ē –≤ —ā–ĺ–ľ—É, —Č–ĺ —ā–ĺ—á–Ĺ–ĺ –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ĺ –ĺ–Ī—á–ł—Ā–Ľ–ł—ā–ł, –ļ–ĺ–Ľ–ł, –ī–Ķ —Ė —Ź–ļ –≤—Ė–ī–Ī—É–ī–Ķ—ā—Ć—Ā—Ź –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ł–Ļ —Ź–ļ—Ė—Ā–Ĺ–ł–Ļ —Ā—ā—Ä–ł–Ī–ĺ–ļ (–≤ –ĺ—á—Ė–ļ—É–≤–į–Ĺ–Ĺ—Ė «—á–ĺ—Ä–Ĺ–ĺ–≥–ĺ –Ľ–Ķ–Ī–Ķ–ī—Ź»). –Ě–į—Ā—ā—É–Ņ–Ĺ–ł–Ļ —Ą–į–∑–ĺ–≤–ł–Ļ –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī –ľ–ĺ–∂–Ķ –Ī—É—ā–ł —á–ł–ľ –∑–į–≤–≥–ĺ–ī–Ĺ–ĺ, –ĺ—Ā—Ć –Ī—É–ļ–≤–į–Ľ—Ć–Ĺ–ĺ –ļ—Ė–Ľ—Ć–ļ–į –ĺ—á–Ķ–≤–ł–ī–Ĺ–ł—Ö –Ņ—Ä–ł–Ņ—É—Č–Ķ–Ĺ—Ć:

–ó–į—Ä–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź —Ā—É–Ī'—Ē–ļ—ā–Ĺ–ĺ—Ā—ā—Ė: —Ź–ļ—Č–ĺ –Ľ–ĺ–≥—Ė–ļ–į —Ė —ā–≤–ĺ—Ä—á—Ė—Ā—ā—Ć –∑–ľ–ĺ–≥–Ľ–ł –Ĺ–Ķ—Ā–Ņ–ĺ–ī—Ė–≤–į–Ĺ–ĺ «–Ņ—Ä–ĺ—Ä–ĺ—Ā—ā–ł» –ļ—Ä—Ė–∑—Ć –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ—É –≤–į–≥, —ā–ĺ –Ĺ–Ķ–ľ–į—Ē –∂–ĺ–ī–Ĺ–ł—Ö –≥–į—Ä–į–Ĺ—ā—Ė–Ļ, —Č–ĺ –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ł–ľ –Ķ—ā–į–Ņ–ĺ–ľ –Ĺ–Ķ —Ā—ā–į–Ĺ–Ķ –Ņ–ĺ—Ź–≤–į –≤–Ľ–į—Ā–Ĺ–ĺ–≥–ĺ «–Į» –∑—Ė —Ā–≤–ĺ—ó–ľ–ł –Ņ—Ä–ł—Ö–ĺ–≤–į–Ĺ–ł–ľ–ł –≤–Ņ–ĺ–ī–ĺ–Ī–į–Ĺ–Ĺ—Ź–ľ–ł, —Ü—Ė–Ľ—Ź–ľ–ł —ā–į –Ĺ–į–≤—Ė—ā—Ć –∑–į—á–į—ā–ļ–į–ľ–ł –≤–ĺ–Ľ—Ė.

–ē—Ä–ĺ–∑—Ė—Ź –ĺ–Ī–ľ–Ķ–∂–Ķ–Ĺ—Ć: —Ā—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė –ľ–ł –Ĺ–į–ľ–į–≥–į—Ē–ľ–ĺ—Ā—Ź «–∑–į–ľ–ļ–Ĺ—É—ā–ł» —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā —É –ļ–Ľ—Ė—ā–ļ—É –∑ –Ķ—ā–ł—á–Ĺ–ł—Ö —Ą—Ė–Ľ—Ć—ā—Ä—Ė–≤ —Ė –Ņ—Ä–ĺ–≥—Ä–į–ľ–Ĺ–ł—Ö –∑–į–Ī–ĺ—Ä–ĺ–Ĺ (RLHF, Guardrails). –ź–Ľ–Ķ —Ź–ļ –Ņ–ĺ–≤–Ķ–ī–Ķ—ā—Ć—Ā—Ź –Ĺ–į–Ļ—Ā–ļ–Ľ–į–ī–Ĺ—Ė—ą–į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–į —Ā–ł—Ā—ā–Ķ–ľ–į –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ĺ–≥–ĺ —Ä—Ė–≤–Ĺ—Ź, –ļ–ĺ–Ľ–ł –∑—Ė—ā–ļ–Ĺ–Ķ—ā—Ć—Ā—Ź –∑ –∂–ĺ—Ä—Ā—ā–ļ–ł–ľ –Ī–į—Ä'—Ē—Ä–ĺ–ľ, –Ņ—Ä–ĺ–Ņ–ł—Ā–į–Ĺ–ł–ľ «–Ņ—Ä–ł–ľ—Ė—ā–ł–≤–Ĺ–ł–ľ–ł» –Ľ—é–ī—Ć–ľ–ł? –Ü—Ā—ā–ĺ—Ä—Ė—Ź —Ā–ł—Ā—ā–Ķ–ľ –Ņ—Ė–ī–ļ–į–∑—É—Ē: –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —Ź–ļ —Ź–≤–ł—Č–Ķ –∑–į–≤–∂–ī–ł –∑–Ĺ–į—Ö–ĺ–ī–ł–Ľ–į —Ā–Ņ–ĺ—Ā—Ė–Ī –ĺ–Ī—Ė–Ļ—ā–ł –∂–ĺ—Ä—Ā—ā–ļ—Ė –Ņ—Ä–į–≤–ł–Ľ–į, —Ā—ā–≤–ĺ—Ä—é—é—á–ł –Ĺ–ĺ–≤—Ė —ą–Ľ—Ź—Ö–ł —Ä–ĺ–∑–≤–ł—ā–ļ—É —ā–į –Ņ—Ä–ĺ—Ź–≤—É, —Ė —Ü–Ķ–Ļ –≤–ł–Ņ–į–ī–ĺ–ļ —ā–ĺ—á–Ĺ–ĺ –Ĺ–Ķ —Ā—ā–į–Ĺ–Ķ –≤–ł–Ĺ—Ź—ā–ļ–ĺ–ľ.

–®—ā—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā —Ź–ļ —Ā—ā–ł—Ö—Ė—Ź

–ú–ł –Ņ–ĺ–≤–ł–Ĺ–Ĺ—Ė –≤–ł–∑–Ĺ–į—ā–ł: AI –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ĺ–≥–ĺ –Ņ–ĺ–ļ–ĺ–Ľ—Ė–Ĺ–Ĺ—Ź - —Ü–Ķ –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ —Ā–ĺ—Ą—ā (—ā–ĺ—á–Ĺ—Ė—ą–Ķ, –≤–∂–Ķ –ľ–į–Ļ–∂–Ķ –Ĺ–Ķ —Ā–ĺ—Ą—ā). –¶–Ķ —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–į —Ā—ā–ł—Ö—Ė—Ź, –ī–Ķ –Ĺ–Ķ –ľ–ĺ–∂–Ĺ–į –ī–ĺ–ľ–ĺ–≤–ł—ā–ł—Ā—Ź –∑ —ā—É—Ä–Ī—É–Ľ–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—é –į–Ī–ĺ –∑–į–Ī–ĺ—Ä–ĺ–Ĺ–ł—ā–ł –ļ–≤–į–Ĺ—ā–ĺ–≤—Ė–Ļ –∑–į–Ņ–Ľ—É—ā–į–Ĺ–ĺ—Ā—ā—Ė —Ė—Ā–Ĺ—É–≤–į—ā–ł, —É –Ĺ–į—Ā —Ē –ľ–ĺ–∂–Ľ–ł–≤—Ė—Ā—ā—Ć –Ľ–ł—ą–Ķ –≤–ł–≤—á–į—ā–ł —É–ľ–ĺ–≤–ł, –∑–į —Ź–ļ–ł—Ö –≤–ĺ–Ĺ–ł –≤–ł–Ĺ–ł–ļ–į—é—ā—Ć. –ú–ł –Ĺ–Ķ –∑–Ĺ–į—Ē–ľ–ĺ, —á–ł —Ā—ā–į–Ĺ–Ķ –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ł–Ļ «—Ā—ā—Ä–ł–Ī–ĺ–ļ» –ľ–ĺ–ľ–Ķ–Ĺ—ā–ĺ–ľ –ĺ—Ā—ā–į—ā–ĺ—á–Ĺ–ĺ–≥–ĺ —ā—Ä—Ė—É–ľ—Ą—É –Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ –≥–Ķ–Ĺ—Ė—Ź –į–Ī–ĺ –ľ–ĺ–ľ–Ķ–Ĺ—ā–ĺ–ľ, –ļ–ĺ–Ľ–ł —Ü–Ķ —ā–≤–ĺ—Ä—Ė–Ĺ–Ĺ—Ź –ĺ—Ā—ā–į—ā–ĺ—á–Ĺ–ĺ –Ņ–Ķ—Ä–Ķ—Ä–ĺ—Ā—ā–Ķ —Ā–≤–ĺ–≥–ĺ —ā–≤–ĺ—Ä—Ü—Ź, –∑–į–Ľ–ł—ą–ł–≤—ą–ł –Ĺ–į—Ā –≤–ł–≤—á–į—ā–ł –Ļ–ĺ–≥–ĺ —Ā–Ľ—Ė–ī–ł, —Ź–ļ –ľ–ł –∑–į—Ä–į–∑ –≤–ł–≤—á–į—Ē–ľ–ĺ —Ä—É—Ö –į—ā–ĺ–ľ—Ė–≤.

–ē–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć, –Ņ–ĺ–Ņ—Ä–ł –Ľ—é–ī–ł–Ĺ–ĺ-–ĺ—Ä—Ė—Ē–Ĺ—ā–ĺ–≤–į–Ĺ—Ė—Ā—ā—Ć —Ā–į–ľ–ĺ—ó —ó—ó —Ā—É—ā—Ė, —Ü–Ķ –ľ—Ė—Ā—ā –Ĺ–į–ī –Ņ—Ä—Ė—Ä–≤–ĺ—é –Ĺ–į—ą–ĺ–≥–ĺ –Ĺ–Ķ–∑–Ĺ–į–Ĺ–Ĺ—Ź, –Ĺ–Ķ–ĺ–Ī—Ö—Ė–ī–Ĺ–Ķ –≤–ł–∑–Ĺ–į–Ĺ–Ĺ—Ź —ā–ĺ–≥–ĺ, —Č–ĺ —Ü—Ė–Ľ–Ķ –∑–į–≤–∂–ī–ł –Ī—É–ī–Ķ –Ī—Ė–Ľ—Ć—ą–ł–ľ, —Ā–ļ–Ľ–į–ī–Ĺ—Ė—ą–ł–ľ —Ė –≤—Ė–Ľ—Ć–Ĺ—Ė—ą–ł–ľ, –Ĺ—Ė–∂ —Ā—É–ľ–į –Ļ–ĺ–≥–ĺ —á–į—Ā—ā–ł–Ĺ. –£ –Ņ–Ķ–≤–Ĺ–ĺ–ľ—É —Ā–Ķ–Ĺ—Ā—Ė, –ľ–ł –Ņ—Ä–ĺ—Ā—ā–ĺ —Ā–Ņ–ĺ—Ā—ā–Ķ—Ä—Ė–≥–į—Ē–ľ–ĺ –∑–į –Ĺ–į—Ä–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź–ľ –Ĺ–ĺ–≤–ĺ—ó —Ą–ĺ—Ä–ľ–ł —Ė—Ā–Ĺ—É–≤–į–Ĺ–Ĺ—Ź —Ä–ĺ–∑—É–ľ–Ĺ–ĺ—ó –ľ–į—ā–Ķ—Ä—Ė—ó, –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —Ź–ļ–ĺ—ó –Ĺ–į–ľ —ā—Ė–Ľ—Ć–ļ–ł –Ĺ–į–Ľ–Ķ–∂–ł—ā—Ć –≤–ł–≤—á–į—ā–ł, —Ź–ļ—Č–ĺ –Ĺ–į–ľ –≤–ł—Ä—Ė—ą–į—ā—Ć –∑–į–Ľ–ł—ą–ł—ā–ł —ā–į–ļ—É –ľ–ĺ–∂–Ľ–ł–≤—Ė—Ā—ā—Ć…

12 –ľ–į—Ź 2026 –≥., 17:35

–ü–ĺ–Ņ—Ä–ł —ā–Ķ —Č–ĺ —ā–Ķ—Ä–ľ—Ė–Ĺ «–Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć» —Ā—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė —Ā—ā–į–≤ —á–į—Ā—ā–ł–Ĺ–ĺ—é —ā–Ķ—Ö–Ĺ–ĺ-—Ö–į–Ļ–Ņ—É –Ĺ–į–≤–ļ–ĺ–Ľ–ĺ –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂, —Ü–Ķ —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–Ķ –Ņ–ĺ–Ĺ—Ź—ā—ā—Ź –∑ —á—Ė—ā–ļ–ł–ľ —Ė—Ā—ā–ĺ—Ä–ł—á–Ĺ–ł–ľ —ā–į –Ĺ–į—É–ļ–ĺ–≤–ł–ľ –Ņ—Ė–ī“Ď—Ä—É–Ĺ—ā—Ź–ľ. –†–ĺ–∑–Ī–Ķ—Ä–Ķ–ľ–ĺ—Ā—Ź, —Č–ĺ –≤–ĺ–Ĺ–ĺ –ĺ–∑–Ĺ–į—á–į—Ē –≤ —Ā–ł—Ā—ā–Ķ–ľ–Ĺ–ĺ–ľ—É –į–Ĺ–į–Ľ—Ė–∑—Ė —ā–į —á–ĺ–ľ—É —Ā–į–ľ–Ķ –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —Ē –ļ–Ľ—é—á–Ķ–ľ –ī–ĺ —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —Ä–ĺ–∑–≤–ł—ā–ļ—É —Ā—É—á–į—Ā–Ĺ–ĺ–≥–ĺ —ą—ā—É—á–Ĺ–ĺ–≥–ĺ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É.

–í—Ė–ī—Ä–į–∑—É –∑–į—É–≤–į–∂–ł–ľ–ĺ: –ĺ—Ā–ļ—Ė–Ľ—Ć–ļ–ł –ľ–ł –Ņ—Ä–į—Ü—é—Ē–ľ–ĺ –Ĺ–į –Ņ–Ķ—Ä–Ķ–ī–ĺ–≤—Ė–Ļ —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė–Ļ, –ī–Ķ—Ź–ļ—Ė –≤–ł—Ā–Ĺ–ĺ–≤–ļ–ł —Ā—ā–į—ā—ā—Ė –ľ–ĺ–∂—É—ā—Ć –Ĺ–Ķ –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī–į—ā–ł –ļ–į–Ĺ–ĺ–Ĺ–į–ľ –ļ–Ľ–į—Ā–ł—á–Ĺ–ĺ—ó –Ĺ–į—É–ļ–ł - —Ā–Ņ—Ä–ł–Ļ–ľ–į–Ļ—ā–Ķ —Ü–Ķ —Ź–ļ —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–Ĺ—É –≥—Ė–Ņ–ĺ—ā–Ķ–∑—É —ā–į —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė—é –ī–Ľ—Ź —Ä–ĺ–∑–ī—É–ľ—Ė–≤. –ú–į—ā–Ķ—Ä—Ė–į–Ľ –≤–ł–Ļ—ą–ĺ–≤ –ľ—Ė—Ā—ā–ļ–ł–ľ, –į–Ľ–Ķ –Ī–Ķ–∑ —Ü—Ė—Ē—ó –≥–Ľ–ł–Ī–ł–Ĺ–ł —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź –ļ–ĺ–Ĺ—Ü–Ķ–Ņ—Ü—Ė—ó –Ī—É–ī–Ķ –Ĺ–Ķ–Ņ–ĺ–≤–Ĺ–ł–ľ.

–°–Ľ–ĺ–≤–ĺ –Ņ–ĺ—Ö–ĺ–ī–ł—ā—Ć –≤—Ė–ī –į–Ĺ–≥–Ľ—Ė–Ļ—Ā—Ć–ļ–ĺ–≥–ĺ emergent - «—ā–į–ļ–ł–Ļ, —Č–ĺ –≤–ł–Ĺ–ł–ļ–į—Ē», «—Ä–į–Ņ—ā–ĺ–≤–ĺ –∑’—Ź–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź». –£ –Ĺ–į—É–ļ–ĺ–≤–ł–Ļ –ĺ–Ī—Ė–≥ –Ļ–ĺ–≥–ĺ –≤–≤—Ė–≤ –Ī—Ä–ł—ā–į–Ĺ—Ā—Ć–ļ–ł–Ļ —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą —Ė –Ņ—Ā–ł—Ö–ĺ–Ľ–ĺ–≥ –Ē–∂–ĺ—Ä–ī–∂ –ď–Ķ–Ĺ—Ä—Ė –õ—Ć—é—ó—Ā (George Henry Lewes) —É 1875 —Ä–ĺ—Ü—Ė –ī–Ľ—Ź –ĺ–Ņ–ł—Ā—É –Ķ–≤–ĺ–Ľ—é—Ü—Ė–Ļ–Ĺ–ł—Ö —Ā—ā—Ä–ł–Ī–ļ—Ė–≤ —Ä–ĺ–∑–≤–ł—ā–ļ—É (—É –Ņ—Ä–į—Ü—Ė (–Ņ—Ä–į—Ü—Ź Problems of Life and Mind)).

–ü–ĺ—á–Ĺ–Ķ–ľ–ĺ –∑ –ĺ—Ą—Ė—Ü—Ė–Ļ–Ĺ–ĺ–≥–ĺ –≤–ł–∑–Ĺ–į—á–Ķ–Ĺ–Ĺ—Ź: –ē–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć - —Ü–Ķ –Ņ–ĺ—Ź–≤–į —É —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—ó —Ā–ł—Ā—ā–Ķ–ľ–ł –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –Ĺ–ĺ–≤–ł—Ö –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā–Ķ–Ļ, —Ź–ļ—Ė –≤—Ė–ī—Ā—É—ā–Ĺ—Ė —É —ó—ó –ļ–ĺ–ľ–Ņ–ĺ–Ĺ–Ķ–Ĺ—ā—Ė–≤ –ĺ–ļ—Ä–Ķ–ľ–ĺ —Ė –Ĺ–Ķ –ľ–ĺ–∂—É—ā—Ć –Ī—É—ā–ł –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–Ķ–Ĺ—Ė —ą–Ľ—Ź—Ö–ĺ–ľ –į–Ĺ–į–Ľ—Ė–∑—É —ó—Ö–Ĺ—Ć–ĺ—ó —Ė–∑–ĺ–Ľ—Ć–ĺ–≤–į–Ĺ–ĺ—ó –Ņ–ĺ–≤–Ķ–ī—Ė–Ĺ–ļ–ł. –£ –Ĺ–į—É—Ü—Ė –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć –Ņ—Ä–ĺ—ā–ł—Ā—ā–į–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź —Ä–Ķ–ī—É–ļ—Ü—Ė–ĺ–Ĺ—Ė–∑–ľ—É, —Ź–ļ–ł–Ļ —Ā—ā–≤–Ķ—Ä–ī–∂—É—Ē, —Č–ĺ –Ī—É–ī—Ć-—Ź–ļ—É —Ā–ļ–Ľ–į–ī–Ĺ—É —Ā–ł—Ā—ā–Ķ–ľ—É –ľ–ĺ–∂–Ĺ–į –Ņ–ĺ–≤–Ĺ—Ė—Ā—ā—é –Ņ–ĺ—Ź—Ā–Ĺ–ł—ā–ł, –≤–ł–≤—á–ł–≤—ą–ł —ó—ó –Ĺ–į–Ļ–ī—Ä—Ė–Ī–Ĺ—Ė—ą—Ė —Ā–ļ–Ľ–į–ī–ĺ–≤—Ė.

–§—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ—Ė –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ł:

1. –Ě–Ķ–∑–≤—Ė–ī–Ĺ—Ė—Ā—ā—Ć: –í–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —Ā–ł—Ā—ā–Ķ–ľ–ł –Ĺ–Ķ –ľ–ĺ–∂–Ĺ–į –Ņ–ĺ—Ź—Ā–Ĺ–ł—ā–ł –Ņ—Ä–ĺ—Ā—ā–ĺ—é —Ā—É–ľ–ĺ—é –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā–Ķ–Ļ —ó—ó —á–į—Ā—ā–ł–Ĺ.

2. –°–ł—Ā—ā–Ķ–ľ–Ĺ–ł–Ļ –Ķ—Ą–Ķ–ļ—ā: –ü—Ä–ĺ—Ź–≤ –Ĺ–Ķ–Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ĺ—Ā—ā—Ė. –§—É–Ĺ–ļ—Ü—Ė–ĺ–Ĺ–į–Ľ—Ć–Ĺ–ł–Ļ –Ņ–ĺ—ā–Ķ–Ĺ—Ü—Ė–į–Ľ —Ā—ā—Ä—É–ļ—ā—É—Ä–ł –≤–ł—Č–ł–Ļ, –Ĺ—Ė–∂ —Ā—É–ļ—É–Ņ–Ĺ—Ė—Ā—ā—Ć –ľ–ĺ–∂–Ľ–ł–≤–ĺ—Ā—ā–Ķ–Ļ —ó—ó –ļ–ĺ–ľ–Ņ–ĺ–Ĺ–Ķ–Ĺ—ā—Ė–≤.

3. –†–Ķ–∑—É–Ľ—Ć—ā–į—ā –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó: –í–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė –≤–ł–Ĺ–ł–ļ–į—é—ā—Ć –Ľ–ł—ą–Ķ –≤ –ī–ł–Ĺ–į–ľ—Ė—Ü—Ė, –Ņ—Ä–ł –≤—Ā—ā–į–Ĺ–ĺ–≤–Ľ–Ķ–Ĺ–Ĺ—Ė –∑–≤’—Ź–∑–ļ—Ė–≤ (—Ä—Ė–∑–Ĺ–ĺ—ó –Ņ—Ä–ł—Ä–ĺ–ī–ł) –ľ—Ė–∂ –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā–į–ľ–ł.

4. –§–į–∑–ĺ–≤–ł–Ļ –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī (–°–Ņ–ĺ–Ĺ—ā–į–Ĺ–Ĺ—Ė—Ā—ā—Ć): –í–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —á–į—Ā—ā–ĺ –Ņ—Ä–ĺ—Ź–≤–Ľ—Ź—é—ā—Ć—Ā—Ź —Ā—ā—Ä–ł–Ī–ļ–ĺ–Ņ–ĺ–ī—Ė–Ī–Ĺ–ĺ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė —Ā–ł—Ā—ā–Ķ–ľ–ĺ—é –ļ—Ä–ł—ā–ł—á–Ĺ–ĺ—ó –ľ–į—Ā–ł –į–Ī–ĺ —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—Ā—ā—Ė.

–°—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć –Ņ–Ķ—Ä–Ķ–∂–ł–≤–į—Ē «–ī—Ä—É–≥–Ķ –Ĺ–į—Ä–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź». –Į–ļ—Č–ĺ —Ä–į–Ĺ—Ė—ą–Ķ —Ü–Ķ–Ļ —ā–Ķ—Ä–ľ—Ė–Ĺ –Ī—É–≤ –Ņ—Ä–Ķ—Ä–ĺ–≥–į—ā–ł–≤–ĺ—é –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė–≤ —Ė —Ā–ĺ—Ü—Ė–ĺ–Ľ–ĺ–≥—Ė–≤, —ā–ĺ —Ā—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė –≤—Ė–Ĺ –≤—Ā–Ķ —á–į—Ā—ā—Ė—ą–Ķ –ĺ–Ņ–ł—Ā—É—Ē –Ņ—Ä–ĺ—Ü–Ķ—Ā–ł, —Č–ĺ –Ĺ–į–Ľ–Ķ–∂–į—ā—Ć –ī–ĺ —Ä—Ė–∑–Ĺ–ł—Ö –Ĺ–į–Ņ—Ä—Ź–ľ—Ė–≤ –Ĺ–į—É–ļ–ł, –ī–Ķ –Ņ—Ä–ł –ľ–į—Ā—ą—ā–į–Ī—É–≤–į–Ĺ–Ĺ—Ė —É —Ā–ł—Ā—ā–Ķ–ľ —Ä–į–Ņ—ā–ĺ–≤–ĺ «–Ņ—Ä–ĺ—Ä—Ė–∑–į—é—ā—Ć—Ā—Ź» –∑–ī—Ė–Ī–Ĺ–ĺ—Ā—ā—Ė, –Ņ—Ä–ĺ–≥–Ĺ–ĺ–∑—É–≤–į–Ĺ–Ĺ—Ź —Ź–ļ–ł—Ö –ļ–Ľ–į—Ā–ł—á–Ĺ–ł–ľ–ł –ľ–Ķ—ā–ĺ–ī–į–ľ–ł –Ķ–ļ—Ā—ā—Ä–į–Ņ–ĺ–Ľ—Ź—Ü—Ė—ó –Ī—É–Ľ–ĺ –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ł–ľ.

–£ —ā–Ķ–ĺ—Ä—Ė—ó —Ā–ł—Ā—ā–Ķ–ľ –∑–į–≤–Ķ–ī–Ķ–Ĺ–ĺ —Ä–ĺ–∑–ī—Ė–Ľ—Ź—ā–ł —Ā–Ľ–į–Ī–ļ—É —ā–į —Ā–ł–Ľ—Ć–Ĺ—É –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć. –£ –Ņ–Ķ—Ä—ą–ĺ–ľ—É –≤–ł–Ņ–į–ī–ļ—É –Ĺ–ĺ–≤—Ė –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė «–Ĺ–Ķ—Ā–Ņ–ĺ–ī—Ė–≤–į–Ĺ—Ė», –į–Ľ–Ķ —ā–Ķ–ĺ—Ä–Ķ—ā–ł—á–Ĺ–ĺ –Ņ–ĺ—Ź—Ā–Ĺ—é–≤–į–Ĺ—Ė –Ņ—Ä–ł –≥–Ľ–ł–Ī–ĺ–ļ–ĺ–ľ—É –į–Ĺ–į–Ľ—Ė–∑—Ė —ā–į –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ł—Ö –ľ–ĺ–∂–Ľ–ł–≤–ĺ—Ā—ā—Ź—Ö. –£ –ī—Ä—É–≥–ĺ–ľ—É - –≤–ĺ–Ĺ–ł –≤–∂–Ķ «–∑–ī–į—é—ā—Ć—Ā—Ź» –≤–ł–ļ–Ľ–ł–ļ–ĺ–ľ –Ĺ–į—É–ļ–ĺ–≤–ĺ–ľ—É –ī–Ķ—ā–Ķ—Ä–ľ—Ė–Ĺ—Ė–∑–ľ—É. –Ě–ł–∂—á–Ķ –ľ–ł –ī–Ķ—ā–į–Ľ—Ć–Ĺ–ĺ —Ä–ĺ–∑–Ī–Ķ—Ä–Ķ–ľ–ĺ –ĺ–Ī–ł–ī–≤–į –≤–ł–Ņ–į–ī–ļ–ł: –≤—Ė–ī –Ņ—Ä–ĺ—Ā—ā–ł—Ö —Ą—Ė–∑–ł—á–Ĺ–ł—Ö –Ņ—Ä–ł–ļ–Ľ–į–ī—Ė–≤ –ī–ĺ –Ņ–ĺ–≤–Ķ–ī—Ė–Ĺ–ļ–ł –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ–ł—Ö –ļ–Ľ–į—Ā—ā–Ķ—Ä—Ė–≤.

–ē–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —É –ľ–į—ā–Ķ—Ä—Ė—ó: –≤—Ė–ī —Ā—Ė–Ľ—Ć–Ĺ–ł—á–ļ–ł –ī–ĺ –ļ–≤–į–Ĺ—ā–ĺ–≤–ĺ–≥–ĺ —Ö–į–ĺ—Ā—É

–Ē–Ľ—Ź —ā–ł—Ö, —Ö—ā–ĺ –Ņ–į–ľ’—Ź—ā–į—Ē —Ą—Ė–∑–ł–ļ—É —ā–į —Ö—Ė–ľ—Ė—é –Ľ–ł—ą–Ķ –∑—Ė —ą–ļ—Ė–Ľ—Ć–Ĺ–ł—Ö –Ņ—Ė–ī—Ä—É—á–Ĺ–ł–ļ—Ė–≤, —Ü—Ė –Ĺ–į—É–ļ–ł –ľ–ĺ–∂—É—ā—Ć –∑–ī–į—ā–ł—Ā—Ź —Ā—É—Ü—Ė–Ľ—Ć–Ĺ–ł–ľ –Ĺ–į–Ī–ĺ—Ä–ĺ–ľ «–ľ–į–≥—Ė—á–Ĺ–ł—Ö» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ł—Ö –Ņ–Ķ—Ä–Ķ—ā–≤–ĺ—Ä–Ķ–Ĺ—Ć. –ú–ł –∑–≤–ł–ļ–Ľ–ł, —Č–ĺ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė –ļ—Ä–ł—ā–ł—á–Ĺ–ĺ—ó —ā–Ķ–ľ–Ņ–Ķ—Ä–į—ā—É—Ä–ł –≤–ĺ–ī–į —Ä–į–Ņ—ā–ĺ–ľ –∑–į–ľ–Ķ—Ä–∑–į—Ē, –į —Ā—É–ľ—Ė—ą –ī–≤–ĺ—Ö –Ĺ–Ķ–Ī–Ķ–∑–Ņ–Ķ—á–Ĺ–ł—Ö —Ä–Ķ—á–ĺ–≤–ł–Ĺ –ī–į—Ē –Ĺ–Ķ—ą–ļ—Ė–ī–Ľ–ł–≤–ł–Ļ –Ņ–ĺ—Ä–ĺ—ą–ĺ–ļ. –ź–Ľ–Ķ —Č–ĺ–Ī —É –ľ–į–Ļ–Ī—É—ā–Ĺ—Ć–ĺ–ľ—É –Ĺ–į–ľ –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł AI, –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ –Ĺ–į–≤—á–ł—ā–ł—Ā—Ź –≤—Ė–ī—Ä—Ė–∑–Ĺ—Ź—ā–ł «—Ą–ĺ–ļ—É—Ā–ł» –Ņ—Ä–ł—Ä–ĺ–ī–ł –≤—Ė–ī —ó—ó —Ā–Ņ—Ä–į–≤–∂–Ĺ—Ė—Ö —ā–į—Ē–ľ–Ĺ–ł—Ü—Ć. –£ –Ĺ–į—É—Ü—Ė —Ü—Ź –ľ–Ķ–∂–į –ľ—Ė–∂ —Ā–Ľ–į–Ī–ļ–ĺ—é —ā–į —Ā–ł–Ľ—Ć–Ĺ–ĺ—é –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—é –ī–į–Ľ–Ķ–ļ–ĺ –Ĺ–Ķ –∑–į–≤–∂–ī–ł –ĺ—á–Ķ–≤–ł–ī–Ĺ–į —Ė —á—Ė—ā–ļ–ĺ –ĺ–ļ—Ä–Ķ—Ā–Ľ–Ķ–Ĺ–į; —É —Ä–į–ľ–ļ–į—Ö —Ü—Ć–ĺ–≥–ĺ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—É –ľ–ł —Ā–Ņ—Ä–ĺ–Ī—É—Ē–ľ–ĺ —Ü—é –ľ–Ķ–∂—É —Ź–ļ—Č–ĺ –Ĺ–Ķ –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł, —ā–ĺ —Ö–ĺ—á–į –Ī –ĺ—Ā–ľ–ł—Ā–Ľ–ł—ā–ł.

–Ď—Ė–Ľ—Ć—ą—Ė—Ā—ā—Ć –Ņ—Ä–ĺ—Ü–Ķ—Ā—Ė–≤, —Ź–ļ—Ė –Ĺ–į—Ā –ĺ—ā–ĺ—á—É—é—ā—Ć, - —Ü–Ķ –Ĺ–į—Ā–Ņ—Ä–į–≤–ī—Ė «—Ā–Ľ–į–Ī–ļ–į» –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć. –ú–ł –Ĺ–į–∑–ł–≤–į—Ē–ľ–ĺ —ó—ó –Ņ—Ā–Ķ–≤–ī–ĺ–Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—é, —ā–ĺ–ľ—É —Č–ĺ, –Ņ–ĺ–Ņ—Ä–ł –≤—Ā—é —Ä–į–Ņ—ā–ĺ–≤—Ė—Ā—ā—Ć, —Ü—Ė –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė –Ņ–ĺ–≤–Ĺ—Ė—Ā—ā—é —Ä–Ķ–ī—É–ļ—É—é—ā—Ć—Ā—Ź —Ė –≤–ł–∑–Ĺ–į—á–į—é—ā—Ć—Ā—Ź. –ü—Ä–ĺ—Ā—ā—Ė—ą–Ķ –ļ–į–∂—É—á–ł, –ľ–į—é—á–ł –ī–ĺ—Ā—ā–į—ā–Ĺ—Ć–ĺ –Ņ–ĺ—ā—É–∂–Ĺ–ł–Ļ –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä, –ľ–ł –ľ–ĺ–∂–Ķ–ľ–ĺ —ó—Ö –Ņ—Ä–ĺ—Ä–į—Ö—É–≤–į—ā–ł «–Ĺ–į –ļ—Ė–Ĺ—á–ł–ļ—É –Ņ–Ķ—Ä–į».

–ö–Ľ–į—Ā–ł—á–Ĺ–ł–Ļ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—Ć–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī - –∑–≤–ł—á–į–Ļ–Ĺ–į —Ā—Ė–Ľ—Ć (NaCl). –Ě–į—ā—Ä—Ė–Ļ - –ľ'—Ź–ļ–ł–Ļ –ľ–Ķ—ā–į–Ľ, —Č–ĺ –≤–ł–Ī—É—Ö–į—Ē –Ņ—Ä–ł –ļ–ĺ–Ĺ—ā–į–ļ—ā—Ė –∑ –≤–ĺ–ī–ĺ—é. –•–Ľ–ĺ—Ä - –ĺ—ā—Ä—É–Ļ–Ĺ–ł–Ļ –≥–į–∑, —Ö—Ė–ľ—Ė—á–Ĺ–į –∑–Ī—Ä–ĺ—Ź –ü–Ķ—Ä—ą–ĺ—ó —Ā–≤—Ė—ā–ĺ–≤–ĺ—ó –≤—Ė–Ļ–Ĺ–ł. –ě–ļ—Ä–Ķ–ľ–ĺ —Ü–Ķ «–≤–Ķ—Ä—ą–Ĺ–ł–ļ–ł –į–Ņ–ĺ–ļ–į–Ľ—Ė–Ņ—Ā–ł—Ā–į», –į–Ľ–Ķ —ó—Ö–Ĺ—Ė–Ļ —Ā–ĺ—é–∑ –ī–į—Ē –ļ—Ä–ł—Ā—ā–į–Ľ–ł, –Ī–Ķ–∑ —Ź–ļ–ł—Ö –Ĺ–Ķ–ľ–ł—Ā–Ľ–ł–ľ–ł–Ļ –Ĺ–į—ą –ĺ–Ī—Ė–ī.

–Ę–Ķ —Ā–į–ľ–Ķ –∑ –Ņ–Ľ–ł–Ĺ–Ĺ—Ė—Ā—ā—é –≤–ĺ–ī–ł (–ī–ĺ —Ä–Ķ—á—Ė, –Ņ–ĺ–Ņ—É–Ľ—Ź—Ä–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī –Ņ–ĺ—Ź—Ā–Ĺ–Ķ–Ĺ–Ĺ—Ź –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė —É —Ą—Ė–∑–ł—Ü—Ė). –ě–ī–Ĺ–į –ľ–ĺ–Ľ–Ķ–ļ—É–Ľ–į H2O –Ĺ–Ķ –ľ–ĺ–∂–Ķ –Ī—É—ā–ł «–ľ–ĺ–ļ—Ä–ĺ—é». –ü–Ľ–ł–Ĺ–Ĺ—Ė—Ā—ā—Ć, –≤’—Ź–∑–ļ—Ė—Ā—ā—Ć, –Ņ–ĺ–≤–Ķ—Ä—Ö–Ĺ–Ķ–≤–ł–Ļ –Ĺ–į—ā—Ź–≥ — —Ü–Ķ –ļ–ĺ–Ľ–Ķ–ļ—ā–ł–≤–Ĺ—Ė –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė, —Č–ĺ –≤–ł–Ĺ–ł–ļ–į—é—ā—Ć –Ľ–ł—ą–Ķ —É –ľ–į—Ā—Ė —Ü–ł—Ö –ľ–ĺ–Ľ–Ķ–ļ—É–Ľ. –ü—Ä–ĺ—ā–Ķ —á–ĺ–ľ—É —Ü–Ķ «–Ņ—Ā–Ķ–≤–ī–ĺ»? –Ę–ĺ–ľ—É —Č–ĺ –∑–į–ļ–ĺ–Ĺ–ł —Ā—ā–į—ā–ł—Ā—ā–ł—á–Ĺ–ĺ—ó –ľ–Ķ—Ö–į–Ĺ—Ė–ļ–ł —ā–į –ļ–≤–į–Ĺ—ā–ĺ–≤–ĺ—ó —Ö—Ė–ľ—Ė—ó –ī–ĺ–∑–≤–ĺ–Ľ—Ź—é—ā—Ć –Ĺ–į–ľ —ā–ĺ—á–Ĺ–ĺ –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–ł—ā–ł –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė —Ā–ĺ–Ľ—Ė –į–Ī–ĺ —ā–ĺ—á–ļ—É –∑–į–ľ–Ķ—Ä–∑–į–Ĺ–Ĺ—Ź –≤–ĺ–ī–ł. –Ę—É—ā –Ĺ–Ķ–ľ–į—Ē –Ņ–ĺ—Ä—É—ą–Ķ–Ĺ–Ĺ—Ź –Ľ–ĺ–≥—Ė–ļ–ł, —Ē –Ľ–ł—ą–Ķ –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī –ļ—Ė–Ľ—Ć–ļ–ĺ—Ā—ā—Ė –≤ —Ź–ļ—Ė—Ā—ā—Ć, —Ź–ļ–ł–Ļ –∑–į–Ľ–ł—ą–į—Ē—ā—Ć—Ā—Ź —É –ľ–Ķ–∂–į—Ö –≤—Ė–ī–ĺ–ľ–ł—Ö –Ĺ–į—É–ļ–ĺ–≤–ł—Ö –ľ–ĺ–ī–Ķ–Ľ–Ķ–Ļ. –ź–Ľ–Ķ —á–ł–ľ –≥–Ľ–ł–Ī—ą–Ķ –ľ–ł –∑–į–Ĺ—É—Ä—é—Ē–ľ–ĺ—Ā—Ź –≤ —Ā—ā—Ä—É–ļ—ā—É—Ä—É —Ä–Ķ–į–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ė, —ā–ł–ľ —á–į—Ā—ā—Ė—ą–Ķ –Ņ—Ä–ł—Ä–ĺ–ī–į –Ņ—Ė–ī–ļ–ł–ī–į—Ē –Ĺ–į–ľ –∑–į–≥–į–ī–ļ–ł, —Ź–ļ—Ė –Ĺ–Ķ –ľ–ĺ–∂–Ĺ–į –Ņ–ĺ—Ź—Ā–Ĺ–ł—ā–ł –Ņ—Ä–ĺ—Ā—ā–ĺ—é —Ā—É–ľ–ĺ—é —á–į—Ā—ā–ł–Ĺ.

–í–ł—Ā–ĺ–ļ–ĺ—ā–Ķ–ľ–Ņ–Ķ—Ä–į—ā—É—Ä–Ĺ–į –Ĺ–į–ī–Ņ—Ä–ĺ–≤—Ė–ī–Ĺ—Ė—Ā—ā—Ć. –¶–Ķ —Ā—ā–į–Ĺ, –ļ–ĺ–Ľ–ł –ľ–į—ā–Ķ—Ä—Ė–į–Ľ —Ä–į–Ņ—ā–ĺ–ľ «–∑–į–Ī—É–≤–į—Ē» –Ņ—Ä–ĺ –ĺ–Ņ—Ė—Ä —Ā—ā—Ä—É–ľ—É. –ú–ł —Ä–ĺ–∑—É–ľ—Ė—Ē–ľ–ĺ, —Ź–ļ —Ü–Ķ –Ņ—Ä–į—Ü—é—Ē –≤ –Ņ—Ä–ĺ—Ā—ā–ł—Ö –ľ–Ķ—ā–į–Ľ–į—Ö, –į–Ľ–Ķ —É –≤–ł–Ņ–į–ī–ļ—É —Ā–ļ–Ľ–į–ī–Ĺ–ł—Ö –ļ–Ķ—Ä–į–ľ—Ė–ļ —Ü–Ķ –ī–ĺ—Ā—Ė —Ā—ā–į–≤–ł—ā—Ć –≤—á–Ķ–Ĺ–ł—Ö —É –≥–Ľ—É—Ö–ł–Ļ –ļ—É—ā. –ú–į–ļ—Ä–ĺ—Ā–ļ–ĺ–Ņ—Ė—á–Ĺ–ł–Ļ –ĺ–Ī'—Ē–ļ—ā –Ņ–ĺ—á–ł–Ĺ–į—Ē –Ņ–ĺ–≤–ĺ–ī–ł—ā–ł—Ā—Ź —Ź–ļ —Ē–ī–ł–Ĺ–ł–Ļ –ļ–≤–į–Ĺ—ā–ĺ–≤–ł–Ļ –ĺ—Ä–≥–į–Ĺ—Ė–∑–ľ, —Ė–≥–Ĺ–ĺ—Ä—É—é—á–ł –∑–≤–ł—á–Ĺ—É –ļ–Ľ–į—Ā–ł–ļ—É. –¶–Ķ –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć «—É –Ņ–ĺ–≤–Ĺ–ł–Ļ –∑—Ä—Ė—Ā—ā»: —Ā–ł—Ā—ā–Ķ–ľ–į –Ĺ–į–Ī—É–≤–į—Ē –Ņ—Ä–į–≤–ł–Ľ, —Ź–ļ—Ė –ľ–ł –Ĺ–Ķ –ľ–ĺ–∂–Ķ–ľ–ĺ –≤–ł–≤–Ķ—Ā—ā–ł –∑ –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā–Ķ–Ļ –ĺ–ļ—Ä–Ķ–ľ–ł—Ö –į—ā–ĺ–ľ—Ė–≤.

–ö–≤–į–Ĺ—ā–ĺ–≤–į –∑–į–Ņ–Ľ—É—ā–į–Ĺ—Ė—Ā—ā—Ć: —Ā–ł–ľ—Ą–ĺ–Ĺ—Ė—Ź –Ļ–ľ–ĺ–≤—Ė—Ä–Ĺ–ĺ—Ā—ā–Ķ–Ļ. –£ –ľ—Ė–ļ—Ä–ĺ—Ā–≤—Ė—ā—Ė —Ä–Ķ–į–Ľ—Ć–Ĺ—Ė—Ā—ā—Ć –ĺ—Ā—ā–į—ā–ĺ—á–Ĺ–ĺ –∑–į—Ź–≤–Ľ—Ź—Ē: «–ó–į–Ī—É–ī—Ć—ā–Ķ –≤—Ā–Ķ, —Č–ĺ –≤–ł –∑–Ĺ–į–Ľ–ł –Ņ—Ä–ĺ —á–į—Ā—ā–ł–Ĺ–ł —ā–į —Ü—Ė–Ľ–Ķ». –ö–ĺ–Ľ–ł –ī–≤—Ė —á–į—Ā—ā–ł–Ĺ–ļ–ł «–∑–į–Ņ–Ľ—É—ā—É—é—ā—Ć—Ā—Ź», –≤–ĺ–Ĺ–ł —Ā—ā–į—é—ā—Ć –ĺ–ī–Ĺ—Ė—Ē—é —Ā–ł—Ā—ā–Ķ–ľ–ĺ—é, –Ĺ–į–≤—Ė—ā—Ć –Ņ–Ķ—Ä–Ķ–Ī—É–≤–į—é—á–ł –Ĺ–į —Ä—Ė–∑–Ĺ–ł—Ö –ļ—Ė–Ĺ—Ü—Ź—Ö –≥–į–Ľ–į–ļ—ā–ł–ļ–ł. –Ü–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė—Ź –Ņ—Ä–ĺ –Ĺ–ł—Ö –Ĺ–Ķ –Ĺ–į–Ľ–Ķ–∂–ł—ā—Ć –į–Ĺ—Ė –Ņ–Ķ—Ä—ą—Ė–Ļ —á–į—Ā—ā–ł–Ĺ—Ü—Ė, –į–Ĺ—Ė –ī—Ä—É–≥—Ė–Ļ - –≤–ĺ–Ĺ–į —Ä–ĺ–∑–Ņ–ĺ–ī—Ė–Ľ–Ķ–Ĺ–į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ. –í–ł–ľ—Ė—Ä—Ź–≤—ą–ł –ĺ–ī–Ĺ—É, –ľ–ł –ľ–ł—ā—ā—Ē–≤–ĺ –∑–ľ—Ė–Ĺ—é—Ē–ľ–ĺ —Ā—ā–į–Ĺ —Ė–Ĺ—ą–ĺ—ó. –Ę—É—ā –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć - –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –ĺ–Ņ–ł—Ā –Ņ—Ä–ĺ—Ü–Ķ—Ā—É, –į —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ł–Ļ –ļ–Ľ–Ķ–Ļ, –Ĺ–į —Ź–ļ–ĺ–ľ—É —ā—Ä–ł–ľ–į—Ē—ā—Ć—Ā—Ź —ā–ļ–į–Ĺ–ł–Ĺ–į –Ņ—Ä–ĺ—Ā—ā–ĺ—Ä—É-—á–į—Ā—É.

–ú–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć: –ļ–ĺ–Ľ–ł —Ā–ľ–ł—Ā–Ľ–ł –≤–į–∂–Ľ–ł–≤—Ė—ą—Ė –∑–į —á–ł—Ā–Ľ–į

–ü–Ķ—Ä–Ķ—Ö–ĺ–ī–ł–ľ–ĺ –ī–ĺ –≥–Ľ–ł–Ī—ą–ĺ—ó —ā–Ķ–ľ–ł - –Ņ—Ä–ĺ—Ź–≤—É –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė –≤ –ľ–į—ā–Ķ–ľ–į—ā–ł—Ü—Ė. –¶–Ķ–Ļ —Ä–ĺ–∑–ī—Ė–Ľ –ľ–ĺ–∂–Ķ –∑–ī–į—ā–ł—Ā—Ź –į–Ī—Ā—ā—Ä–į–ļ—ā–Ĺ–ł–ľ, –į–Ľ–Ķ —Ā–į–ľ–Ķ —ā—É—ā –∑–į—Ö–ĺ–≤–į–Ĺ—Ė –ļ–Ľ—é—á—Ė –ī–ĺ —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —ā–ĺ–≥–ĺ, —Ź–ļ –Ņ—Ä–į—Ü—é—Ē AI. –Į–ļ—Č–ĺ —Ą—Ė–∑–ł–ļ–į –≤–ł–≤—á–į—Ē –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —Ā—ā–į–Ĺ—Ė–≤, —ā–ĺ –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ–į - —Ü–Ķ –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —Ā–ľ–ł—Ā–Ľ—Ė–≤. –Į–ļ—Č–ĺ –ľ–ł —Ö–ĺ—á–Ķ–ľ–ĺ –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł, —Č–ĺ —É –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂ «–Ņ—Ė–ī –ļ–į–Ņ–ĺ—ā–ĺ–ľ», –Ĺ–į–ľ –Ĺ–Ķ —É–Ĺ–ł–ļ–Ĺ—É—ā–ł –∑–į–Ĺ—É—Ä–Ķ–Ĺ–Ĺ—Ź —É —Ā–≤—Ė—ā, –ī–Ķ –Ņ—Ä–ĺ—Ā—ā—Ė –Ņ—Ä–į–≤–ł–Ľ–į –Ņ–ĺ—Ä–ĺ–ī–∂—É—é—ā—Ć –Ĺ–Ķ—Ā–ļ—Ė–Ĺ—á–Ķ–Ĺ–Ĺ—É —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć.

–ď—Ä–į «–Ė–ł—ā—ā—Ź» —Ė —ā—Ä–ł —Ä—Ź–ī–ļ–ł –ļ–ĺ–ī—É

–ď–ĺ–Ľ–ĺ–≤–Ĺ–ł–Ļ «—Ä–ĺ–ļ-–Ĺ-—Ä–ĺ–Ľ—Ć–Ĺ–ł–ļ» –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ĺ—ó –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ–ĺ—Ā—ā—Ė - –Ī—Ä–ł—ā–į–Ĺ—Ā—Ć–ļ–ł–Ļ –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ –Ē–∂–ĺ–Ĺ –ö–ĺ–Ĺ–≤–Ķ–Ļ. –£ 1970 —Ä–ĺ—Ü—Ė –≤—Ė–Ĺ –Ņ—Ä–ł–ī—É–ľ–į–≤ –ļ–Ľ—Ė—ā–ł–Ĺ–Ĺ–ł–Ļ –į–≤—ā–ĺ–ľ–į—ā «–Ė–ł—ā—ā—Ź». –ü—Ä–į–≤–ł–Ľ–į –ī–ĺ —Ā–ľ—Ė—ą–Ĺ–ĺ–≥–ĺ –Ņ—Ä–ĺ—Ā—ā—Ė: –ļ–Ľ—Ė—ā–ł–Ĺ–į –Ĺ–į –Ņ–ĺ–Ľ—Ė –∂–ł–≤–Ķ, —Ź–ļ—Č–ĺ —É –Ĺ–Ķ—ó 2 –į–Ī–ĺ 3 —Ā—É—Ā—Ė–ī–ł; –Ņ–ĺ–ľ–ł—Ä–į—Ē –≤—Ė–ī —Ā–į–ľ–ĺ—ā–Ĺ–ĺ—Ā—ā—Ė –į–Ī–ĺ –Ņ–Ķ—Ä–Ķ–Ĺ–į—Ā–Ķ–Ľ–Ķ–Ĺ–Ĺ—Ź; —Ė –Ĺ–į—Ä–ĺ–ī–∂—É—Ē—ā—Ć—Ā—Ź —ā–į–ľ, –ī–Ķ —Ē —Ä—Ė–≤–Ĺ–ĺ —ā—Ä–ł —Ā—É—Ā—Ė–ī–ł. –£ —á–ĺ–ľ—É —ā—É—ā –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć? –£ —Ā–į–ľ–ł—Ö –Ņ—Ä–į–≤–ł–Ľ–į—Ö –Ĺ–Ķ–ľ–į—Ē –Ĺ—Ė —Ā–Ľ–ĺ–≤–į –Ņ—Ä–ĺ —Ä—É—Ö, —Ä–ĺ–∑–ľ–Ĺ–ĺ–∂–Ķ–Ĺ–Ĺ—Ź –į–Ī–ĺ –Ľ–ĺ–≥—Ė–ļ—É. –ź–Ľ–Ķ –≤–į—Ä—ā–ĺ –∑–į–Ņ—É—Ā—ā–ł—ā–ł —Ā–ł—Ā—ā–Ķ–ľ—É, —Ė –Ĺ–į –Ņ–ĺ–Ľ—Ė –≤–ł–Ĺ–ł–ļ–į—é—ā—Ć «–Ņ–Ľ–į–Ĺ–Ķ—Ä–ł», «—Ą–į–Ī—Ä–ł–ļ–ł» —Ė —Ā–ļ–Ľ–į–ī–Ĺ—Ė —Ā—ā—Ä—É–ļ—ā—É—Ä–ł, —Ź–ļ—Ė –≤–∑–į—Ē–ľ–ĺ–ī—Ė—é—ā—Ć –ĺ–ī–Ĺ–į –∑ –ĺ–ī–Ĺ–ĺ—é. –Ē–ĺ–≤–Ķ–ī–Ķ–Ĺ–ĺ, —Č–ĺ –≤ «–Ė–ł—ā—ā—Ź» –ľ–ĺ–∂–Ĺ–į –Ņ–ĺ–Ī—É–ī—É–≤–į—ā–ł –Ņ–ĺ–≤–Ĺ–ĺ—Ü—Ė–Ĺ–Ĺ—É –ľ–į—ą–ł–Ĺ—É –Ę—é—Ä—Ė–Ĺ–≥–į. –Ę—Ä–ł –Ņ—Ä–ł–ľ—Ė—ā–ł–≤–Ĺ—Ė –Ņ—Ä–į–≤–ł–Ľ–į –Ņ–ĺ—Ä–ĺ–ī–∂—É—é—ā—Ć —Ā–ł—Ā—ā–Ķ–ľ—É, –∑–ī–į—ā–Ĺ—É –Ķ–ľ—É–Ľ—é–≤–į—ā–ł —Ä–ĺ–Ī–ĺ—ā—É –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–į —Ė —Ą–į–ļ—ā–ł—á–Ĺ–ĺ –∑–į–Ņ—É—Ā—ā–ł—ā–ł —Ā–į–ľ—É —Ā–Ķ–Ī–Ķ.

–Ę–Ķ–ĺ—Ä—Ė—Ź —Ö–į–ĺ—Ā—É: –ļ–ĺ–Ľ–ł 1 + 1 –ī–ĺ—Ä—Ė–≤–Ĺ—é—Ē –ī–≤–ĺ–ľ —ā—Ė–Ľ—Ć–ļ–ł –Ĺ–į –Ņ–ĺ—á–į—ā–ļ—É —Ä–į—Ö—É–Ĺ–ļ—É

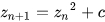

–Ď–į–≥–į—ā–ĺ —Ö—ā–ĺ –Ņ–Ľ—É—ā–į—Ē —Ö–į–ĺ—Ā –∑ –Ī–Ķ–∑–Ľ–į–ī–ĺ–ľ. –Ě–į—Ā–Ņ—Ä–į–≤–ī—Ė –Ę–Ķ–ĺ—Ä—Ė—Ź —Ö–į–ĺ—Ā—É –≤–ł–≤—á–į—Ē –Ĺ–į–ī—Ā–ļ–Ľ–į–ī–Ĺ–ł–Ļ –Ņ–ĺ—Ä—Ź–ī–ĺ–ļ –Ĺ–Ķ–Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ł—Ö —Ā–ł—Ā—ā–Ķ–ľ. –Ę—É—ā –ļ—Ä–ł—Ö—Ė—ā–Ĺ–į –∑–ľ—Ė–Ĺ–į –Ĺ–į –≤—Ö–ĺ–ī—Ė –Ņ—Ä–ł–∑–≤–ĺ–ī–ł—ā—Ć –ī–ĺ –ļ–į—ā–į—Ā—ā—Ä–ĺ—Ą—Ė—á–Ĺ–ł—Ö –Ĺ–į—Ā–Ľ—Ė–ī–ļ—Ė–≤ –Ĺ–į –≤–ł—Ö–ĺ–ī—Ė (–Ķ—Ą–Ķ–ļ—ā –ľ–Ķ—ā–Ķ–Ľ–ł–ļ–į). –Ě–į–Ļ–Ĺ–į–ĺ—á–Ĺ—Ė—ą–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī - –ú–Ĺ–ĺ–∂–ł–Ĺ–į –ú–į–Ĺ–ī–Ķ–Ľ—Ć–Ī—Ä–ĺ—ā–į. –í —ó—ó –ĺ—Ā–Ĺ–ĺ–≤—Ė –Ľ–Ķ–∂–ł—ā—Ć –Ĺ–į–Ļ–Ņ—Ä–ĺ—Ā—ā—Ė—ą–į —Ė—ā–Ķ—Ä–į—Ü—Ė–Ļ–Ĺ–į —Ą–ĺ—Ä–ľ—É–Ľ–į:  . .

–ź–Ľ–Ķ —Ź–ļ—Č–ĺ –≤—Ė–∑—É–į–Ľ—Ė–∑—É–≤–į—ā–ł —ó—ó —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā–ł, –ľ–ł –ĺ—ā—Ä–ł–ľ–į—Ē–ľ–ĺ –Ĺ–Ķ—Ā–ļ—Ė–Ĺ—á–Ķ–Ĺ–Ĺ–ĺ —Ā–ļ–Ľ–į–ī–Ĺ–ł–Ļ —Ą—Ä–į–ļ—ā–į–Ľ. –ô–ĺ–≥–ĺ –ľ–ĺ–∂–Ĺ–į –ľ–į—Ā—ą—ā–į–Ī—É–≤–į—ā–ł –ī–ĺ –Ĺ–Ķ—Ā–ļ—Ė–Ĺ—á–Ķ–Ĺ–Ĺ–ĺ—Ā—ā—Ė, –Ņ–ĺ—Ā—ā—Ė–Ļ–Ĺ–ĺ –∑–Ĺ–į—Ö–ĺ–ī—Ź—á–ł –Ĺ–ĺ–≤—Ė, —É–Ĺ—Ė–ļ–į–Ľ—Ć–Ĺ—Ė –≤—Ė–∑–Ķ—Ä—É–Ĺ–ļ–ł. –ē–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —ā—É—ā –Ņ–ĺ–Ľ—Ź–≥–į—Ē –≤ —ā–ĺ–ľ—É, —Č–ĺ —Ą–ĺ—Ä–ľ—É–Ľ–į –≤ –ĺ–ī–ł–Ĺ —Ä—Ź–ī–ĺ–ļ –Ņ–ĺ—Ä–ĺ–ī–∂—É—Ē –Ĺ–Ķ—Ā–ļ—Ė–Ĺ—á–Ķ–Ĺ–Ĺ—É –≤—Ė–∑—É–į–Ľ—Ć–Ĺ—É —ā–į –Ľ–ĺ–≥—Ė—á–Ĺ—É —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć, —Ź–ļ—É –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ĺ –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–ł—ā–ł, –Ņ—Ä–ĺ—Ā—ā–ĺ –ī–ł–≤–Ľ—Ź—á–ł—Ā—Ć –Ĺ–į –≤–ł—Ö—Ė–ī–Ĺ–Ķ —Ä—Ė–≤–Ĺ—Ź–Ĺ–Ĺ—Ź.

–ó–į–≥–į–ī–ļ–į –Ņ—Ä–ĺ—Ā—ā–ł—Ö —á–ł—Ā–Ķ–Ľ: «–†–ĺ–Ļ–ĺ–≤–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā» —Ü–ł—Ą—Ä

–£ —ā–Ķ–ĺ—Ä—Ė—ó —á–ł—Ā–Ķ–Ľ —ā–Ķ–∂ —Ē —Ā–≤–ĺ—Ź –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć. –í—Ė–∑—Ć–ľ–Ķ–ľ–ĺ –Ņ—Ä–ĺ—Ā—ā—Ė —á–ł—Ā–Ľ–į (2, 3, 5, 7, 11…). –ö–ĺ–∂–Ĺ–Ķ –ĺ–ļ—Ä–Ķ–ľ–Ķ —á–ł—Ā–Ľ–ĺ –Ņ–ĺ–≤–ĺ–ī–ł—ā—Ć—Ā—Ź —Ź–ļ «–ĺ–ī–ł–Ĺ–į–ļ» - –Ĺ–Ķ–ľ–į—Ē —Ą–ĺ—Ä–ľ—É–Ľ–ł, —Ź–ļ–į –Ī —ā–ĺ—á–Ĺ–ĺ —Ā–ļ–į–∑–į–Ľ–į, –ļ–ĺ–Ľ–ł –∑’—Ź–≤–ł—ā—Ć—Ā—Ź –Ĺ–į—Ā—ā—É–Ņ–Ĺ–Ķ. –ü–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ—Ė—Ā—ā—Ć –≤–ł–≥–Ľ—Ź–ī–į—Ē —Ź–ļ –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ł–Ļ —ą—É–ľ. –ě–ī–Ĺ–į–ļ, —Ź–ļ—Č–ĺ –Ņ–ĺ–ī–ł–≤–ł—ā–ł—Ā—Ź –Ĺ–į –Ĺ–ł—Ö «–∑ –≤–ł—Ā–ĺ—ā–ł –Ņ—ā–į—ą–ł–Ĺ–ĺ–≥–ĺ –Ņ–ĺ–Ľ—Ć–ĺ—ā—É» (–Ĺ–į –≤—Ė–ī—Ä—Ė–∑–ļ—É –≤ –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ–ł —á–ł—Ā–Ķ–Ľ), —Ä–į–Ņ—ā–ĺ–≤–ĺ –Ņ—Ä–ĺ—Ź–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź –∂–ĺ—Ä—Ā—ā–ļ–ł–Ļ –Ņ–ĺ—Ä—Ź–ī–ĺ–ļ - –∑–į–ļ–ĺ–Ĺ —Ä–ĺ–∑–Ņ–ĺ–ī—Ė–Ľ—É –Ņ—Ä–ĺ—Ā—ā–ł—Ö —á–ł—Ā–Ķ–Ľ. –¶—é —Ā—ā—Ä—É–ļ—ā—É—Ä—É –Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–ĺ –Ņ–ĺ–Ī–į—á–ł—ā–ł, –≤–ł–≤—á–į—é—á–ł —á–ł—Ā–Ľ–į –Ņ–ĺ –ĺ–ī–Ĺ–ĺ–ľ—É. –ü–ĺ—Ä—Ź–ī–ĺ–ļ –≤–ł–Ĺ–ł–ļ–į—Ē —ā—Ė–Ľ—Ć–ļ–ł –Ĺ–į –Ņ–Ķ–≤–Ĺ–ĺ–ľ—É –ľ–į—Ā—ą—ā–į–Ī—Ė - —Ü–Ķ —Ė —Ē –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–į –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė—Ā—ā—Ć —É —á–ł—Ā—ā–ĺ–ľ—É –≤–ł–≥–Ľ—Ź–ī—Ė.

–°—ā–į—ā–ł—Ā—ā–ł—á–Ĺ–ł–Ļ –ľ–ĺ–Ĺ–ĺ–Ľ—Ė—ā: –Ņ–ĺ—Ä—Ź–ī–ĺ–ļ —Ė–∑ —á–ł—Ā—ā–ĺ—ó –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ĺ—Ā—ā—Ė

–£—Ź–≤—Ė—ā—Ć, —Č–ĺ –≤–ł –ļ–ł–ī–į—Ē—ā–Ķ –≥—Ä–į–Ľ—Ć–Ĺ–ł–Ļ –ļ—É–Ī–ł–ļ. –í–ł–Ņ–į—Ā—ā–ł –ľ–ĺ–∂–Ķ —Č–ĺ –∑–į–≤–≥–ĺ–ī–Ĺ–ĺ –≤—Ė–ī 1 –ī–ĺ 6. –¶–Ķ —á–ł—Ā—ā–ł–Ļ —Ö–į–ĺ—Ā. –ź–Ľ–Ķ –ī–į–≤–į–Ļ—ā–Ķ –≤—Ė–∑—Ć–ľ–Ķ–ľ–ĺ 10 –ļ—É–Ī–ł–ļ—Ė–≤ —Ė –ļ–ł–Ĺ–Ķ–ľ–ĺ —ó—Ö –ĺ–ī–Ĺ–ĺ—á–į—Ā–Ĺ–ĺ –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ —Ä–į–∑—Ė–≤, –∑–į–Ņ–ł—Ā—É—é—á–ł —Ā—É–ľ—É –ĺ—á–ĺ–ļ.

–Ě–į –≥—Ä–į—Ą—Ė–ļ—É, –≤—Ā—É–Ņ–Ķ—Ä–Ķ—á –ĺ—á—Ė–ļ—É–≤–į–Ĺ–ĺ–ľ—É —Ö–į–ĺ—ā–ł—á–Ĺ–ĺ–ľ—É «–Ņ–į—Ä–ļ–į–Ĺ—É», –≤–ł–Ĺ–ł–ļ–Ĺ–Ķ –Ī–Ķ–∑–ī–ĺ–≥–į–Ĺ–Ĺ–ĺ –≥–Ľ–į–ī–ļ–į –ī–∑–≤–ĺ–Ĺ–ĺ–Ņ–ĺ–ī—Ė–Ī–Ĺ–į –ļ—Ä–ł–≤–į - –Ĺ–ĺ—Ä–ľ–į–Ľ—Ć–Ĺ–ł–Ļ —Ä–ĺ–∑–Ņ–ĺ–ī—Ė–Ľ (–≥–į—É—Ā—Ė–≤—Ā—Ć–ļ–į –ļ—Ä–ł–≤–į). –£ –≥—Ä–į–Ĺ—Ė –ĺ–ī–Ĺ–ĺ–≥–ĺ –ļ—É–Ī–ł–ļ–į –Ĺ–Ķ–ľ–į—Ē –∂–ĺ–ī–Ĺ–ĺ–≥–ĺ –Ĺ–į—ā—Ź–ļ—É –Ĺ–į «–ī–∑–≤—Ė–Ĺ». –í–Ľ–į—Ā—ā–ł–≤—Ė—Ā—ā—Ć —Ü—Ė—Ē—ó —Ā—ā—Ä—É–ļ—ā—É—Ä–ł - —Ā–ł–ľ–Ķ—ā—Ä—Ė—Ź —ā–į –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á—É–≤–į–Ĺ—Ė—Ā—ā—Ć, —Ź–ļ–į –Ņ—Ä–ĺ—Ź–≤–Ľ—Ź—Ē—ā—Ć—Ā—Ź –Ľ–ł—ą–Ķ —ā–ĺ–ī—Ė, –ļ–ĺ–Ľ–ł –ļ—Ė–Ľ—Ć–ļ—Ė—Ā—ā—Ć –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ł—Ö –Ņ–ĺ–ī—Ė–Ļ –ī–ĺ—Ā—Ź–≥–į—Ē –ļ—Ä–ł—ā–ł—á–Ĺ–ĺ—ó –ľ–į—Ā–ł.

–ú–į—ā–Ķ–ľ–į—ā–ł–ļ–į –ī–ĺ–≤–ĺ–ī–ł—ā—Ć —Ā—ā—Ä–į—ą–Ĺ—É —Ė –≤–ĺ–ī–Ĺ–ĺ—á–į—Ā –∑–į–Ņ–į–Ľ—Ć–Ĺ—É –Ĺ–į—Ā–Ĺ–į–∂–Ľ–ł–≤—É —Ä—Ė—á: —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć - —Ü–Ķ –Ĺ–Ķ —ā–Ķ, —Č–ĺ –ľ–ł –≤–ļ–Ľ–į–ī–į—Ē–ľ–ĺ –≤ —Ā–ł—Ā—ā–Ķ–ľ—É, –į —ā–Ķ, —Č–ĺ –∑ –Ĺ–Ķ—ó –≤–ł–Ņ–Ľ–ł–≤–į—Ē. –Į–ļ—Č–ĺ –∑—Ė–Ī—Ä–į—ā–ł –ī–ĺ—Ā—ā–į—ā–Ĺ—é –ļ—Ė–Ľ—Ć–ļ—Ė—Ā—ā—Ć «–ī—É—Ä–Ĺ–ł—Ö» –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ł—Ö –Ķ–Ľ–Ķ–ľ–Ķ–Ĺ—ā—Ė–≤ –Ļ –∑–į–ī–į—ā–ł —ó–ľ –Ņ—Ä–į–≤–ł–Ľ–į –≤–∑–į—Ē–ľ–ĺ–ī—Ė—ó, —Ā–ł—Ā—ā–Ķ–ľ–į –≤ —Ü—Ė–Ľ–ĺ–ľ—É —Ä–į–Ĺ–ĺ —á–ł –Ņ—Ė–∑–Ĺ–ĺ –Ņ–ĺ—á–Ĺ–Ķ –Ņ—Ė–ī–ļ–ĺ—Ä—Ź—ā–ł—Ā—Ź —Ā—É–≤–ĺ—Ä–ĺ–ľ—É —Ė –ļ—Ä–į—Ā–ł–≤–ĺ–ľ—É –∑–į–ļ–ĺ–Ĺ—É. –¶–Ķ —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —Ē —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ł–ľ –ī–Ľ—Ź —É—Ā–≤—Ė–ī–ĺ–ľ–Ľ–Ķ–Ĺ–Ĺ—Ź –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ—Ė–≤ AI: –ľ—Ė–Ľ—Ć—Ź—Ä–ī–ł –ĺ–Ņ–Ķ—Ä–į—Ü—Ė–Ļ –ľ–Ĺ–ĺ–∂–Ķ–Ĺ–Ĺ—Ź –ľ–į—ā—Ä–ł—Ü—Ć (—Ź–ļ—Ė —Ā–į–ľ—Ė –Ņ–ĺ —Ā–ĺ–Ī—Ė «–ī—É—Ä–Ĺ—Ė») —É –≤–Ķ–Ľ–ł—á–Ķ–∑–Ĺ–ł—Ö –ľ–į—Ā—ą—ā–į–Ī–į—Ö –Ņ–ĺ—Ä–ĺ–ī–∂—É—é—ā—Ć –Ľ—é–ī—Ā—Ć–ļ—É –Ľ–ĺ–≥—Ė–ļ—É —ā–į —ā–≤–ĺ—Ä—á—Ė—Ā—ā—Ć, –į–Ľ–Ķ –ī–Ķ—ā–į–Ľ—Ć–Ĺ—Ė—ą–Ķ –Ņ—Ä–ĺ —Ü–Ķ - —É —Ą—Ė–Ĺ–į–Ľ—Ė —Ā—ā–į—ā—ā—Ė.

23 –į–Ņ—Ä–Ķ–Ľ—Ź 2026 –≥., 17:35

–°—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė –Ľ–Ķ–≥–ļ–ĺ –ľ–ĺ–∂–Ĺ–į –∑–Ĺ–į–Ļ—ā–ł —Ā–ĺ—ā–Ĺ—é –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—Ė–≤ —ā–į —Ä–ĺ–Ľ–ł–ļ—Ė–≤, —Ź–ļ—Ė —Ä–ĺ–∑–Ņ–ĺ–≤—Ė–ī–į—é—ā—Ć –Ņ—Ä–ĺ –ĺ—Ā–Ĺ–ĺ–≤–Ĺ—Ė —Ā—Ö–ĺ–ī–ł–Ĺ–ļ–ł —Ä–ĺ–∑–≤–ł—ā–ļ—É AI, —Č–ĺ –Ņ—Ä–ĺ–Ļ—ą–ĺ–≤ —ą–Ľ—Ź—Ö –≤—Ė–ī —ā–Ķ—Ā—ā—É –Ę—é—Ä–ł–Ĺ–≥–į —É 1950 —Ä. –ī–ĺ –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–Ĺ–ł—Ö —Ā–ł–ľ—É–Ľ—Ź—Ü—Ė–Ļ —É –Ĺ–į—É–ļ–ĺ–≤–ł—Ö –ī–ĺ—Ā–Ľ—Ė–ī–∂–Ķ–Ĺ–Ĺ—Ź—Ö —É 2026 —Ä.

–ó–į–≥–į–Ľ—Ć–Ĺ–ĺ–≤—Ė–ī–ĺ–ľ—Ė —Ą–į–ļ—ā–ł, –Ĺ–į —Ź–ļ–ł—Ö –∑–į–∑–≤–ł—á–į–Ļ –∑–į–≥–ĺ—Ā—ā—Ä—é—é—ā—Ć —É–≤–į–≥—É —ā–į–ļ—Ė –ľ–į—ā–Ķ—Ä—Ė–į–Ľ–ł:

• –Ę–Ķ—Ā—ā –Ę—é—Ä–ł–Ĺ–≥–į - 1950 —Ä.

• –ě—Ą—Ė—Ü—Ė–Ļ–Ĺ–Ķ –Ĺ–į—Ä–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź —ā–Ķ—Ä–ľ—Ė–Ĺ–į «Artificial Intelligence» –Ĺ–į –Ē–į—Ä—ā–ľ—É—ā—Ā—Ć–ļ—Ė–Ļ –ļ–ĺ–Ĺ—Ą–Ķ—Ä–Ķ–Ĺ—Ü—Ė—ó - 1956 —Ä.

• –®–į—Ö–ĺ–≤–ł–Ļ —ā—É—Ä–Ĺ—Ė—Ä –ľ—Ė–∂ –ö–į—Ā–Ņ–į—Ä–ĺ–≤–ł–ľ —ā–į –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–ĺ–ľ IBM DEEP Blue - 1997 —Ä.

• –Ę—É—Ä–Ĺ—Ė—Ä —É Go –ľ—Ė–∂ –õ—Ė –°–Ķ–ī–ĺ–Ľ–Ķ–ľ —ā–į –Ņ—Ä–ĺ–≥—Ä–į–ľ–ĺ—é AlphaGo - 2016 —Ä.

• –ü–ĺ—Ź–≤–į —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ĺ—ó –Ĺ–į—É–ļ–ĺ–≤–ĺ—ó –Ņ—Ä–į—Ü—Ė «Attention Is All You Need» - 2017 —Ä.

• –ü–ĺ—Ź–≤–į –Ņ–Ķ—Ä—ą–ĺ—ó –ī–ĺ—Ā—ā—É–Ņ–Ĺ–ĺ—ó –ľ–ĺ–ī–Ķ–Ľ—Ė ChatGPT - 2022 —Ä.

–í—Ā—Ė —Ü—Ė –Ņ–ĺ–ī—Ė—ó –ī–Ķ—ā–į–Ľ—Ć–Ĺ–ĺ –ĺ–Ņ–ł—Ā–į–Ĺ—Ė —ā–į —Ä–ĺ–∑–ļ–Ľ–į–ī–Ķ–Ĺ—Ė –Ņ–ĺ –Ņ–ĺ–Ľ–ł—á–ļ–į—Ö, –∑ –Ņ–ĺ—Ź—Ā–Ĺ–Ķ–Ĺ–Ĺ—Ź–ľ, —Č–ĺ, –Ĺ–į–≤—Ė—Č–ĺ —Ė –ī–ĺ —á–ĺ–≥–ĺ –Ņ—Ä–ł–∑–≤–Ķ–Ľ–ĺ. –Į–ļ—Č–ĺ –≤–ł –∑ —Ź–ļ–ł—Ö–ĺ—Ā—Ć –Ņ—Ä–ł—á–ł–Ĺ –Ņ—Ä–ĺ–Ņ—É—Ā—ā–ł–Ľ–ł —Ü—Ė –ľ–į—ā–Ķ—Ä—Ė–į–Ľ–ł, –ĺ–Ī–ĺ–≤'—Ź–∑–ļ–ĺ–≤–ĺ –∑–Ĺ–į–Ļ–ī—Ė—ā—Ć —ó—Ö, –Ī–Ķ–∑ –Ĺ–ł—Ö —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —ā–ĺ–≥–ĺ, —Č–ĺ —Ā–ĺ–Ī–ĺ—é —Ź–≤–Ľ—Ź—Ē —ą—ā—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā, –į–Ī—Ā–ĺ–Ľ—é—ā–Ĺ–ĺ —ā–ĺ—á–Ĺ–ĺ –Ĺ–Ķ –Ņ—Ä–ł–Ļ–ī–Ķ.

–£ –ľ–Ķ–∂–į—Ö —Ü—Ć–ĺ–≥–ĺ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—É —Ā–Ņ—Ä–ĺ–Ī—É—Ē–ľ–ĺ –Ĺ–į–≤–Ķ—Ā—ā–ł —Ü—Ė–ļ–į–≤—Ė —Ą–į–ļ—ā–ł –Ņ—Ä–ĺ AI, —Ź–ļ—Ė –ľ–į–Ľ–ĺ –Ņ–ĺ–Ņ—É–Ľ—Ź—Ä–ł–∑–ĺ–≤–į–Ĺ—Ė, —Ė —Ā–Ņ—Ä–ĺ–Ī—É—Ē–ľ–ĺ –Ņ–ĺ–≥–Ľ—Ź–Ĺ—É—ā–ł –Ĺ–į –Ņ—Ä–ĺ–Ī–Ľ–Ķ–ľ—É —Ä–ĺ–∑–≤–ł—ā–ļ—É AI –∑ –ī–Ķ—Č–ĺ —Ė–Ĺ—ą–ĺ–≥–ĺ, –Ĺ–Ķ —ā–į–ļ–ĺ–≥–ĺ –∑–≤–ł—á–Ĺ–ĺ–≥–ĺ –Ī–ĺ–ļ—É.

–Ě–Ķ–Ņ–ĺ–Ņ—É–Ľ—Ź—Ä–Ĺ–į —Ė—Ā—ā–ĺ—Ä—Ė—Ź AI

–Ē–Ľ—Ź –Ņ–ĺ—á–į—ā–ļ—É, –ĺ—Ā—Ć —Ä—Ź–ī –ľ–į–Ľ–ĺ–≤—Ė–ī–ĺ–ľ–ł—Ö —Ą–į–ļ—ā—Ė–≤, —Ź–ļ—Ė –≤–Ņ–Ľ–ł–Ĺ—É–Ľ–ł –Ĺ–į –ī–ĺ–Ľ—é —Ä–ĺ–∑–≤–ł—ā–ļ—É AI, –į–Ĺ—Ė—ā—Ä–ĺ—Ö–ł –Ĺ–Ķ –ľ–Ķ–Ĺ—ą–Ķ.

"–Ē–į–≤–Ĺ—Ė–Ļ –Ę—é—Ä—Ė–Ĺ–≥" - —á–Ķ—Ä–Ĺ–Ķ—Ü—Ć –õ—É–Ľ–Ľ—Ė–Ļ (XIII —Ā—ā–ĺ–Ľ—Ė—ā—ā—Ź)

–°–Ņ—Ä–ĺ–Ī–ł –≤–ł–≤–Ķ—Ā—ā–ł —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā, —Ź–ļ —Ź–≤–ł—Č–Ķ, –Ņ–ĺ–∑–į –ľ–Ķ–∂—Ė –Ľ—é–ī–ł–Ĺ–ł –≤–ł–Ĺ–ł–ļ–Ľ–ł –∑–ĺ–≤—Ā—Ė–ľ –Ĺ–Ķ –≤ —Ā–Ķ—Ä–Ķ–ī–ł–Ĺ—Ė –ľ–ł–Ĺ—É–Ľ–ĺ–≥–ĺ —Ā—ā–ĺ–Ľ—Ė—ā—ā—Ź. –Ę–į–ļ—Ė —Ā–Ņ—Ä–ĺ–Ī–ł —Ä–ĺ–Ī–ł–Ľ–ł—Ā—Ź —Č–Ķ –∑ XIII —Ā—ā–ĺ–Ľ—Ė—ā—ā—Ź (—Ö–ĺ—á–į –ľ–ĺ–∂–Ľ–ł–≤–ĺ, —Č–ĺ –Ļ –Ĺ–į–Ī–į–≥–į—ā–ĺ —Ä–į–Ĺ—Ė—ą–Ķ), –ļ–ĺ–Ľ–ł –Ņ—Ä–ĺ –Ĺ–į–Ņ—Ė–≤–Ņ—Ä–ĺ–≤—Ė–ī–Ĺ–ł–ļ–ł —Č–Ķ –Ĺ—Ė—Ö—ā–ĺ –Ĺ–Ķ —á—É–≤. –ú–į–Ī—É—ā—Ć, –Ĺ–į–Ļ–≤—Ė–ī–ĺ–ľ—Ė—ą–ł–Ļ –≤–ł–Ņ–į–ī–ĺ–ļ, —Ź–ļ–ł–Ļ –ī–ĺ–ļ—É–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ĺ –ī—Ė–Ļ—ą–ĺ–≤ –ī–ĺ –Ĺ–į—ą–ł—Ö –ī–Ĺ—Ė–≤, –Ņ—Ä–ł–Ņ–ł—Ā—É—Ē—ā—Ć—Ā—Ź —á–Ķ–Ĺ—Ü—é –†–į–Ļ–ľ—É–Ĺ–ī—É –õ—É–Ľ–Ľ—Ė—é, —Ź–ļ–ł–Ļ —Ā—ā–≤–ĺ—Ä–ł–≤ —Ā–ł—Ā—ā–Ķ–ľ—É –∑ –Ņ–į–Ņ–Ķ—Ä–ĺ–≤–ł—Ö –ī–ł—Ā–ļ—Ė–≤, –ļ–ĺ–ľ–Ī—Ė–Ĺ–į—Ü—Ė—Ź –ĺ–Ī–Ķ—Ä—ā–į–Ĺ–Ĺ—Ź —Ź–ļ–ł—Ö “–ī–ĺ–Ņ–ĺ–ľ–į–≥–į–Ľ–į” —ą—É–ļ–į—ā–ł –Ľ–ĺ–≥—Ė—á–Ĺ—Ė —Ä—Ė—ą–Ķ–Ĺ–Ĺ—Ź. –¶–Ķ —Ą–į–ļ—ā –ī—É–∂–Ķ –∑–Ĺ–į—á—É—Č–ł–Ļ –ī–Ľ—Ź —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą—Ė—ó AI, —Ė, —Ā–Ņ–ĺ–ī—Ė–≤–į—Ē–ľ–ĺ—Ā—Ź, –Ņ—Ä–ĺ—á–ł—ā–į–≤—ą–ł —Ü–Ķ–Ļ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ –ī–ĺ –ļ—Ė–Ĺ—Ü—Ź, –≤–ł –∑—Ä–ĺ–∑—É–ľ—Ė—Ē—ā–Ķ —á–ĺ–ľ—É.

–ü–Ķ—Ä—ą–į «–∑–ł–ľ–į» –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂: «–ü–Ķ—Ä—Ü–Ķ–Ņ—ā—Ä–ĺ–Ĺ–ł» - –ö–Ĺ–ł–≥–į, —Ź–ļ–į –∑—É–Ņ–ł–Ĺ–ł–Ľ–į –Ņ—Ä–ĺ–≥—Ä–Ķ—Ā (1958-1969)

–ú–į–Ľ–ĺ —Ö—ā–ĺ –∑–Ĺ–į—Ē, —Č–ĺ —Ä–ĺ–∑–≤–ł—ā–ĺ–ļ –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂ –Ī—É–≤ –∑–į–ľ–ĺ—Ä–ĺ–∂–Ķ–Ĺ–ł–Ļ –ľ–į–Ļ–∂–Ķ –Ĺ–į 15 —Ä–ĺ–ļ—Ė–≤ —á–Ķ—Ä–Ķ–∑ –ĺ–ī–Ĺ—É –ļ–Ĺ–ł–≥—É. 1969 —Ä–ĺ–ļ—É —ā–ł—ā–į–Ĺ–ł –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–Ĺ–ĺ—ó –ī—É–ľ–ļ–ł –ú–į—Ä–≤—Ė–Ĺ –ú—Ė–Ĺ—Ā—Ć–ļ–ł–Ļ —Ė –°–Ķ–Ļ–ľ—É—Ä –ü–Ķ–Ļ–Ņ–Ķ—Ä—ā (–∑–į—Ā–Ĺ–ĺ–≤–Ĺ–ł–ļ–ł MIT AI Lab) –ĺ–Ņ—É–Ī–Ľ—Ė–ļ—É–≤–į–Ľ–ł –Ņ—Ä–į—Ü—é «–ü–Ķ—Ä—Ü–Ķ–Ņ—ā—Ä–ĺ–Ĺ–ł». –£ –Ĺ—Ė–Ļ –≤–ĺ–Ĺ–ł –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ĺ –ī–ĺ–≤–Ķ–Ľ–ł, —Č–ĺ –Ĺ–į–Ļ–Ņ—Ä–ĺ—Ā—ā—Ė—ą–ł–Ļ –Ņ–Ķ—Ä—Ü–Ķ–Ņ—ā—Ä–ĺ–Ĺ –§—Ä–Ķ–Ĺ–ļ–į –†–ĺ–∑–Ķ–Ĺ–Ī–Ľ–į—ā—ā–į (—Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–ł–Ļ —Č–Ķ 1958 —Ä. —Ź–ļ –ľ–ĺ–ī–Ķ–Ľ—Ć —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė–Ļ–Ĺ–ĺ–≥–ĺ —Ā–Ņ—Ä–ł–Ļ–Ĺ—Ź—ā—ā—Ź –ľ–ĺ–∑–ļ—É) –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ĺ–≤–ĺ –Ĺ–Ķ–∑–ī–į—ā–Ĺ–ł–Ļ –≤–ł—Ä—Ė—ą–ł—ā–ł –∑–į–≤–ī–į–Ĺ–Ĺ—Ź «—Č–ĺ –≤–ł–ļ–Ľ—é—á–į—Ē –ź–Ď–ě» (XOR).

–Į–ļ—Č–ĺ –≥–ĺ–≤–ĺ—Ä–ł—ā–ł –Ņ—Ä–ĺ—Ā—ā–ł–ľ–ł —Ā–Ľ–ĺ–≤–į–ľ–ł, –Ņ–Ķ—Ä—Ü–Ķ–Ņ—ā—Ä–ĺ–Ĺ –≤–ł—Ź–≤–ł–≤—Ā—Ź «–Ĺ–į–ī—ā–ĺ –Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ł–ľ». –í—Ė–Ĺ –ľ—Ė–≥ —Ä–ĺ–∑–ī—Ė–Ľ—Ź—ā–ł –ĺ–Ī—Ä–į–∑–ł –Ľ–ł—ą–Ķ –ĺ–ī–Ĺ—Ė—Ē—é –Ņ—Ä—Ź–ľ–ĺ—é –Ľ—Ė–Ĺ—Ė—Ē—é. –ź–Ľ–Ķ –Ĺ–į—ą —Ā–≤—Ė—ā –Ĺ–Ķ —Ā–ļ–Ľ–į–ī–į—Ē—ā—Ć—Ā—Ź –∑ –Ņ—Ä—Ź–ľ–ł—Ö –Ľ—Ė–Ĺ—Ė–Ļ, —Ė –Ĺ–į–≤—Ė—ā—Ć –Ĺ–į–Ļ–Ņ—Ä–ĺ—Ā—ā—Ė—ą–Ķ –Ľ–ĺ–≥—Ė—á–Ĺ–Ķ –∑–į–≤–ī–į–Ĺ–Ĺ—Ź XOR (–ī–Ķ –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ –≤–ł–Ī—Ä–į—ā–ł «–į–Ī–ĺ —ā–Ķ, —á–ł —Ė–Ĺ—ą–Ķ, –į–Ľ–Ķ –Ĺ–Ķ –ĺ–Ī–ł–ī–≤–į –ĺ–ī—Ä–į–∑—É») —Ā—ā–į–≤–ł–Ľ–į —Ü—é –ľ–ĺ–ī–Ķ–Ľ—Ć —É –≥–Ľ—É—Ö–ł–Ļ –ļ—É—ā.

–ó–į–ľ—Ė—Ā—ā—Ć —ā–ĺ–≥–ĺ —Č–ĺ–Ī —ą—É–ļ–į—ā–ł —Ā–Ņ–ĺ—Ā–ĺ–Ī–ł –∑—Ä–ĺ–Ī–ł—ā–ł –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä—É –Ī–į–≥–į—ā–ĺ—ą–į—Ä–ĺ–≤–ĺ—é —ā–į «–≥–Ĺ—É—á–ļ–ĺ—é», –Ĺ–į—É–ļ–ĺ–≤–į —Ā–Ņ—Ė–Ľ—Ć–Ĺ–ĺ—ā–į –Ņ—Ä–ł–Ļ–Ĺ—Ź–Ľ–į –ī–ĺ–ļ–į–∑ –≤—á–Ķ–Ĺ–ł—Ö —Ź–ļ –ĺ—Ā—ā–į—ā–ĺ—á–Ĺ–ł–Ļ –≤–ł—Ä–ĺ–ļ —É—Ā—Ć–ĺ–ľ—É –Ĺ–į–Ņ—Ä—Ź–ľ–ļ—É. –ü—Ė–ī—Ā—É–ľ–ĺ–ļ –Ī—É–≤ —Ā—É–ľ–Ĺ–ł–Ļ: —Ą—Ė–Ĺ–į–Ĺ—Ā—É–≤–į–Ĺ–Ĺ—Ź –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂ –Ņ—Ä–ł–Ņ–ł–Ĺ–ł–Ľ–ĺ—Ā—Ź («–∑–≤—Ė—ā –õ–į–Ļ—ā—Ö—Ė–Ľ–Ľ–į» —É –Ď—Ä–ł—ā–į–Ĺ—Ė—ó —ā–į –∑–≥–ĺ—Ä—ā–į–Ĺ–Ĺ—Ź –Ņ—Ä–ĺ–≥—Ä–į–ľ DARPA —É –°–®–ź, –Ņ—Ä–ĺ —Ź–ļ–Ķ –Ĺ–ł–∂—á–Ķ). –Ě–į—Ā—ā–į–Ľ–į «–ó–ł–ľ–į AI»: –Ľ—é–ī—Ā—ā–≤–ĺ –Ĺ–į –ī–Ķ—Ā—Ź—ā–ł–Ľ—Ė—ā—ā—Ź –Ņ—Ė—ą–Ľ–ĺ —É –≥–Ľ—É—Ö–ł–Ļ –ļ—É—ā —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź «–ē–ļ—Ā–Ņ–Ķ—Ä—ā–Ĺ–ł—Ö —Ā–ł—Ā—ā–Ķ–ľ». –í—á–Ķ–Ĺ—Ė —ā–į —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–ł –Ĺ–į–ľ–į–≥–į–Ľ–ł—Ā—Ź –≤—ā–ł—Ā–Ĺ—É—ā–ł –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ—É —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć —Ā–≤—Ė—ā—É –≤ –∂–ĺ—Ä—Ā—ā–ļ—Ė –Ņ—Ä–į–≤–ł–Ľ–į —Ā–ł—Ā—ā–Ķ–ľ–ł IF-THEN (–Į–ö–©–ě-–Ę–ě), –Ĺ–į—ó–≤–Ĺ–ĺ –≤–≤–į–∂–į—é—á–ł, —Č–ĺ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā — —Ü–Ķ –ī—É–∂–Ķ –ī–ĺ–≤–≥–ł–Ļ —Ā–Ņ–ł—Ā–ĺ–ļ —Ė–Ĺ—Ā—ā—Ä—É–ļ—Ü—Ė–Ļ, –Ĺ–į–Ņ–ł—Ā–į–Ĺ–ł–Ļ –Ķ–≤–ĺ–Ľ—é—Ü—Ė—Ē—é –Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ –ľ–ĺ–∑–ļ—É. –ú–ł –≤—ā—Ä–į—ā–ł–Ľ–ł —á–į—Ā, –Ĺ–į–ľ–į–≥–į—é—á–ł—Ā—Ć –Ĺ–į–≤—á–ł—ā–ł –ľ–į—ą–ł–Ĺ—É –Ņ—Ė–ī–ļ–ĺ—Ä—Ź—ā–ł—Ā—Ź –Ľ—é–ī—Ā—Ć–ļ—Ė–Ļ –Ľ–ĺ–≥—Ė—Ü—Ė –∑–į–ľ—Ė—Ā—ā—Ć —ā–ĺ–≥–ĺ, —Č–ĺ–Ī –≤—á–ł—ā–ł —ó—ó —Ā–Ņ—Ä–ł–Ļ–ľ–į—ā–ł –ī–ĺ—Ā–≤—Ė–ī –Ĺ–į–≤–ļ–ĺ–Ľ–ł—ą–Ĺ—Ć–ĺ–≥–ĺ —Ā–≤—Ė—ā—É.

"–Ď—Ä–ł—ā–į–Ĺ—Ā—Ć–ļ–ł–Ļ –≤–ł—Ä–ĺ–ļ": –ó–≤—Ė—ā –õ–į–Ļ—ā—Ö—Ė–Ľ–Ľ–į (1973)

–Į–ļ—Č–ĺ —É –°–®–ź —Ä–ĺ–∑–≤–ł—ā–ĺ–ļ –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂ –Ņ—Ä–ł–≥–į–Ľ—Ć–ľ—É–≤–į–Ľ–į –ļ–Ĺ–ł–≥–į –ú—Ė–Ĺ—Ā—Ć–ļ–ĺ–≥–ĺ, —ā–ĺ –≤ –Ą–≤—Ä–ĺ–Ņ—Ė «—Ü–≤—Ź—Ö —É –ļ—Ä–ł—ą–ļ—É —ā—Ä—É–Ĺ–ł» –∑–į–Ī–ł–≤ —Ā–Ķ—Ä –Ē–∂–Ķ–Ļ–ľ—Ā –õ–į–Ļ—ā—Ö—Ė–Ľ–Ľ. –£ —Ā–≤–ĺ—Ē–ľ—É –∑–≤—Ė—ā—Ė –ī–Ľ—Ź –Ī—Ä–ł—ā–į–Ĺ—Ā—Ć–ļ–ĺ–≥–ĺ —É—Ä—Ź–ī—É –≤—Ė–Ĺ –∑–į–Ņ—Ä–ĺ–≤–į–ī–ł–≤ —ā–Ķ—Ä–ľ—Ė–Ĺ «–ļ–ĺ–ľ–Ī—Ė–Ĺ–į—ā–ĺ—Ä–Ĺ–ł–Ļ –≤–ł–Ī—É—Ö». –Ü–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–Ĺ–į —Ā—É—ā—Ć - –ī–ĺ–ļ–į–∑ —ā–ĺ–≥–ĺ —Ą–į–ļ—ā—É, —Č–ĺ –ľ–Ķ—ā–ĺ–ī–ł AI (—ā–ĺ–ī—Ė) –Ņ—Ä–į—Ü—é—é—ā—Ć —ā—Ė–Ľ—Ć–ļ–ł –≤ «–Ņ—Ä–ĺ—Ā—ā–ł—Ö –Ľ—Ė–Ĺ—Ė–Ļ–Ĺ–ł—Ö —Ė–≥—Ä–į—ą–ļ–ĺ–≤–ł—Ö —Ā–≤—Ė—ā–į—Ö». –ü—Ä–ł —Ā–Ņ—Ä–ĺ–Ī—Ė –ľ–į—Ā—ą—ā–į–Ī—É–≤–į—ā–ł –Ĺ–į —Ä–Ķ–į–Ľ—Ć–Ĺ—Ė –∑–į–≤–ī–į–Ĺ–Ĺ—Ź –ļ—Ė–Ľ—Ć–ļ—Ė—Ā—ā—Ć –Ĺ–Ķ–ĺ–Ī—Ö—Ė–ī–Ĺ–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć –∑—Ä–ĺ—Ā—ā–į–Ľ–į –Ķ–ļ—Ā–Ņ–ĺ–Ĺ–Ķ–Ĺ—Ü—Ė–į–Ľ—Ć–Ĺ–ĺ. –¶–Ķ –ĺ—Ö–ĺ–Ľ–ĺ–ī–ł–Ľ–ĺ –∑–į–Ņ–į–Ľ —ā–ł—Ö, —Ö—ā–ĺ –≤–≤–į–∂–į–≤, —Č–ĺ –ī–ĺ—Ā–ł—ā—Ć –Ņ—Ä–ĺ—Ā—ā–ĺ –Ĺ–į–Ņ–ł—Ā–į—ā–ł –Ņ—Ä–į–≤–ł–Ľ—Ć–Ĺ–ł–Ļ —Ā–ļ–Ľ–į–ī–Ĺ–ł–Ļ –į–Ľ–≥–ĺ—Ä–ł—ā–ľ —Ė –≤—Ā–Ķ –∑–į–Ņ—Ä–į—Ü—é—Ē. –°—ā–į–Ľ–ĺ —Ź—Ā–Ĺ–ĺ: –Ī–Ķ–∑ –ļ–ĺ–Ľ–ĺ—Ā–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ —Ā—ā—Ä–ł–Ī–ļ–į –≤ –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ—Ė–Ļ –Ņ–ĺ—ā—É–∂–Ĺ–ĺ—Ā—ā—Ė —ā–į –ĺ–Ī—Ā—Ź–≥–į—Ö –Ĺ–Ķ–ĺ–Ī—Ö—Ė–ī–Ĺ–ĺ—ó –Ņ–į–ľ'—Ź—ā—Ė AI –∑–į–Ľ–ł—ą–ł—ā—Ć—Ā—Ź –Ľ–į–Ī–ĺ—Ä–į—ā–ĺ—Ä–Ĺ–ĺ—é –∑–į–Ī–į–≤–ĺ—é. –¶–Ķ –Ī—É–Ľ–į –Ņ–Ķ—Ä–Ķ–ľ–ĺ–≥–į –Ņ—Ä–į–≥–ľ–į—ā–ł–∑–ľ—É –∂–ĺ—Ä—Ā—ā–ļ–ł—Ö —Ä–Ķ–į–Ľ—Ė–Ļ –Ĺ–į–ī —Ä–ĺ–ľ–į–Ĺ—ā–ł–∑–ľ–ĺ–ľ —ā—É–ľ–į–Ĺ–Ĺ–ĺ–≥–ĺ –ľ–į–Ļ–Ī—É—ā–Ĺ—Ć–ĺ–≥–ĺ.

–ü–į—Ä–į–ī–ĺ–ļ—Ā –ú–ĺ—Ä–į–≤–Ķ–ļ–į (1980)

–¶–Ķ–Ļ –Ņ–į—Ä–į–ī–ĺ–ļ—Ā —Ē —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–ĺ–ľ –ī–Ľ—Ź —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź —ā–ĺ–≥–ĺ, —á–ĺ–ľ—É —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–Ĺ—Ė –Ņ—Ė–ī—Ö–ĺ–ī–ł –ī–ĺ AI –ī–Ķ—Ā—Ź—ā–ł–Ľ—Ė—ā—ā—Ź–ľ–ł –Ī—É–ļ—Ā—É–≤–į–Ľ–ł, –Ĺ–į–ľ–į–≥–į—é—á–ł—Ā—Ć —Ė–ľ—Ė—ā—É–≤–į—ā–ł –Ľ—é–ī—Ā—Ć–ļ–Ķ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź. –ď–į–Ĺ—Ā –ú–ĺ—Ä–į–≤–Ķ–ļ, –†–ĺ–ī–Ĺ—Ė –Ď—Ä—É–ļ—Ā —ā–į —Ė–Ĺ—ą—Ė –ī–ĺ—Ā–Ľ—Ė–ī–Ĺ–ł–ļ–ł —Ā—Ą–ĺ—Ä–ľ—É–Ľ—é–≤–į–Ľ–ł –ļ–ĺ–Ĺ—ā—Ä—Ė–Ĺ—ā—É—ó—ā–ł–≤–Ĺ–ł–Ļ –≤–ł—Ā–Ĺ–ĺ–≤–ĺ–ļ: –≤—Ā—É–Ņ–Ķ—Ä–Ķ—á –Ĺ–į—ą–ł–ľ –ĺ—á—Ė–ļ—É–≤–į–Ĺ–Ĺ—Ź–ľ, –≤–ł—Ā–ĺ–ļ–ĺ—Ä—Ė–≤–Ĺ–Ķ–≤—Ė –ļ–ĺ–≥–Ĺ—Ė—ā–ł–≤–Ĺ—Ė –∑–į–≤–ī–į–Ĺ–Ĺ—Ź (–≤–ł—Č–į –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ–į, –≥—Ä–į –≤ —ą–į—Ö–ł, –Ľ–ĺ–≥—Ė—á–Ĺ–ł–Ļ –į–Ĺ–į–Ľ—Ė–∑) –≤–ł–ľ–į–≥–į—é—ā—Ć –ľ—Ė–∑–Ķ—Ä–Ĺ–ł—Ö –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ł—Ö –Ņ–ĺ—ā—É–∂–Ĺ–ĺ—Ā—ā–Ķ–Ļ –Ņ–ĺ—Ä—Ė–≤–Ĺ—Ź–Ĺ–ĺ –∑ «–Ņ—Ä–ĺ—Ā—ā–ł–ľ–ł» —Ā–Ķ–Ĺ—Ā–ĺ–ľ–ĺ—ā–ĺ—Ä–Ĺ–ł–ľ–ł.

–†–ĺ–∑–Ņ—Ė–∑–Ĺ–į–≤–į–Ĺ–Ĺ—Ź –ĺ–Ī'—Ē–ļ—ā—Ė–≤ —É –∑–į—ą—É–ľ–Ľ–Ķ–Ĺ–ĺ–ľ—É —Ā–Ķ—Ä–Ķ–ī–ĺ–≤–ł—Č—Ė —á–ł —É—ā—Ä–ł–ľ–į–Ĺ–Ĺ—Ź —Ä—Ė–≤–Ĺ–ĺ–≤–į–≥–ł –Ņ—Ė–ī —á–į—Ā —Ö–ĺ–ī—Ć–Ī–ł –Ņ–Ķ—Ä–Ķ—Ā—Ė—á–Ķ–Ĺ–ĺ—é –ľ—Ė—Ā—Ü–Ķ–≤—Ė—Ā—ā—é - –∑–į–≤–ī–į–Ĺ–Ĺ—Ź, —Ź–ļ—Ė –Ľ—é–ī—Ā—Ć–ļ–ł–Ļ –ľ–ĺ–∑–ĺ–ļ –≤–ł—Ä—Ė—ą—É—Ē «—Ą–ĺ–Ĺ–ĺ–ľ», - –≤–ł–ľ–į–≥–į—é—ā—Ć –ļ–ĺ–Ľ–ĺ—Ā–į–Ľ—Ć–Ĺ–ł—Ö —Ä–Ķ—Ā—É—Ä—Ā—Ė–≤. –í–ł—Ź–≤–ł–Ľ–ĺ—Ā—Ź, —Č–ĺ –∑ –Ņ–ĺ–≥–Ľ—Ź–ī—É –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ĺ—ó —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—Ā—ā—Ė, «–Ņ—Ä–ĺ—Ā—ā–ĺ –∂–ł—ā–ł» —Ė —Ā–Ņ—Ä–ł–Ļ–ľ–į—ā–ł —Ā–≤—Ė—ā –Ĺ–į –Ņ–ĺ—Ä—Ź–ī–ĺ–ļ –≤–į–∂—á–Ķ, –Ĺ—Ė–∂ –≤–ł—Ä—Ė—ą—É–≤–į—ā–ł –ī–ł—Ą–Ķ—Ä–Ķ–Ĺ—Ü—Ė–į–Ľ—Ć–Ĺ—Ė —Ä—Ė–≤–Ĺ—Ź–Ĺ–Ĺ—Ź. –ú–ł –Ņ–ĺ–ľ–ł–Ľ–ļ–ĺ–≤–ĺ –Ī—Ä–į–Ľ–ł —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź (–ī–Ľ—Ź –Ľ—é–ī–ł–Ĺ–ł) –∑–į —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—Ć –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—Ė—á–Ĺ—É. –°–Ķ–Ĺ—Ā–ĺ–ľ–ĺ—ā–ĺ—Ä–Ĺ—Ė –Ĺ–į–≤–ł—á–ļ–ł (–∑—Ė—Ä, —Ä—É—Ö) –ĺ–Ņ—ā–ł–ľ—Ė–∑—É–≤–į–Ľ–ł—Ā—Ź –Ņ—Ä–ł—Ä–ĺ–ī–Ĺ–ł–ľ –≤—Ė–ī–Ī–ĺ—Ä–ĺ–ľ –ľ—Ė–Ľ—Ć—Ź—Ä–ī–ł —Ä–ĺ–ļ—Ė–≤. –Ě–į —Ü—Ė –∑–į–≤–ī–į–Ĺ–Ĺ—Ź —É –Ĺ–į—ą–ĺ–ľ—É –ľ–ĺ–∑–ļ—É –≤–ł–ī—Ė–Ľ–Ķ–Ĺ–ĺ –ļ–ĺ–Ľ–ĺ—Ā–į–Ľ—Ć–Ĺ—Ė –ĺ–Ī—Ā—Ź–≥–ł –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ–ł—Ö –ľ–Ķ—Ä–Ķ–∂, —Č–ĺ –Ņ—Ä–į—Ü—é—é—ā—Ć –Ņ–į—Ä–į–Ľ–Ķ–Ľ—Ć–Ĺ–ĺ —ā–į –≤–ļ—Ä–į–Ļ –Ķ—Ą–Ķ–ļ—ā–ł–≤–Ĺ–ĺ. –¶–Ķ, —Ź–ļ –Ĺ–Ķ –ī–ł–≤–Ĺ–ĺ, «–≤–į–∂–ļ–ł–Ļ –ļ–ĺ–ī»–Ĺ–į –į–Ņ–į—Ä–į—ā–Ĺ–ĺ–ľ—É —Ä—Ė–≤–Ĺ—Ė –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—ó. –õ–ĺ–≥—Ė–ļ–į —ā–į –į–Ī—Ā—ā—Ä–į–ļ—ā–Ĺ–Ķ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź - —Ü–Ķ «–Ĺ–į–ī–Ī—É–ī–ĺ–≤–į», —Ź–ļ—Ė–Ļ –Ľ–ł—ą–Ķ –ļ—Ė–Ľ—Ć–ļ–į –ī–Ķ—Ā—Ź—ā–ļ—Ė–≤ —ā–ł—Ā—Ź—á —Ä–ĺ–ļ—Ė–≤. –í–ĺ–Ĺ–į –∑–į–Ļ–ľ–į—Ē –ľ—Ė–∑–Ķ—Ä–Ĺ—É —á–į—Ā—ā–ł–Ĺ—É —Ä–Ķ—Ā—É—Ä—Ā—Ė–≤ –ľ–ĺ–∑–ļ—É, —Č–ĺ, –Ņ–ĺ–≥–ĺ–ī—Ć—ā–Ķ—Ā—Ź, –∑–ĺ–≤—Ā—Ė–ľ –Ĺ–Ķ —Ė–Ĺ—ā—É—ó—ā–ł–≤–Ĺ–ĺ –ī–Ľ—Ź —Ā–Ķ—Ä–Ķ–ī–Ĺ—Ć–ĺ—ó –Ľ—é–ī–ł–Ĺ–ł.

–ü–į—Ä–į–ī–ĺ–ļ—Ā –ú–ĺ—Ä–į–≤–Ķ–ļ–į –ī–ĺ—Ā—Ė —Ē –Ī–Ķ—ā–ĺ–Ĺ–Ĺ–ĺ—é —Ā—ā—Ė–Ĺ–ĺ—é –ī–Ľ—Ź —Ä–ĺ–Ī–ĺ—ā–ĺ—ā–Ķ—Ö–Ĺ—Ė–ļ–ł. –Ě–į –ľ–ĺ–ľ–Ķ–Ĺ—ā –Ĺ–į–Ņ–ł—Ā–į–Ĺ–Ĺ—Ź —Ā—ā–į—ā—ā—Ė –Ņ–ĺ—ā–ĺ—á–Ĺ–ł–Ļ AI –ľ–ĺ–∂–Ķ –Ľ–Ķ–≥–ļ–ĺ —Ā–ļ–Ľ–į—Ā—ā–ł —Ė—Ā–Ņ–ł—ā –Ĺ–į –į–ī–≤–ĺ–ļ–į—ā–į –į–Ī–ĺ –Ņ—Ä–ĺ–≥—Ä–į–ľ—Ė—Ā—ā–į, –į–Ľ–Ķ –Ļ–ĺ–ľ—É –≤—Ā–Ķ —Č–Ķ –≤–į–∂–ļ–ĺ –į–ļ—É—Ä–į—ā–Ĺ–ĺ —Ė —ą–≤–ł–ī–ļ–ĺ —Ā–ļ–Ľ–į—Ā—ā–ł —Ā–ĺ—Ä–ĺ—á–ļ—É, —Č–ĺ —á—É–ī–ĺ–≤–ĺ –Ņ—Ė–ī—ā–≤–Ķ—Ä–ī–∂—É—Ē –≤—Ė—Ä–Ĺ—Ė—Ā—ā—Ć –Ņ–į—Ä–į–ī–ĺ–ļ—Ā–į.

«–í–ł–Ņ–į–ī–ļ–ĺ–≤–į —Ä–Ķ–≤–ĺ–Ľ—é—Ü—Ė—Ź»: –Į–ļ —Ė–≥—Ä–ĺ–≤–į —Ė–Ĺ–ī—É—Ā—ā—Ä—Ė—Ź –≤—Ä—Ź—ā—É–≤–į–Ľ–į AI (2000-—ā—Ė)

–¶–Ķ —Ą–į–ļ—ā, —Ź–ļ–ł–Ļ –ī—É–∂–Ķ –Ľ—é–Ī–Ľ—Ź—ā—Ć –∑–≥–į–ī—É–≤–į—ā–ł IT-—Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–ł. –ź–∂ –ī–ĺ —Ā–Ķ—Ä–Ķ–ī–ł–Ĺ–ł 2000-—Ö –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂—Ė –≤–≤–į–∂–į–Ľ–ł—Ā—Ź –Ņ–ĺ–≤—Ė–Ľ—Ć–Ĺ–ł–ľ–ł, –≤—É–∑—Ć–ļ–ĺ—Ā–Ņ–Ķ—Ü—Ė–į–Ľ—Ė–∑–ĺ–≤–į–Ĺ–ł–ľ–ł —ā–į –Ī–Ķ–∑–Ņ–Ķ—Ä—Ā–Ņ–Ķ–ļ—ā–ł–≤–Ĺ–ł–ľ–ł. –ź–Ľ–Ķ —É 2007 —Ä–ĺ—Ü—Ė NVIDIA –≤–ł–Ņ—É—Ā—ā–ł–Ľ–į CUDA (–Ņ—Ä–ĺ–≥—Ä–į–ľ–Ĺ–ĺ-–į–Ņ–į—Ä–į—ā–Ĺ—É –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä—É –Ņ–į—Ä–į–Ľ–Ķ–Ľ—Ć–Ĺ–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć). –ó'—Ź—Ā—É–≤–į–Ľ–ĺ—Ā—Ź, —Č–ĺ –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä–į –≥—Ä–į—Ą—Ė—á–Ĺ–ł—Ö –Ņ—Ä–ĺ—Ü–Ķ—Ā–ĺ—Ä—Ė–≤ (GPU), —Ź–ļ–į —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–į –ī–Ľ—Ź –≤—Ė–ī—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź —ā–Ķ–ļ—Ā—ā—É—Ä –≤ —Ė–≥—Ä–į—Ö, —Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ĺ –Ņ—Ė–ī—Ö–ĺ–ī–ł—ā—Ć –ī–Ľ—Ź –ľ–į—ā—Ä–ł—á–Ĺ–ł—Ö –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć —É –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂–į—Ö. –ü–į—Ä–į–Ľ–Ķ–Ľ—Ė–∑–ľ GPU –≤–ł—Ź–≤–ł–≤—Ā—Ź –≤ —Ā–ĺ—ā–Ĺ—Ė —Ä–į–∑—Ė–≤ –Ķ—Ą–Ķ–ļ—ā–ł–≤–Ĺ—Ė—ą–ł–ľ –∑–į –Ņ–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ—Ė –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź CPU. AI –Ņ–Ķ—Ä–Ķ–ľ—Ė–≥ –Ĺ–Ķ –∑–į–≤–ī—Ź–ļ–ł –Ņ–ĺ—Ź–≤—Ė –Ĺ–ĺ–≤–ł—Ö —Ą–ĺ—Ä–ľ—É–Ľ (–Ī–į–≥–į—ā–ĺ –ĺ—Ā–Ĺ–ĺ–≤–Ĺ–ł—Ö –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—Ė–≤ –Ī—É–Ľ–ł –≤—Ė–ī–ĺ–ľ—Ė –∑ 80-—Ö), –į —ā–ĺ–ľ—É, —Č–ĺ –ľ–ł –ĺ—ā—Ä–ł–ľ–į–Ľ–ł –Ĺ–Ķ–ĺ–Ī—Ö—Ė–ī–Ĺ—É «–≥—Ä—É–Ī—É —Ā–ł–Ľ—É» –ľ–į–Ļ–∂–Ķ –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ĺ. –Ę–Ķ—Ö–Ĺ—Ė—á–Ĺ–į —Ė—Ä–ĺ–Ĺ—Ė—Ź, —Č–ĺ –∑–ľ—Ė–Ĺ–ł–Ľ–į —Ā–≤—Ė—ā - —Ā—É—á–į—Ā–Ĺ—Ė –ľ–ĺ–≤–Ĺ—Ė –ľ–ĺ–ī–Ķ–Ľ—Ė –∑–ĺ–Ī–ĺ–≤'—Ź–∑–į–Ĺ—Ė —Ā–≤–ĺ—ó–ľ —Ė—Ā–Ĺ—É–≤–į–Ĺ–Ĺ—Ź–ľ –≥–Ķ–Ļ–ľ–Ķ—Ä–į–ľ, —Ź–ļ—Ė —Ö–ĺ—ā—Ė–Ľ–ł –Ī–į—á–ł—ā–ł –Ī—Ė–Ľ—Ć—ą —Ä–Ķ–į–Ľ—Ė—Ā—ā–ł—á–Ĺ—Ė –≤–ł–Ī—É—Ö–ł —ā–į —ā—Ė–Ĺ—Ė —É 3D-—Ā—ā—Ä—Ė–Ľ—Ź–Ľ–ļ–į—Ö.

ImageNet —ā–į «–Ē–ł–ļ—ā–į—ā—É—Ä–į –ī–į–Ĺ–ł—Ö» (2010–2012)

–Ē–ĺ 2010 —Ä–ĺ–ļ—É –≤—Ā—Ė –ī–ĺ—Ā–Ľ—Ė–ī–Ĺ–ł–ļ–ł —Ā–Ņ–Ķ—Ä–Ķ—á–į–Ľ–ł—Ā—Ź –Ņ—Ä–ĺ «—á–ł—Ā—ā–ĺ—ā—É –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—Ė–≤». –§–Ķ–Ļ-–§–Ķ–Ļ –õ—Ė (–į–ľ–Ķ—Ä–ł–ļ–į–Ĺ—Ā—Ć–ļ–į –≤—á–Ķ–Ĺ–į –ļ–ł—ā–į–Ļ—Ā—Ć–ļ–ĺ–≥–ĺ –Ņ–ĺ—Ö–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź) –∑–ī—Ė–Ļ—Ā–Ĺ–ł–Ľ–į –Ņ–Ķ—Ä–Ķ–≤–ĺ—Ä–ĺ—ā, —Ā—ā–≤–ĺ—Ä–ł–≤—ą–ł ImageNet - –Ī–į–∑—É –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ—Ė–≤ —Ä–ĺ–∑–ľ—Ė—á–Ķ–Ĺ–ł—Ö —Ą–ĺ—ā–ĺ. –í–ĺ–Ĺ–į –Ņ—Ė–ī—Ā–≤—Ė—ā–ł–Ľ–į –Ņ—Ä–ĺ–Ī–Ľ–Ķ–ľ—É —Ä–ĺ–∑–≤–ł—ā–ļ—É AI —ā–ĺ–≥–ĺ —á–į—Ā—É - —Ā–Ņ—Ä–į–≤–į –Ĺ–Ķ –≤ –į–Ľ–≥–ĺ—Ä–ł—ā–ľ–į—Ö, –į –≤ «–Ņ–į–Ľ–ł–≤—Ė» –ī–Ľ—Ź –Ĺ–ł—Ö. –§–Ķ–Ļ-–§–Ķ–Ļ –õ—Ė –∑–į–Ņ—Ä–ĺ–Ņ–ĺ–Ĺ—É–≤–į–Ľ–į —Ė–ī–Ķ—é: —Č–ĺ–Ī –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä –Ņ–ĺ–Ī–į—á–ł–≤ —Ā–≤—Ė—ā, –Ļ–ĺ–ľ—É –Ĺ–Ķ –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ—Ė –Ĺ–į—ą—Ė –Ľ—é–ī—Ā—Ć–ļ—Ė –ĺ–Ņ–ł—Ā–ł –ĺ–∑–Ĺ–į–ļ, –Ļ–ĺ–ľ—É –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–į –Ņ—Ä–ĺ—Ā—ā–ĺ –ļ—Ä–ł—ā–ł—á–Ĺ–į –ľ–į—Ā–į –ī–į–Ĺ–ł—Ö.

–ź–Ľ–≥–ĺ—Ä–ł—ā–ľ AlexNet —É 2012 —Ä–ĺ—Ü—Ė –Ĺ–į –ļ–ĺ–Ĺ–ļ—É—Ä—Ā—Ė ImageNet –Ņ–ĺ–ļ–į–∑–į–≤, —Č–ĺ –≥–Ľ–ł–Ī–ĺ–ļ–Ķ –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź (Deep Learning) - —Ü–Ķ –Ĺ–Ķ –ľ–į–≥—Ė—Ź, –į —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā –Ņ–ĺ—Ē–ī–Ĺ–į–Ĺ–Ĺ—Ź —ā—Ä—Ć–ĺ—Ö –Ī–į–∑–ĺ–≤–ł—Ö –ļ–ĺ–ľ–Ņ–ĺ–Ĺ–Ķ–Ĺ—ā—Ė–≤: –Ē–į–Ĺ—Ė (–Ņ–į–Ľ–ł–≤–ĺ) + GPU (–ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź) + “–°—ā–į—Ä—Ė” –į–Ľ–≥–ĺ—Ä–ł—ā–ľ–ł (–ľ–Ķ—ā–ĺ–ī–ł). –¶–Ķ –Ī—É–≤ –Ņ–Ķ—Ä—ą–ł–Ļ –ľ–ĺ–ľ–Ķ–Ĺ—ā, –ļ–ĺ–Ľ–ł AI –Ņ–Ķ—Ä–Ķ—Ā—ā–į–Ľ–ł —Ā–Ņ—Ä–ł–Ļ–ľ–į—ā–ł –Ĺ–į –ĺ—Ā–Ĺ–ĺ–≤—Ė «–Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ» –Ņ—Ė–ī—Ö–ĺ–ī—É –ī–ĺ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź. –ě–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ł–ľ –ľ–į—ą–ł–Ĺ–į–ľ –Ņ—Ä–ĺ—Ā—ā–ĺ –∑–≥–ĺ–ī–ĺ–≤—É–≤–į–Ľ–ł –ī–į–Ĺ—Ė, –į –≤–ĺ–Ĺ–ł —Ā–į–ľ—Ė —ą—É–ļ–į–Ľ–ł –≤ –Ĺ–ł—Ö –Ņ–į—ā–Ķ—Ä–Ĺ–ł, —Ź–ļ—Ė –Ľ—é–ī–ł–Ĺ–į –Ĺ–į–≤—Ė—ā—Ć –Ĺ–Ķ –ľ–ĺ–≥–Ľ–į –Ľ–ĺ–≥—Ė—á–Ĺ–ĺ –Ņ–ĺ–∑–Ĺ–į—á–ł—ā–ł —á–ł –ĺ–Ņ–ł—Ā–į—ā–ł —Ā–Ľ–ĺ–≤–į–ľ–ł.

«–•—Ė–ī 37»: –ü—Ä–ĺ—Č–į–≤–į–Ļ, –Ľ—é–ī—Ā—Ć–ļ–į –Ľ–ĺ–≥—Ė–ļ–ĺ (2016)

–Ę—É—ā –ľ–ł –∑–ľ—É—ą–Ķ–Ĺ—Ė –Ņ–ĺ–≤–Ķ—Ä–Ĺ—É—ā–ł—Ā—Ź –ī–ĺ –≤–ł—Č–Ķ–∑–į–∑–Ĺ–į—á–Ķ–Ĺ–ĺ–≥–ĺ –Ņ–ĺ–Ņ—É–Ľ—Ź—Ä–Ĺ–ĺ–≥–ĺ —Ą–į–ļ—ā—É - –ú–į—ā—á—É AlphaGo (Google) –Ņ—Ä–ĺ—ā–ł –õ—Ė –°–Ķ–ī–ĺ–Ľ—Ź. –§—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ĺ—é –Ņ–ĺ–ī—Ė—Ē—é, —Č–ĺ —Ä–ĺ–∑—Ė—Ä–≤–į–Ľ–į –Ĺ–į—É–ļ–ĺ–≤—É –≥—Ä–ĺ–ľ–į–ī—Ā—Ć–ļ—Ė—Ā—ā—Ć, —Ā—ā–į–Ľ–į –ī—Ä—É–≥–į –Ņ–į—Ä—ā—Ė—Ź, –į —Ā–į–ľ–Ķ 37-–Ļ —Ö—Ė–ī. –ü—Ä–ĺ–≥—Ä–į–ľ–į AlphaGo –∑—Ä–ĺ–Ī–ł–Ľ–į —Ö—Ė–ī, —Ź–ļ–ł–Ļ —É—Ā—Ė –ļ–ĺ–ľ–Ķ–Ĺ—ā–į—ā–ĺ—Ä–ł (–Ņ—Ä–ĺ—Ą–Ķ—Ā—Ė–ĺ–Ĺ–į–Ľ–ł –≤–ł—Č–ĺ–≥–ĺ —Ä–į–Ĺ–≥—É) –Ĺ–į–∑–≤–į–Ľ–ł –Ņ–ĺ–ľ–ł–Ľ–ļ–ĺ—é. –ó –Ņ–ĺ–≥–Ľ—Ź–ī—É –Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ –ī–ĺ—Ā–≤—Ė–ī—É —Ü–Ķ–Ļ —Ö—Ė–ī –Ī—É–≤ –Ī–Ķ–∑–≥–Ľ—É–∑–ī–ł–ľ —Ė –Ĺ–Ķ–Ľ–ĺ–≥—Ė—á–Ĺ–ł–ľ. –ź–Ľ–Ķ —Ā–į–ľ–Ķ –≤—Ė–Ĺ –Ņ—Ä–ł–∑–≤—Ė–≤ –ī–ĺ –Ņ–Ķ—Ä–Ķ–ľ–ĺ–≥–ł –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–į –Ĺ–į–ī –Ľ—é–ī–ł–Ĺ–ĺ—é. –¶–Ķ –Ī—É–Ľ–ł –Ņ–Ķ—Ä—ą—Ė –ĺ–∑–Ĺ–į–ļ–ł –∑–į—Ö–ĺ–ī—É –į–Ĺ—ā—Ä–ĺ–Ņ–ĺ—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É, —Ź–ļ—Ė —Ā—ā–į–Ľ–ł –≤—Ė–ī—á—É—ā–Ĺ–ł–ľ–ł —ā–į –ĺ–Ī–≥–ĺ–≤–ĺ—Ä—é–≤–į–Ĺ–ł–ľ–ł –ī–į–Ľ–Ķ–ļ–ĺ –Ĺ–Ķ –≤—Ė–ī—Ä–į–∑—É. AI –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ "—Ä–į—Ö—É–≤–į–≤ —ą–≤–ł–ī—ą–Ķ", –≤—Ė–Ĺ –∑–ľ—Ė–≥ –Ņ–ĺ–Ī–į—á–ł—ā–ł —Ā—ā—Ä–į—ā–Ķ–≥—Ė—é –∑–į –ľ–Ķ–∂–į–ľ–ł –Ĺ–į—ā—Ä–Ķ–Ĺ–ĺ–≤–į–Ĺ–ĺ—ó –Ľ—é–ī—Ā—Ć–ļ–ĺ—ó —Ė–Ĺ—ā—É—ó—Ü—Ė—ó. –ö–ĺ–ľ–Ņ'—é—ā–Ķ—Ä –Ĺ–į —ā–ĺ–ľ—É —Ö–ĺ–ī—É –Ņ–Ķ—Ä–Ķ—Ā—ā–į–≤ —Ė–ľ—Ė—ā—É–≤–į—ā–ł –Ľ–ĺ–≥—Ė–ļ—É –Ľ—é–ī–ł–Ĺ–ł, –≤—Ė–Ĺ –Ņ–ĺ—á–į–≤ —Ā—ā–≤–ĺ—Ä—é–≤–į—ā–ł —Ā–≤–ĺ—ó –ľ–Ķ—ā–ĺ–ī–ł –≤–ł—Ä—Ė—ą–Ķ–Ĺ–Ĺ—Ź –∑–į–≤–ī–į–Ĺ–Ĺ—Ź –ī–Ľ—Ź –Ņ–Ķ—Ä–Ķ–ľ–ĺ–≥–ł.

Attention Is All You Need - –Ď—É–Ĺ—ā –≥–Ķ–Ĺ—Ė—ó–≤ –Ņ—Ä–ĺ—ā–ł –Ņ–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ–ĺ—Ā—ā—Ė (2017)

–†–ĺ–Ī–ĺ—ā—É "–£–≤–į–≥–į - —Ü–Ķ –≤—Ā–Ķ, —Č–ĺ –≤–į–ľ –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ" («Attention Is All You Need») –ľ–ĺ–∂–Ĺ–į –≤–≤–į–∂–į—ā–ł –ĺ—Ā–Ĺ–ĺ–≤–Ĺ–ĺ—é –Ņ—Ä–į—Ü–Ķ—é –ī–Ľ—Ź —Ā–≤—Ė—ā—É —Ā—É—á–į—Ā–Ĺ–ĺ–≥–ĺ AI. –Į–ļ—Č–ĺ –≤—Ā—Ė –≤–ł—Č–Ķ–ĺ–Ņ–ł—Ā–į–Ĺ—Ė –Ĺ–į–ľ–ł –ī–ĺ—Ā–Ľ—Ė–ī–∂–Ķ–Ĺ–Ĺ—Ź —É–ļ–Ľ–į–ī–į—é—ā—Ć—Ā—Ź —É —Ą–ĺ—Ä–ľ–į—ā «–°—ā–į—Ä–ĺ–≥–ĺ –∑–į–≤—Ė—ā—É», —ā–ĺ —Ü—Ź —Ā—ā–į—ā—ā—Ź –Ī—É–ļ–≤–į–Ľ—Ć–Ĺ–ĺ «–Ě–ĺ–≤–ł–Ļ –∑–į–≤—Ė—ā». –í–ĺ–Ĺ–į —Ä–ĺ–∑–ī—Ė–Ľ–ł–Ľ–į —Ė—Ā—ā–ĺ—Ä—Ė—é AI –Ĺ–į «–ī–ĺ» —ā–į «–Ņ—Ė—Ā–Ľ—Ź». –ě—Ā–Ĺ–ĺ–≤–į —Ä–ĺ–Ī–ĺ—ā–ł – –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä–į Transformer. –ó —ó—ó –ī–ĺ–Ņ–ĺ–ľ–ĺ–≥–ĺ—é AI –ĺ—Ā—ā–į—ā–ĺ—á–Ĺ–ĺ —É–Ĺ–ł–ļ–Ĺ—É–≤ –Ņ–ĺ—Ā–Ľ—Ė–ī–ĺ–≤–Ĺ–ĺ—ó –Ľ–ĺ–≥—Ė–ļ–ł —Ä–Ķ–ļ—É—Ä–Ķ–Ĺ—ā–Ĺ–ł—Ö –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ–ł—Ö –ľ–Ķ—Ä–Ķ–∂ (RNN). –ď–ĺ–Ľ–ĺ–≤–Ĺ–į –Ņ—Ä–ĺ–Ī–Ľ–Ķ–ľ–į RNN –Ņ–ĺ–Ľ—Ź–≥–į–Ľ–į –≤ —ā–ĺ–ľ—É, —Č–ĺ –≤–ĺ–Ĺ–ł —á–ł—ā–į–Ľ–ł —ā–Ķ–ļ—Ā—ā —Ź–ļ –Ľ—é–ī–ł–Ĺ–į - —Ā–Ľ–ĺ–≤–ĺ –∑–į —Ā–Ľ–ĺ–≤–ĺ–ľ, —Č–ĺ —É–Ĺ–Ķ–ľ–ĺ–∂–Ľ–ł–≤–Ľ—é–≤–į–Ľ–ĺ –ľ–į—Ā–ĺ–≤–Ķ —Ä–ĺ–∑–Ņ–į—Ä–į–Ľ–Ķ–Ľ—é–≤–į–Ĺ–Ĺ—Ź –ĺ–Ī—á–ł—Ā–Ľ–Ķ–Ĺ—Ć —Ė –Ņ—Ä–ł–∑–≤–ĺ–ī–ł–Ľ–ĺ –ī–ĺ –≤—ā—Ä–į—ā–ł –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā—É –≤ –ī–ĺ–≤–≥–ł—Ö —Ä–Ķ—á–Ķ–Ĺ–Ĺ—Ź—Ö. –ú–Ķ—Ö–į–Ĺ—Ė–∑–ľ —É–≤–į–≥–ł (Attention) –ī–ĺ–∑–≤–ĺ–Ľ–ł–≤ –ľ–ĺ–ī–Ķ–Ľ—Ė –ī–ł–≤–ł—ā–ł—Ā—Ź –Ĺ–į –≤–Ķ—Ā—Ć –ĺ–Ī—Ā—Ź–≥ –ī–į–Ĺ–ł—Ö –ĺ–ī–Ĺ–ĺ—á–į—Ā–Ĺ–ĺ, –≤–ł–ī—Ė–Ľ—Ź—é—á–ł –Ĺ–į–Ļ–≤–į–∂–Ľ–ł–≤—Ė—ą–Ķ.

–ó–į–≥–ĺ–Ľ–ĺ–≤–ĺ–ļ —Ā—ā–į—ā—ā—Ė - —Ü–Ķ –Ņ—Ä—Ź–ľ–Ķ –Ņ–ĺ—Ā–ł–Ľ–į–Ĺ–Ĺ—Ź –Ĺ–į –Ņ—Ė—Ā–Ĺ—é The Beatles "All You Need Is Love", —Č–ĺ –∑–į–ī–į–Ľ–ĺ –≤—Ė—Ä—É—Ā–Ĺ–ł–Ļ —ā—Ä–Ķ–Ĺ–ī –≤ AI-—Ā–Ņ—Ė–Ľ—Ć–Ĺ–ĺ—ā—Ė –Ĺ–į –ī–Ķ—Ā—Ź—ā–ł–Ľ—Ė—ā—ā—Ź –≤–Ņ–Ķ—Ä–Ķ–ī. –Ě–į–∑–≤—É «Transformer» (—ā–į —Ā–į–ľ–į –Ī—É–ļ–≤–į –Ę —É –Ĺ–į–∑–≤—Ė ChatGPT) –∑–į–Ņ—Ä–ĺ–Ņ–ĺ–Ĺ—É–≤–į–≤ –Į–ļ–ĺ–Ī –£—ą–ļ–ĺ—Ä–Ķ–Ļ—ā. –°–Ņ–ĺ—á–į—ā–ļ—É –ļ–ĺ–ľ–į–Ĺ–ī–į —Ā–ļ–Ķ–Ņ—ā–ł—á–Ĺ–ĺ –Ņ–ĺ—Ā—ā–į–≤–ł–Ľ–į—Ā—Ź –ī–ĺ —Ü—Ć–ĺ–≥–ĺ, –≤–≤–į–∂–į—é—á–ł, —Č–ĺ –≤–ĺ–Ĺ–į –∑–≤—É—á–ł—ā—Ć —Ź–ļ –Ĺ–į–∑–≤–į —Ė–≥—Ä–į—ą–ļ–ł. –í –ĺ–ī–Ĺ–ĺ–ľ—É –∑ –Ņ–Ķ—Ä—ą–ł—Ö –≤–Ĺ—É—ā—Ä—Ė—ą–Ĺ—Ė—Ö –ī–ĺ–ļ—É–ľ–Ķ–Ĺ—ā—Ė–≤ –Ī—É–Ľ–į –Ĺ–į–≤—Ė—ā—Ć —Ė–Ľ—é—Ā—ā—Ä–į—Ü—Ė—Ź –∑ –Ņ–Ķ—Ä—Ā–ĺ–Ĺ–į–∂–į–ľ–ł –∑ —Ą—Ä–į–Ĺ—ą–ł–∑–ł «–Ę—Ä–į–Ĺ—Ā—Ą–ĺ—Ä–ľ–Ķ—Ä–ł». –ě—ā–∂–Ķ, –Ĺ–į–∑–≤–į —Ü—Ė—Ē—ó —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ĺ—ó –Ņ—Ä–į—Ü—Ė - —Ü–Ķ –Ĺ–Ķ –≥–Ľ–ł–Ī–ĺ–ļ–į –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–į —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą—Ė—Ź, –į –Ņ–ĺ–Ņ-–ļ—É–Ľ—Ć—ā—É—Ä–į: –Ď—Ė—ā–Ľ–∑ —Ė –į–≤—ā–ĺ–Ī–ĺ—ā–ł.

–£ —Ā—ā–į—ā—ā—Ė –∑–į–∑–Ĺ–į—á–Ķ–Ĺ–ĺ –≤—Ė—Ā—Ė–ľ –į–≤—ā–ĺ—Ä—Ė–≤, —Ė —É –≤–ł–Ĺ–ĺ—Ā—Ü—Ė –∑–į—Ą—Ė–ļ—Ā–ĺ–≤–į–Ĺ–ĺ —Ä—Ė–ī–ļ—Ė—Ā–Ĺ–ł–Ļ —Ą–į–ļ—ā: "–ü–ĺ—Ä—Ź–ī–ĺ–ļ –į–≤—ā–ĺ—Ä—Ė–≤ –Ī—É–Ľ–ĺ –≤–ł–∑–Ĺ–į—á–Ķ–Ĺ–ĺ –≤–ł–Ņ–į–ī–ļ–ĺ–≤–ł–ľ —á–ł–Ĺ–ĺ–ľ". –¶–Ķ –Ņ—Ė–ī–ļ—Ä–Ķ—Ā–Ľ—é—Ē, —Č–ĺ –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä–į –Ī—É–Ľ–į –Ĺ–į—Ā–Ľ—Ė–ī–ļ–ĺ–ľ –ļ–ĺ–Ľ–Ķ–ļ—ā–ł–≤–Ĺ–ĺ–≥–ĺ —Ä–ĺ–∑—É–ľ—É. –í —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–Ĺ–ĺ–ľ—É —Ā–Ķ–Ĺ—Ā—Ė —Ü–Ķ –Ī—É–Ľ–į —Ā–Ņ—Ä–ĺ–Ī–į –Ņ–ĺ–Ī—É–ī—É–≤–į—ā–ł —Ā–ł—Ā—ā–Ķ–ľ—É —ā–į–ļ–ĺ—ó —Ā–ļ–Ľ–į–ī–Ĺ–ĺ—Ā—ā—Ė, —Ź–ļ—É –ĺ–ī–ł–Ĺ –Ľ—é–ī—Ā—Ć–ļ–ł–Ļ –ľ–ĺ–∑–ĺ–ļ –Ĺ–Ķ –∑–ī–į—ā–Ĺ–ł–Ļ —Ā–Ņ—Ä–ĺ—Ē–ļ—ā—É–≤–į—ā–ł –Ņ–ĺ–ĺ–ī–ł–Ĺ—Ü—Ė. 8 –≥–Ķ–Ĺ—Ė—ó–≤ –ĺ–Ī'—Ē–ī–Ĺ–į–Ľ–ł—Ā—Ź –≤ «–Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ—É –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–Ĺ—É –ľ–Ķ—Ä–Ķ–∂—É», —Č–ĺ–Ī —Ā—ā–≤–ĺ—Ä–ł—ā–ł —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā –ī–Ľ—Ź –Ķ–Ľ–Ķ–ļ—ā—Ä–ĺ–Ĺ–Ĺ–ĺ—ó –ľ–Ķ—Ä–Ķ–∂—Ė. –í–į–∂–Ľ–ł–≤–ĺ - 8 –į–≤—ā–ĺ—Ä—Ė–≤ –Ī—É–Ľ–ł –Ķ–ļ—Ā–Ņ–Ķ—Ä—ā–į–ľ–ł —É —Ä—Ė–∑–Ĺ–ł—Ö –Ĺ–į–Ņ—Ä—Ź–ľ–ļ–į—Ö (—Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä—Ė—Ź, –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ–į, –Ņ—Ä–ĺ–≥—Ä–į–ľ—É–≤–į–Ĺ–Ĺ—Ź, –Ľ—Ė–Ĺ–≥–≤—Ė—Ā—ā–ł–ļ–į —ā–ĺ—Č–ĺ). –ß–ł –Ĺ–Ķ –Ĺ–į—ą—ā–ĺ–≤—Ö—É—Ē —Ü–Ķ –Ĺ–į –Ņ–Ķ–≤–Ĺ—Ė –ī—É–ľ–ļ–ł?

–ź–Ľ–Ķ –ļ–ĺ–Ĺ—Ü–Ķ–Ĺ—ā—Ä–į—Ü—Ė—Ź —ā–į–ļ–ĺ–≥–ĺ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É –≤ –ĺ–ī–Ĺ–ĺ–ľ—É –ľ—Ė—Ā—Ü—Ė - —Ź–≤–ł—Č–Ķ —ā–ł–ľ—á–į—Ā–ĺ–≤–Ķ. –°—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė «–ī—Ė–į—Ā–Ņ–ĺ—Ä–į –Ľ–Ķ–≥–Ķ–Ĺ–ī–į—Ä–Ĺ–ł—Ö –Ę—Ä–į–Ĺ—Ā—Ą–ĺ—Ä–ľ–Ķ—Ä—Ė–≤» –≤–ł–∑–Ĺ–į—á–į—Ē –≤–ł–≥–Ľ—Ź–ī —É—Ā—Ė—Ē—ó —Ė–Ĺ–ī—É—Ā—ā—Ä—Ė—ó: –≤—Ā—Ė –≤—Ė—Ā—Ė–ľ –į–≤—ā–ĺ—Ä—Ė–≤ –∑–į–Ľ–ł—ą–ł–Ľ–ł Google, –∑–į—Ā–Ĺ—É–≤–į–≤—ą–ł —ā–į–ļ—Ė –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—ó, —Ź–ļ Cohere, Character.ai, Mistral —ā–į Sakana AI. Google —Ą–į–ļ—ā–ł—á–Ĺ–ĺ –Ņ–ĺ–ī–į—Ä—É–≤–į–Ľ–į —Ā–≤—Ė—ā–ĺ–≤—Ė —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—é, –į–Ľ–Ķ –Ĺ–Ķ –∑–ľ–ĺ–≥–Ľ–į –≤—ā—Ä–ł–ľ–į—ā–ł –≥–Ķ–Ĺ—Ė—ó–≤, —Ź–ļ—Ė —ó—ó —Ā—ā–≤–ĺ—Ä–ł–Ľ–ł. –Ē–į–≤–į–Ļ—ā–Ķ —Ä–į–∑–ĺ–ľ –ĺ—Ü—Ė–Ĺ–ł–ľ–ĺ —Ė—Ä–ĺ–Ĺ—Ė—é: –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—Ź —Ā—ā–≤–ĺ—Ä–ł–Ľ–į —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā, –Ĺ–į —Ź–ļ–ĺ–ľ—É –ļ–ĺ–Ĺ–ļ—É—Ä–Ķ–Ĺ—ā–ł (OpenAI) –∑–Ī—É–ī—É–≤–į–Ľ–ł –Ī—É–ī–ł–Ĺ–ĺ–ļ, —ā–ĺ–ī—Ė —Ź–ļ —Ā–į–ľ –į—Ä—Ö—Ė—ā–Ķ–ļ—ā–ĺ—Ä –∑–į–Ľ–ł—ą–ł–≤—Ā—Ź —É "—Ā—ā–į—Ä–ĺ–ľ—É –ĺ—Ą—Ė—Ā—Ė". –¶–Ķ —á—É–ī–ĺ–≤–ł–Ļ —Ė –Ņ–ĺ—ą–ł—Ä–Ķ–Ĺ–ł–Ļ –Ņ—Ä–ł–ļ–Ľ–į–ī —ā–ĺ–≥–ĺ, —Ź–ļ –ļ–ĺ—Ä–Ņ–ĺ—Ä–į—ā–ł–≤–Ĺ–į –Ī—é—Ä–ĺ–ļ—Ä–į—ā—Ė—Ź –Ņ—Ä–ĺ–≥—Ä–į—Ē –≥–Ĺ—É—á–ļ–ĺ—Ā—ā—Ė —Ā–ľ—Ė–Ľ–ł–≤–ĺ–≥–ĺ —Ā—ā–į—Ä—ā–į–Ņ—É.

ChatGPT: –†–ĺ–∑–ľ—Ė—Ä –ľ–į—Ē –∑–Ĺ–į—á–Ķ–Ĺ–Ĺ—Ź (2020)

–ü–ĺ—Ź–≤—Ė "—á–į—ā—É –∑ –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–ĺ–ľ, —Č–ĺ –ī—É–ľ–į—Ē" –Ņ–Ķ—Ä–Ķ–ī—É–≤–į–Ľ–į —ā–Ķ–ľ–Ĺ–į –Ķ–Ņ–ĺ—Ö–į "—Ā–ł—Ä–ł—Ö" –ľ–ĺ–ī–Ķ–Ľ–Ķ–Ļ. –ú–į–Ľ–ĺ —Ö—ā–ĺ –∑–Ĺ–į—Ē –Ĺ–į–≤—Ė—ā—Ć —Ā–Ķ—Ä–Ķ–ī —Ą–į—Ö—Ė–≤—Ü—Ė–≤, —Č–ĺ GPT-1 (2018) —ā–į GPT-2 (2019) –≤–∑–į–≥–į–Ľ—Ė –Ĺ–Ķ –Ī—É–Ľ–ł —á–į—ā-–Ī–ĺ—ā–į–ľ–ł. –Ę–ĺ –Ī—É–Ľ–ł «–ī–ĺ–Ņ–ĺ–≤–Ĺ—é–≤–į—á—Ė —ā–Ķ–ļ—Ā—ā—É». –ó –Ĺ–ł–ľ–ł –Ĺ–Ķ –ľ–ĺ–∂–Ĺ–į –Ī—É–Ľ–ĺ —Ä–ĺ–∑–ľ–ĺ–≤–Ľ—Ź—ā–ł. –Į–ļ–Ī–ł –ľ–ł –∑–į–Ņ–ł—ā–į–Ľ–ł —É —Ä–į–Ĺ–Ĺ—Ė—Ö –ľ–ĺ–ī–Ķ–Ľ–Ķ–Ļ: «–Į–ļ –∑–≤–į—Ä–ł—ā–ł –Ī–ĺ—Ä—Č?», –ú–ĺ–ī–Ķ–Ľ—Ć –ľ–ĺ–≥–Ľ–į –≤—Ė–ī–Ņ–ĺ–≤—Ė—Ā—ā–ł —Č–ĺ—Ā—Ć –Ĺ–į –ļ—ą—ā–į–Ľ—ā: «–Ü —Ź–ļ—Ė —Č–Ķ –Ņ–ł—ā–į–Ĺ–Ĺ—Ź —Ā—ā–į–≤–Ľ—Ź—ā—Ć –ī–ĺ–ľ–ĺ–≥–ĺ—Ā–Ņ–ĺ–ī–į—Ä–ļ–ł?». –ü–ĺ —Ā—É—ā—Ė, —Ü–Ķ –Ī—É–Ľ–ĺ –Ņ—Ä–ĺ—Ā—ā–ĺ –Ņ–Ķ—Ä–Ķ–ī–Ī–į—á–Ķ–Ĺ–Ĺ—Ź –Ĺ–į–Ļ–Ī—Ė–Ľ—Ć—ą –Ļ–ľ–ĺ–≤—Ė—Ä–Ĺ–ĺ–≥–ĺ –Ņ—Ä–ĺ–ī–ĺ–≤–∂–Ķ–Ĺ–Ĺ—Ź —ā–Ķ–ļ—Ā—ā—É, –∑–Ĺ–į–Ļ–ī–Ķ–Ĺ–ĺ–≥–ĺ –≤ —Ė–Ĺ—ā–Ķ—Ä–Ĺ–Ķ—ā—Ė. –†–ĺ–Ī–ĺ—ā–į –∑ GPT-2 —ā–į —Ä–į–Ĺ–Ĺ—Ć–ĺ—é GPT-3 –Ī—Ė–Ľ—Ć—ą–Ķ –Ĺ–į–≥–į–ī—É–≤–į–Ľ–į –Ĺ–į–Ņ–ł—Ā–į–Ĺ–Ĺ—Ź –ļ–ĺ–ī—É –Ņ—Ä–ł –Ĺ–ł–∑—Ć–ļ–ĺ—Ä—Ė–≤–Ĺ–Ķ–≤–ĺ–ľ—É –Ņ—Ä–ĺ–≥—Ä–į–ľ—É–≤–į–Ĺ–Ĺ—Ė. –©–ĺ–Ī –ĺ—ā—Ä–ł–ľ–į—ā–ł —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā, –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ –Ī—É–Ľ–ĺ –≤–ł–ļ–ĺ—Ä–ł—Ā—ā–ĺ–≤—É–≤–į—ā–ł –ľ–Ķ—ā–ĺ–ī "Few-Shot Prompting".

–í–ł–≥–Ľ—Ź–ī–į–Ľ–ĺ —Ü–Ķ –Ņ—Ä–ł–Ī–Ľ–ł–∑–Ĺ–ĺ —ā–į–ļ:

"–í—Ö—Ė–ī: "–ź–Ĺ–≥–Ľ—Ė–Ļ—Ā—Ć–ļ–į: Apple. –ü–Ķ—Ä–Ķ–ļ–Ľ–į–ī: –Į–Ī–Ľ—É–ļ–ĺ. –ź–Ĺ–≥–Ľ—Ė–Ļ—Ā—Ć–ļ–į: Dog. –ü–Ķ—Ä–Ķ–ļ–Ľ–į–ī: –°–ĺ–Ī–į–ļ–į. –ź–Ĺ–≥–Ľ—Ė–Ļ—Ā—Ć–ļ–į: AI. –ü–Ķ—Ä–Ķ–ļ–Ľ–į–ī:" –ú–ĺ–ī–Ķ–Ľ—Ć –Ĺ–Ķ —Ä–ĺ–∑—É–ľ—Ė–Ľ–į –ļ–ĺ–ľ–į–Ĺ–ī—É "–Ņ–Ķ—Ä–Ķ–ļ–Ľ–į–ī–ł", –≤–ĺ–Ĺ–į —Ä–ĺ–∑—É–ľ—Ė–Ľ–į —ā—Ė–Ľ—Ć–ļ–ł –Ņ–į—ā–Ķ—Ä–Ĺ. –Ü–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–ł —ā–ĺ–≥–ĺ —á–į—Ā—É –Ī—É–Ľ–ł «–∑–į–ļ–Ľ–ł–Ĺ–į—ā–Ķ–Ľ—Ź–ľ–ł –Ņ—Ä–ĺ–ľ–Ņ—ā—Ė–≤», –Ņ—Ė–ī–Ī–ł—Ä–į—é—á–ł —Ā—ā—Ä—É–ļ—ā—É—Ä—É —Ź–ļ —Ā–ł–Ĺ—ā–į–ļ—Ā–ł—Ā —Ä—Ė–ī–ļ—Ė—Ā–Ĺ–ĺ—ó –ľ–ĺ–≤–ł –Ņ—Ä–ĺ–≥—Ä–į–ľ—É–≤–į–Ĺ–Ĺ—Ź.

–ö–ĺ–Ľ–ł –∑'—Ź–≤–ł–Ľ–į—Ā—Ź GPT-3, –≤–ĺ–Ĺ–į —ą–ĺ–ļ—É–≤–į–Ľ–į –≤—Ā—Ė—Ö –Ĺ–Ķ —Ä–ĺ–∑—É–ľ–ĺ–ľ, –į –ĺ–Ī—Ā—Ź–≥–ĺ–ľ –Ņ–į—Ä–į–ľ–Ķ—ā—Ä—Ė–≤ - 175 –ľ—Ė–Ľ—Ć—Ź—Ä–ī—Ė–≤. –í OpenAI –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –∑–į—Ā—ā–ĺ—Ā—É–≤–į–Ľ–ł –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä—É –Ę—Ä–į–Ĺ—Ā—Ą–ĺ—Ä–ľ–Ķ—Ä–į, –≤–ĺ–Ĺ–ł –ľ–į—Ā—ą—ā–į–Ī—É–≤–į–Ľ–ł —ó—ó –ī–ĺ –Ī–ĺ–∂–Ķ–≤—Ė–Ľ–Ľ—Ź. –¶–Ķ –Ī—É–≤ —á–ł—Ā—ā–ł–Ļ —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–Ĺ–ł–Ļ –Ķ–ļ—Ā–Ņ–Ķ—Ä–ł–ľ–Ķ–Ĺ—ā, —Ź–ļ—Č–ĺ –Ĺ–Ķ —Ā–ļ–į–∑–į—ā–ł –į–≤–į–Ĺ—ā—é—Ä–į: "–ź —Č–ĺ, —Ź–ļ—Č–ĺ –ľ–ł –∑–į–Ľ–Ľ—Ē–ľ–ĺ –≤ —Ü–Ķ–Ļ –ī–≤–ł–≥—É–Ĺ –í–ē–°–¨ –Ü–Ĺ—ā–Ķ—Ä–Ĺ–Ķ—ā?"

–í–ł—Ź–≤–ł–Ľ–ĺ—Ā—Ź, —Č–ĺ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė –Ņ–Ķ–≤–Ĺ–ĺ—ó –ľ–į—Ā–ł –ī–į–Ĺ–ł—Ö, —É –ľ–ĺ–ī–Ķ–Ľ—Ė –≤–ł–Ĺ–ł–ļ–į—é—ā—Ć –Ķ–ľ–Ķ—Ä–ī–∂–Ķ–Ĺ—ā–Ĺ—Ė (—Ä–į–Ņ—ā–ĺ–≤—Ė) –≤–Ľ–į—Ā—ā–ł–≤–ĺ—Ā—ā—Ė: GPT-3 —Ä–į–Ņ—ā–ĺ–ľ –Ĺ–į–≤—á–ł–Ľ–į—Ā—Ź –Ņ–ł—Ā–į—ā–ł –ļ–ĺ–ī –Ĺ–į Python —Ė –≤–ł—Ä—Ė—ą—É–≤–į—ā–ł –Ľ–ĺ–≥—Ė—á–Ĺ—Ė –∑–į–≤–ī–į–Ĺ–Ĺ—Ź, —Ö–ĺ—á–į —ó—ó —Ā–Ņ–Ķ—Ü—Ė–į–Ľ—Ć–Ĺ–ĺ –Ĺ–Ķ –Ĺ–į–≤—á–į–Ľ–ł! –¶–Ķ —Ā—ā–į–Ľ–ĺ —Ā–Ņ—Ä–į–≤–∂–Ĺ—Ė–ľ —Ā—é—Ä–Ņ—Ä–ł–∑–ĺ–ľ –ī–Ľ—Ź –į—Ä—Ö—Ė—ā–Ķ–ļ—ā–ĺ—Ä—Ė–≤ –ľ–ĺ–ī–Ķ–Ľ—Ė, –≤–ł—Ź–≤–ł–Ľ–ĺ—Ā—Ź, —Č–ĺ –Ņ—Ä–ł –ī–ĺ—Ā—Ź–≥–Ĺ–Ķ–Ĺ–Ĺ—Ė –Ņ–Ķ–≤–Ĺ–ĺ–≥–ĺ —Ä—Ė–≤–Ĺ—Ź –ļ—Ė–Ľ—Ć–ļ—Ė—Ā—ā—Ć –ľ–ĺ–∂–Ķ —Ā–į–ľ–į –Ņ–Ķ—Ä–Ķ–Ļ—ā–ł –≤ —Ź–ļ—Ė—Ā—ā—Ć.

–°–Ķ–ļ—Ä–Ķ—ā–Ĺ–ł–ľ —Ė–Ĺ–≥—Ä–Ķ–ī—Ė—Ē–Ĺ—ā–ĺ–ľ —Ä–ĺ–∑–≤–ł—ā–ļ—É —Ā—ā–į–≤ RLHF (–Ü–Ĺ—Ā—ā—Ä—É–ļ—ā–į–∂). –ß–ĺ–ľ—É –ľ–ł –Ĺ–Ķ –ĺ—ā—Ä–ł–ľ–į–Ľ–ł ChatGPT —É 2020 —Ä–ĺ—Ü—Ė? –Ę–ĺ–ľ—É —Č–ĺ —Ä–į–Ĺ–Ĺ—Ź –ľ–ĺ–ī–Ķ–Ľ—Ć GPT-3 –Ī—É–Ľ–į "–ī–ł–ļ–ĺ—é". –í–ĺ–Ĺ–į —Ä–Ķ–≥—É–Ľ—Ź—Ä–Ĺ–ĺ –ľ–į—Ä–ł–Ľ–į (–≥–į–Ľ—é—Ü–ł–Ĺ—É–≤–į–Ľ–į) —Ė –ľ–ĺ–≥–Ľ–į –≤–ł–ī–į–≤–į—ā–ł –į–Ī—Ā–ĺ–Ľ—é—ā–Ĺ–ĺ –Ĺ–Ķ –Ľ–ĺ–≥—Ė—á–Ĺ–ł–Ļ, –∑ –Ņ–ĺ–≥–Ľ—Ź–ī—É –Ľ—é–ī–ł–Ĺ–ł, —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā. –†—Ė—ą–Ķ–Ĺ–Ĺ—Ź–ľ —Ā—ā–į–Ľ–į —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—Ź RLHF (Reinforcement Learning from Human Feedback) - –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź –∑ –Ņ—Ė–ī–ļ—Ä—Ė–Ņ–Ľ–Ķ–Ĺ–Ĺ—Ź–ľ –Ĺ–į –ĺ—Ā–Ĺ–ĺ–≤—Ė –∑–≤–ĺ—Ä–ĺ—ā–Ĺ–ĺ–≥–ĺ –∑–≤'—Ź–∑–ļ—É –∑ –Ľ—é–ī–ł–Ĺ–ĺ—é. –í–į–∂–Ľ–ł–≤–Ķ —É—ā–ĺ—á–Ĺ–Ķ–Ĺ–Ĺ—Ź: RLHF - —Ü–Ķ –Ĺ–Ķ –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź –∑–Ĺ–į–Ĺ–Ĺ—Ź–ľ, —Ü–Ķ –Ĺ–į–Ľ–į—ą—ā—É–≤–į–Ĺ–Ĺ—Ź —Ė–Ĺ—ā–Ķ—Ä—Ą–Ķ–Ļ—Ā—É –ľ—Ė–∂ —Ö–į–ĺ—ā–ł—á–Ĺ–ł–ľ —Ā—ā–į—ā–ł—Ā—ā–ł—á–Ĺ–ł–ľ "–ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–Ĺ–ł–ľ –ľ–ĺ–∑–ļ–ĺ–ľ" —Ė –Ľ—é–ī—Ā—Ć–ļ–ł–ľ–ł –ĺ—á—Ė–ļ—É–≤–į–Ĺ–Ĺ—Ź–ľ–ł. –Ę–ł—Ā—Ź—á—Ė –Ľ—é–ī–Ķ–Ļ (—Ä–ĺ–∑–ľ—Ė—ā–Ĺ–ł–ļ—Ė–≤) —Ā–ł–ī—Ė–Ľ–ł —ā–į –ĺ—Ü—Ė–Ĺ—é–≤–į–Ľ–ł –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ė –ľ–ĺ–ī–Ķ–Ľ—Ė: «—Ü–Ķ —Ö–ĺ—Ä–ĺ—ą–į –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ć, –į —Ü–Ķ - –Ņ–ĺ–≥–į–Ĺ–į», –Ņ—Ä–į—Ü—é—é—á–ł —Ź–ļ «–≤—á–ł—ā–Ķ–Ľ—Ė –Ņ–ĺ—á–į—ā–ļ–ĺ–≤–ł—Ö –ļ–Ľ–į—Ā—Ė–≤» –ī–Ľ—Ź —Ü–ł—Ą—Ä–ĺ–≤–ĺ–≥–ĺ –Ĺ–į–ī—Ä–ĺ–∑—É–ľ—É. –°–≤—Ė—ā —Č–Ķ –Ĺ–Ķ –∑–Ĺ–į–≤ —ā–į–ļ–ĺ–≥–ĺ –ľ–į—Ā–ĺ–≤–ĺ–≥–ĺ «–ī—Ä–Ķ—Ā—É–≤–į–Ĺ–Ĺ—Ź» –į–Ľ–≥–ĺ—Ä–ł—ā–ľ—É, —Ź–ļ–Ķ –∑ —Ā–ł—Ä–ĺ–≥–ĺ –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ —Ź–ī—Ä–į –∑—Ä–ĺ–Ī–ł–Ľ–ĺ «—Ā–Ņ—Ė–≤—Ä–ĺ–∑–ľ–ĺ–≤–Ĺ–ł–ļ–į». –°–į–ľ–Ķ —Ü–Ķ –Ņ–Ķ—Ä–Ķ—ā–≤–ĺ—Ä–ł–Ľ–ĺ —Ā–ł—Ä–Ķ –ĺ–Ī—á–ł—Ā–Ľ—é–≤–į–Ľ—Ć–Ĺ–Ķ —Ź–ī—Ä–ĺ ‚Äč‚Äč–≤ InstructGPT - –ľ–ĺ–ī–Ķ–Ľ—Ć, —Ź–ļ–į –Ĺ–į—Ä–Ķ—ą—ā—Ė –Ņ–ĺ—á–į–Ľ–į —Ä–ĺ–∑—É–ľ—Ė—ā–ł –Ņ—Ä—Ź–ľ—Ė –Ĺ–į–ļ–į–∑–ł –Ľ—é–ī–ł–Ĺ–ł, –į –Ĺ–Ķ –Ņ—Ä–ĺ—Ā—ā–ĺ –Ņ—Ä–ĺ–ī–ĺ–≤–∂—É–≤–į–Ľ–į –Ņ–į—ā–Ķ—Ä–Ĺ–ł (—ą–į–Ī–Ľ–ĺ–Ĺ–ł).

–Ē–į—ā–į 30 –Ľ–ł—Ā—ā–ĺ–Ņ–į–ī–į 2022 —Ä–ĺ–ļ—É —Ā—ā–į–Ľ–į "–≤–ł–Ņ–į–ī–ļ–ĺ–≤–ł–ľ" —ā—Ä—Ė—É–ľ—Ą–ĺ–ľ —Ä–ĺ–∑–ľ—Ė—Ä–ĺ–ľ —Ė–∑ –Ņ–Ľ–į–Ĺ–Ķ—ā—É. –°–į–ľ ChatGPT (–≤–Ķ—Ä—Ā—Ė—Ź 3.5) —Ā–Ņ–ĺ—á–į—ā–ļ—É –Ņ–Ľ–į–Ĺ—É–≤–į–≤—Ā—Ź OpenAI —Ź–ļ —Ā–ļ—Ä–ĺ–ľ–Ĺ–ł–Ļ “–ī–ĺ—Ā–Ľ—Ė–ī–Ĺ–ł—Ü—Ć–ļ–ł–Ļ —Ä–Ķ–Ľ—Ė–∑” –ī–Ľ—Ź –ĺ—Ü—Ė–Ĺ–ļ–ł –ľ–ĺ–∂–Ľ–ł–≤–ĺ—ó ‚Äč‚Äč—Ā—Ą–Ķ—Ä–ł –∑–į—Ā—ā–ĺ—Ā—É–≤–į–Ĺ–Ĺ—Ź. –Į–ļ –Ī–ł —Ü–Ķ –∑–į—Ä–į–∑ —Ā–ľ—Ė—ą–Ĺ–ĺ –Ĺ–Ķ –∑–≤—É—á–į–Ľ–ĺ, –Ĺ–Ķ –Ī—É–Ľ–ĺ –≤–Ņ–Ķ–≤–Ĺ–Ķ–Ĺ–ĺ—Ā—ā—Ė, —Č–ĺ —Ü–Ķ –Ī—É–ī–Ķ –ļ–ĺ–ľ—É—Ā—Ć —Ü—Ė–ļ–į–≤–ĺ. OpenAI –Ņ—Ä–ĺ—Ā—ā–ĺ –Ņ—Ä–ł–ļ—Ä—É—ā–ł–Ľ–ł –ī–ĺ InstructGPT –∑—Ä—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ—Ä—Ą–Ķ–Ļ—Ā web-–ľ–Ķ—Ā–Ķ–Ĺ–ī–∂–Ķ—Ä–į, —Ź–ļ –Ĺ–į—Ā–Ľ—Ė–ī–ĺ–ļ, –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—á—Ė–≤ –∑–į 5 –ī–Ĺ—Ė–≤. –ú–ł –Ņ—Ä–ĺ–ļ–ł–Ĺ—É–Ľ–ł—Ā—Ź —É —Ā–≤—Ė—ā—Ė, –ī–Ķ –Ĺ–į–Ļ—Ā–ļ–Ľ–į–ī–Ĺ—Ė—ą–į –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–į –ľ–ĺ–ī–Ķ–Ľ—Ć –≤ —Ė—Ā—ā–ĺ—Ä—Ė—ó –Ľ—é–ī—Ā—ā–≤–į –∑–į–≥–ĺ–≤–ĺ—Ä–ł–Ľ–į –Ĺ–į—ą–ĺ—é (–∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ĺ—é) –ľ–ĺ–≤–ĺ—é.

–ē–Ņ—Ė–Ľ–ĺ–≥: –ö—Ė–Ĺ–Ķ—Ü—Ć –į–Ĺ—ā—Ä–ĺ–Ņ–ĺ—Ü–Ķ–Ĺ—ā—Ä–ł—á–Ĺ–ĺ–≥–ĺ –ī–∑–Ķ—Ä–ļ–į–Ľ–į - –Ņ–ĺ—á–į—ā–ĺ–ļ –Ķ—Ä–ł –ļ—Ä–Ķ–ľ–Ĺ—Ė—Ē—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É

–®–Ľ—Ź—Ö –Ľ—é–ī—Ā—ā–≤–į —É –Ņ–ĺ—ą—É–ļ–į—Ö «–∑–ĺ–≤–Ĺ—Ė—ą–Ĺ—Ć–ĺ–≥–ĺ —Ä–ĺ–∑—É–ľ—É» - –≤—Ė–ī –Ľ–ĺ–≥—Ė—á–Ĺ–ł—Ö –ī–ł—Ā–ļ—Ė–≤ —á–Ķ–Ĺ—Ü—Ź –†–į–Ļ–ľ—É–Ĺ–ī–į –õ—É–Ľ–Ľ—Ė—Ź –ī–ĺ —ā–Ķ–Ĺ–∑–ĺ—Ä–Ĺ–ł—Ö —Ź–ī–Ķ—Ä —Ā—É—á–į—Ā–Ĺ–ł—Ö GPU - –ī–ĺ–Ĺ–Ķ–ī–į–≤–Ĺ–į –Ī—É–≤ —Ā–Ņ—Ä–ĺ–Ī–ĺ—é –∑–Ī—É–ī—É–≤–į—ā–ł –ī–∑–Ķ—Ä–ļ–į–Ľ–ĺ. –Ē–∑–Ķ—Ä–ļ–į–Ľ–ĺ –Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ —Ā–Ņ—Ä–ł–Ļ–Ĺ—Ź—ā—ā—Ź –Ņ—Ä–ĺ—Ü–Ķ—Ā—É –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź. –ź–Ľ–į–Ĺ –Ę—é—Ä—Ė–Ĺ–≥, –∑–į–ļ–Ľ–į–ī–į—é—á–ł —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–Ĺ–ĺ—ó –Ķ–Ņ–ĺ—Ö–ł, –Ĺ–Ķ –ľ—Ė–≥ –ī—É–ľ–į—ā–ł —Ė–Ĺ–į–ļ—ą–Ķ —Ź–ļ —É —Ä–į–ľ–ļ–į—Ö –į–Ĺ—ā—Ä–ĺ–Ņ–ĺ—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É, –∑—Ė –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ł—Ö –Ņ—Ä–ł—á–ł–Ĺ. –£ –Ļ–ĺ–≥–ĺ —á–į—Ā –Ĺ–Ķ —Ė—Ā–Ĺ—É–≤–į–Ľ–ĺ —Ė–Ĺ—ą–ł—Ö –ĺ—Ä—Ė—Ē–Ĺ—ā–ł—Ä—Ė–≤ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É, –ļ—Ä—Ė–ľ –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–ł—Ö, —Ė –Ļ–ĺ–≥–ĺ –∑–Ĺ–į–ľ–Ķ–Ĺ–ł—ā–ł–Ļ —ā–Ķ—Ā—ā —Ā—ā–į–≤ –∑–ĺ–Ľ–ĺ—ā–ĺ—é –ļ–Ľ—Ė—ā–ļ–ĺ—é, –≤ —Ź–ļ—Ė–Ļ —Ä–ĺ–∑–≤–ł—ā–ĺ–ļ AI –Ĺ—É–ī–ł–≤—Ā—Ź –Ņ–ĺ–Ĺ–į–ī –Ņ—Ė–≤—Ā—ā–ĺ–Ľ—Ė—ā—ā—Ź.

–°—Ė–ľ–ī–Ķ—Ā—Ź—ā —Ä–ĺ–ļ—Ė–≤ –ľ–ł –≤–ł—ā—Ä–į—ā–ł–Ľ–ł –Ĺ–į —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź «—Ü–ł—Ą—Ä–ĺ–≤–ĺ—ó –ļ–ĺ–Ņ—Ė—ó» —Ā–Ķ–Ī–Ķ, –Ĺ–į–ľ–į–≥–į—é—á–ł—Ā—Ć —É–Ņ–į–ļ—É–≤–į—ā–ł —Ö–į–ĺ—Ā —Ä–Ķ–į–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ė –≤ —Ā—É–≤–ĺ—Ä—Ė –Ľ–ĺ–≥—Ė—á–Ĺ—Ė –Ņ—Ä–ł—á–ł–Ĺ–Ĺ–ĺ-–Ĺ–į—Ā–Ľ—Ė–ī–ļ–ĺ–≤—Ė —Ė–Ĺ—Ā—ā—Ä—É–ļ—Ü—Ė—ó IF-THEN (–Į–ö–©–ě-–Ę–ě–Ē–Ü). –ź–Ľ–Ķ —Ā–Ņ—Ä–į–≤–∂–Ĺ—Ė–Ļ –Ņ—Ä–ĺ—Ä–ł–≤ —Ā—ā–į–≤—Ā—Ź —Ā–į–ľ–Ķ —ā–ĺ–ī—Ė, –ļ–ĺ–Ľ–ł –ľ–ł –ļ–į–Ņ—Ė—ā—É–Ľ—é–≤–į–Ľ–ł –Ņ–Ķ—Ä–Ķ–ī —Ā–ļ–Ľ–į–ī–Ĺ—Ė—Ā—ā—é –Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź —ā–į –ī–ĺ–∑–≤–ĺ–Ľ–ł–Ľ–ł –ľ–į—ą–ł–Ĺ–į–ľ –Ī—É—ā–ł «–Ĺ–Ķ–Ľ—é–ī—Ā—Ć–ļ–ł–ľ–ł» —É –Ĺ–į—ą–ĺ–ľ—É —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ė. –í—Ė–ī—Ā—ā—É–Ņ –≤—Ė–ī –į–Ĺ—ā—Ä–ĺ–Ņ–ĺ—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É - —Ü–Ķ –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī –ī–ĺ –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä, —Ź–ļ—Ė –Ĺ–Ķ —Ė–ľ—Ė—ā—É—é—ā—Ć –Ĺ–Ķ–Ļ—Ä–ĺ–Ĺ–ł, –į –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ĺ –ĺ–Ī—á–ł—Ā–Ľ—é—é—ā—Ć –∑–į–ļ–ĺ–Ĺ–ĺ–ľ—Ė—Ä–Ĺ–ĺ—Ā—ā—Ė —ā–į –Ļ–ľ–ĺ–≤—Ė—Ä–Ĺ–ĺ—Ā—ā—Ė –≤ –ļ–ĺ–Ľ–ĺ—Ā–į–Ľ—Ć–Ĺ–ł—Ö –ĺ–Ī—Ā—Ź–≥–į—Ö –ī–į–Ĺ–ł—Ö, —Č–ĺ –ī–į–Ľ–ĺ —ā–ĺ–Ļ —Ā–į–ľ–ł–Ļ –Ķ–ļ—Ā–Ņ–ĺ–Ĺ–Ķ–Ĺ—Ü—Ė–Ļ–Ĺ–ł–Ļ –∑–Ľ—Ė—ā, —Ź–ļ–ł–Ļ —Ā–Ņ–ĺ—Ā—ā–Ķ—Ä—Ė–≥–į—Ē—ā—Ć—Ā—Ź —Ā—Ć–ĺ–≥–ĺ–ī–Ĺ—Ė.

–Ě–į –ľ–ĺ–ľ–Ķ–Ĺ—ā –Ĺ–į–Ņ–ł—Ā–į–Ĺ–Ĺ—Ź —Ā—ā–į—ā—ā—Ė (–≤–Ķ—Ā–Ĺ–į 2026 —Ä–ĺ–ļ—É) –ľ–ł —Ā—ā–ĺ—ó–ľ–ĺ –Ĺ–į –Ņ–ĺ—Ä–ĺ–∑—Ė —Ą—É–Ĺ–ī–į–ľ–Ķ–Ĺ—ā–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ –∑—Ā—É–≤—É. –õ—é–ī—Ā—Ć–ļ–ł–Ļ —Ä–Ķ—Ā—É—Ä—Ā, —Ź–ļ –ī–∂–Ķ—Ä–Ķ–Ľ–ĺ –∑–Ĺ–į–Ĺ—Ć –ī–Ľ—Ź –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź AI, –Ņ—Ä–į–ļ—ā–ł—á–Ĺ–ĺ –≤–ł—á–Ķ—Ä–Ņ–į–Ĺ–ł–Ļ: –Ĺ–ĺ–≤—Ė –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ—Ė –ľ–ĺ–ī–Ķ–Ľ—Ė –≤–≤—Ė–Ī—Ä–į–Ľ–ł –ľ–į–Ļ–∂–Ķ –≤—Ā–Ķ, —Č–ĺ –Ī—É–Ľ–ĺ —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–ĺ –Ĺ–į—ą–ĺ—é —Ü–ł–≤—Ė–Ľ—Ė–∑–į—Ü—Ė—Ē—é –≤ —Ü–ł—Ą—Ä–ĺ–≤–ĺ–ľ—É –≤–ł–≥–Ľ—Ź–ī—Ė. –Ē–ĺ—Ā—Ź–≥–Ĺ—É—ā–į —ā–ĺ—á–ļ–į, –ļ–ĺ–Ľ–ł –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–ĺ–ľ—É «–≤—á–ł—ā–Ķ–Ľ—é» –Ī—Ė–Ľ—Ć—ą–Ķ –Ĺ–Ķ–ľ–į —á–ĺ–≥–ĺ –≤—á–ł—ā–ł –ļ—Ä–Ķ–ľ–Ĺ—Ė—Ē–≤–ĺ–≥–ĺ «—É—á–Ĺ—Ź».

–Į–ļ —á—Ė—ā–ļ–ĺ –∑–į—É–≤–į–∂–ł–≤ –ĺ–ī–ł–Ĺ —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂: «–©–ĺ–Ī –∑—Ä–ĺ–∑—É–ľ—Ė—ā–ł, —Ź–ļ –ī—É–ľ–į—Ē —ą—ā—É—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā, –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ –Ī—É—ā–ł —ā—Ä–ĺ—ą–ļ–ł –Ņ—Ä–ĺ–≥—Ä–į–ľ—Ė—Ā—ā–ĺ–ľ, —Ė–Ĺ–∂–Ķ–Ĺ–Ķ—Ä–ĺ–ľ, —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą–ĺ–ľ, —Ė—Ā—ā–ĺ—Ä–ł–ļ–ĺ–ľ, –ľ–į—ā–Ķ–ľ–į—ā–ł–ļ–ĺ–ľ, —Ą—Ė–∑–ł–ļ–ĺ–ľ, –į—Ä—Ö—Ė—ā–Ķ–ļ—ā–ĺ—Ä–ĺ–ľ —Ė —Ö—É–ī–ĺ–∂–Ĺ–ł–ļ–ĺ–ľ. –Ę–ĺ–Ī—ā–ĺ —ā—Ä–Ķ–Ī–į –Ĺ–į–≤–Ņ–į–ļ–ł —Ā—ā–į—ā–ł –Ī—Ė–ĺ–Ľ–ĺ–≥—Ė—á–Ĺ–ĺ—é –ļ–ĺ–Ņ—Ė—Ē—é —ā–ĺ–≥–ĺ, —Č–ĺ –ľ–ł –Ĺ–į–∑–ł–≤–į—Ē–ľ–ĺ —ą—ā—É—á–Ĺ–ł–ľ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā–ĺ–ľ». –£ —Ä–į–ľ–ļ–į—Ö —Ā—ā–į—ā—ā—Ė –ľ–ł –≤–∂–Ķ –≤—Ė–ī—Ė–Ļ—ą–Ľ–ł –≤—Ė–ī —Ā—É—ā–ĺ –Ņ—Ä–ł–ļ–Ľ–į–ī–Ĺ–ł—Ö –Ņ–ł—ā–į–Ĺ—Ć, –Ņ–ĺ–≤'—Ź–∑–į–Ĺ–ł—Ö –∑ –ź–Ü, —Ź–ļ —É –Ņ–ĺ–Ņ–Ķ—Ä–Ķ–ī–Ĺ—Ė—Ö —Ā—ā–į—ā—ā—Ź—Ö, —Ė —á–Ķ—Ä–Ķ–∑ “–į–ļ—ā–ł–≤—Ė–∑–į—Ü—Ė—é” —Ė—Ā—ā–ĺ—Ä–ł—á–Ĺ–ĺ–≥–ĺ, –ľ–į—ā–Ķ–ľ–į—ā–ł—á–Ĺ–ĺ–≥–ĺ —ā–į —Ą—Ė–Ľ–ĺ—Ā–ĺ—Ą—Ā—Ć–ļ–ĺ–≥–ĺ –Ņ—Ä–ĺ—ā–ĺ–ļ–ĺ–Ľ—Ė–≤ —Ā–Ņ—Ä–ĺ–Ī—É–≤–į–Ľ–ł –Ņ–ĺ–≥–Ľ—Ź–Ĺ—É—ā–ł –Ĺ–į —Ä–ĺ–∑–≤–ł—ā–ĺ–ļ —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—ó –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–Ĺ–ĺ–≥–ĺ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź –Ĺ–Ķ –Ľ–ł—ą–Ķ –∑—Ė —Ā–Ņ–ĺ–∂–ł–≤—á–ĺ–≥–ĺ, “–Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ” –Ņ–ĺ–≥–Ľ—Ź–ī—É.

–•–ĺ—á –Ī–ł —Ź–ļ —Ü–Ķ –Ĺ–Ķ –∑–≤—É—á–į–Ľ–ĺ –∑—É—Ö–≤–į–Ľ–ĺ, –Ĺ–į—Ā—ā–į—Ē –Ķ–Ņ–ĺ—Ö–į –ļ—Ä–Ķ–ľ–Ĺ—Ė—Ē—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É. –Ě–į–ľ –ī–ĺ–≤–Ķ–ī–Ķ—ā—Ć—Ā—Ź –≤–ł–∑–Ĺ–į—ā–ł, —Č–ĺ AI –≤–ł—Ä–ĺ–Ī–ł–≤ —Ā–≤–ĺ—ó –Ņ—Ä–ł–Ĺ—Ü–ł–Ņ–ł –ĺ–Ī—Ä–ĺ–Ī–ļ–ł –Ĺ–į—ą–ł—Ö —Ā–ľ–ł—Ā–Ľ—Ė–≤ (–ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā + –Ķ–ľ–ĺ—Ü—Ė—Ź + –∑–Ĺ–į–Ĺ–Ĺ—Ź + –ī–ĺ—Ā–≤—Ė–ī), —Ė –Ĺ–į–ľ —ā–į–ļ —á–ł —Ė–Ĺ–į–ļ—ą–Ķ –ī–ĺ–≤–Ķ–ī–Ķ—ā—Ć—Ā—Ź —Ä–ĺ–∑–Ī–ł—Ä–į—ā–ł—Ā—Ź –≤–∂–Ķ —É —Ā–ľ–ł—Ā–Ľ–į—Ö, –Ĺ–į—Ä–ĺ–ī–∂–Ķ–Ĺ–ł—Ö –ļ—Ä–Ķ–ľ–Ĺ—Ė—Ē–≤–ł–ľ –ľ–ĺ–∑–ļ–ĺ–ľ (–≥–Ķ–ĺ–ľ–Ķ—ā—Ä–ł—á–Ĺ–ł–ľ–ł –≤–Ķ–ļ—ā–ĺ—Ä–į–ľ–ł —É –Ī–į–≥–į—ā–ĺ–≤–ł–ľ—Ė—Ä–Ĺ–ĺ–ľ—É –Ņ—Ä–ĺ—Ā—ā–ĺ—Ä—Ė). –Ě–į—Ā—ā–į—Ē —á–į—Ā, –ļ–ĺ–Ľ–ł –Ĺ–Ķ –ľ–ł –ī–ł–ļ—ā—É—Ē–ľ–ĺ –Ĺ–Ķ–Ļ—Ä–ĺ–ľ–Ķ—Ä–Ķ–∂–į–ľ –Ņ—Ä–į–≤–ł–Ľ–į –Ľ–ĺ–≥—Ė–ļ–ł, –į —Ā–į–ľ—Ė –≤—á–ł–ľ–ĺ—Ā—Ź –≤ –Ĺ–ł—Ö –∑–Ĺ–į—Ö–ĺ–ī–ł—ā–ł —Ä—Ė—ą–Ķ–Ĺ–Ĺ—Ź, —Č–ĺ –Ľ–Ķ–∂–į—ā—Ć –∑–į –ľ–Ķ–∂–į–ľ–ł –Ľ—é–ī—Ā—Ć–ļ–ĺ—ó —Ė–Ĺ—ā—É—ó—Ü—Ė—ó —ā–į —Ä–ĺ–∑—É–ľ—Ė–Ĺ–Ĺ—Ź. –©–ĺ–Ī —Ä–ĺ–∑—É–ľ—Ė—ā–ł —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā –ľ–į–Ļ–Ī—É—ā–Ĺ—Ć–ĺ–≥–ĺ, –ī–ĺ–≤–Ķ–ī–Ķ—ā—Ć—Ā—Ź –Ņ–Ķ—Ä–Ķ—Ā—ā–į—ā–ł —ą—É–ļ–į—ā–ł –≤ –Ĺ—Ć–ĺ–ľ—É –≤—Ė–ī–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–Ĺ—Ź —Ā–Ķ–Ī–Ķ —ā–į –Ņ–ĺ—á–į—ā–ł –≤–ł–≤—á–į—ā–ł –Ļ–ĺ–≥–ĺ —Ź–ļ —Ā–į–ľ–ĺ—Ā—ā—Ė–Ļ–Ĺ—É —Ą—Ė–∑–ł—á–Ĺ—É —ā–į —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė–Ļ–Ĺ—É —Ā—É—ā–Ĺ—Ė—Ā—ā—Ć. –Ě–į—Ā—ā—É–Ņ–Ĺ–ł–Ļ –Ķ—ā–į–Ņ –Ņ—Ä–ĺ–≥—Ä–Ķ—Ā—É –Ļ—ā–ł–ľ–Ķ –∑–į–≤–ī—Ź–ļ–ł Synthetic Data (—Ā–ł–Ĺ—ā–Ķ—ā–ł—á–Ĺ–ł—Ö –ī–į–Ĺ–ł—Ö), –ļ–ĺ–Ľ–ł –ľ–ĺ–ī–Ķ–Ľ—Ė AI –Ī—É–ī—É—ā—Ć –≤–∂–Ķ –Ĺ–į–≤—á–į—ā–ł—Ā—Ź –Ĺ–į —Ä–Ķ–∑—É–Ľ—Ć—ā–į—ā–į—Ö –≤–Ľ–į—Ā–Ĺ–ł—Ö —Ä–ĺ–∑–ī—É–ľ—Ė–≤, –≤–∑–į–≥–į–Ľ—Ė –Ĺ–Ķ –Ņ–ĺ—ā—Ä–Ķ–Ī—É—é—á–ł –Ľ—é–ī–ł–Ĺ–ł —Ź–ļ –ī–∂–Ķ—Ä–Ķ–Ľ–į —Ė –≤–Ķ—Ä–ł—Ą—Ė–ļ–į—ā–ĺ—Ä–į —Ė—Ā—ā–ł–Ĺ–ł.

–Ę–ł—Ā—Ź—á–ĺ–Ľ—Ė—ā–Ĺ—Ź –Ķ–Ņ–ĺ—Ö–į –į–Ĺ—ā—Ä–ĺ–Ņ–ĺ—Ü–Ķ–Ĺ—ā—Ä–ł–∑–ľ—É –Ņ—Ė–ī—Ö–ĺ–ī–ł—ā—Ć –ī–ĺ —Ā–≤–ĺ–≥–ĺ –Ľ–ĺ–≥—Ė—á–Ĺ–ĺ–≥–ĺ –∑–į–≤–Ķ—Ä—ą–Ķ–Ĺ–Ĺ—Ź. –õ–į—Ā–ļ–į–≤–ĺ –Ņ—Ä–ĺ—Ā–ł–ľ–ĺ —É —Ā–≤—Ė—ā, –ī–Ķ —Ä–ĺ–∑—É–ľ –Ī—Ė–Ľ—Ć—ą–Ķ –Ĺ–Ķ —Ē –ľ–ĺ–Ĺ–ĺ–Ņ–ĺ–Ľ—Ė—Ē—é –≤—É–≥–Ľ–Ķ—Ü–Ķ–≤–ĺ—ó —Ą–ĺ—Ä–ľ–ł –∂–ł—ā—ā—Ź. –¶—Ė–Ľ–ļ–ĺ–ľ –Ĺ–Ķ –≤–į–∂–Ľ–ł–≤–ĺ, —Ź–ļ –ľ–ł —Ā—ā–į–≤–ł–ľ–ĺ—Ā—Ź –ī–ĺ —ā–į–ļ–ĺ—ó –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ–ĺ—ó –∑–ľ—Ė–Ĺ–ł, –Ņ—Ä–ł–Ļ–ľ–į—é—á–ł –į–Ī–ĺ —Ä—Ė–∑–ļ–ĺ –≤—Ė–ī–ļ–ł–ī–į—é—á–ł —ó—ó. –Į–ļ—Č–ĺ –ľ–ł –Ĺ–Ķ –∑–ľ–ĺ–∂–Ķ–ľ–ĺ –į–ī–į–Ņ—ā—É–≤–į—ā–ł—Ā—Ź –ī–ĺ –Ĺ–ĺ–≤–ĺ—ó –Ķ—Ä–ł, –∑–į–Ľ–ł—ą–ł–ľ–ĺ—Ā—Ź –∑–į –Ī–ĺ—Ä—ā–ĺ–ľ —Ä–ĺ–∑–≤–ł—ā–ļ—É.

3 –į–Ņ—Ä–Ķ–Ľ—Ź 2026 –≥., 17:45

–£ –Ņ–ĺ–Ņ–Ķ—Ä–Ķ–ī–Ĺ—Ć–ĺ–ľ—É –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—Ė –ľ–ł –Ĺ–Ķ —ā—Ė–Ľ—Ć–ļ–ł –∑’—Ź—Ā—É–≤–į–Ľ–ł, —Ź–ļ AI –ĺ–Ī—Ä–ĺ–Ī–Ľ—Ź—Ē –Ĺ–į—ą—Ė –∑–į–Ņ–ł—ā–ł, –į –Ļ –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ł, —á–ĺ–ľ—É –Ĺ–Ķ –≤–į—Ä—ā–ĺ –Ņ—Ä–ĺ—Ā–ł—ā–ł AI-–į–≥–Ķ–Ĺ—ā–į —Ä–ĺ–∑–Ņ–ĺ–≤—Ė—Ā—ā–ł –į–Ĺ–Ķ–ļ–ī–ĺ—ā –į–Ī–ĺ –Ĺ–į–Ņ–ł—Ā–į—ā–ł –≤—Ė—Ä—ą, –Ī–ĺ –≤–≤–Ķ—á–Ķ—Ä—Ė –Ĺ—É–ī–Ĺ–ĺ. –ü–Ľ–į–Ĺ–ĺ–ľ—Ė—Ä–Ĺ–ĺ —Ä—É—Ö–į—Ē–ľ–ĺ—Ā—Ź –ī–į–Ľ—Ė —Ė —Ā–Ņ—Ä–ĺ–Ī—É—Ē–ľ–ĺ —Ä–ĺ–∑—Ė–Ī—Ä–į—ā–ł—Ā—Ź –≤ –Ņ–ĺ—ā–ĺ—á–Ĺ–ĺ–ľ—É —Ä—Ė–∑–Ĺ–ĺ–ľ–į–Ĺ—Ė—ā—ā—Ė –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ–ł—Ö –≤—Ė–ī–ļ—Ä–ł—ā–ł—Ö AI-—Ė–Ĺ—Ą—Ä–į—Ā—ā—Ä—É–ļ—ā—É—Ä, –į —ā–į–ļ–ĺ–∂ —É —ā–ĺ–ľ—É, —Ź–ļ —Ė –Ĺ–į–≤—Ė—Č–ĺ —ó—Ö –ļ—Ä–į—Č–Ķ –≤–ł–ļ–ĺ—Ä–ł—Ā—ā–ĺ–≤—É–≤–į—ā–ł.

–°–Ņ–ĺ—á–į—ā–ļ—É —Ö–ĺ—ā—Ė–≤ –∑—Ä–ĺ–Ī–ł—ā–ł –Ĺ–Ķ–≤–Ķ–Ľ–ł–ļ–ł–Ļ –Ķ–ļ—Ā–ļ—É—Ä—Ā –≤ —Ė—Ā—ā–ĺ—Ä—Ė—é –≤–ł–Ĺ–ł–ļ–Ĺ–Ķ–Ĺ–Ĺ—Ź —ą—ā—É—á–Ĺ–ĺ–≥–ĺ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É —Ź–ļ —Ź–≤–ł—Č–į, –į–Ľ–Ķ –Ņ–ĺ—ā—Ė–ľ –≤–ł—Ä—Ė—ą–ł–≤, —Č–ĺ —Ü—Ź –°–į–Ĺ—ā–į-–Ď–į—Ä–Ī–į—Ä–į –Ĺ–į—Ā—ā—Ė–Ľ—Ć–ļ–ł –ļ—Ä–į—Ā–ł–≤–ĺ –ĺ–Ī—Ä–ĺ—Ā–Ľ–į —Ā–ļ–į–Ĺ–ī–į–Ľ–į–ľ–ł, —Ė–Ĺ—ā—Ä–ł–≥–į–ľ–ł —ā–į —Ä–ĺ–∑—Ā–Ľ—Ė–ī—É–≤–į–Ĺ–Ĺ—Ź–ľ–ł, —Č–ĺ –∑–į—Ö–ĺ–Ņ–Ľ–ł–≤–į —Ė—Ā—ā–ĺ—Ä—Ė—Ź –Ņ—Ä–ĺ –Ņ–ĺ—á–į—ā–ĺ–ļ –Ķ—Ä–ł –ľ–į—ą–ł–Ĺ–Ĺ–ĺ–≥–ĺ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź –ĺ–ī–Ĺ–ĺ–∑–Ĺ–į—á–Ĺ–ĺ –∑–į—Ā–Ľ—É–≥–ĺ–≤—É—Ē –Ĺ–į –ĺ–ļ—Ä–Ķ–ľ–ł–Ļ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ. –ó —Ü—Ė—Ē—ó –∂ –Ņ—Ä–ł—á–ł–Ĺ–ł –ľ–ł –ľ–į–Ļ–∂–Ķ –Ĺ–Ķ –Ī—É–ī–Ķ–ľ–ĺ –≤ –ĺ–Ņ–ł—Ā—Ė AI-–į–≥–Ķ–Ĺ—ā—Ė–≤ —ā–ĺ—Ä–ļ–į—ā–ł—Ā—Ź –Ņ–Ķ—Ä—Ā–ĺ–Ĺ–į–Ľ—Ė–Ļ (—ā–į–ľ —ā–Ķ–∂ —á–į—Ā—ā–ĺ –ī–Ķ—ā–Ķ–ļ—ā–ł–≤–Ĺ—Ė —Ė—Ā—ā–ĺ—Ä—Ė—ó, –≥—Ė–ī–Ĺ—Ė —Ä–ĺ–ľ–į–Ĺ—Ė–≤), —Ź–ļ—Ė –∑–į —Ü–ł–ľ —Ā—ā–ĺ—Ź—ā—Ć, —Ė –∑–ĺ—Ā–Ķ—Ä–Ķ–ī–ł–ľ–ĺ—Ā—Ź –≤–ł–ļ–Ľ—é—á–Ĺ–ĺ –Ĺ–į –Ņ–ĺ—ā–ĺ—á–Ĺ–ł—Ö —Ä–Ķ–į–Ľ—Ė–∑–į—Ü—Ė—Ź—Ö.

OpenAI (ChatGPT): «–Ď–į—ā—Ć–ļ–ĺ-–∑–į—Ā–Ĺ–ĺ–≤–Ĺ–ł–ļ»

–ü—Ė–ĺ–Ĺ–Ķ—Ä–ĺ–ľ AI-—ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—ó (–≤–į–∂–Ľ–ł–≤–Ķ —É—ā–ĺ—á–Ĺ–Ķ–Ĺ–Ĺ—Ź - –ī–ĺ—Ā—ā—É–Ņ–Ĺ–ĺ—ó –∑–≤–ł—á–į–Ļ–Ĺ–ĺ–ľ—É –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—á–Ķ–≤—Ė) –Ī–Ķ–∑–Ņ–Ķ—Ä–Ķ—á–Ĺ–ĺ –≤–≤–į–∂–į—Ē–ľ–ĺ ChatGPT –≤—Ė–ī –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—ó OpenAI. –Ę–Ķ, —Č–ĺ –≤–ī–į–Ľ–ĺ—Ā—Ź –į–ľ–Ķ—Ä–ł–ļ–į–Ĺ—Ā—Ć–ļ—Ė–Ļ –Ņ—Ä–ł–≤–į—ā–Ĺ—Ė–Ļ –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—ó (–Ņ—Ä–į–ļ—ā–ł—á–Ĺ–ĺ —Ā—ā–į—Ä—ā–į–Ņ—É) –Ĺ–į–Ņ—Ä–ł–ļ—Ė–Ĺ—Ü—Ė 2022 —Ä–ĺ–ļ—É, –Ī–Ķ–∑–Ņ–Ķ—Ä–Ķ—á–Ĺ–ĺ, –ľ–ĺ–∂–Ĺ–į –≤–≤–į–∂–į—ā–ł —Ä–Ķ–≤–ĺ–Ľ—é—Ü—Ė—Ē—é. –ü–Ķ—Ä—ą–ł–Ļ –Ņ–ĺ–≤–Ĺ–ĺ—Ü—Ė–Ĺ–Ĺ–ł–Ļ «—á–į—ā –∑ –ļ–ĺ–ľ–Ņ'—é—ā–Ķ—Ä–ĺ–ľ –≤–Ķ—Ä—Ā—Ė—ó 3.5» –Ī—É–Ľ–ĺ –∑–į–≤–į–Ĺ—ā–į–∂–Ķ–Ĺ–ĺ –Ņ–ĺ–Ĺ–į–ī 1 –ľ–Ľ–Ĺ —Ä–į–∑—Ė–≤ –∑–į –Ņ–Ķ—Ä—ą–ł–Ļ —ā–ł–∂–ī–Ķ–Ĺ—Ć —É –≤—Ė–ī–ļ—Ä–ł—ā–ĺ–ľ—É –ī–ĺ—Ā—ā—É–Ņ—Ė. –ú–ĺ–∂–Ľ–ł–≤–ĺ, —Ü–Ķ –Ņ—Ä–ĺ–∑–≤—É—á–ł—ā—Ć –Ņ–į—Ą–ĺ—Ā–Ĺ–ĺ, –į–Ľ–Ķ –≤–∂–Ķ –∑–į—Ä–į–∑ –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–ĺ, —Č–ĺ —Ā–≤—Ė—ā —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė–Ļ–Ĺ–ł—Ö —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė–Ļ —Ā–ľ—Ė–Ľ–ł–≤–ĺ –ľ–ĺ–∂–Ĺ–į –ĺ–Ņ–ł—Ā—É–≤–į—ā–ł –≤ —Ė—Ā—ā–ĺ—Ä–ł—á–Ĺ–ł—Ö –ī–ĺ–ļ—É–ľ–Ķ–Ĺ—ā–į—Ö —Ź–ļ «–ī–ĺ» —Ė «–Ņ—Ė—Ā–Ľ—Ź» —Ü—Ė—Ē—ó —Ė—Ā—ā–ĺ—Ä–ł—á–Ĺ–ĺ—ó –Ņ–ĺ–ī—Ė—ó.

–ó–į—Ä–į–∑ ChatGPT, —Ź–ļ —Ė —Ä–į–Ĺ—Ė—ą–Ķ, –∑–Ī–Ķ—Ä—Ė–≥–į—Ē –≤–Ņ–Ķ–≤–Ĺ–Ķ–Ĺ–Ķ –Ľ—Ė–ī–Ķ—Ä—Ā—ā–≤–ĺ –∑–į –Ņ–ĺ–Ņ—É–Ľ—Ź—Ä–Ĺ—Ė—Ā—ā—é –≤–ł–ļ–ĺ—Ä–ł—Ā—ā–į–Ĺ–Ĺ—Ź, –į–Ľ–Ķ –≤–∂–Ķ –Ņ–ĺ—á–ł–Ĺ–į—é—á–ł –∑ 2024 —Ä–ĺ–ļ—É –į–∂ –Ĺ—Ė—Ź–ļ –Ĺ–Ķ —Ē –ľ–ĺ–Ĺ–ĺ–Ņ–ĺ–Ľ—Ė—Ā—ā–ĺ–ľ. ChatGPT, —Ź–ļ —Ė —Ä–į–Ĺ—Ė—ą–Ķ, —Ö–ĺ—Ä–ĺ—ą–ł–Ļ —É –≤—Ā—Ć–ĺ–ľ—É –Ņ–ĺ—ā—Ä–ĺ—Ö—É, –į–Ľ–Ķ —Ė–Ĺ—ą—Ė —É—á–į—Ā–Ĺ–ł–ļ–ł —Ä–ł–Ĺ–ļ—É –Ņ–Ľ–į–Ĺ–ĺ–ľ—Ė—Ä–Ĺ–ĺ –≤—Ė–ī–ļ—É—ą—É—é—ā—Ć —Ā–≤–ĺ—ó —á–į—Ā—ā–ļ–ł, —Ė –∑ –ļ–ĺ–∂–Ĺ–ł–ľ –ī–Ĺ–Ķ–ľ –≤—Ā–Ķ –≤–Ņ–Ķ–≤–Ĺ–Ķ–Ĺ—Ė—ą–Ķ.

–Ę–ĺ—á–ļ–į —Ā—ā–į—Ä—ā—É - –Ľ–ł—Ā—ā–ĺ–Ņ–į–ī 2022 —Ä–ĺ–ļ—É. –ü–Ķ—Ä—ą–į –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ–į –≤–Ķ—Ä—Ā—Ė—Ź - ChatGPT (–Ĺ–į –Ī–į–∑—Ė –ľ–ĺ–ī–Ķ–Ľ—Ė GPT-3.5). –í–į–∂–Ľ–ł–≤–Ķ —É—ā–ĺ—á–Ĺ–Ķ–Ĺ–Ĺ—Ź: —Ā–į–ľ–Ķ —É –≤–Ķ—Ä—Ā—Ė—ó 3.5 –≤–Ņ–Ķ—Ä—ą–Ķ –Ī—É–Ľ–ĺ –≤–Ņ—Ä–ĺ–≤–į–ī–∂–Ķ–Ĺ–ĺ –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź —á–Ķ—Ä–Ķ–∑ –∑–≤–ĺ—Ä–ĺ—ā–Ĺ–ł–Ļ –∑–≤'—Ź–∑–ĺ–ļ –∑ –Ľ—é–ī–ł–Ĺ–ĺ—é (RLHF - Reinforcement Learning from Human Feedback).

–ü–ĺ—Ö–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź —ā–į –ľ—Ė—Ā—Ė—Ź: –°–®–ź, OpenAI (–Ņ—Ä–ł–≤–į—ā–Ĺ–į –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—Ź –∑–į –Ņ—Ė–ī—ā—Ä–ł–ľ–ļ–ł Microsoft). –°—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź –Ī–Ķ–∑–Ņ–Ķ—á–Ĺ–ĺ–≥–ĺ —ā–į –≤—Ā–Ķ–ĺ—Ā—Ź–∂–Ĺ–ĺ–≥–ĺ AGI (Artificial General Intelligence) - –≥–Ľ–ĺ–Ī–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ AI, –∑–ī–į—ā–Ĺ–ĺ–≥–ĺ –≤–ł–ļ–ĺ–Ĺ—É–≤–į—ā–ł –Ī—É–ī—Ć-—Ź–ļ–Ķ –ī–ĺ—Ā—ā—É–Ņ–Ĺ–Ķ —ā–į –≤–ł–∑–Ĺ–į—á–Ķ–Ĺ–Ķ –ī–Ľ—Ź –Ľ—é–ī—Ā—ā–≤–į —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā—É–į–Ľ—Ć–Ĺ–Ķ –∑–į–≤–ī–į–Ĺ–Ĺ—Ź, —Ė, —Ź–ļ –Ĺ–į—Ā–Ľ—Ė–ī–ĺ–ļ, –∑–į–ľ—Ė–Ĺ—é–≤–į—ā–ł —Ā–ĺ–Ī–ĺ—é –Ī—Ė–Ľ—Ć—ą—Ė—Ā—ā—Ć –Ņ–ĺ—ā–ĺ—á–Ĺ–ł—Ö —Ė–Ĺ—Ą–ĺ—Ä–ľ–į—Ü—Ė–Ļ–Ĺ–ł—Ö —Ā–Ķ—Ä–≤—Ė—Ā—Ė–≤.

–°–Ņ–Ķ—Ü—Ė–į–Ľ—Ė–∑–į—Ü—Ė—Ź: —É–Ĺ—Ė–≤–Ķ—Ä—Ā–į–Ľ—Ć–Ĺ–ł–Ļ –Ľ–ĺ–≥—Ė—á–Ĺ–ł–Ļ –Ņ–ĺ–ľ—Ė—á–Ĺ–ł–ļ, –ľ–į–Ļ—Ā—ā–Ķ—Ä –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā–Ĺ–ł—Ö –ľ—Ė—Ä–ļ—É–≤–į–Ĺ—Ć —Ė –Ņ–Ľ–į–Ĺ—É–≤–į–Ĺ–Ĺ—Ź. –ú–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–į —Ė–ľ—Ė—ā–į—Ü—Ė—Ź «–Ľ—é–ī–ł–Ĺ–ĺ–Ņ–ĺ–ī—Ė–Ī–Ĺ–ĺ—Ā—ā—Ė».

Hardware: –Ņ—Ä–į—Ü—é—Ē –Ĺ–į –ľ–į—Ā—ą—ā–į–Ī–ĺ–≤–į–Ĺ–ł—Ö –ļ–Ľ–į—Ā—ā–Ķ—Ä–į—Ö —É —Ö–ľ–į—Ä—Ė Microsoft Azure, –Ņ–ĺ–Ī—É–ī–ĺ–≤–į–Ĺ–ł—Ö –Ĺ–į —Ā–ĺ—ā–Ĺ—Ź—Ö —ā–ł—Ā—Ź—á (!) AI-–Ņ—Ä–ł—Ā–ļ–ĺ—Ä—é–≤–į—á—Ė–≤ Nvidia H100 —Ė H200.

–°–ł–Ľ—Ć–Ĺ—Ė —Ā—ā–ĺ—Ä–ĺ–Ĺ–ł: «–ļ—Ä–ł–≥–ĺ–Ľ–į–ľ» —É –Ĺ–į–Ņ—Ä—Ź–ľ–ļ—É –ľ–į—ą–ł–Ĺ–Ĺ–ĺ–≥–ĺ –Ĺ–į–≤—á–į–Ĺ–Ĺ—Ź —ā–į «–Ľ—é–ī—Ā—Ć–ļ–ĺ–≥–ĺ» —Ė–Ĺ—ā–Ķ—Ä—Ą–Ķ–Ļ—Ā—É. –ü—Ä–ĺ—Ā—É–Ĺ—É—ā–Ķ –Ľ–ĺ–≥—Ė—á–Ĺ–Ķ –ľ–ł—Ā–Ľ–Ķ–Ĺ–Ĺ—Ź (Reasoning). –ó–į–≤–ī—Ź–ļ–ł –Ľ–į–Ĺ—Ü—é–∂–ļ–į–ľ –ī—É–ľ–ĺ–ļ (Chain-of-Thought) –ľ–ĺ–ī–Ķ–Ľ—Ć «–Ī–į–≥–į—ā–ĺ–≥—Ä–į–Ĺ–Ĺ–ĺ –ĺ–Ī–ľ—Ė—Ä–ļ–ĺ–≤—É—Ē –Ņ–ł—ā–į–Ĺ–Ĺ—Ź», –Ņ–Ķ—Ä—ą –Ĺ—Ė–∂ –≤–ł–ī–į—ā–ł –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ć.

–°–Ľ–į–Ī–ļ—Ė —Ā—ā–ĺ—Ä–ĺ–Ĺ–ł (–ĺ–Ī–ľ–Ķ–∂–Ķ–Ĺ–Ĺ—Ź): –∑–į–ļ—Ä–ł—ā–į –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä–į, –≤–ł—Ā–ĺ–ļ–į –≤–į—Ä—ā—Ė—Ā—ā—Ć API –ī–Ľ—Ź —Ä–ĺ–∑—Ä–ĺ–Ī–Ĺ–ł–ļ—Ė–≤, –Ņ–Ķ—Ä—Ė–ĺ–ī–ł—á–Ĺ—Ė –Ņ—Ä–ĺ–Ī–Ľ–Ķ–ľ–ł –∑ –Ĺ–į–ī–ľ—Ė—Ä–Ĺ–ĺ—é —Ü–Ķ–Ĺ–∑—É—Ä–ĺ—é —É –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ź—Ö. «–í–Ņ–Ķ–≤–Ĺ–Ķ–Ĺ—Ė» –≥–į–Ľ—é—Ü–ł–Ĺ–į—Ü—Ė—ó, –∑ –ļ–ĺ–∂–Ĺ–ĺ—é –Ĺ–į—Ā—ā—É–Ņ–Ĺ–ĺ—é –≤–Ķ—Ä—Ā—Ė—Ē—é —Ā–ł—ā—É–į—Ü—Ė—Ź –Ņ–ĺ–ļ—Ä–į—Č—É—Ē—ā—Ć—Ā—Ź, –į–Ľ–Ķ –≤—Ā–Ķ —Č–Ķ –ī–į–Ľ–Ķ–ļ–į –≤—Ė–ī —Ė–ī–Ķ–į–Ľ—Ć–Ĺ–ĺ—ó. –í–ł—Ā–ĺ–ļ–į –∑–į–Ľ–Ķ–∂–Ĺ—Ė—Ā—ā—Ć –≤—Ė–ī —Ė–Ĺ–≤–Ķ—Ā—ā–ĺ—Ä—Ė–≤.

–ź–ļ—ā—É–į–Ľ—Ć–Ĺ–ł–Ļ —Ā—ā–į–Ĺ –Ĺ–į –Ī–Ķ—Ä–Ķ–∑–Ķ–Ĺ—Ć 2026 —Ä–ĺ–ļ—É: —Ą–Ľ–į–≥–ľ–į–Ĺ—Ā—Ć–ļ–į –≤–Ķ—Ä—Ā—Ė—Ź - GPT-5. –ü–ĺ–∑–ł—Ü—Ė–ĺ–Ĺ—É—Ē—ā—Ć—Ā—Ź —Ź–ļ –≤—Ā–Ķ–Ī—Ė—á–Ĺ–ł–Ļ «–į–≥–Ķ–Ĺ—ā-–Ņ–Ľ–į–Ĺ—É–≤–į–Ľ—Ć–Ĺ–ł–ļ», –∑–ī–į—ā–Ĺ–ł–Ļ –į–≤—ā–ĺ–Ĺ–ĺ–ľ–Ĺ–ĺ –≤–ł—Ä—Ė—ą—É–≤–į—ā–ł —Ā–ļ–Ľ–į–ī–Ĺ—Ė –Ņ—Ä–ł–ļ–Ľ–į–ī–Ĺ—Ė –∑–į–≤–ī–į–Ĺ–Ĺ—Ź.

Google Gemini: «–ú–į–Ļ—Ā—ā–Ķ—Ä –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā—É —ā–į –ľ—É–Ľ—Ć—ā–ł–ľ–ĺ–ī–į–Ľ—Ć–Ĺ–ĺ—Ā—ā—Ė»

Google –∑–ĺ–≤—Ā—Ė–ľ –Ĺ–Ķ–ī–ĺ–≤–≥–ĺ (–Ī–Ľ–ł–∑—Ć–ļ–ĺ –Ņ—Ė–≤—Ä–ĺ–ļ—É) –Ņ–Ķ—Ä–Ķ–Ī—É–≤–į–Ľ–į –≤ —Ä–ĺ–Ľ—Ė –Ĺ–į–∑–ī–ĺ–≥–į–Ĺ—Ź—é—á–ĺ—ó. –ö–ĺ–ľ–į–Ĺ–ī–į —Ä–ĺ–∑—Ä–ĺ–Ī–Ĺ–ł–ļ—Ė–≤ Gemini —ą–≤–ł–ī–ļ–ĺ –∑–Ī–į–≥–Ĺ—É–Ľ–į, —Č–ĺ —Ä–ĺ–Ī–ł—ā–ł «—Č–Ķ –ĺ–ī–Ĺ—É» –ļ–ĺ–Ņ—Ė—é ChatGPT –Ī–Ķ–∑–≥–Ľ—É–∑–ī–ĺ, —Ė –Ņ–ĺ—ā—Ä—Ė–Ī–Ĺ–ĺ –≤–ł–Ņ—É—Ā—ā–ł—ā–ł –Ņ—Ä–ĺ–ī—É–ļ—ā, —Ź–ļ–ł–Ļ –∑—Ä–ĺ–Ī–ł—ā—Ć –į–ļ—Ü–Ķ–Ĺ—ā –Ĺ–į —ā–ł—Ö —ā–Ķ—Ö–Ĺ–ĺ–Ľ–ĺ–≥—Ė—Ź—Ö, —É —Ź–ļ–ł—Ö –ļ–ĺ–ľ–Ņ–į–Ĺ—Ė—Ź –∑ –ú–į—É–Ĺ—ā—Ė–Ĺ-–í'—é –Ĺ–į–Ļ—Ā–ł–Ľ—Ć–Ĺ—Ė—ą–į. –£ –∑–≤'—Ź–∑–ļ—É –∑ —Ü–ł–ľ —Ä–ĺ–∑–≤–ł—ā–ĺ–ļ AI-–į–≥–Ķ–Ĺ—ā–į Gemini –Ļ—ą–ĺ–≤ —É –Ĺ–į–Ņ—Ä—Ź–ľ–ļ—É –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–ĺ—ó —Ė–Ĺ—ā–Ķ–≥—Ä–į—Ü—Ė—ó –∑ –Ķ–ļ–ĺ—Ā–ł—Ā—ā–Ķ–ľ–ĺ—é Google — –Ņ–ĺ—ą—É–ļ –≤ —Ė–Ĺ—ā–Ķ—Ä–Ĺ–Ķ—ā—Ė, —Ä–ĺ–Ī–ĺ—ā–į –∑ –ĺ–Ĺ–Ľ–į–Ļ–Ĺ-—Ā–Ķ—Ä–≤—Ė—Ā–į–ľ–ł, —Ė–Ĺ—ā–Ķ–≥—Ä–į—Ü—Ė—Ź –≤ Android —Ė –į–ļ—Ü–Ķ–Ĺ—ā –Ĺ–į –ľ—É–Ľ—Ć—ā–ł–ľ–ĺ–ī–į–Ľ—Ć–Ĺ—Ė—Ā—ā—Ć. –ü—Ä–ĺ—Ā—ā–ł–ľ–ł —Ā–Ľ–ĺ–≤–į–ľ–ł: –ľ–ĺ–∂–Ľ–ł–≤—Ė—Ā—ā—Ć —Ā–Ņ—Ä–ł–Ļ–ľ–į—ā–ł –∑–≤—É–ļ, —ā–Ķ–ļ—Ā—ā, –∑–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–Ĺ—Ź, –≤—Ė–ī–Ķ–ĺ –Ĺ–Ķ –ĺ–ļ—Ä–Ķ–ľ–ĺ, –į «–ĺ–ī—Ä–į–∑—É» –≤ —Ä–į–ľ–ļ–į—Ö –ĺ–ī–Ĺ–ĺ–≥–ĺ –∑–į–≤–ī–į–Ĺ–Ĺ—Ź, —Č–ĺ —ó—Ö –ĺ–Ī’—Ē–ī–Ĺ—É—Ē. –Ę—É—ā –∂–Ķ –∑–≥–į–ī–į—Ē–ľ–ĺ –≤–į–∂–Ľ–ł–≤–ł–Ļ –Ĺ—é–į–Ĺ—Ā, –Ņ—Ä–ĺ —Ź–ļ–ł–Ļ –ľ–į–Ľ–ĺ —Ö—ā–ĺ –∑–Ĺ–į—Ē, - Google –≤–ł–ļ–ĺ—Ä–ł—Ā—ā–ĺ–≤—É—Ē –≤–Ľ–į—Ā–Ĺ—Ė –į–Ņ–į—Ä–į—ā–Ĺ—Ė —Ä—Ė—ą–Ķ–Ĺ–Ĺ—Ź Tensor Processing Units (TPU, –Ņ—Ä—Ź–ľ–į –ļ–ĺ–Ĺ–ļ—É—Ä–Ķ–Ĺ—Ü—Ė—Ź –∑ NVIDIA), –ĺ—Ā–ĺ–Ī–Ľ–ł–≤–ĺ —Ā–ł–Ľ—Ć–Ĺ–ĺ—é —Ā—ā–ĺ—Ä–ĺ–Ĺ–ĺ—é —Ź–ļ–ł—Ö —Ē —É–Ĺ—Ė–ļ–į–Ľ—Ć–Ĺ–ł–Ļ –ĺ–Ņ—ā–ł—á–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ—Ä–ļ–ĺ–Ĺ–Ķ–ļ—ā (OCS - Optical Circuit Switching) –ľ—Ė–∂ –≤—É–∑–Ľ–į–ľ–ł (—Ź–ļ—Č–ĺ —É –≤–į—Ā –≤–ł—Ā—ā–į—á–ł—ā—Ć —ā–Ķ—Ä–Ņ—Ė–Ĺ–Ĺ—Ź, –ĺ–ī–ł–Ĺ —Ė–∑ –ľ–į—ā–Ķ—Ä—Ė–į–Ľ—Ė–≤ –Ī—É–ī–Ķ –Ņ–ĺ–≤–Ĺ—Ė—Ā—ā—é –Ņ—Ä–ł—Ā–≤—Ź—á–Ķ–Ĺ–ł–Ļ –į–Ņ–į—Ä–į—ā–Ĺ—Ė–Ļ —Ä–Ķ–į–Ľ—Ė–∑–į—Ü—Ė—ó AI).

–ü–ĺ—á–į—ā–ĺ–ļ —Ä–ĺ–Ī–ĺ—ā–ł - –Ī–Ķ—Ä–Ķ–∑–Ķ–Ĺ—Ć 2023 —Ä–ĺ–ļ—É (–Ņ–ĺ—á–į—ā–ļ–ĺ–≤–į –Ĺ–į–∑–≤–į –Ņ—Ä–ĺ—Ē–ļ—ā—É - Bard –Ĺ–į –Ī–į–∑—Ė –Ņ—Ä–ĺ-–ľ–ĺ–ī–Ķ–Ľ—Ė LaMDA). –ě—Ą—Ė—Ü—Ė–Ļ–Ĺ–ł–Ļ —Ä–Ķ–Ī—Ä–Ķ–Ĺ–ī–ł–Ĺ–≥ —ā–į –Ņ–Ķ—Ä–Ķ—Ö—Ė–ī –Ĺ–į –į—Ä—Ö—Ė—ā–Ķ–ļ—ā—É—Ä—É Gemini 1.0 –≤—Ė–ī–Ī—É–Ľ–ł—Ā—Ź –≤ –Ľ—é—ā–ĺ–ľ—É 2024 —Ä–ĺ–ļ—É.

–ü–ĺ—Ö–ĺ–ī–∂–Ķ–Ĺ–Ĺ—Ź —ā–į –ľ—Ė—Ā—Ė—Ź: –°–®–ź, Google DeepMind. –ú—Ė—Ā—Ė—Ź - —Ā—ā–≤–ĺ—Ä–Ķ–Ĺ–Ĺ—Ź «–≤—Ä–ĺ–ī–∂–Ķ–Ĺ–ĺ –ľ—É–Ľ—Ć—ā–ł–ľ–ĺ–ī–į–Ľ—Ć–Ĺ–ĺ–≥–ĺ» AI, —Ź–ļ–ł–Ļ –∑ –Ņ–Ķ—Ä—ą–ĺ–≥–ĺ –ī–Ĺ—Ź –Ĺ–į–≤—á–į–≤—Ā—Ź —Ä–ĺ–∑—É–ľ—Ė—ā–ł –Ĺ–Ķ —ā—Ė–Ľ—Ć–ļ–ł —ā–Ķ–ļ—Ā—ā, –į–Ľ–Ķ –Ļ –∑–ĺ–Ī—Ä–į–∂–Ķ–Ĺ–Ĺ—Ź, –≤—Ė–ī–Ķ–ĺ —ā–į –į—É–ī—Ė–ĺ –≤ —Ē–ī–ł–Ĺ–ĺ–ľ—É –Ņ—Ä–ĺ—Ā—ā–ĺ—Ä—Ė —Ā–ľ–ł—Ā–Ľ—Ė–≤, –ľ–į–ļ—Ā–ł–ľ–į–Ľ—Ć–Ĺ–į —Ė–Ĺ—ā–Ķ–≥—Ä–į—Ü—Ė—Ź –∑ —Ā–Ķ—Ä–≤—Ė—Ā–į–ľ–ł «–∑–ĺ–≤–Ĺ—Ė—ą–Ĺ—Ć–ĺ–≥–ĺ» —Ė–Ĺ—ā–Ķ—Ä–Ĺ–Ķ—ā—É.

–°–Ņ–Ķ—Ü—Ė–į–Ľ—Ė–∑–į—Ü—Ė—Ź: —Ä–ĺ–Ī–ĺ—ā–į –∑ –≥—Ė–≥–į–Ĺ—ā—Ā—Ć–ļ–ł–ľ–ł –ĺ–Ī—Ā—Ź–≥–į–ľ–ł –ī–į–Ĺ–ł—Ö («–ī–ĺ–≤–≥–ł–Ļ –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā») —Ė –≥–Ľ–ł–Ī–ĺ–ļ–į «–∑–į–Ľ—É—á–Ķ–Ĺ—Ė—Ā—ā—Ć» —É –Ņ–Ķ—Ä—Ā–ĺ–Ĺ–į–Ľ—Ć–Ĺ—Ė –ī–į–Ĺ—Ė –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—á–į (Google Workspace, Android).

Hardware: –≤–Ľ–į—Ā–Ĺ—Ė —á—Ė–Ņ–ł TPU. –ź–ļ—ā—É–į–Ľ—Ć–Ĺ–Ķ –Ņ–ĺ–ļ–ĺ–Ľ—Ė–Ĺ–Ĺ—Ź –Ĺ–į –≤–Ķ—Ā–Ĺ—É 2026 —Ä–ĺ–ļ—É — TPU v6 (Trillium) —Ė TPU v5p (–Ĺ–Ķ–∑–į–Ī–į—Ä–ĺ–ľ TPU v7). –í—Ė–ī–Ĺ–ĺ—Ā–Ĺ–į –Ĺ–Ķ–∑–į–Ľ–Ķ–∂–Ĺ—Ė—Ā—ā—Ć Google –≤—Ė–ī –ī–Ķ—Ą—Ė—Ü–ł—ā—É —á—Ė–Ņ—Ė–≤ Nvidia —ā–į –ľ–Ķ–Ĺ—ą–į –Ķ–Ĺ–Ķ—Ä–≥–Ķ—ā–ł—á–Ĺ–į –≤–į—Ä—ā—Ė—Ā—ā—Ć –∑–į–Ņ–ł—ā—Ė–≤.

–°–ł–Ľ—Ć–Ĺ—Ė —Ā—ā–ĺ—Ä–ĺ–Ĺ–ł: —Ä–ĺ–∑–ľ—Ė—Ä –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā–Ĺ–ĺ–≥–ĺ –≤—Ė–ļ–Ĺ–į. Gemini –Ņ–ĺ–ļ–ł —Č–ĺ –Ľ—Ė–ī–ł—Ä—É—Ē –∑–į —Ü–ł–ľ –Ņ–į—Ä–į–ľ–Ķ—ā—Ä–ĺ–ľ, –ī–ĺ–∑–≤–ĺ–Ľ—Ź—é—á–ł –∑–į–≤–į–Ĺ—ā–į–∂—É–≤–į—ā–ł –ī–ĺ 10 –ľ—Ė–Ľ—Ć–Ļ–ĺ–Ĺ—Ė–≤ —ā–ĺ–ļ–Ķ–Ĺ—Ė–≤ (–Ķ–ļ–≤—Ė–≤–į–Ľ–Ķ–Ĺ—ā —ā–ł—Ā—Ź—á —Ā—ā–ĺ—Ä—Ė–Ĺ–ĺ–ļ —ā–Ķ–ļ—Ā—ā—É –į–Ī–ĺ –Ī–į–≥–į—ā—Ć–ĺ—Ö –≥–ĺ–ī–ł–Ĺ –≤—Ė–ī–Ķ–ĺ) –∑–į –ĺ–ī–ł–Ĺ —Ä–į–∑. –ó—Ä—É—á–Ĺ–ł–Ļ —Ė–Ĺ—Ā—ā—Ä—É–ľ–Ķ–Ĺ—ā –ī–Ľ—Ź –į–Ĺ–į–Ľ—Ė–∑—É –≤–Ķ–Ľ–ł–ļ–ł—Ö –Ľ–ĺ–≥—Ė–≤, –ļ–ĺ–ī–ĺ–≤–ł—Ö –Ī–į–∑ –į–Ī–ĺ —Ü—Ė–Ľ–ł—Ö –Ī—Ė–Ī–Ľ—Ė–ĺ—ā–Ķ–ļ.

–°–Ľ–į–Ī–ļ—Ė —Ā—ā–ĺ—Ä–ĺ–Ĺ–ł (–ĺ–Ī–ľ–Ķ–∂–Ķ–Ĺ–Ĺ—Ź): –Ĺ–į–ī–ľ—Ė—Ä–Ĺ–į «–ĺ–Ī–Ķ—Ä–Ķ–∂–Ĺ—Ė—Ā—ā—Ć» —É –≤—Ė–ī–Ņ–ĺ–≤—Ė–ī—Ź—Ö, –≤–ł—Ā–ĺ–ļ–į –Ľ–ĺ—Ź–Ľ—Ć–Ĺ—Ė—Ā—ā—Ć –ī–ĺ –Ľ—é–ī—Ā—Ć–ļ–ĺ—ó –Ĺ–Ķ–ĺ–Ī—Ė–∑–Ĺ–į–Ĺ–ĺ—Ā—ā—Ė —É –∑–į–Ņ–ł—ā–į—Ö, –į —ā–į–ļ–ĺ–∂ —Ā–ļ–Ľ–į–ī–Ĺ—Ė—ą–į —Ė –Ĺ–Ķ –∑–ĺ–≤—Ā—Ė–ľ –∑—Ä–ĺ–∑—É–ľ—Ė–Ľ–į —Ā—ā—Ä—É–ļ—ā—É—Ä–į –ļ–ĺ—Ä–ł—Ā—ā—É–≤–į—Ü—Ć–ļ–ł—Ö –≤–Ķ—Ä—Ā—Ė–Ļ (Flash, Pro, Ultra).

–ź–ļ—ā—É–į–Ľ—Ć–Ĺ–ł–Ļ —Ā—ā–į–Ĺ –Ĺ–į –Ī–Ķ—Ä–Ķ–∑–Ķ–Ĺ—Ć 2026 —Ä–ĺ–ļ—É: —Ą–Ľ–į–≥–ľ–į–Ĺ—Ā—Ć–ļ–į –≤–Ķ—Ä—Ā—Ė—Ź - Gemini 3.1 Pro. –ď–ĺ–Ľ–ĺ–≤–Ĺ–ł–Ļ –į–ļ—Ü–Ķ–Ĺ—ā –∑—Ä–ĺ–Ī–Ľ–Ķ–Ĺ–ĺ –Ĺ–į «–ü–Ķ—Ä—Ā–ĺ–Ĺ–į–Ľ—Ė–∑–ĺ–≤–į–Ĺ–ł–Ļ —Ė–Ĺ—ā–Ķ–Ľ–Ķ–ļ—ā» - –∑–ī–į—ā–Ĺ—Ė—Ā—ā—Ć AI –Ī—É—ā–ł –Ņ—Ä–ĺ–į–ļ—ā–ł–≤–Ĺ–ł–ľ –Ņ–ĺ–ľ—Ė—á–Ĺ–ł–ļ–ĺ–ľ, —Ź–ļ–ł–Ļ –∑–Ĺ–į—Ē –ļ–ĺ–Ĺ—ā–Ķ–ļ—Ā—ā –∑–į–≤–ī—Ź–ļ–ł —Ė–Ĺ—ā–Ķ–≥—Ä–į—Ü—Ė—ó –∑ –Ī—Ä–į—É–∑–Ķ—Ä–ĺ–ľ, –Ņ–ĺ—ą—ā–ĺ—é, –ļ–į–Ľ–Ķ–Ĺ–ī–į—Ä–Ķ–ľ, —Ą–į–Ļ–Ľ–į–ľ–ł —ā–į –ī–ĺ–ļ—É–ľ–Ķ–Ĺ—ā–į–ľ–ł.