Учёные улучшают эффективность нейросети, уменьшая количество в ней нейронов

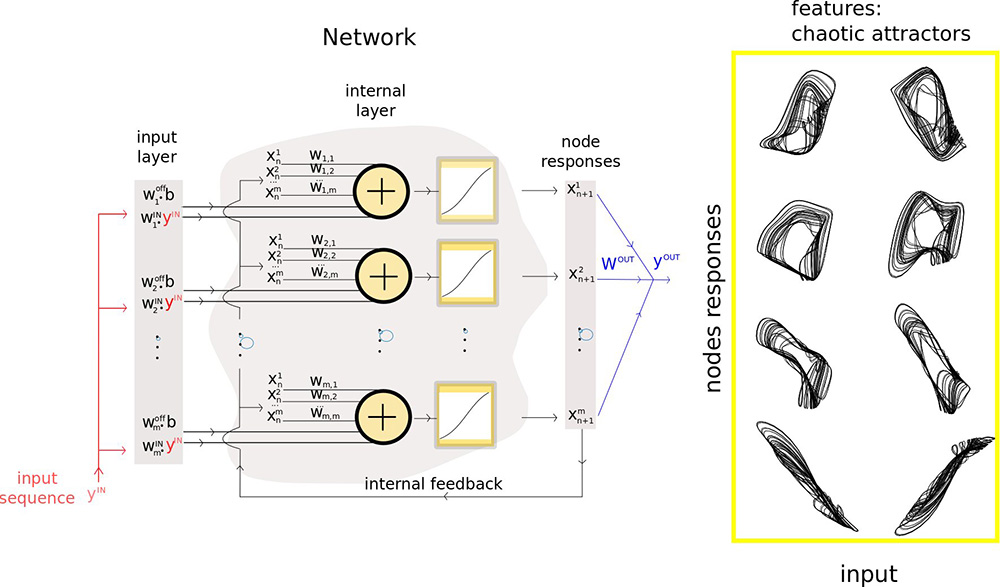

Группой исследователей из канадского университета Куинс недавно был предложен метод уменьшения размера случайных рекуррентных нейросетей (rRNN). Этот класс нейросетей часто используется для того, чтобы строить прогнозы на основе данных.

Статья, описывающая способ, как свести к минимуму количество нейронов в скрытом слое rRNN с увеличением производительности выдачи прогнозов (биржевого курса, погоды, эволюции патологий и т.д.), предварительно опубликована на сервере arXiv.

«В этом исследовании мы искали стратегии для понимания принципов действия нейронных сетей и в то же время пытались сократить количество нейронов в создаваемых сетях без негативного влияния на их производительность при решении задачи», — рассказала Бики Маркес (Bicky Marquez), принимавшая участие в этом междисциплинарном проекте на стыке теории нелинейных динамических систем, анализа временных рядов и машинного обучения.

Эта методика может быть использована для извлечения из входных данных rRNN релевантных признаков и управления процессом уменьшения скрытых слоев нейросети, что в конечном итоге улучшает продуктивность выдачи ею прогнозов. «Если мы сможем выявить и устранить шум вокруг этих важных признаков, мы сможем использовать их для улучшения производительности нашей сети», — отметила Маркес.

Используемая авторами модель состояла как из реальных, так и виртуальных нейронов, она показала рекордную эффективность в решении сложных задач, таких как качественное долгосрочное прогнозирование хаотических сигналов. Маркес и её коллеги использовали свой гибридный процессор, чтобы стабилизировать аритмическую модель возбуждения нейронов (модель ФитцХью-Нагумо). Это позволило уменьшить размер стабилизированной сети в 15 раз по сравнению со стандартными нейросетями.

Новая методика также привлекательна тем, что может сделать работу rRNN более прозрачной, и дать пользователям важное понимание того, как нейросеть приходит к своим выводам.

Следующим шагом канадской команды должна стать физическая реализация такой оптимизированной рекуррентной нейросети, что станет предпосылкой к созданию нейроморфного компьютера для быстрого и энергоэффективного решения задач искусственного интеллекта.