Суперкомпьютер Google на Tensor Processing Unit установил мировой рекорд

Итоги прохождения очередных эталонных состязаний MLPerf продемонстрировали, что компании Google удалось создать самый быстродействующий в мире компьютер для тренировки моделей машинного обучения (ML). С помощью этого компьютера, а также новейших чипов Tensor Processing Unit (TPU), поисковый гигант установил рекорды производительности в шести из восьми тестов MLPerf.

Для четырёх из восьми реализаций ML-модели в фреймворках TensorFlow, JAX и Lingvo, время обучения с нуля не превышало 30 секунд. Для сравнения, всего пять лет назад на обучение одной из этих моделей тратилось почти на пять порядков больше времени (более трёх недель) с использованием самых совершенных аппаратных ускорителей, доступных тогда.

Использовавшийся в этом раунде MLPerf Training компьютер Google в четыре раза больше, чем Cloud TPU v3 Pod, который принёс компании три рекорда в предыдущих соревнованиях (MLPerf Training v0.6). Новая система включает в себя 4096 чипов TPU v3 и сотни центральных процессоров хост-машин, объединённых в сверхскоростную крупномасштабную сеть с пиковой производительностью 430 PFLOPs. Увеличившийся масштаб позволил для получения рекордных результатов максимально задействовать параллелизм моделей, пакетную нормализацию, эффективные графы и древовидную инициализацию весов.

В дополнение к лучшим в отрасли показателям в максимальном масштабе, Google также предоставила результаты MLPerf для открытой среды машинного обучения TensorFlow на Google Cloud, которая готова к использованию предприятиями уже сегодня.

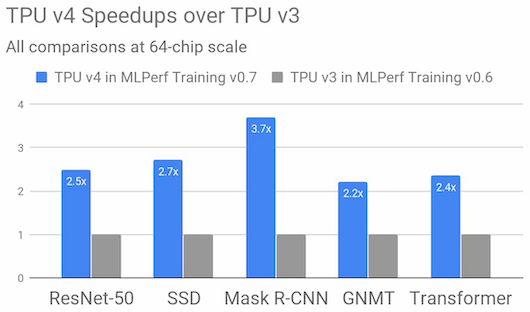

Четвёртое поколение специализированных ASIC TPU от Google более чем удваивает производительность TPU v3 на операциях перемножения матриц благодаря прогрессу в увеличении пропускной способности памяти и в технологиях межсоединений. Представленные Google результаты TPU v4 MLPerf сочетают эти аппаратные преимущества с усовершенствованиями в компиляторе и моделях. Среднее улучшение производительности составляет 2,7х по сравнению с TPU v3 на прошлом соревновании MLPerf Training. Google обещает опубликовать больше сведений о TPU v4 в скором времени.

Компания заявила, что успех в раунде MLPerf Training v0.7 демонстрирует её приверженность к совершенствованию технологий машинного обучения и к приобщению пользователей к этим новейшим достижениям через открытое ПО, свои продукты и платформу Google Cloud.