Ironwood та Axion - Google намагається перехопити ініциативу у сегмненті AI-обчислень

9 ноябрь, 2025 - 10:54КОГлобальні перегони в галузі штучного інтелекту та хмарних обчислень перейшли у фазу глибокої вертикальної інтеграції. Сьогодні для провідних хмарних провайдерів (CSP) недостатньо покладатися виключно на сторонніх виробників чипів, таких як NVIDIA, Intel або AMD. Розробка власного кремнію стала єдиним шляхом до досягнення справді унікальної продуктивності-на-ват, максимальної маржинальності та повного контролю над інфраструктурою.

Google Cloud виводить цю стратегію на новий рівень, представивши свій «кремнієвий дует». Ironwood, сьоме покоління Tensor Processing Unit (TPU), призначене для надвеликих AI-навантажень. Та Axion, перший Arm-базований процесор Google для загальних обчислень. За оцінками аналітиків цей подвійний запуск є стратегічним кроком, який дозволяє Google Cloud покрити 100% корпоративних потреб — від високопродуктивного AI до рутинних серверних завдань.

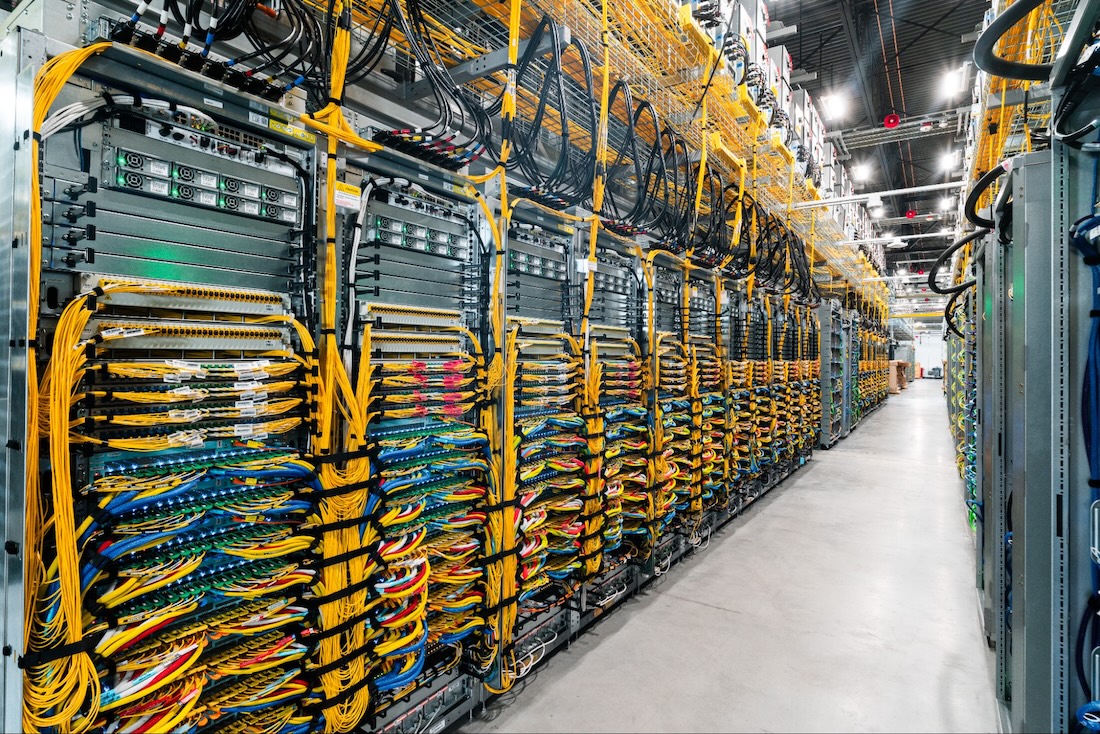

Обидва нові чипи формують основу інтегрованої суперкомп’ютерної платформи Google, відомої як AI Hypercomputer. Цей підхід поєднує обчислення, зберігання та мережеву інфраструктуру під єдиним, вертикально оптимізованим шаром управління. Головна обіцянка для корпоративного сектора - забезпечення провідної ціни-продуктивності та радикальне зниження сукупної вартості володіння (TCO). Axion орієнтований на загальні робочі навантаження, обіцяючи до 65% краще співвідношення ціна-продуктивність порівняно з існуючими x86-інстансами, тоді як Ironwood націлений на AI, пропонуючи до 10x пікового приросту продуктивності над попередниками.

Ironwood TPU: новий фокус на масштабному інференсі

Сьоме покоління TPU, Ironwood, є найпотужнішою та найбільш енергоефективною розробкою Google. Його архітектура та технічні характеристики демонструють агресивну позицію на ринку високопродуктивних обчислень, де зараз домінують рішення від NVIDIA.

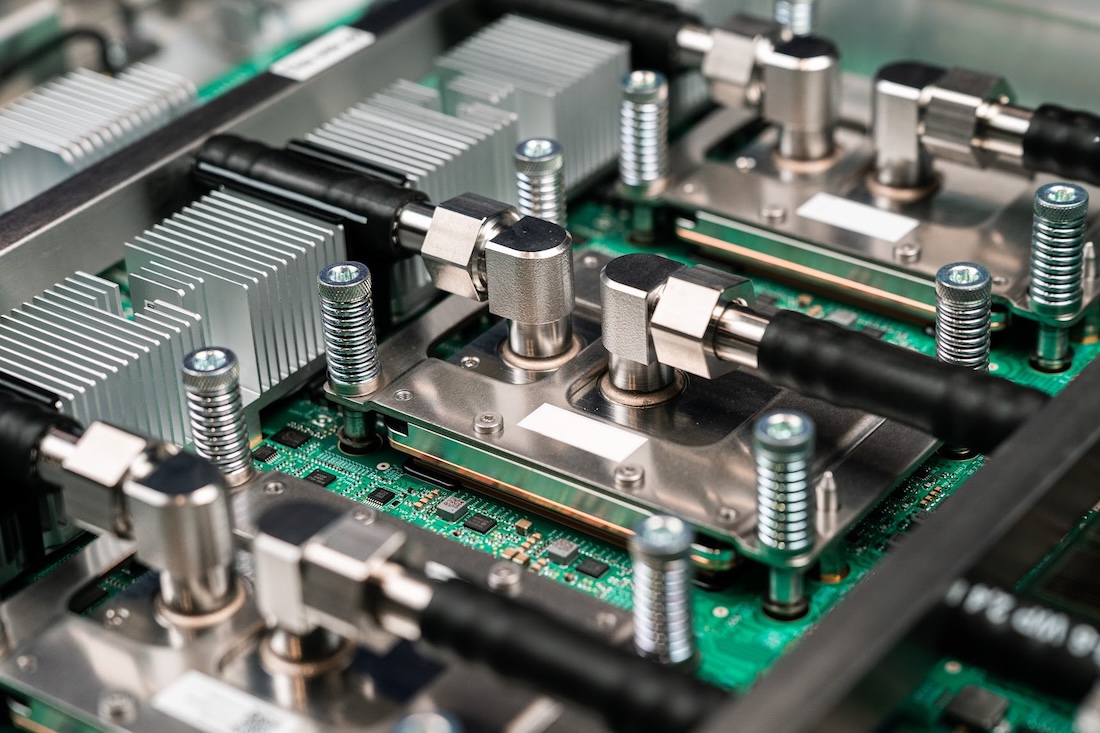

Кожен чип Ironwood TPU забезпечує вражаючі 4,614 TFLOP пікової продуктивності, використовуючи 8-бітну плаваючу точку (FP8). Це дозволяє масштабувати обчислювальні ресурси до безпрецедентних розмірів. При об'єднанні 9216 таких чипів у єдиний Superpod, система досягає колосальної потужності 42.5 ExaFLOP. Цей показник не лише відображає так би мовити сиру міць, але й окреслює можливості Google у великомасштабних розподілених обчисленнях.

Критично важливим фактором для сучасних великих мовних моделей (LLM) та мультимодальних систем є пам'ять. Ironwood оснащений 192 GB високошвидкісної пам'яті HBM на чип, що забезпечує пропускну здатність 7,2 TB/s.Це має вирішальне значення для ефективної роботи моделей з великим контекстним вікном та моделей з експертною архітектурою (MoE, Mixture-of-Experts), де потрібна швидка подача даних. Порівняно з деякими конкурентними рішеннями, Ironwood має більш ніж подвійну пропускну здатність пам'яті.

Для забезпечення плавного потоку даних між тисячами чипів Google значно оновила інтерконект. Двонаправлений Inter-Chip Interconnect (ICI) забезпечує пропускну здатність 1,2 TB/s на чип.

Хоча попередні покоління TPU були універсальними, Ironwood стратегічно позиціонується насамперед для високооб'ємного, низьколатентного обслуговування (inference) та складного навчання з підкріпленням (reinforcement learning). Цей фокус відображає зрілість ринку AI. Підприємства, які вже завершили етап первинного тренування своїх моделей, тепер стикаються з постійними та зростаючими операційними витратами на масове обслуговування (serving) генеративного AI. Ironwood спрямований саме на цей етап, пропонуючи значно кращу, до 4x, продуктивність на чип для тренування та інференсу порівняно з TPU v6e (Trillium).

Ще раз слід зазначити, що Ironwood — це не ізольований компонент, а ключова частина AI Hypercomputer, цілісної суперкомп'ютерної платформи. У цьому контексті інженерні рішення, що стосуються надійності та інтеграції, стають настільки ж важливими, як і пікова продуктивність.

Надзвичайна масштабованість до 9216 чипів збільшує ймовірність апаратних збоїв. Для підтримки безперервної роботи та високої операційної ефективності Google використовує реконфігуровану мережеву тканину під назвою Optical Circuit Switching (OCS). Ця технологія дозволяє системі миттєво обходити будь-які апаратні перебої та підтримувати безперервне функціонування надвеликих подів. З інженерної точки зору, OCS є необхідною відповіддю на виклики ультра-масштабування, що значно знижує ризики простоїв у критично важливих AI-виробничих середовищах.

IDC підтверджує системну перевагу моделі AI Hypercomputer, приписуючи їй середній 353% трирічний коефіцієнт окупності інвестицій (ROI), на 28% нижчі ІТ-витрати та на 55% вищу операційну ефективність для корпоративних клієнтів.

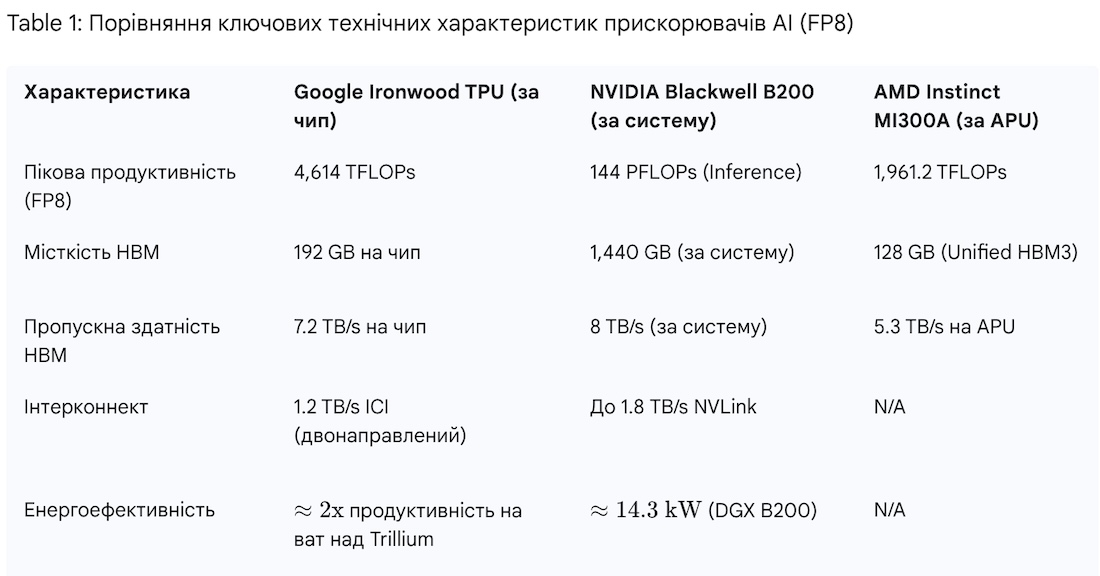

Експерти ринку зазначають, що Ironwood є агресивним технологічним інструментом, що конкурує з найсучаснішими прискорювачами. Нижче представлено порівняння ключових технічних характеристик Ironwood з конкурентами на ринку.

Битва гігантів: економіка TCO та протистояння Ironwood vs. NVIDIA

Хоча Google позиціонує Ironwood як систему, що перевершує навіть новітні рішення, такі як NVIDIA GB300, слід зазначити, що галузеві стандартні бенчмарки MLPerf для Ironwood поки що не опубліковані. Ця відсутність незалежних даних зміщує фокус оцінки від пікової продуктивності до економічних метрик.

Для технологічних директорів (CTO) та фінансових відділів, що займаються впровадженням AI, ключовими показниками для порівняння є не лише TFLOP, а й показники сукупної вартості володіння (TCO), зокрема Cost-per-Token — вартість обробки або генерації одиниці тексту. Цей показник є єдиним об'єктивним способом оцінки операційних витрат на обслуговування широкомасштабних LLM у виробничому середовищі.

Звітні дані свідчать про те, що TPU історично забезпечують 1,2–1,7× кращу продуктивність на долар порівняно з конкурентами та можуть знизити загальні витрати на 20–30% завдяки меншим вимогам до енергоспоживання та охолодження. Заявлена Google подвійна енергоефективність Ironwood над попереднім поколінням Trillium має на меті значно посилити цю економічну перевагу.

Модель ціноутворення TPU залишається суто хмарною: послуги доступні виключно за моделлю "Pay-as-you-go" (плати-по-факту). Наприклад, попередні покоління (v5p) коштували $4,20/чип-годину, а v5e — $1,20/чип-годину, зі значними знижками (до $1,89/чип-годину для v5p) при 3-річних зобов'язаннях. Ця модель є надзвичайно вигідною для стартапів та компаній, які потребують гнучкості та не можуть дозволити собі великі капітальні витрати на закупівлю обладнання.

Проте, при аналізі TCO необхідно враховувати інфраструктурну стратегію клієнта. TPU економічно може бути вигідні для чистих, великомасштабних завдань машинного навчання, особливо в екосистемі Google. Але для деяких організацій, які вимагають максимального контролю або мають необхідну інфраструктуру, розгортання NVIDIA H100 у власних дата-центрах (on-premises) TPU мже забезпечити нижчу довгострокову TCO. Це пов'язано з тим, що компанії уникають постійних операційних хмарних витрат після початкової закупівлі апаратного забезпечення. Таким чином, вибір оптимального рішення TCO залежить від специфіки робочого навантаження, наявного капіталу та стратегії розміщення інфраструктури.

Навіть до широкої доступності Ironwood вже отримав потужне індустріальне підтвердження. Компанія Anthropic планує отримати доступ до одного мільйона TPU для роботи та розширення своєї лінійки моделей Claude, що прямо вказує на суттєві переваги Ironwood у співвідношенні витрати-продуктивність. Крім того, компанія Lightricks використовує платформу Ironwood для тренування та обслуговування своєї мультимодальної системи LTX-2, відзначаючи помітні покращення якості генеративних медіа.

Axion CPU: фундамент оптимізації загальних навантажень

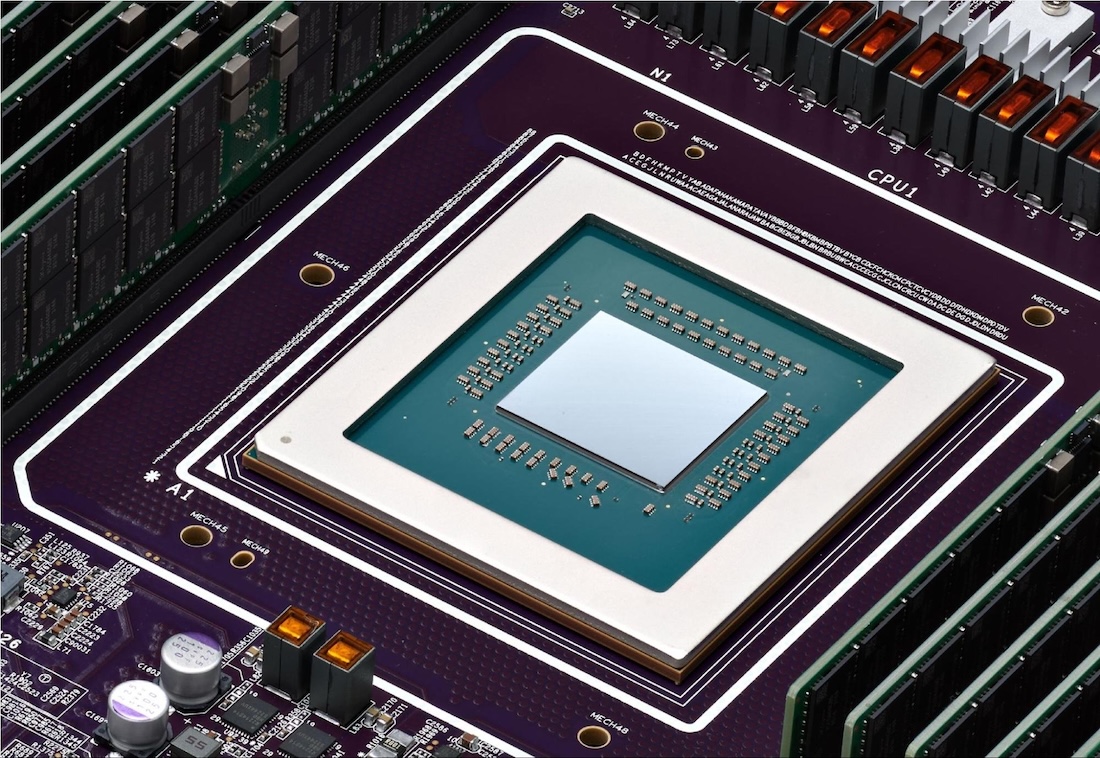

Google Cloud паралельно з Ironwood представила процесори Axion, свої перші Arm-базовані серверні процесори загального призначення. Axion позиціонується як революційний інструмент для зниження TCO не лише для AI, а й для рутинних корпоративних навантажень.

Axion є власною розробкою Google, побудованою на базі архітектури Armv9 та ядер Arm Neoverse V2/N3. Ці процесори призначені для забезпечення високої продуктивності та ефективності для таких навантажень, як веб-додатки та ad-сервери, а також бази даних.

Нові інстанси C4A Metal підтримують до 96 vCPU та 768 GB пам'яті DDR5, а N4A VMs, що зараз знаходяться у попередньому перегляді, підтримують до 72 vCPU та 576 GB DDR5. Значний обсяг кеш-пам'яті, включаючи 80MB L3 та 2MB L2 на ядро, забезпечує високу швидкість доступу до даних.

Порівняння продуктивності Axion з конкурентами вказує на його лідерство в Arm-серверному сегменті. Axion демонструє майже 10% перевагу в продуктивності над AWS Graviton4 і значно вищу ціну-продуктивність, ніж існуючі інстанси x86-64.7

Ключовим фактором, що забезпечує проривну ефективність Axion, є глибока інтеграція з апаратно-програмною системою Titanium. Це система спеціалізованих мікроконтролерів та багаторівневих апаратних офлоадів (розвантаження), спроектована для роботи в тандемі з Axion.

Зазвичай, значна частина ресурсів центрального процесора у віртуальних машинах витрачається на виконання інфраструктурних завдань, таких як робота гіпервізора, мережевий стек, безпека та управління життєвим циклом. Titanium бере ці інтенсивні завдання на себе, використовуючи спеціалізовані offload-механізми. Це звільняє ресурси процесора Axion, дозволяючи йому присвятити більшу частину обчислювальної потужності безпосередньо клієнтським робочим навантаженням.

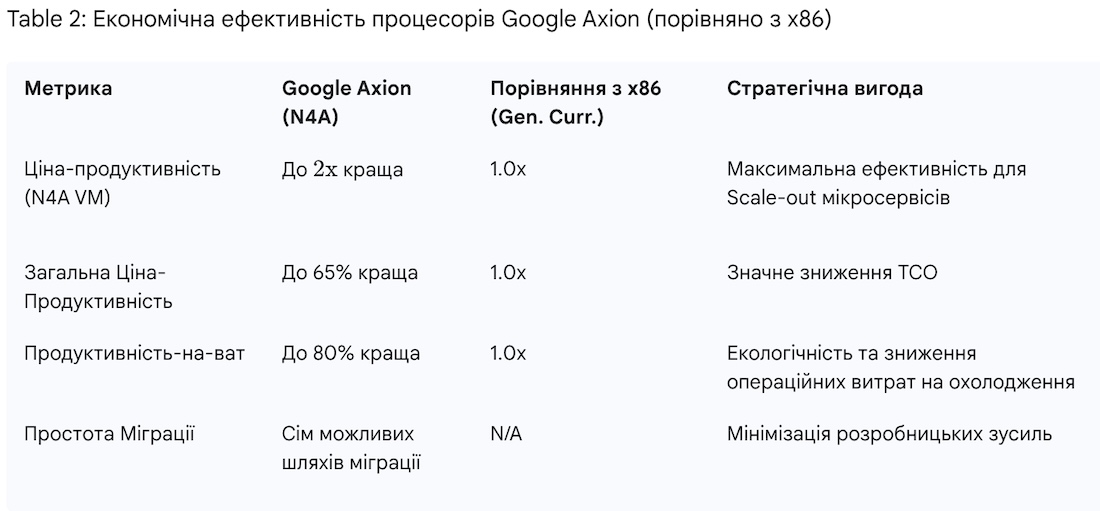

Ця глибока вертикальна інтеграція забезпечує передбачувану, високу продуктивність та мінімальні затримки, що є критично важливим для хмарних мікросервісів та CI/CD систем. Завдяки Titanium, Axion N4A VM забезпечують майже двукратну перевагу по показнику ціна-продуктивність та 80% кращу продуктивність-на-ват порівняно з аналогічними x86-based VM.

Axion змінює економіку загальних обчислень. Цей процесор майже ідеально підходить для хмарно-орієнтованих бізнесів, які використовують масштабовані мікросервіси на GKE, а також для корпоративних команд, що управляють базами даних (зокрема, Cloud SQL та AlloyDB для PostgreSQL).

Прикладом успішного впровадження є Databricks, яка, перейшовши на Axion-базовані C4A VM, досягла 40% підвищення ефективності для своїх складних робочих навантажень, що включають Data Warehousing та AI. Загалом, Axion пропонує клієнтам до 65% кращу ціну-продуктивність порівняно з поточним поколінням x86-інстансів, забезпечуючи значне зниження TCO.

Нижче наведено порівняння економічної ефективності Axion.

Стратегічні можливості для українського технологічного сектора

Впровадження новітньої інфраструктури Google Cloud має особливе стратегічне значення для українського технологічного сектора, який, попри виклики війни, переживає бум AI-first інновацій.

Українські стартапи, підтримані, зокрема, Google for Startups Ukraine Support Fund, змістили свій фокус від простого виживання до вирішення складних, глибоких технологічних викликів у сферах безпеки, охорони здоров’я, боротьби з дезінформацією та оборонних технологій.

Google подвоїв свою фінансову підтримку українських засновників до 10 млн дол., надаючи кожному реципієнту не лише фінансування, а й до $350,000 у Google Cloud Credits.Для Deep Tech компаній, яким необхідна потужність класу ExaFLOPS для тренування складних моделей, доступ до Ironwood TPU через ці кредити є критичним немонетарним ресурсом. Це значно знижує поріг входу у світ найсучасніших технологій, що є запорукою стійкості та інноваційної активності малих та середніх підприємств.

AI-Оборона та Кібербезпека: Звіт Google Cloud "Cybersecurity Forecast 2026" попереджає, що кіберзловмисники повністю інтегрують AI для прискорення та масштабування атак, використовуючи, наприклад, prompt injection та AI-enabled соціальну інженерію. Для ефективної оборони та розгортання власних AI-агентів, які повинні встигати за швидкістю загроз, українські компанії потребують потужностей Ironwood TPU для швидкого тренування та інференсу моделей ідентифікації загроз.

Синергія Arm для Edge-рішень: Компанії, що працюють у сфері робототехніки та промислового AI, як-от Deus Robotics, яка використовує AI для оркестрування роботи складів, отримують значну перевагу від Axion. Оскільки Edge-системи та вбудовані системи часто базуються на архітектурі Arm, використання Axion (який також є Arm-базованим) забезпечує архітектурну узгодженість між хмарою та кінцевими пристроями. Це спрощує розробку, тестування та безшовне розгортання, прискорюючи вихід критично важливих рішень на ринок та знижуючи витрати на розробку.

Незважаючи на значні обіцянки TCO, перехід на Arm-базовану інфраструктуру Axion вимагає від розробників уваги до міграційних процесів. Хоча Google пропонує сім можливих шляхів міграції (включаючи контейнеризовані навантаження та підтримку для Linux-інтерпретованих мов, таких як Java, Python, PHP), командам необхідно інвестувати час у ретельну перевірку сумісності та, можливо, рекомпіляцію низькорівневих бібліотек, які можуть бути оптимізовані під x86.

Майбутнє, інтегроване на кремнієвому рівні

Треба зазначити, що запуск Ironwood TPU та Axion CPU демонструє завершення ключового етапу вертикальної інтеграції Google Cloud. Компанія тепер пропонує кастомний кремній, оптимізований для кожного основного типу обчислювальних навантажень, що забезпечує їй максимальний контроль над продуктивністю, енергоефективністю та, що найважливіше, економікою хмарних послуг.

Ironwood — це не просто швидкий чип. Це високомасштабована платформа, архітектурно націлена на TCO інференсу для LLM. Завдяки безпрецедентній пропускній здатності пам'яті та системній надійності OCS, він створює пряму та вагому конкуренцію для домінуючих рішень NVIDIA на ринку масового обслуговування AI-моделей.

Axion, підсилений апаратним розвантаженням Titanium, змінює економічну парадигму загальних обчислень. Обіцянка до 65% кращої ціни-продуктивності робить Axion надзвичайно привабливим для масового корпоративного впровадження, особливо для масштабованих мікросервісів, що є визначальним для хмарної архітектури майбутнього.