Google сделала еще один шаг в направлении глубокого понимания поисковых запросов

Компания Google на конференции I/O анонсировала очередные улучшения своего поиска.

Как отмечается, одна из самых сложных проблем для поисковых систем сегодня — помочь пользователями с комплексными задачами, например, спланировать, чем заняться на семейной прогулке. Специалисты Google обнаружили, что для решения подобных задач требуется в среднем восемь поисковых запросов.

В 2019 году было запущено использование технологии BERT в поиске Google. Это модель искусственного интеллекта, позволяющая лучше понимать истинный смысл поискового запроса. По уверению компании, использование технологии BERT стало огромным прорывом.

Теперь с новой технологией многозадачной унифицированной модели, или MUM, поиск Google может лучше понимать сложные вопросы и потребности пользователей, поэтому им потребуется меньше поисковых запросов. Как и BERT, эта модель построена на архитектуре глубоких нейронных сетей Transformer, которые стали огромным шагом вперед в понимании языка. Однако MUM в 1000 раз мощнее, чем BERT, и способна выполнять множество задач одновременно, чтобы анализировать информацию новыми способами.

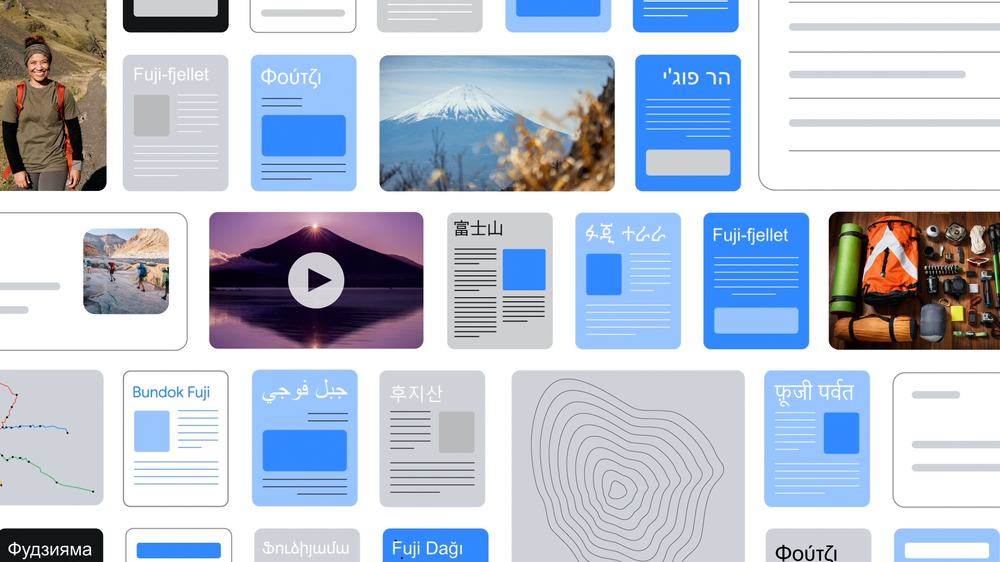

Модель MUM не только понимает язык, но и генерирует его. MUM обучалась на 75 языках и множестве задач одновременно, что дает ей более широкое понимание информации, чем у предыдущих моделей. Кроме того, MUM мультимодальна, то есть она распознает информацию в виде текста и изображений, а в будущем может перейти на дополнительные модальности, такие как видео и аудио.

Рассмотрим сложный запрос в разговорной форме, например «У меня уже было восхождение на гору Адамс, следующей осенью я хочу подняться на гору Фудзи, что мне нужно изменить в подготовке?». Сейчас поисковые системы не способны справиться с таким вопросом, но, возможно, в будущем MUM сможет понять его и сгенерировать структурированный ответ, указывающий на высокорелевватные результаты. В Google начали внутренние пилотные проекты с MUM и видят большой потенциал этой модели для развития продуктов.