Gobblin — шлюз в Big Data для LinkedIn

Во вторник LinkedIn сообщила дополнительные подробности о системе Gobblin, помогающей этой социальной сети ежедневно вбирать в себя десятки терабайт разнородных данных и анализировать их в хранилищах на базе Hadoop.

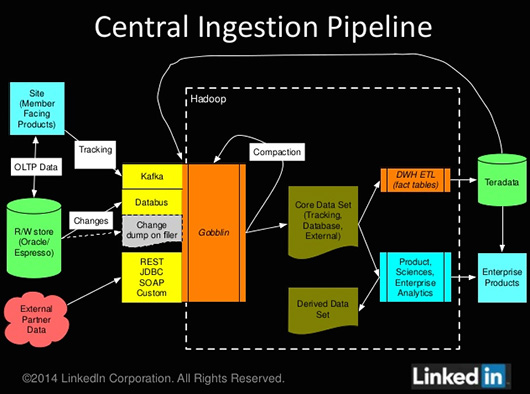

Наряду с различными внутренними данными (информация о профилях участников и пользовательских действиях), хранящимися в таких БД, как Espresso и системах регистрации событий, таких как Kafka, LinkedIn, пусть и в меньших объемах, но собирает сведения и из внешних источников, включая Twitter и Salesforce.

В итоге компании для перемещения всей этой информации в большую централизованную систему Hadoop приходится принимать во внимание слишком много переменных — типы источников данных (потоки событий, файлы журналов и пр.), разновидности потоков (пакетная загрузка или трансляция) и даже транспортные протоколы (REST, Kafka, внутренние API и пр.).

В блоге LinkedIn указывается, что эта социальная сеть использует более 15 типов механизмов получения данных и прилагает все усилия для того, чтобы для всех них обеспечивались одинаковые уровни качества данных и функциональности.

Упростить задачу «усвоения» разнородной информации, требующей собственных протоколов, и призвана система Gobblin, которая действует как шлюз в Hadoop, контролируя, чтобы данные направлялись в нужные файловые каталоги. Она включает в себя набор готовых адаптеров для Salesforce, MySQL, Google, Kafka, Databus и других источников данных. Взаимодействие с менеджером ресурсов YARN позволяет организовывать получение пакетов по расписанию или непрерывное поступление информации.

Gobblin также предоставляет сторонним разработчикам возможность создавать и подключать переходники для дополнительных источников данных. Компания сообщила, что в течение ближайших недель планирует перевести эту систему на модель Open Source.