AMD представила PCIe-прискорювачі Instinct MI350P для наявної інфраструктури

Компанія AMD оголосила про випуск нових графічних прискорювачів AMD Instinct MI350P PCIe, які пропонують підприємствам «третій шлях» впровадження штучного інтелекту. Новинка дозволяє отримати флагманську продуктивність без необхідності повної перебудови серверних стійок, систем живлення та охолодження.

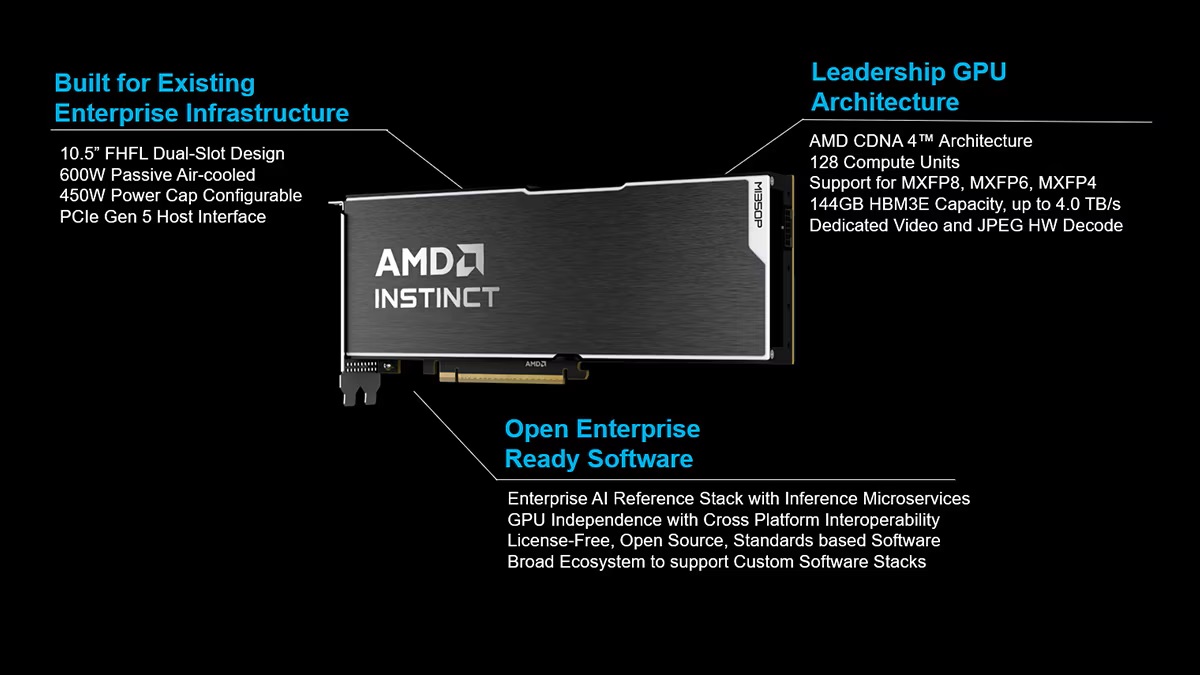

Головна перевага Instinct MI350P - формат стандартної двослотової PCIe-карти з повітряним охолодженням. Це робить їх оптимальним рішенням для компаній, які хочуть розгорнути локальний (on-prem) штучний інтелект, але не готові інвестувати у спеціалізовані дорогі платформи з рідинним охолодженням.

Карти призначені для встановлення у звичайні сервери, що дозволяє запускати малі, середні та великі AI-моделі для інференсу (виведення) та RAG-конвеєрів безпосередньо у власному дата-центрі.

Для AMD Instinct MI350P заявлена пікова продуктивність до 4600 TFLOPS у форматі MXFP4 - найвищий показник на ринку для карт такого типу.

Модель оснащена 144 ГБ надшвидкої пам'яті HBM3E із пропускною здатністю до 4 ТБ/с.

В новинці реалізована нативна підтримка форматів низької точності (MXFP6, MXFP4) та прискорення розріджених обчислень (sparsity) для стандартних форматів INT8 та BF16.

Архітектура розроблена для мінімізації використання пам'яті та енергоспоживання, що критично для повітряного охолодження.

AMD продовжує стратегію відкритого ПЗ, пропонуючи корпоративний стек AI без ліцензійних зборів. Це дозволяє компаніям мігрувати навантаження з мінімальними правками коду завдяки нативній підтримці PyTorch та Kubernetes GPU Operator, а також використовувати готові мікросервіси (AMD Inference Microservices) для хмарно-орієнтованого розгортання.

Крім того, рішення дає можливість уникнути «потокенової» оплати, яка характерна для хмарних сервісів, зберігаючи повну приватність даних.

«Впровадження AI не повинно означати будівництво інфраструктури з нуля, - зазначають в AMD. - З Instinct MI350P підприємства можуть запускати більше моделей і обслуговувати більше користувачів у межах тих дата-центрів, якими вони вже володіють».

Багато організацій стикаються з проблемою: хмарний AI - це дорого та не завжди приватно, а модернізація власного дата-центру під надпотужні прискорювачі вимагає мільйонних інвестицій. Зазначено, MI350P PCIe стає «золотою серединою», забезпечуючи потужність, необхідну для епохи агентського AI (Agentic AI), у знайомому та доступному форматі.