| 0 |

|

Исследователи из Дартмутского Колледжа, Tecnalia Research & Innovation и Microsoft Research Cambridge создали и испытали самообучающуюся систему машинного зрения, предназначенную для того, чтобы извлекать семантическую информацию из фотографий, а впоследствии также из видео, на веб-страницах. Эта информация дополняет описание HTML-страницы, используемое поисковыми механизмами для обнаружения нужных документов.

«За последние 30 лет Веб эволюционировал из небольшой коллекции преимущественно текстовых документов в современную, гигантскую и стремительно растущую совокупность мультимедиа-данных, где почти каждая страница включает множество картинок и видео, — отмечает адъюнкт-профессор Лоренцо Террезани (Lorenzo Torresani), соавтор статьи, опубликованной в журнале PAMI (IEEE Transactions on Pattern Analysis and Machine Intelligence). — Как ни странно, все существующие популярные поисковые механизмы, такие как Google или Bing, отбрасывают содержащуюся в фотографиях информацию и используют исключительно текст Веб-страниц. Наша работа впервые показывает, что современные системы машинного зрения достаточно эффективны и точны для продуктивного применения информации, извлеченный из пикселей изображения, для улучшения поиска документов».

Новая технология тестировалась на базе данных из 50 млн веб-страниц. Модифицированный авторами высокопроизводительный текстовый поисковик в 600 запросах продемонстрировал увеличение точности на 30% по сравнению с чисто текстовым поиском.

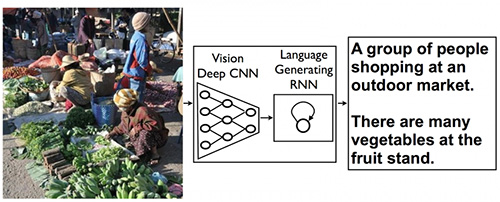

«Я бы назвала пиксельные данные в изображениях и видео темным веществом Интернета, и мы начинаем освещать его», — заявляет Фэйфэй Ли (Fei-Fei Li), директор Лаборатории искусственного интеллекта Стэнфордского университета. Вместе с аспирантом Андреем Карпатым, соавтором доклада «Deep Visual-Semantic Alignments for Generating Image Descriptions», она работает над Multimodal Recurrent Neural Architecture, системой аннотирования картинок на естественном языке, создающей семантическую связь с визуальным контентом веб-страниц.

Аналогичные исследования в Google ведут сотрудники Google Research Ориол Виньялс (Oriol Vinyals), Александр Тошев (Alexander Toshev), Сэми Бенджио (Samy Bengio) и Думитру Эрхан (Dumitru Erhan).

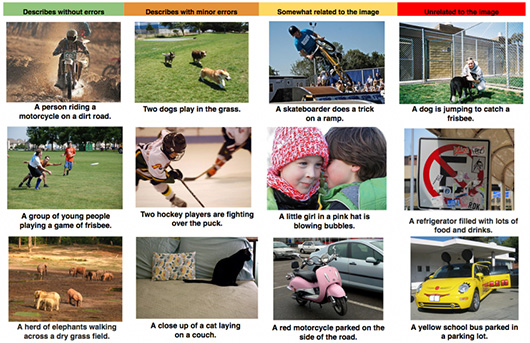

Разработанная ими самообучающаяся система способна автоматически генерировать описания картинок. Согласно сообщению в блоге, в будущем такая система сможет помогать воспринимать изображения людям с дефектами зрения, заменять их альтернативной текстовой информацией при низкой пропускной способности беспроводных коммуникаций, упрощать пользование Google для поиска картинок, каталогизировать онлайновые банки фотографий и видео.

Стратегія охолодження ЦОД для епохи AI

| 0 |

|